别光吃瓜!Claude 51万行源码泄露,跟我们普通人到底有啥关系?

-

先给你吃颗定心丸:你的数据没泄露

-

跟普通人最相关的3件事

1. 你用的AI工具,以后可能更 “卷”、更便宜

-

更多好用、免费的AI工具会冒出来,竞争更激烈;

-

大厂不敢随便涨价、功能更新会更快;

-

以前只有Claude、GPT-4有的高级能力,很快会下放到普通产品。

2. 你的AI安全,被摆上了台面

-

所有AI产品都会被迫升级安全机制,你的电脑、文件被AI误操作的风险降低

-

行业会更重视 “AI权限管控”,以后用AI工具更放心

-

你会越来越清楚:AI能做什么、不能做什么,不再是 “盲信”

3. 提前剧透:AI未来要变成 “常驻助手”

多智能体系统:一个任务拆成多个小AI协作完成;

自主守护进程:AI能在后台默默运行,不用每次手动唤醒;

电子宠物、持久化助手:AI会记住你的习惯,像 “常驻伙伴” 一样。

对我们意味着:

-

不用再反复教AI你的偏好,它会越来越懂你;

-

AI会更主动:帮你整理文件、监控进度、主动提醒;

-

未来AI不再是 “用完即关” 的工具,而是常驻设备的 “助手”。

-

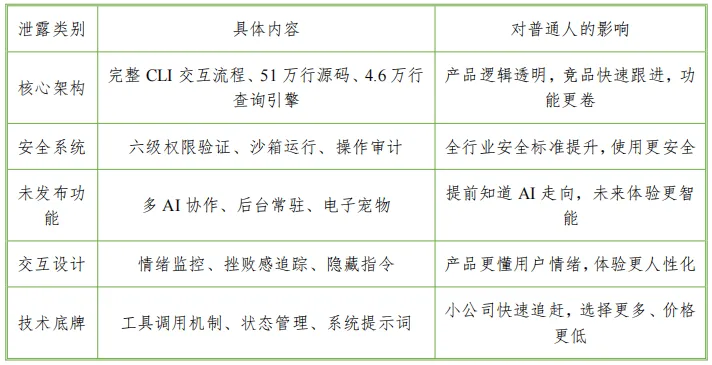

一张表看懂:到底泄露了什么?

-

最后想说:这不是灾难,是行业转折点

夜雨聆风

夜雨聆风