从齿轮到AI —— 人造物的四个层级

引言

不管我们有没有准备好,AI都扑面而来了。

今年似乎到了一个转折点,所有人都在谈如何使用AI提效。在把Agent融入工作流的尝试中,对我来说最主要的阻力在心理层面,我「不敢」让Agent自主执行,怕他犯错。一边是Gemini胡乱引用历史对话胡说八道;另一边Claude说建议你优化这个能省很多资源,尝试几次不行之后又说这事你别干了没啥用,有这个时间你不如干另一件事收益更高;角落里是满嘴emoji和超短句的ChatGPT… 以至于Claude Code要执行一段很长的脚本我都得让他停下来先解释要干啥。

我仍然认为AI不够可靠,但也看到模型和Agent都在变强,那么质变的临界点在哪?和我的理解有多大偏差?新的范式会是什么?

我想有一个框架来理解现状、推演未来。AI和人类建造的其他东西到底有什么不同,为什么AI不可靠、如何变得可靠?一个多月前,有个想法出现在脑子里。

人造物的四个层级

看了一个关于圣家堂的视频。这座教堂已经建了 144 年,还有 10 年完工。让我印象深刻的是,当时没有计算机辅助,建筑师高迪用精妙的物理模拟来设计承重结构。倒挂模型,绳索自然下垂的形状就是受力最优的拱形。几百上千年前建筑师们使用的技术,能够让建筑使用到今天,也正是因为其预期寿命够长,人们才愿意花一百多年去建造它。

旅行者号花了近五十年飞出太阳系内层,至今仍在运行。一些基础程序也持续运行了几十年,但Windows每一两周就让你更新;一个 AI 模型,一样的问题会输出不一样的答案,在最简单的问题上犯错,不知道就瞎编。

似乎人类建造的新东西越来越不可靠、寿命越来越短了。顺着这个脉络,从构成和工作原理上看,我把人造物分为四个层级,可靠性逐级递减。

第一层 物理实体

由物体本身的物理属性承载功能。小到一个齿轮,大到一个教堂。核心原理是牛顿力学和几何映射,系统可以被一个有明确定义域的确定性函数描述。一个齿轮在设计转速范围内的传动比、一座桥在设计载荷范围内的形变量,都可以简化为,输入严格决定输出。

物理实体是完全透明的。每个齿轮的咬合都符合牛顿力学,所见即所得。失效方式也是可预期的:材料疲劳、形变、在过载下断裂。工程师知道桥会怎么断,也就知道怎么加固。

为保证质量,你可以在原理层面做理论演算,也可以做疲劳试验。一根钢梁反复加载卸载,看它什么时候出裂纹。严谨,直接,可靠。

第二层 裸机程序

固化的物理实体无法承载灵活的功能,编程的思想出现了,用输入信息来控制机器的运行方式。程序编码直接控制机械或电路的行为,我把这一层级称为「裸机程序」。核心是,由一组明确的规则驱动,在每个时刻根据当前状态和输入决定下一个状态 —— 一个有限状态机:,核心范式是离散数学和逻辑门控制。

雅卡尔提花机,使用打孔卡编程

裸机程序为高颗粒度白盒,程序直接控制硬件,每一个状态都是可观测和追踪的。但新的脆弱性随之出现:信息失效,程序本身存在错误。电压抖动也可能导致逻辑错误,甚至一个宇宙粒子打中芯片,也可能让一个比特从 0 变成 1。

在大部分简单系统中,可以穷举测试所有可能状态,100%覆盖。复杂一些的系统用形式化验证,用数学证明程序在所有可能的状态下都满足某个性质。

第三层 抽象堆叠

需求和软硬件复杂度不断提升,很难通过直接方式构建大型软件。虽然理论上可行,没人会通过直接控制屏幕像素点RGB亮度值的方式手搓一个《黑神话:悟空》出来。

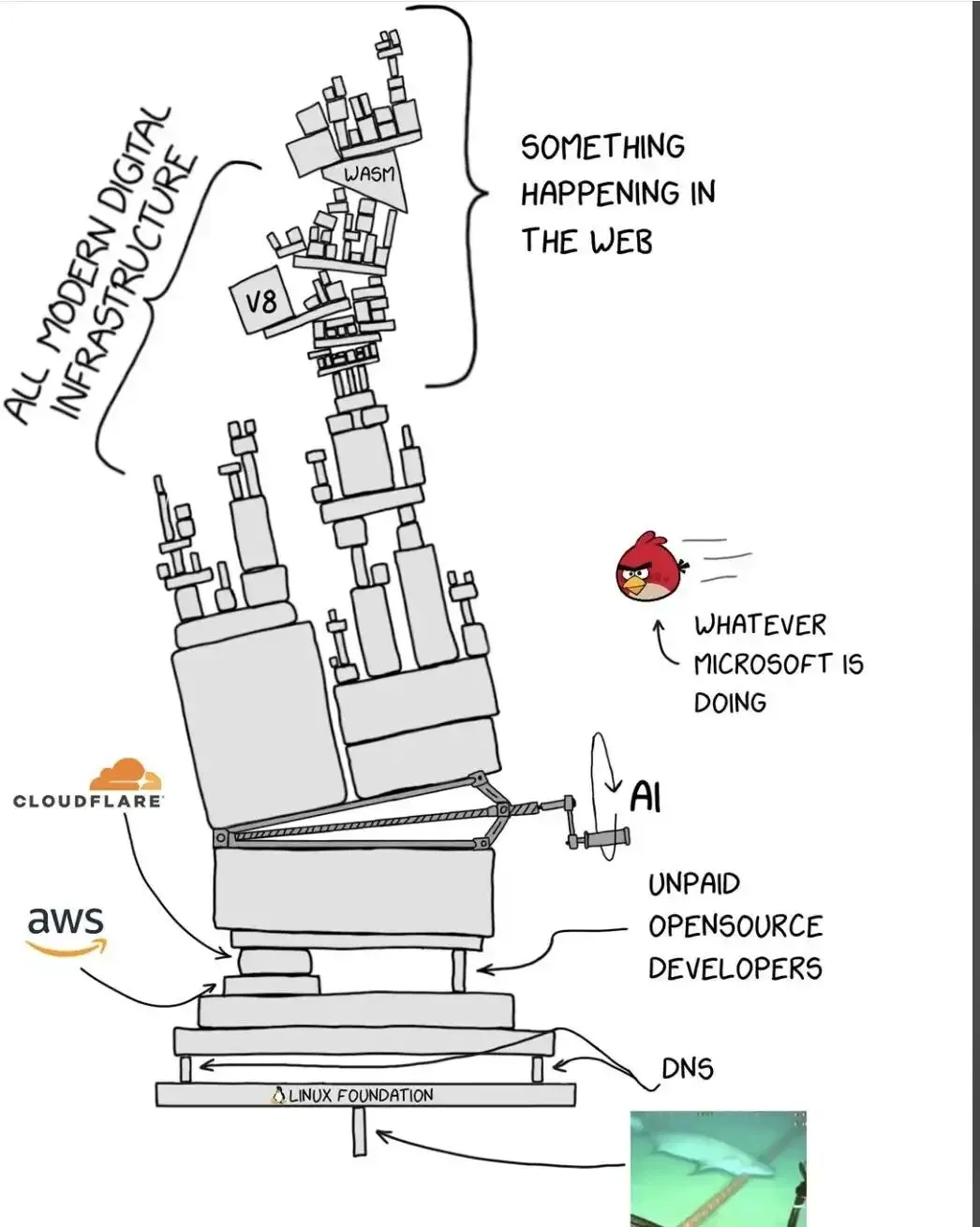

抽象层级被引入。每个模块只做特定的事情,把自己的复杂度隐藏在内部,对外只暴露一个输入输出的规范。计算机上运行操作系统,操作系统里运行虚拟机、docker、引擎、框架、外部库… 在此基础上搭建各种传输协议、规范等等,最终支持复杂的软件系统。这就是现代软件,本质上是层层嵌套的函数调用 —— 。 新的复杂度来自组合的层数和层间交互。你在手机上点一个外卖,背后的信息处理可能穿过了十几个子系统。

可解释性退化为局部白盒、全局灰盒。没人能够理解一个大型软件系统所有模块的状态机,也不可能在大脑中完整模拟一个网页浏览器的运行栈。工程师只能依赖接口契约来理解系统。

失效特征变成了状态爆炸与抽象泄漏。底层的实现细节会穿透接口契约,击穿上层的预期。指数增加的系统状态数导致测试无法覆盖所有情况。但每个模块代码都是人写的,内部逻辑可理解,至少知道该重点测什么。这是一个无法做到没有问题的体系,但世界确实在这种不完美的架构上运转了。

第四层 概率涌现

人类想要真正的人工智能 —— 能理解自然语言、识别图像、做出判断的系统。起初思路是搭建一个足够复杂的规则引擎,覆盖所有现实世界会出现的场景。专家系统就是一个尝试,但是后来发现并不可行。现实世界的复杂度远超人类可直接「编码」的上限。

应对方案是「机器学习」,让模型自己在数据集中寻找规律,泛化到其他问题上。这本质上是一种概率统计 ——

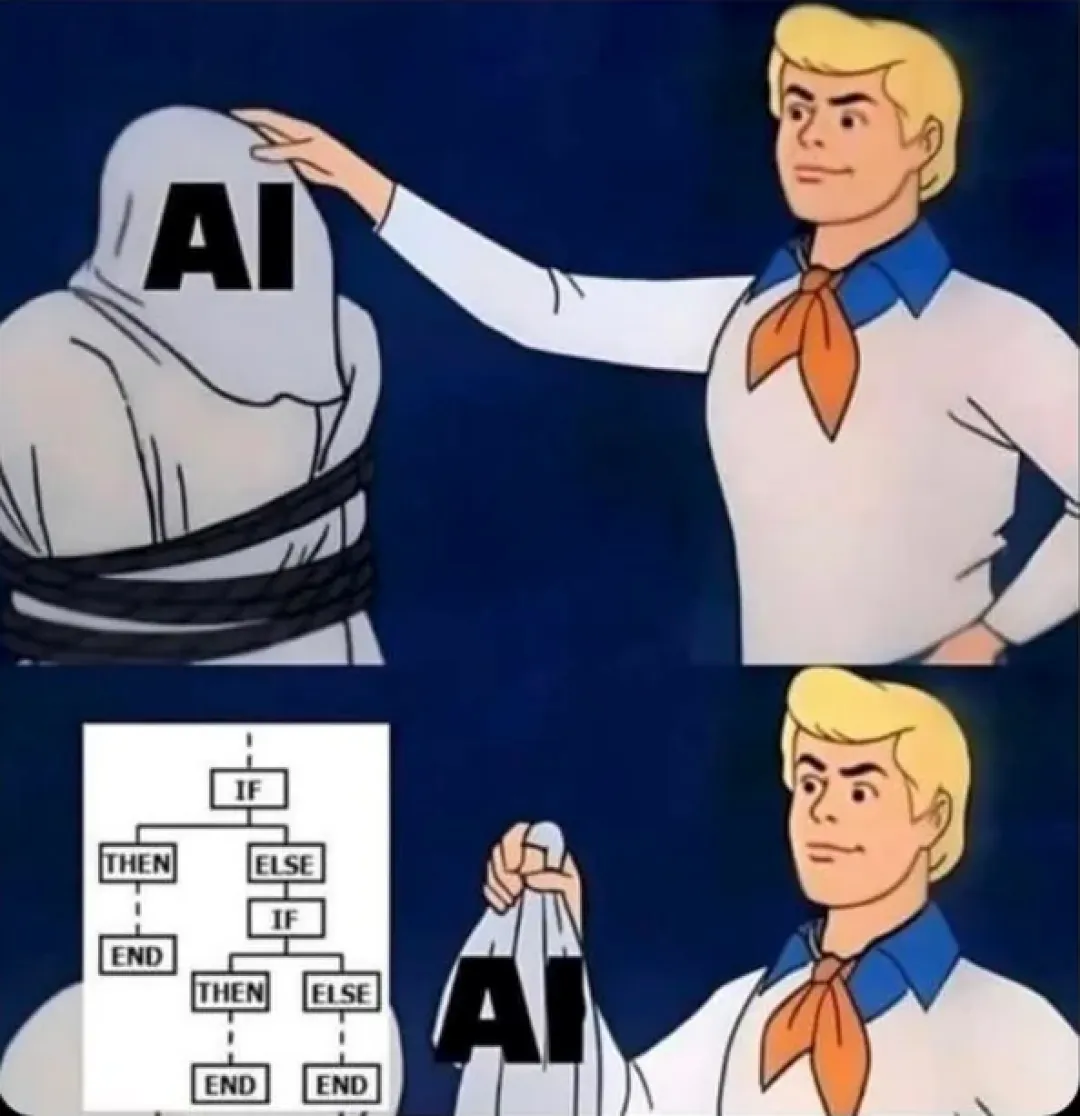

这里发生了一个根本性的转变:前三层的构建本质上依赖足够的确定性,只不过模块间可能有误差,误差会累积。但第四层不再是确定函数,而是概率分布。给定同一个输入 ,输出 是从一个分布中采样的。同样的问题向AI提问两次,大概率得到两个不同的回答,这是底层原理决定的。

可解释性是全局黑盒。参数 (万亿级的网络权重)是在超高维空间中通过梯度下降拟合的,我们知道宏观原理,但无法解释微观决策路径。

失效机制是泛化失败 —— 输入偏离训练数据的分布时,模型的行为不可预测。幻觉和对齐偏移都是这一机制的表征。关键区别在于方向不可预测。工程师知道桥会因为承重过大而断裂,但没人知道一个大模型会在什么输入上、以什么方式犯错。

测试工作从「寻找设计误差和代码 Bug」变成了「寻找统计学上的边缘情况」。但超高维向量空间内的组合意味着边缘可能是近乎无限的,你甚至不知道「边缘」在哪。

三个维度与质变

上述分析中使用了三个维度,并且可以看到清晰的渐变曲线。

1. 可解释性全局白盒 → 高颗粒度白盒 → 局部白盒/全局灰盒 → 全局黑盒

2. 失效特征物理失效(方向可预知) → 信息失效 → 抽象泄漏 → 泛化失效(方向不可预知)

3. 测试基准理论演算 → 穷举/形式化验证 → 结构化测试 → 启发式评估

前三层之间是量变,复杂度递增,但无论多复杂(, , ),在定义域内给定输入就有确定输出。第四层系统变为超高维向量空间内的概率分布 —— 全新的元范式。

意味着什么

从第一层到第三层,至少在原则上保持着一种可能性:投入足够的资源,就可以理解和验证。你可以不做,但原则上可以。第四层打破了这一点,这种可能性在原则上不存在了。

但我们仍然习惯拿砖块盖楼,我们会假设AI遵守接口契约、拿它当组件构建新的软件系统(eg. Agent)。但如果组合函数里融入了一个或多个概率分布,这个原本就「摇摇欲坠」的体系还能继续堆叠下去吗?如果能,会以一种什么方式出现呢?如何避免失效呢?

夜雨聆风

夜雨聆风