小龙虾养成日记:“虾”路相逢之 OpenClaw 安装和 Ollama 本地模型配置+小模型也能干大事!

本文默认环境:macOS(Apple Silicon / Intel 均可)。

目标:用 Ollama 跑本地模型,再让 OpenClaw 通过 Ollama 调模型(流式输出 + 工具调用一起工作)。

本文示例模型:

qwen3.5:2b(以你 Ollama 里实际能搜到/拉到的名字为准)。

开场:终于 Token 自由了(小龙虾差点把我养破产)

真是服了:昨晚为了跑任务,硬生生给我“干”了几千万 token。你说养个小龙虾还能破产,这合理吗?

大家好,我是寒山。

今天这篇就干一件事:一分钱不花,把 OpenClaw 接到本地模型上。装好以后你会发现,“能聊天”只是起点,“能干活”才是爽点。

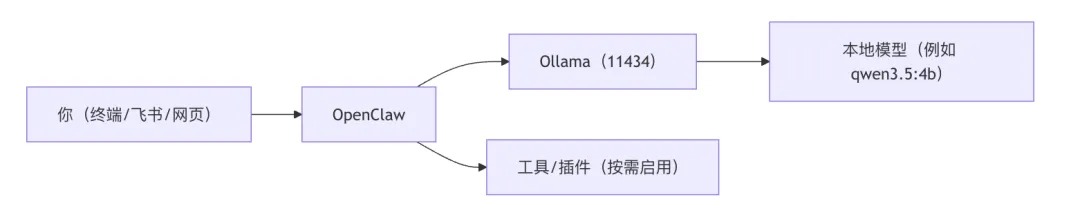

0. 先搞清楚:OpenClaw + Ollama 到底怎么连起来?

-

Ollama:本地模型运行时(负责下载/加载/推理),默认监听 http://127.0.0.1:11434 -

OpenClaw:你的个人 AI 助手(网关、工具调用、插件、渠道接入),把“聊天”升级成“行动”

一个最直观的理解:

最关键的技术细节(也是踩坑高发点):

-

OpenClaw 优先走 Ollama 原生接口: /api/chat,更稳地支持流式输出 + 工具调用一起工作 -

不要把 OpenAI 兼容地址 http://127.0.0.1:11434/v1当成baseUrl填给 OpenClaw。

1. 准备工作:先把模型“养”进 Ollama

如果你用的是 Ollama 的 macOS 桌面版,打开后一般会看到聊天窗口/模型列表(不同版本 UI 细节可能略有差异,但逻辑一致):

-

在模型列表里找到 qwen3.5:2b(或同类命名,按你的列表为准) -

选中它,随便说一句: 你好 -

它会开始自动下载模型,进度跑完就能直接聊

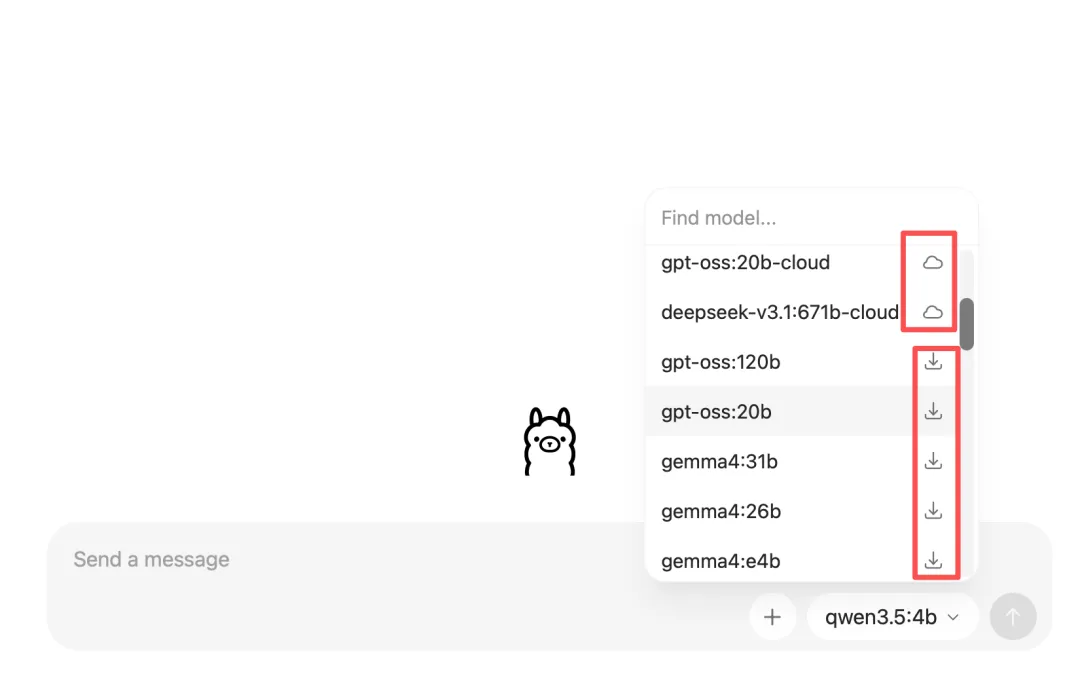

1.1 本地 vs 云端怎么选?

-

你显卡/内存够:优先上本地(隐私、稳定、Token 自由) -

你显卡不行:先用云端顶上去(很多云端模型会标注 :cloud或 “cloud” 标签)

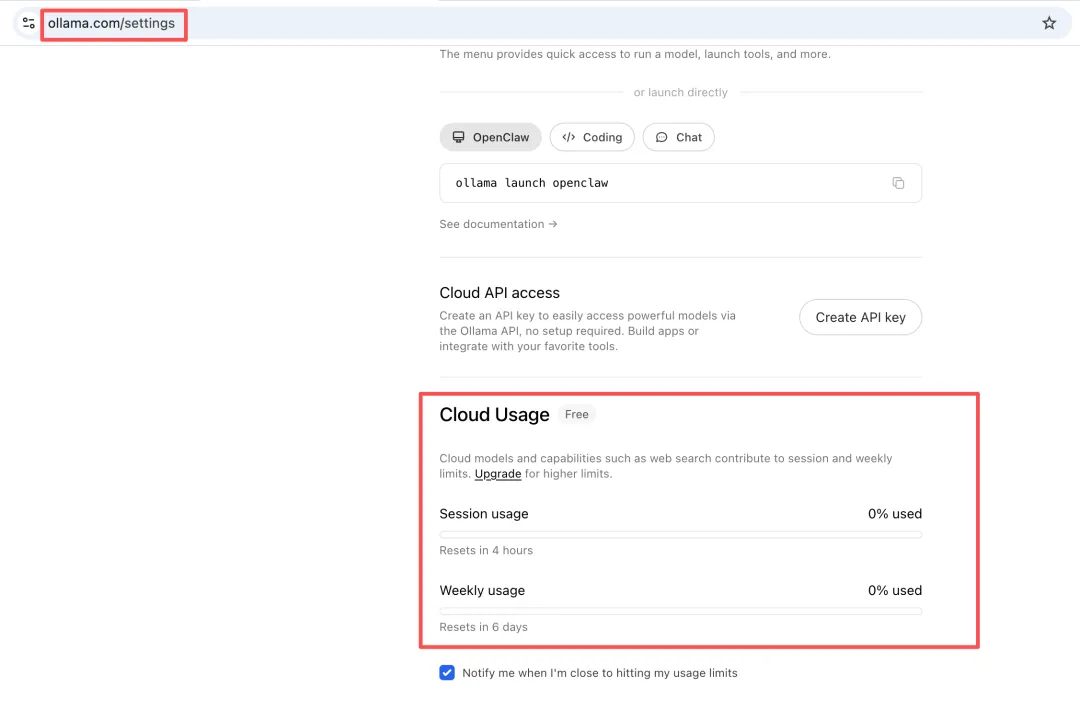

1.2 云端额度在哪看?怎么薅?

一般在 Ollama 的设置里会有类似 Manage/管理 的入口,能看到云端模型的免费额度和用量;有些会周期性刷新(以界面展示为准)。

1.3 用终端拉模型(更稳、更可控)

如果你更习惯命令行,直接:

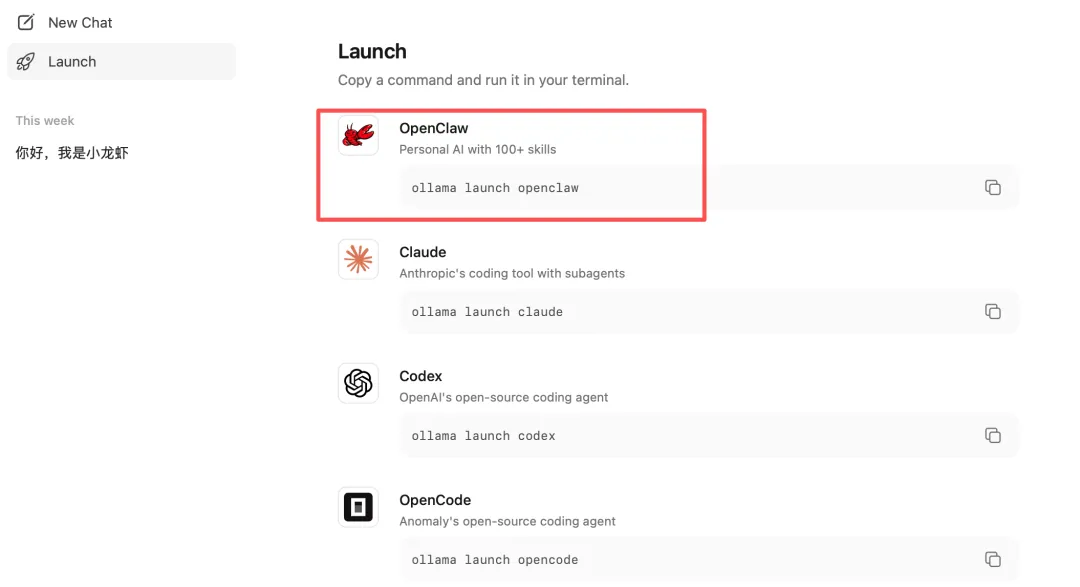

ollama pull qwen3.5:2bollama list2. 安装并启动 OpenClaw:Ollama 一条命令拉起

ollama launch openclaw它会把一堆“新手容易漏掉的步骤”串起来(安装、选择模型、生成配置、启动网关/TUI 等)。这里直接选你刚才在 Ollama 里用的 qwen3.5:2b;如果你想先用云端模型试跑,就选带 :cloud 的那个。

如果你想显式指定模型(例:先用云模型跑通,再切本地):

ollama launch openclaw --model kimi-k2.5:cloud

openclaw --version3. 配置:把本地 Ollama 接入 OpenClaw

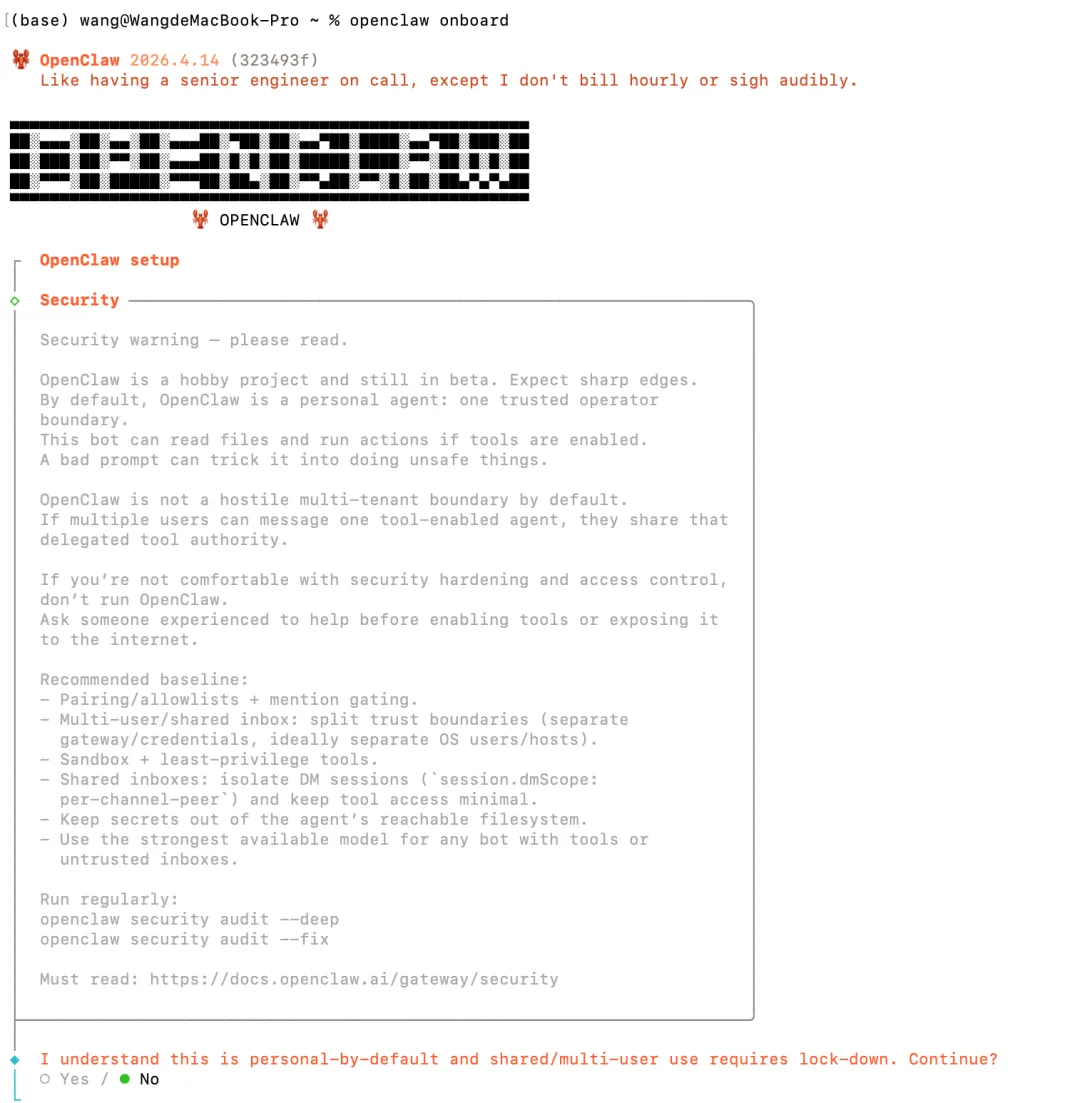

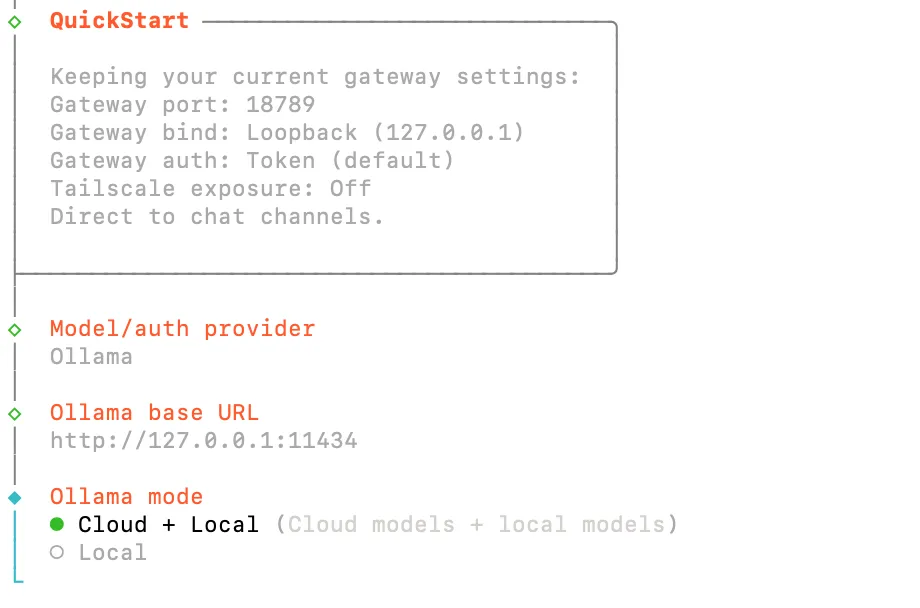

如果你用 ollama launch openclaw,它通常已经帮你做完了大部分配置;但建议还是走一遍 OpenClaw 官方推荐的 onboarding,让流程更完整、更不依赖“自动化黑盒”。

3.1 一键引导(推荐)

openclaw onboard

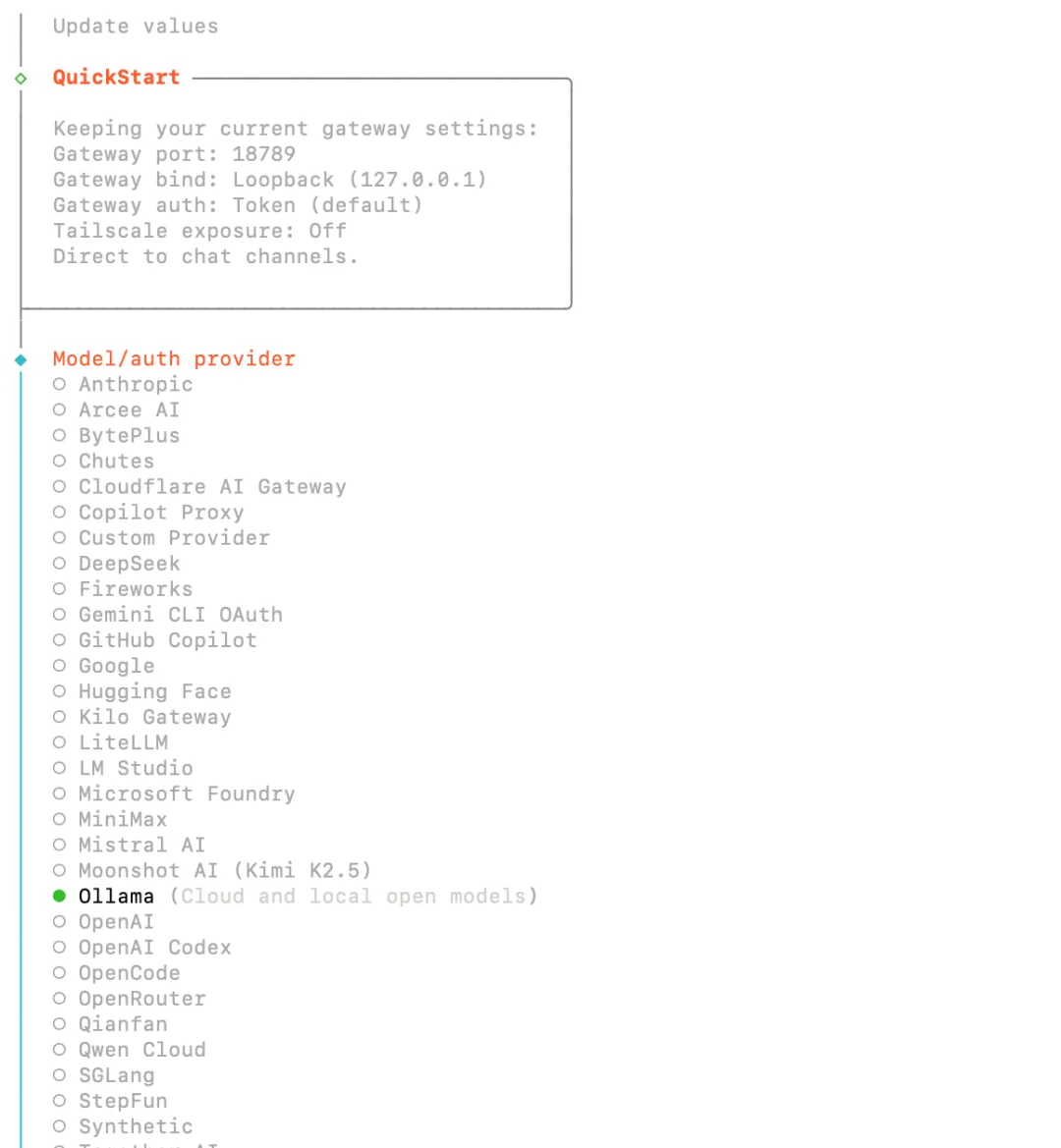

选择 Ollama 作为 provider,然后按你的目标选择模式:

-

Local only:只用本地 Ollama(隐私优先) -

Cloud + Local:本地 + 云模型混用(如果你还想用 Ollama cloud 或 Web Search)

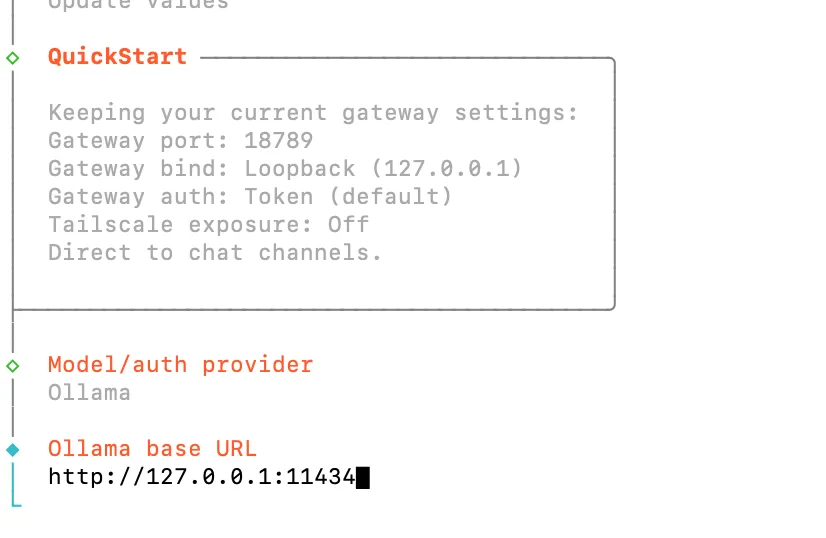

3.2 重要检查项:baseUrl 千万别带 /v1

你会在向导/配置里看到类似 baseUrl 的字段。这里是最常见的坑:

-

✅ 正确: http://127.0.0.1:11434(或http://localhost:11434) -

❌ 错误: http://127.0.0.1:11434/v1

如下图:

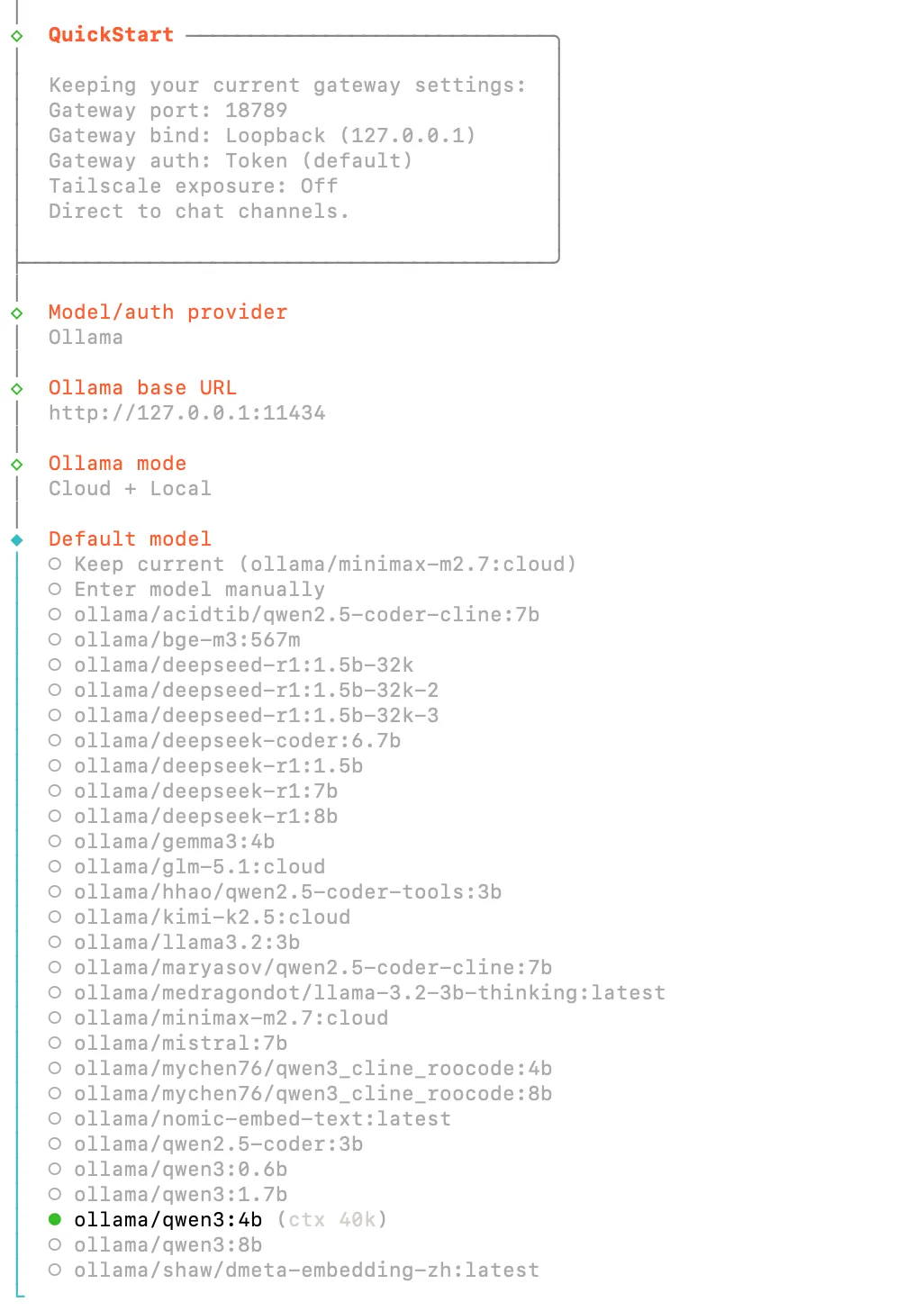

3.3 选模型、选客户端

如果你选择了“云 + 本地”,向导里会让你确认接下来用哪些能力/模型:

然后选具体的模型:本地已装的 + 云端可用的都会出现在列表里。

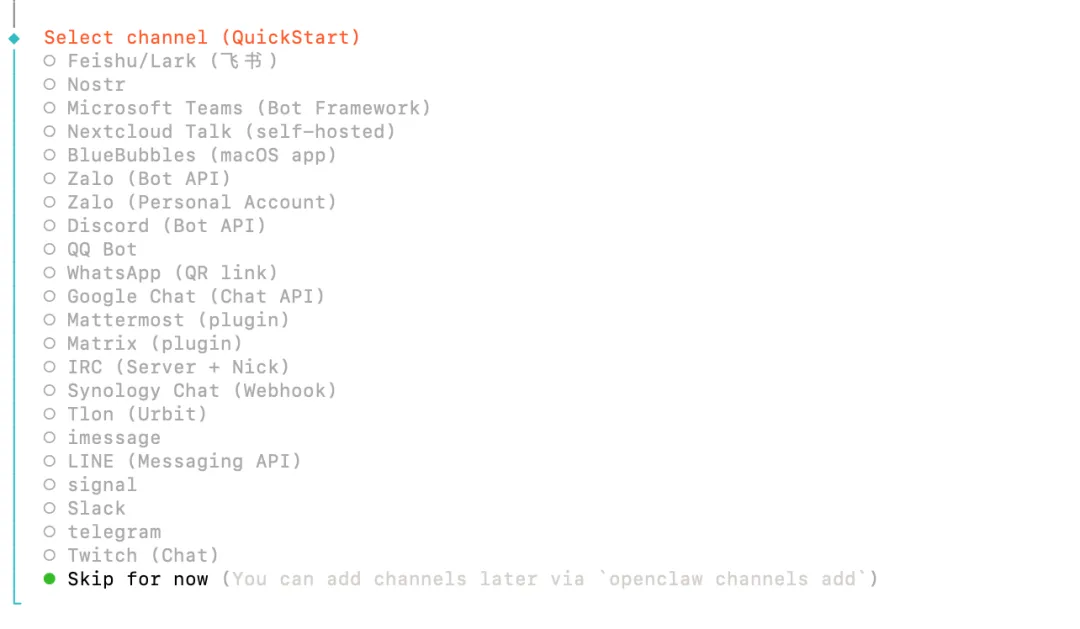

最后向导可能会问你“用哪个 App/客户端来控制龙虾”。这一步今天先跳过:先用终端 + 后台管理页把链路跑通,等确定稳定后再接飞书/网页等渠道。

4. 一页速查

# 1) 确认 Ollama & 模型ollama --versionollama pull qwen3.5:2bollama list# 2) 一键启动 OpenClawollama launch openclaw# 3) OpenClaw 常用命令openclaw onboardopenclaw config fileopenclaw gateway startopenclaw gateway stopopenclaw gateway restartopenclaw logs --follow5. 最后的验证

这一段是最能让读者一下理解 OpenClaw 为啥叫 Agent。

你可以把 OpenClaw 接到飞书(或其他渠道),然后让它去调用工具做事。比如我当时演示的是:

-

问一句: 你是哪个模型?(先确认它真在用你刚选的本地/云端模型) -

再来一句: 打开淘宝

如果你的 OpenClaw 开了对应的工具(比如浏览器自动化/系统控制类工具),它就会把“打开淘宝”这句话,变成一条真实的行动。

提醒:这类“能动手”的工具权限很高,建议你只在自己可控的机器、可控的目录/应用范围里开,先从低风险动作演示起步。

6. 安全提醒(养虾先加盖)

OpenClaw 是“能动手”的 Agent:只要你开了执行命令、读写文件、联网搜索等能力,它就可能把误解变成真实操作。

建议你从这两条开始:

-

先在低风险目录试跑:别一上来就给它你的工作仓库/电脑根目录 -

少开权限、逐步放开:插件/工具按需启用

7. 这不就 Token 自由了吗?

到这一步,你已经把链路彻底打通了。问题来了:Token 自由以后,你还想让小龙虾帮你干点啥?

今天的分享就到这里,更多 AI 内容,我们下期再讲!

夜雨聆风

夜雨聆风