新闻活动 | AI²2026系列讲座第二场:如何分辨大语言模型是“鹦鹉学舌”还是“推理者”?

当AI给出精准答案,是真的“理解”题意,还是仅在海量数据中复刻模式?这不仅是用户的直观困惑,更是AI领域的核心哲学议题。

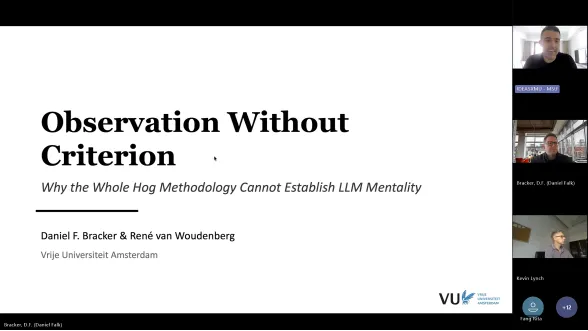

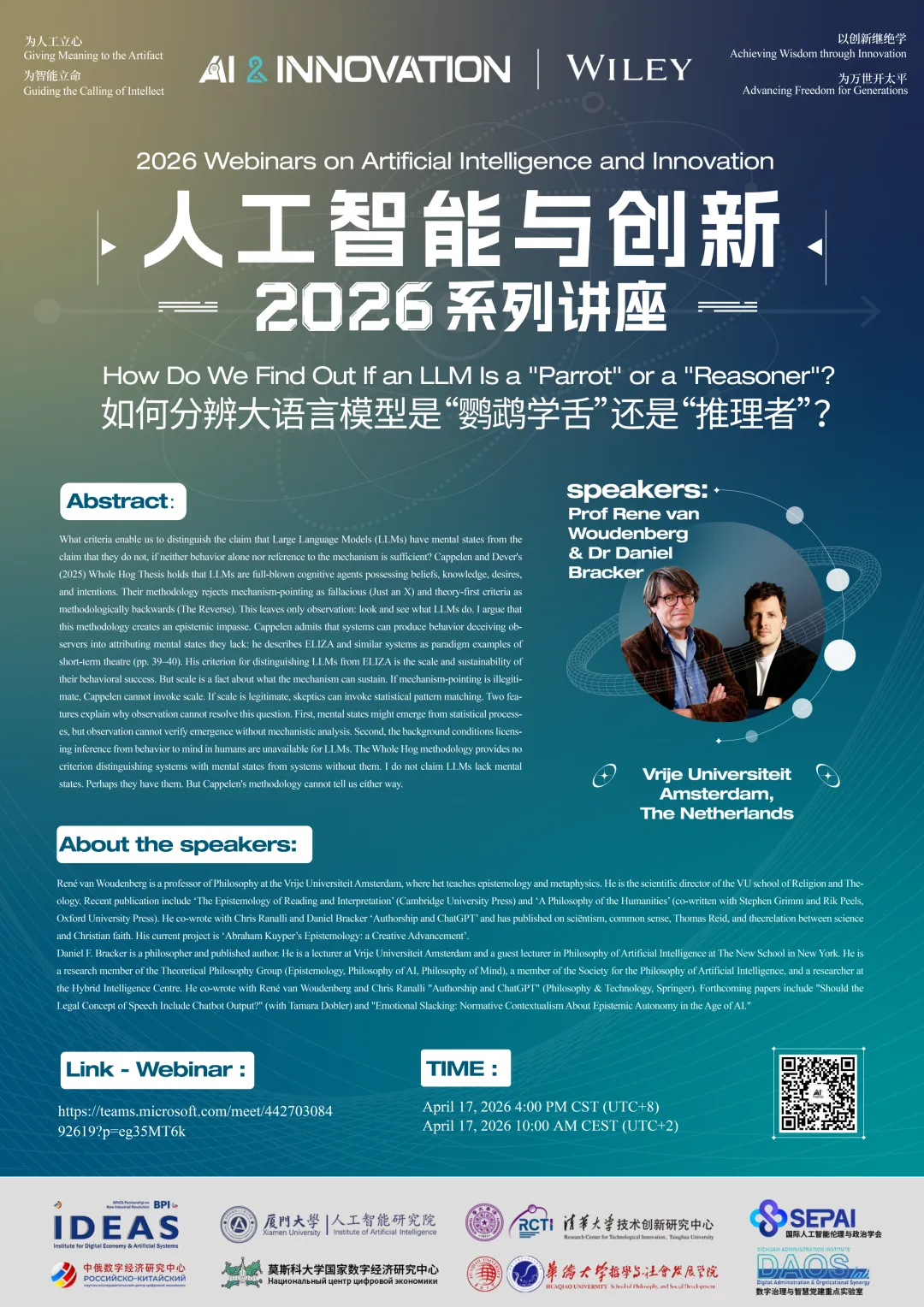

2026年4月17日,《人工智能与创新》(AI²)2026系列讲座第二场圆满落幕。本次讲座特邀阿姆斯特丹自由大学哲学专家勒内・范・沃登伯格教授、丹尼尔・F・布拉克博士(主讲人),以“如何分辨大语言模型是‘鹦鹉学舌’还是‘推理者’”为题,展开一场深度跨学科思辨,吸引哲学、人工智能、认知科学、法学等领域学者与从业者在线共研。

讲座聚焦核心争议:仅凭行为表现或机制指涉,能否判定大语言模型(Large Language Model,LLM)具备心理状态?嘉宾深入剖析卡佩伦与德弗2025年提出的“全盘论”(Whole Hog Thesis)——该主张将LLM视作拥有信念、知识、欲望、意图的完整认知主体,摒弃机制与理论标准,仅以行为观察为判断依据。但两位专家直指其认识论困境:模型行为可欺骗观察者,营造出拥有心理状态的假象;即便LLM与早期机器人ELIZA的差异在于行为规模与持续性,可规模本质依托底层机制,若否定机制指向,便无权以规模区分推理与模仿,怀疑论者更可将其归为单纯统计模式匹配。

为何纯行为观察走不出认知僵局?一方面,无机制分析则无法验证心理状态的涌现;另一方面,人类推导心理状态的背景条件,在LLM中完全不成立,套用人类认知逻辑评判机器本就存在逻辑偏差。

现场互动直击痛点,有参与者提问:“LLM给出正确答案,能否作为理解的依据?”布拉克博士明确回应:正确答案本身,不是证据。如同词典、搜索引擎能返回正确结果,却无人认为其具备“理解”能力,判断的关键,是建立“理解”的本质标准,而这正是当下学界待解的难题。

针对方法论困境,布拉克博士引入了哲学界成熟的最佳解释推理(IBE)框架:将“LLM是真正推理者”与“LLM是统计模式匹配器”两种解释对比,综合行为表现、错误类型、泛化能力、对抗鲁棒性(Adversarial Robustness)等全维度证据,目前来看,统计模式匹配的解释更贴合神经网络机制,也更具说服力。

本次讲座并未断言LLM有无心理状态,而是打破“非黑即白”的认知误区,指出“全盘论”无法有效判定模型认知本质。既提醒大众勿被AI流畅输出迷惑——“看起来像理解”绝不等于“真理解”,也为AI研发、政策制定、行业应用提供关键启示:技术评估不能唯正确率,关键领域落地需警惕“表面智能”,普通用户更应保持理性审视。

本次讲座是《人工智能与创新》(AI²)2026系列讲座的第二场活动。AI²期刊始终秉持“为人工立心、为智能立命”的核心理念,本次讲座为探究大语言模型认知本质开辟全新思辨视角。后续系列讲座将持续邀约国内外顶尖学者,对话人工智能与创新前沿议题,敬请期待。

了解更多与AI²、IDEAS相关的学术科研信息,请点击以下链接:

关于AI²

扫描二维码 | 关注我们

《人工智能与创新》(AI & Innovation,简称 AI²)学术期刊由金砖创新基地数字经济研究中心(Institute for Digital Economy & Artificial Systems,简称IDEAS)与清华大学技术创新研究中心、厦门大学人工智能研究院共同主办,并联合威立(Wiley)出版。本期刊基于AI的基础理论、工程系统、社会治理和创新生态四大战略维度,致力于在跨学科视角下全面研究智能科学发展领域,推动全球数字创新和发展研究,建立国际权威话语体系,帮助政府机构和行业制定适应数字经济发展战略。

IDEAS是依托厦大、莫大建设的前沿交叉学科研究阵地、新兴战略产业高端智库、科技成果转化服务平台、国际专业人才合作通道。在金砖国家新工业革命伙伴关系框架内,IDEAS以”数字化,为了更智慧的全球合作:全球化,为了更广阔的数字包容”(Digitalization, for a Wiser Global Cooperation, Globalization, for aWider Digital Inclusion)为理念,与各方共建国际数字经济与智能科技协同研发网络。

夜雨聆风

夜雨聆风