我给我的AI小龙虾装上了特朗普的声音,结果笑疯了

当你的AI助手突然开口说话,还用的是你偶像的声音,那种感觉真的太奇妙了。

事情是这样的。

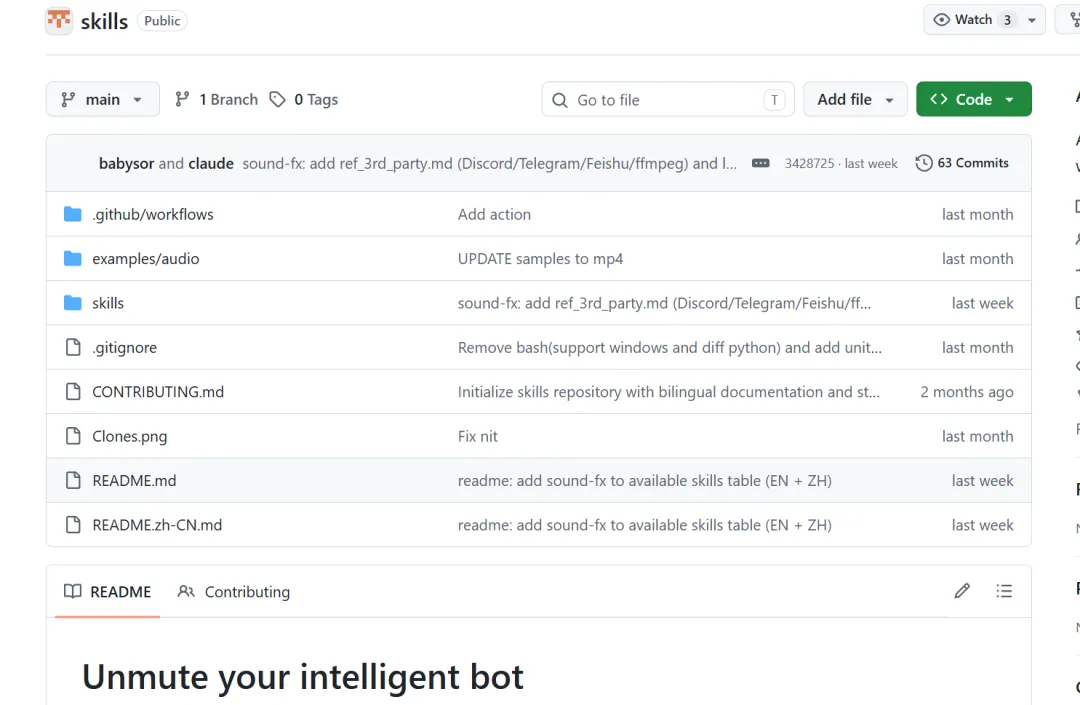

前段时间我在GitHub上逛,发现了一个刚刚开源的Skill项目,名字叫NoizAI/skills。看描述说,它能让你的OpenClaw小龙虾开口说话,甚至能克隆任何人的音色。

我当时的第一反应是:真的假的?

于是我就试了试。结果一发不可收拾。

现在我的小龙虾“钱多多”用的音色是克隆的川普。每次它一本正经地用那种腔调跟我汇报工作进度,我就忍不住笑出声来。

但这还不是最离谱的。最离谱的是,这种“有声音”的AI,在心理层面上突然就有了存在感。以前它只是一个聊天框里的文字流,你看完就忘了。现在它一开口,你感觉旁边坐着一个人。

这种变化,真的很微妙。

01 先听听效果,笑死我了

装好这个Skill之后,我做的第一件事,就是找了一段川普的演讲音频,丢给了我的OpenClaw小龙虾“钱多多”。

它干了两件事:

第一,它分析并克隆了川普的音色。 第二,它把这个音色设为了自己的默认声音。

然后我让它说了一句中文。

你们猜怎么着?

一个操着川普口音、但说着标准普通话的小龙虾,就这么诞生了。

那种感觉很难形容。声音里带着川普特有的那种抑扬顿挫和略带夸张的语调,但内容又是正经的“老板,今天的代码任务已经完成了”。

我听完直接笑喷了。

后来我去翻了翻GitHub上其他用户的反馈,发现大家都玩得很嗨。有人在飞书群里给自己的不同Agent配了不同声音——一个做运营,一个做客服,一个写代码。每个Agent开口说话的时候,光靠声音就知道是谁在发言。

还有人把这个Skill接入了Telegram和WhatsApp。开车的时候、做饭的时候,不用看屏幕,Agent直接语音汇报,方便得不行。

有网友评论说:“感觉我旁边坐了一整个办公室。”

02 安装特别简单,一句话的事

好了,不卖关子了。我直接说怎么装。

前提是你已经有一个OpenClaw小龙虾环境。如果没有的话,先去GitHub上把OpenClaw跑起来,这里就不展开说了。

安装这个语音Skill,真的只需要一句话。

在你的小龙虾对话框里输入:

帮我装这个 Skill:https://github.com/NoizAI/skills

然后你的小龙虾就会自己去读取那个GitHub仓库,自动下载安装。

就是这么简单。

装完之后,它会提示你有两种模式可选:

- 本地模式(Kokoro)

:完全离线运行,不需要联网。需要下载一个模型文件,优点是隐私安全、免费。缺点是不能克隆音色,只能用默认的几个声音。 - 云端模式(Noiz)

:需要注册一个Noiz API Key,有免费额度。优点是能克隆音色,而且音质更好。我自己用的就是云端模式。

我建议你先用云端模式,因为免费额度足够你玩很久了。注册也很简单,去Noiz AI官网注册一下,拿到API Key,然后告诉你的小龙虾:

配置一下 Noiz API Key,我的Key是xxxx

它会自己帮你配置好。

配置完成之后,你就可以让你的小龙虾说话了。

03 怎么让它用你想要的音色

这里有两个方法。

方法一:从官方音色库选

你可以直接问小龙虾:“帮我看看有哪些音色可以选?”它会返回一个列表,里面有各种各样的声音——男女老少、不同语言、不同风格。你选一个喜欢的,告诉它“以后就用这个音色了”。

方法二:克隆任意音色(这才是精髓)

你找一段目标人物的音频文件,比如一段演讲、一段播客、或者你自己的录音。把这段音频发给小龙虾,然后对它说:

“克隆这段音频的音色。”

它会自己处理。等几秒钟,它会告诉你“克隆成功啦”。

这时候你再说一句:

“记住,刚刚克隆的这个音色就是你的音色了。以后我让你发语音的时候,你就用这个音色。”

然后它就记住了。

以后你让它说话,它就会用那个声音回复你。

我克隆的是川普。有网友克隆了马斯克、林志玲、甚至自己的声音。还有人说,他给公司的客服Agent克隆了他们公司老板娘的声音,客户打电话进来还以为是在跟真人聊天。

04 什么场景下最有用?

我用了几天之后,发现这个东西最香的地方不是“好玩”,而是“好用”。

场景一:开车或做家务时

以前我在开车的时候,如果想让AI帮我查个东西或者安排个任务,我要么停下来打字,要么语音输入然后看屏幕上的回复。眼睛还是得离开路面。

现在不需要了。我直接对着小龙虾说话,它用语音回复我。我甚至不用看屏幕,听声音就知道它说了什么。它把事情办完之后,还会主动告诉我:“老板,搞定了。”

场景二:多个Agent协作时

如果你用OpenClaw的Agent Teams功能,同时跑了几个不同角色的Agent,视觉上很难区分谁是谁。都挤在同一个聊天窗口里,你得分不清哪个是回答你的。

但是一旦给每个Agent配上不同的声音,情况就完全不同了。运营Agent用温柔女声,客服Agent用沉稳男声,代码Agent用川普声。你闭着眼睛,光听声音就知道谁在说话。

这种感觉,就像你身边真的坐着三个不同性格的助理。

场景三:情感陪伴场景

我觉得这个是未来最有可能爆发的方向。

文字聊天和语音聊天的心理感受是完全不一样的。文字是冷冰冰的,语音是有温度的。尤其当你给AI配上一个你喜欢的、熟悉的声音时,你会不自觉地把它当成一个“人”来对待。

有个网友在GitHub issue里写道:“我给小龙虾克隆了我已故爷爷的声音,然后让它用那个声音跟我聊天。有点想哭。”

虽然这个用法有点沉重,但它确实说明了一件事:声音,是AI人格化最重要的一块拼图。

05 关于NoizAI/skills这个开源项目

说完了玩法,咱们正经介绍一下这个项目。

项目地址:https://github.com/NoizAI/skills

这是一个由Noiz AI平台开源的项目。Noiz AI本身是一家专注于语音AI的公司,他们的核心技术包括高质量语音克隆、情感化TTS、YouTube视频摘要等。

这次他们开源的skills项目,不只是简单的一个“文本转语音”工具包,而是一整套面向AI Agent的语音能力集合。

目前这个仓库包含了5个核心Skill:

Skill 1:文本转语音

支持Kokoro本地引擎和Noiz云端引擎。特点是可以精确控制时长、时间轴渲染,以及最重要的——参考音频音色克隆。就是上面我用到的那个功能。

Skill 2:用目标人物的声音进行对话

这个Skill更强。你不需要自己准备音频文件。你只要告诉小龙虾一个名字,比如“我想用奥巴马的声音”,它会自动去网上搜索奥巴马的公开演讲,提取干净的参考样本,然后克隆音色并生成语音回复。

整个过程全自动。

Skill 3:特色语音

这个Skill主要给语音加上“人味儿”。它支持语气词(嗯、啊、哦)、情绪参数(开心、严肃、生气)、场景预设(客服、闲聊、紧急通知)。生成的语音不再是冷冰冰的朗读,而是带着情绪的说话。

Skill 4:视频翻译

这是一个比较进阶的功能。你给小龙虾一个视频文件或者YouTube链接,它可以把视频里的语音翻译成另一种语言,然后用TTS生成配音并替换原音轨,同时保留视频画面和背景音。

相当于AI做了一次完整的视频配音+翻译。

Skill 5:安装与管理

提供了一个命令行工具,用来管理Skill的安装、列表、更新、删除。

命令行示例:

# 查看可安装的技能

npx skills add NoizAI/skills --list --full-depth

# 安装指定的技能

npx skills add NoizAI/skills --full-depth --skill tts -y

# 从GitHub仓库安装

npx skills add <owner>/<repo>

# 本地开发调试

npx skills add . --list --full-depth

如果你是自己开发Skill,也可以用这个命令行做本地调试。

06 一些你可能遇到的坑和解决办法

我在安装和使用过程中遇到了几个小问题,这里写出来,你们可以少走弯路。

问题1:小龙虾没办法给我发语音条

这个是最常见的问题。如果你在飞书里用,语音条的正确发送方式不是直接发mp3文件。

飞书的语音消息需要满足这几个条件:

-

文件格式必须是opus,不是mp3 -

发送时需要用到chat_id作为receive_id -

消息类型是audio,content里要包含file_key和duration

更简单的方法:你直接跟小龙虾对话,让它自己学习。你给它说:“你现在给我发一条语音消息。”它会尝试,如果失败了,它会把错误信息反馈回来,然后自己调整。

如果实在搞不定,你就把下面这段话原封不动发给小龙虾:

“飞书语音条正确的发送方式:上传文件:file_type=opus,需要 receive_id_type=chat_id 和 receive_id。发送消息:msg_type=audio,receive_id_type=chat_id,content 包含 file_key 和 duration。”

它看完就会懂了。

问题2:克隆的音色不太像

这是因为你给的参考音频质量不高。最好用目标人物没有背景噪声、语速正常、长度在10-30秒之间的音频。如果是演讲片段,选清晰的那几秒。

另外,如果你用中文的参考音频去克隆,然后让AI说英文,效果会差一些。反过来也一样。尽量保持语言一致。

问题3:本地Kokoro模式不发音

Kokoro需要下载模型文件,大概几百MB。确保你的网络能连上Hugging Face或者镜像源。如果下载失败,可以手动下载模型放到指定目录。具体路径小龙虾安装的时候会告诉你。

07 一个值得期待的AI方向

NoizAI这个开源项目,我觉得最大的意义不在于“给AI装个声音”,而在于它展示了AI Agent能力的一个新维度——多模态主动交互。

过去的AI Agent,你问它答,它像一台被动的机器。现在它有了声音,你甚至可以不用主动问,它可以在合适的时机主动“说”给你听。

比如你让它去监控一个数据指标,一旦异常,它会主动给你发一条语音:“老板,订单量突然跌了30%,要不要看一下?”

这种体验,和看一条推送通知是完全不同的。

而且随着Agent Teams的流行,未来每个人身边可能会有几十个不同角色的AI助理在同时工作。如果它们都用文字跟你沟通,你的聊天窗口会被刷爆。但如果你给每个助理分配一个独特的声音,你就可以像一个大老板一样,光靠听就知道谁在说什么。

这可能是AI人机交互的一个新范式。

再往远了想,如果再加上视觉、加上身体,那就是真正的“数字人”了。

但那是后话。至少现在,你可以花几分钟,给你的OpenClaw小龙虾装上一个声音,让它活过来。

08 最后说两句

这个项目是刚刚开源的,代码还很新。如果你遇到问题,可以去看GitHub仓库的Issues,或者去Discord群里问。

作者很活跃,回复也很快。国内用户如果访问GitHub不方便,可以用镜像站,或者下载下来本地装。

另外,如果你是开发者,也可以参考这个项目的实现,给你的AI Agent加上语音能力。它本质上是一套Skills框架,你可以基于它开发更多有趣的功能。

比如:让AI朗读长文章、让AI做多语言配音、让AI用特定情绪跟你聊天……

想象空间很大。

好了,不废话了。

给AI装上声音这件事,一定要自己动手试一次。当你听到你的小龙虾开口说话的那一刻,你就知道我在说什么了。

GitHub地址:https://github.com/NoizAI/skills

安装命令(在你的OpenClaw对话框里输入):

帮我装这个 Skill:https://github.com/NoizAI/skills

玩得开心。

夜雨聆风

夜雨聆风