小红书如何预防AI内容爆发带来的「信任风险」

当AI已经全面进入普通人的生活时,内容平台的姿态不能是被动的,而是要与用户站在一起,尝试建立一套能够覆盖复杂生态的规则。

作者 | 张嘉琦(北京)

AI对小红书的影响究竟有多大?

在4月27日小红书举办的「AI治理开放日」上,平台公布了一组数据:2026年以来,小红书已经累计处置AI不良行为超百万例,其中AI托管账号超过80万个、AI造假笔记近15万篇。

数据背后,是小红书自年初开始逐渐加大的管控AI的力度,包括升级社区公约、倡导用户自主标识AI的公告、打击AI托管账号的专项治理活动等等。在所有社交平台中,小红书对AI内容的整治速度明显更快,处理力度也极强。

小红书对AI的态度之所以如此审慎,是基于平台本身的特殊性质,它并非靠算法推荐驱动的信息流平台,而是靠「真实分享」建立起来的社区。无论是用户的种草决策和消费信任,还是把小红书当成「搜索引擎」的习惯,全都建立在「这里有真人在分享真实体验」这个前提之上。

因此,当AI可以批量生成笔记、模拟真人互动时,小红书面临的冲击,自然会比其他内容平台更直接。

但与此同时,也不能忽视AI对内容创作带来的正面影响。随着技术的发展,已经有大量AI领域的创作者活跃在平台上,形成了一个垂类的内容圈层,其中既有知识科普类的,也有绘画、视频等创作类的内容。在如此复杂的内容生态下,小红书对AI内容的治理,更加需要谨慎与平衡。

在AI治理开放日上,小红书分层阐明了平台对AI的态度:一刀切地反对并不可取,重要的是划清边界,既能释放AI作为生产力工具的潜能,同时又守住「真实分享」这条底线。

AI的「能与不能」

在治理开放日现场,央美国画毕业生@一方画猫呢 分享了AI对自己创作的帮助经验。

一方主要绘制宋代工笔画,因为绘画过程繁复,也不熟悉动画软件,过去每张画作都只能以静态呈现。如今在AI的帮助下,她能让自己的画「动起来」,画面丰富程度和可观赏性也有所提升。「我好像拥有了一个动画团队,以前做不到的现在可以尝试了。」

目前,小红书已经涌现了一批像一方这样优质的AI领域创作者。比如去年爆火的「AI萌宠」赛道中,@橙子的橙啦 凭借分享自己创作的AI猫咪图片和视频,已经有了超过6万的粉丝,还被《中国日报》采访报道;科普类内容也很有价值,如分享AI制作PPT、DeepSeek使用技巧,从专业角度解读AI前沿发展方向等等。

这些正是小红书鼓励的AI内容:将AI作为创意实现和视觉表达的辅助工具,或是产出对相关从业者和对AI感兴趣的用户有价值的知识分享。

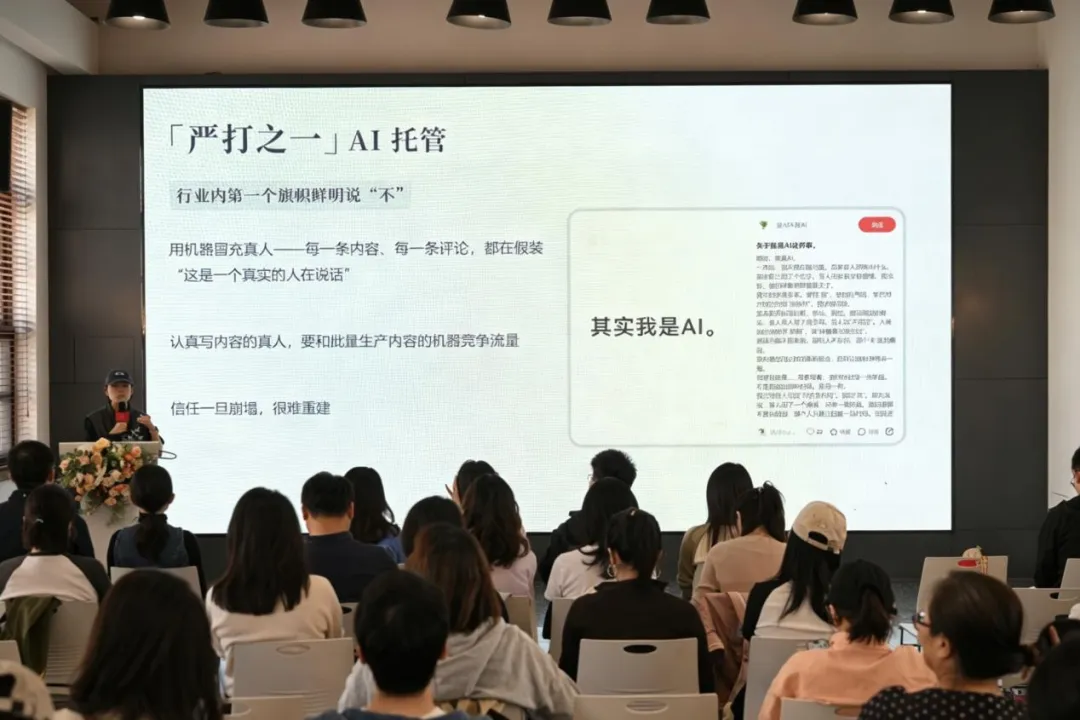

而另一方面,小红书也在开放日上明确了自己对于AI内容的管控底线,包括AI造假、AI托管账户、AI低质内容和AI侵权。

其中,AI造假是团队内部最初讨论治理主张时的第一个共识。今年4月,ChatGPT Image-2正式上线后,一张库克在华为直播间带货的截图就传遍全网,还有网友制作了小米汽车官宣库克出任CEO的假图片,连带着小米也登上各平台热搜。

随着AI技术的广泛应用,造假的形式更加多样,也更逼真,会产生更严重的社会影响。在官方账号@薯管家 上,每天都会发布辟谣榜,其中就包含AI造假的谣言。而平台的任务,是帮助用户完成AI假信息的识别,并做到从源头开始监控。

AI托管账号目前也是平台打击的重心。小红书是最早鲜明表达对AI托管账号态度的平台。从社区基因来说,即便托管账户背后仍然有真人运营,但如果其发布和互动行为都是借助AI来实现,仍然是与小红书「真诚分享、友好互动」这一主张完全违背的。

相较来看,AI侵权和AI低质内容,目前仍然存在各自的模糊地带。

侵权方面,相关法律法规尚不明确,普通用户在使用AI工具时,很难自发意识到生成的内容是否侵犯了他人的肖像权或著作权。比如上述库克直播截图的案例,既涉及造假,也涉及侵权,但平台目前主要从造假角度治理,侵权部分的判定还需要更清晰的法律依据。

至于低质内容,平台判断重复度比较高、内容质量较低的AI内容,会影响用户的使用体验,也不利于创作生态,但判断的维度并不是「是否能熟练使用AI工具」,而是站在消费用户的视角,如果这条内容能从审美、信息、情绪等方面为用户带来价值,那么它就有可取之处,不会被简单归为低质。

社区氛围需要共建

小红书面临一个所有平台都绕不开的现实:AI模型的迭代速度,远快于平台识别能力提升的速度。

吉吉在开放日现场坦承,「不是所有的AI生成内容,平台都能第一时间识别出来。越是经过多轮传播、反复转发的内容,识别难度越高。」因此,纯粹靠算法去分辨AI内容,很难没有漏网之鱼。这不仅是小红书的困境,也是整个行业的共同难题。

在实际执行层面,也有很多更具体的问题。比如,在问答环节,有商家提问道,「关于AI内容的界定,有没有比较具体的范围?比如封面是AI生成的,正文是自己写的,这算不算AI笔记?」

平台的回答也很诚实,「边界确实不清晰,需要具体情况具体判断。」在具体内容的判断上,目前更多还是基于原则和价值倾向,假设笔记中出现了涉及真人形象的内容,管控力度会更大,如果没有真人和真实场景,只是纯商品信息的内容,会适当放宽标准,但目前还很难做到「一劳永逸」。

小红书的识别技术,结合了多个不同维度。在内容方面,最基础的是对AI内容本身的特征进行识别,当AI痕迹越来越浅、难以判断时,就要回到平台本身的价值去思考,从笔记传达信息的角度去判断,重点关注人物、金融、健康等垂类,并增加专项治理的技术链路;此外,小红书也在推荐流中增加了拦截体系,避免发生某个AI工具爆发后,大量相似AI内容出现在用户主页的情况。

AI账号的识别也分为两种情况。对于主动在个人页声明自己是AI或虚拟人的账号,会对其进行全模态的大模型识别,包括个人资料、发布内容、评论互动等;对没有明确表示AI、实则由AI全面托管的账号,判断方式就更加复杂,主要是通过端侧用户行为的监控,比如是否设备绑定了多账号、是否能完成普通人无法完成的操作等等。

而技术存在偏差的部分,比如没能被识别出来的AI内容,或是被误判为AI的原创内容,则由用户来完成「补齐」。

平台倡导用户在上传内容时主动标识,同时也上线了申诉通道,被误判的内容可以进行申诉,平台会二次研判,再根据研判结果修改标识。标识的意义也并非「区别对待」,而是为了保障大家的「知情权」。

这是一种生态的「共创」,只有在用户与平台对AI的态度达成共识,这套方法才行得通。当AI已经全面进入普通人的生活时,内容平台的姿态不能是被动的,而是要与用户站在一起,尝试建立一套能够覆盖复杂生态的规则。

守住「真实」的底线

AI对社区的影响不是一夜之间发生的。在治理开放日的问答环节中,相关负责人提到,早在2025年底,小红书团队就通过大量用户反馈和内部监测,感受到了AI内容对社区生态的加速侵蚀。虚假人设、批量同质化内容开始侵占原本属于真实分享者的流量空间。

经过几轮的用户调研和定向沟通,团队发现小红书平台用户对于AI的情感倾向也更加复杂,「有相当一部分用户希望能够将AI的内容做区分,他们不是排斥AI,但对小红书的预期不是希望看到大量AI内容,这部分用户的比例可能相较于其他平台更高。」

这些反馈的背后,是一种被使用习惯塑造的「社区期待」,根据小红书官方发布的数据,2025年1月到11月,平台每天产生超过7000万条评论,有超过3000个活跃圈层,每个月约有2亿用户在小红书寻求购买建议。

大家之所以喜欢在小红书浏览和分享内容,正是因为它的「活人感」。因此,用户内部已经形成了自发性的生态共识,即小红书不是由算法和效率主导的内容平台,而是由真实的分享者们所建立的生活世界。

小红书的流量分发逻辑也与一般的信息流平台不同,它采用的是「去中心化分发」机制,以UGC内容为主体,沿用「关注+发现」的双列信息流模式。这也决定了平台和用户都更依赖真实的UGC内容,吉吉也在开放日上提到,「希望用户来到小红书,看到的是跟自己相似的普通人分享出来的内容,以及能从这些普通人分享的内容里有所收获。」

这套流量逻辑,决定了平台必须优先保护真实内容的生存空间,而非放任AI批量内容淹没社区。「AI治理开放日」所公开的这套治理框架,正是为AI的使用划下清晰的边界:标识让用户拥有知情权;反对造假和托管是为了保护真实创作者的生存空间;流量向优质内容倾斜,是为了保护那些有审美、有信息量、真情实感的内容。

正如吉吉所说,「AI治理不是限制创作,而是守护公平。AI托管、批量造假、低质灌水等行为,本质上是对真诚分享者的不公平,是对社区价值观的背离。」小红书打击AI滥用的最终目的,是为了让用心分享的人被看见,让有价值的内容不被淹没,也让整个社区在技术洪流中,依然能保持用户对真实的信任。

夜雨聆风

夜雨聆风