关于 AI 的一些絮絮叨叨

最近五一闲在宿舍,不想去旅游,也不知道能干什么。总不能S 属性大爆发,连学 7 天。想起来自己还有一个基本没发过东西的公众号,于是来写一些絮絮叨叨。

叠甲:笔者只是一个物理系大学生,本身不具备很强的 AI 背景。本文所说的观点,仅限于本人从大学起开始使用 AI 的一些经验和思考,欢迎大家指正和讨论。

最近 ChatGPT Images 2.0 上线之后,很多人又一次感受到了 AI 的进步速度。以前我们觉得 AI 画图容易翻车,文字容易乱码,风格容易不统一;但现在,它已经可以根据一句话生成完整的海报、漫画分镜、产品图,甚至学习资料图。OpenAI 官方也提到,这一代图像模型在文字渲染、多语言支持和复杂视觉任务上有明显提升。这也让很多人开始感叹:新时代下,设计师是不是也要大规模失业了?

图源:各种人给笔者的转发

借着这个热点,我想聊聊自己总结的几点:在 AI 时代,我们到底需要锻炼什么能力。

一、AI的两个特点

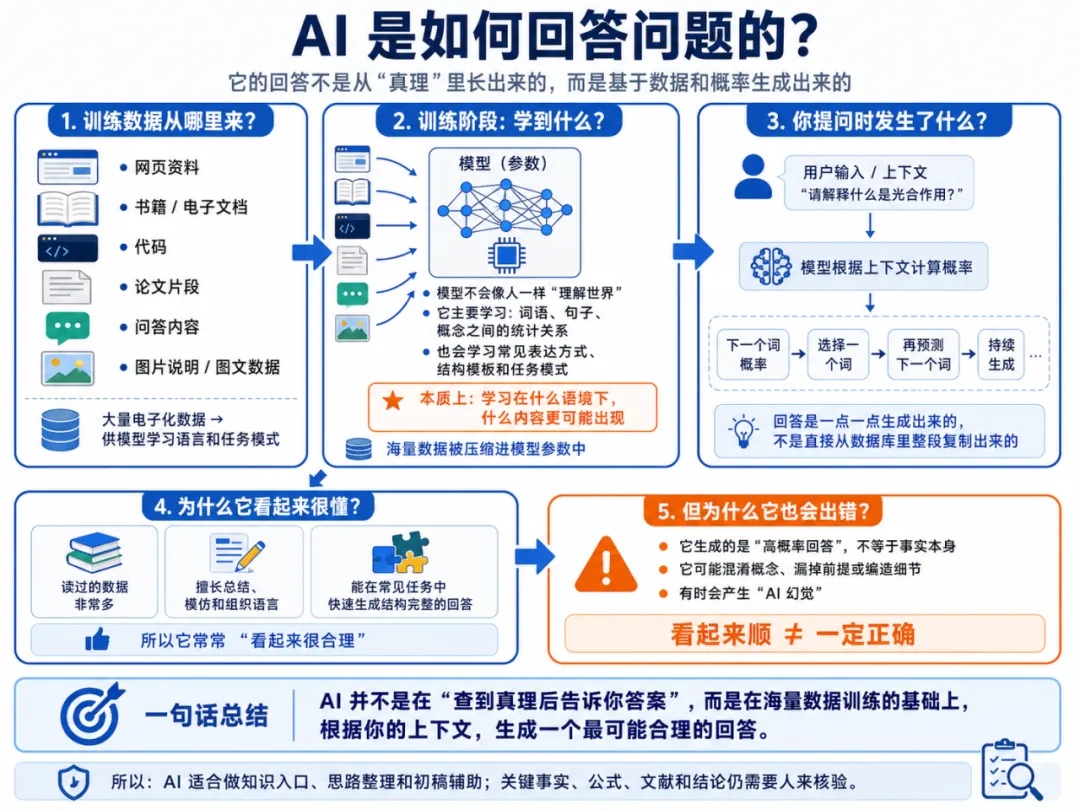

现在我们常用的 AI,很大程度上是基于大量电子化数据训练出来的。它读过海量文字、代码、图片说明、网页资料、论文片段和问答内容,然后学会了在不同语境下生成最可能合理的回答。所以它有两个很明显的特点:

第一个特点是:凡是重复性强、套路明显、短时间内可以总结模板的工作,AI 都很擅长。比如写一份普通通知、整理一段材料、生成一篇结构完整的文章、写基础代码、总结一个 PPT,AI 往往可以在很短时间内完成。它不一定有真正的理解,但它非常擅长模仿人类已经写过的表达方式。

第二个特点是:它像一个压缩过的知识库,也有某种“知识入口”的作用。以前我们想了解一个知识点,要打开网页、筛选资料、读很多内容。现在可以直接问 AI,让它先给出一个框架。对于学习来说,这确实很有帮助。比如我学物理概念时,可以先让 AI 用通俗语言解释,再让它列出公式、适用条件和例题。

但问题也在这里:AI 给出的东西看起来很顺,却不代表一定对。它的回答不是从“真理”里长出来的,而是基于数据和概率生成出来的。它可以说得很像真的,也可能错得很自然。

所以我们首先应该知道一个常识性的结论:AI 的回答不一定是正确的。甚至法律条文、公式定理这类看似有定论的知识,它也可能出错,我们常常称之为 AI 的“幻觉”。

2023 年美国 Mata v. Avianca 案中,律师把 ChatGPT 编造的假判例写进了提交给法院的文件里,结果被法官发现并处罚。这个例子很典型:AI 幻觉最可怕的地方,不是它会胡说,而是它能把胡说包装得非常像真的。

目前很多模型改进,也都在努力提升上下文推理能力,并减少幻觉现象。

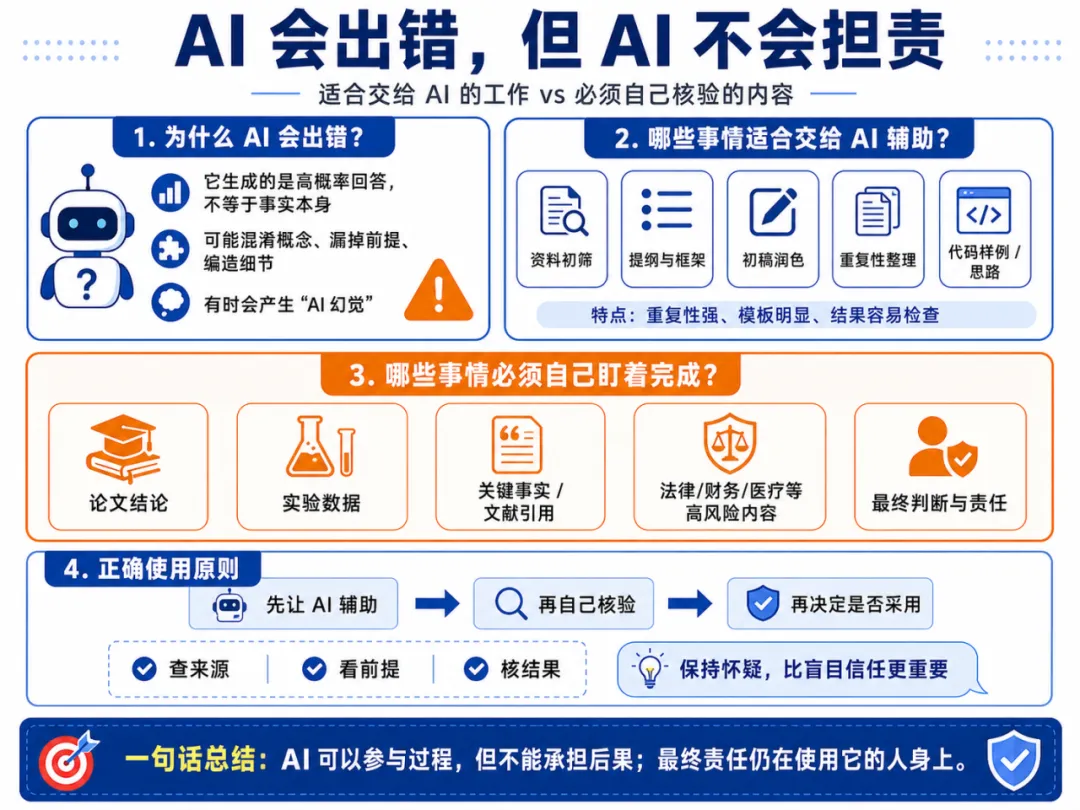

二、AI时代的担责意识

AI 会出错,但 AI 不会担责。这也是一个常有的笑话:大家说 AI 浪潮里最不可能下岗的职位是财务,因为出了事,AI 可没法坐牢。这个事实虽然显而易见,但我认为,这是我们在使用 AI 处理问题时需要下意识想到的一个基本原则。它决定了我们在使用 AI 的过程中,要区分哪些事情可以交给 AI,哪些事情必须自己盯着完成。

以往把工作外包给人时,事情搞砸了,至少还可以开始“分锅”。但现在你的外包对象是一个没有主体的 AI,出了事,责任大概率还是在你身上。AI 不会为你的论文负责,不会为你的实验数据负责,也不会为你的判断后果负责。它生成的内容最终由谁使用,责任就落在谁身上。

小组作业的时候,当然可以合理大量使用 AI 辅助做一些重复性的工作。但在论文写作中,就不能一股脑让 AI 计算数据、给出结果,然后自己无脑相信。保持怀疑,永远是面对 AI 给出的结论时最好的态度。

三、从第一性原理出发

作为一名物理系学生,笔者常常会看到一个名词,叫作“第一性原理”。第一性原理通常指从系统中最基本的命题或原理出发,进行逻辑推理的方法。

我们常常强调要从第一性原理来看待问题、解决问题。这也是物理学吸引人的地方:用极少数的基本假设,就可以建立起庞大的物理大厦,并尝试解释整个世界。

这其实是 AI 时代非常重要的一种能力。因为 AI 很擅长给出结论。你问它一个公式,它可以马上写出来;你让它解释一个概念,它可以给出一段看起来很流畅的文字;你让它总结一个知识点,它也可以迅速整理出完整框架。

但问题在于,AI 生成的内容并不意味着它真正理解了背后的物理机制。它可能把语言组织得很好,却忽略了适用条件;它可能给出一个看似正确的公式,却没有说明前提;它也可能把不同学科、不同模型下的结论混在一起,让错误变得不那么明显。

这时候,第一性原理思维就显得非常关键。当 AI 给出一个答案时,我们不能只看它“像不像正确答案”,而要进一步追问:它的基本假设是什么?它使用的模型是否合理?它有没有把近似条件说清楚?它的结论是否符合基本物理规律?如果换一个边界条件,结果还成立吗?

这种能力,其实就是一种更深层的学习能力。在 AI 时代,知识获取变得越来越容易,答案生成变得越来越快。但越是这样,我们越不能只停留在“得到答案”这一层。因为答案本身可能很廉价,真正有价值的是提出问题、建立模型、判断逻辑和验证结论的能力。

所以,第一性原理在 AI 时代的意义,不只是一个物理学术语,也不只是某种高级的思维口号。它提醒我们:面对复杂问题时,不要轻易被表面的结论带走,而要尽量回到基本规律、基本假设和基本逻辑中去。

在一次论文推导代码的 vibe coding 过程中,笔者让 AI 写的代码始终无法得到自己想要的数学推导结果。通过逐行筛查,笔者发现 AI 的代码逻辑和正常数学推导之间存在一个细微差别。笔者就从这个地方出发,通过追问的方式修正了问题。

所以,其实大家都在问:有了 AI,我们学习知识的意义在哪里?我的回答是,我们需要用学会的已有知识,对 AI 给出的结论进行纠正;借助第一性原理,我们才能对结论的推导过程是否正确形成判断标准。

四、培养主体意识

很多人都知道,AI 只是一个工具。但我更想强调的一点是:面对 AI,我们要有主体意识。

所谓主体意识,就是我知道自己要解决什么问题,知道为什么要做这件事,也知道 AI 在其中只是辅助,而不是替我决定方向。

我们经常会把 AI 比喻成一个不吃不喝的“电子牛马”,仿佛它是一个即将挤占我们生存空间的工作竞争对手。其实我们大可以转换一下主客体:把自己当成 AI 的“小老板”,用高标准要求它,甚至半开玩笑地说,用一点“PUA skill”压榨它,让它为我们工作。

要谨记,AI 是我们主体想法的放大和落地工具,而不是一把无主的魔法扫帚,带着我们漫无目的的飞。

比如这篇文章的写作过程,笔者当然没有手敲这篇 4000 字的大长文稿,而是先由自己构思结构,再把主要框架和核心观点交给 AI,让它生成初稿。在一些例子和论证部分,也会让 AI 帮忙写,但主题表达出来的观点还是笔者自己的。这种写作方式也为笔者节约了大量时间。

当然,为了文章思路的连贯性和写作文风不变,笔者最后还是把大部分内容手敲了一遍(怀疑是一种精神洁癖)更进一步,也可以直接把思路交给 AI,再通过不断反馈,慢慢得到更接近自己想法的文章。

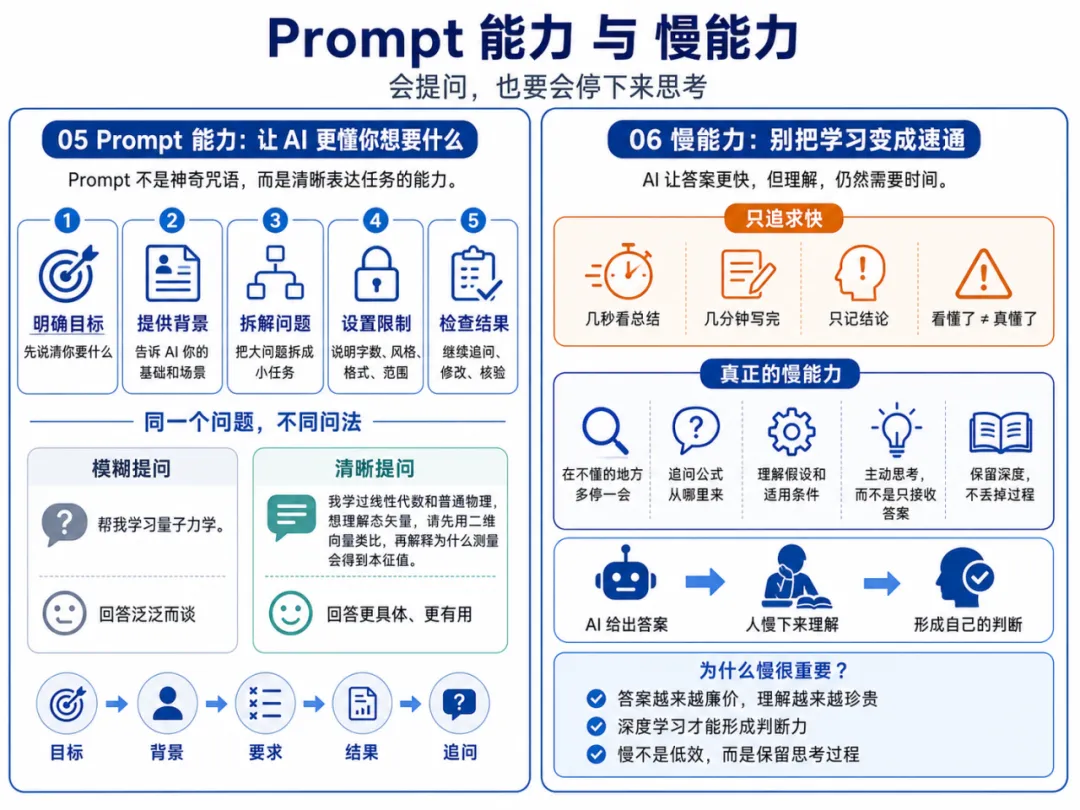

五、prompt能力的背后

接下来,是现在大家都在强调的 prompt 能力。就像摄影圈里,大家会在好看的照片下面问参数一样,好的 AI 作品评论区里,也总少不了“求 prompt”的留言。但我觉得,prompt 不是几句神秘咒语。毕竟授人以鱼不如授人以渔。想拍出好照片,不能只复制别人的参数,还要理解构图、光线和调色;想高效利用 AI,也不能只照搬别人的提示词,而要学会如何和 AI 正确对话。

AI 时代确实需要 prompt 能力。但我不太想把它理解成“会不会写高级提示词”。真正的 prompt 能力,其实是把一个模糊问题拆成清楚任务的能力。

比如你问 AI:“帮我学习量子力学。”这个问题太大,AI 只能给你一堆泛泛而谈的内容。

但如果你问:“我已经学过线性代数和普通物理,现在想理解态矢量。先不要讲太抽象,请用二维向量类比,再解释为什么测量会得到本征值。”这时候,AI 的回答就会明显更有用。

因为你不仅告诉了它“我要学什么”,还告诉了它“我的基础是什么”“我希望怎么讲”“先讲到什么程度”。所以你和 AI 对话的语言越模糊,它的回答通常也越模糊。你越能明确目标、背景、限制和输出形式,它越能帮你完成具体任务。

说到底,prompt 能力背后,其实是三种能力:明确目标、拆解问题、检查结果。明确目标,是知道自己到底想得到什么;拆解问题,是把一个大问题分成几个更容易回答的小问题;检查结果,是不把 AI 的回答直接当成最终答案,而是继续追问、修改和验证。

这也解释了为什么很多人觉得 AI 不好用。不是 AI 完全不行,而是我们常常没有把任务说清楚。尤其是任务越长、逻辑越复杂,越不能指望一句 prompt 就得到完美结果。更好的方式,是让 AI 先搭框架,再分段展开,最后由人来检查、追问和调整。

六、老生常谈:慢下来

最后,到了文章该“公式化升华”的部分了,我想来聊一聊从互联网时代起经常被人提起的“慢下来”的能力。

AI 最大的诱惑,是让一切都变快。几秒钟生成总结,几分钟写完文章,一句话得到答案。效率当然重要,但如果所有学习都变成“速通”,我们可能会失去真正理解一件事的能力。

就像我们反对那些“三集带你看完《红楼梦》”“两集告诉你量子力学的奥秘”之类的快节奏短视频。很多价值不只在于情节或者知识本身,更在于你慢下来深入学习它的过程。

在这个过程中,你会感叹于曹雪芹笔下生动的小人物描写;你会抓狂地疑惑:这个公式到底是怎么得到的?你更会感叹:这些精妙的基本概念,是怎么像地基一样撑起一座物理学大厦的。

在慢下来学习的过程中,你会主动思考、主动参与,深化对知识的理解,也会逐渐了解它背后的思维路径和发展过程。这些才是我们真正需要的,也正是前面所说的:如何培养用第一性原理看问题的能力,如何拆解问题并得到结果。了解了伽利略变换和以太概念,你才更能体会爱因斯坦保持怀疑的态度有多么可贵,也更能理解相对论的提出为什么是跨时代的成就。

问题没有办法完全速通。它需要停下来,需要反复想,需要在不懂的地方多待一会儿。我觉得这就是 AI 时代特别珍贵的“慢能力”。

慢不是低效,而是保留深度。慢不是拒绝技术,而是不让技术夺走自己的思考过程。

所以,回到开头那个问题:AI 会不会让设计师、写作者,甚至更多行业的人大规模失业?我的答案是:它会替代一部分“只会套模板的人”,但很难替代那些真正知道自己要表达什么、要解决什么问题的人。

AI 可以生成一张海报,但它不知道为什么要这样设计;AI 可以写出一篇文章,但它没有自己的经历和立场;AI 可以给出一个答案,但它不能替我们承担判断的后果。

所以在 AI 时代,我们真正要锻炼的,不只是使用某个工具的能力,更是保留作为人的主动性:能提出问题,能判断结果,能回到基本原理思考,能把复杂任务拆开,也能在一切都变快的时候,仍然愿意慢下来理解。

夜雨聆风

夜雨聆风