别再卷 AI 工具了,二/八原则中真正拉开差距的是决策习惯

前天晚上刷到 Jeff Gothelf 的一篇文章,标题大意是:有三种习惯,比 AI (人工智能)工具熟练度更能赢。

我第一反应是:这话有点耳熟。

现在谁还没几个 AI (人工智能)工具收藏夹?写文案用一个,画原型用一个,写代码用一个,做 PPT (演示文稿)再用一个。朋友圈里隔三差五有人晒:“我用某某工具 10 分钟做了一个产品原型。”

厉害是真厉害。

但问题也在这里。原型越来越快,方案越来越漂亮,团队反而更容易吵起来:到底哪个版本更好?谁的 Prompt (提示词)更高级?谁生成的页面看起来更像能融资?

说白了, AI (人工智能)把“做出东西”的门槛打低了,却把“判断什么东西值得做”的问题放大了。

这才是最烦的地方。

工具越快,团队越容易掉进“漂亮废稿”里

Jeff Gothelf 在文章里讲了一个产品设计场景:一家 AI-first startup (人工智能优先创业公司)的设计师,正在和一个利益相关方同时迭代同一个 UX (用户体验)问题。两个人都用 Lovable 、 Claude Code 这类 AI (人工智能)工具做出了很完整的 Mockup (视觉原型),然后各自拿着成果去说服团队:“我的更好。”

听起来是不是很熟。

以前这种内耗没那么容易发生。不是因为人更成熟,是因为成本高。设计稿要画,交互要接,开发要排期,谁都不能天天开新坑。

现在不一样了。你一句话,工具给你三个版本。再一句话,换配色、换布局、换交互、换信息架构。精致得像刚从发布会后台端出来。

坏就坏在“精致”。

精致会让人误以为它已经接近正确。其实很多时候,它只是接近好看。

麦肯锡 2025 年关于 AI (人工智能)的全球调研里有个数据挺刺眼: 88% 的受访组织说自己已经在至少一个业务职能里常规使用 AI (人工智能),但多数公司还停留在实验或试点阶段,真正开始企业级规模化的只有约三分之一。另一组数字也很有意思: 62% 的组织已经在实验 AI Agent (人工智能代理),但在单个业务职能里规模化部署的比例普遍不超过 10%。

这说明什么?

不是大家不会用。大家太会试了。问题是,试完以后不知道怎么收。

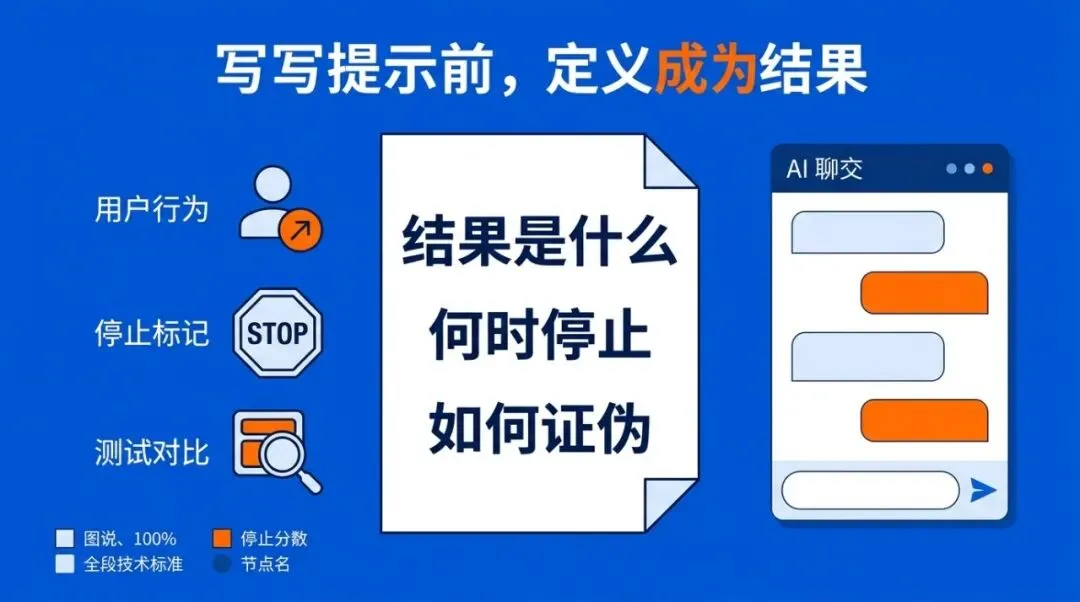

第一件事:写 Prompt (提示词)之前,先写结果

Jeff 给的第一条习惯是:在写 Prompt (提示词)之前,先命名结果。

这句话看着简单,做起来特别反人性。因为我们现在太容易直接开干了。

“帮我优化一下首页。”

“帮我做一个更高级的登录页。”

“帮我把这个流程改得更顺。”

这些话不是需求,是愿望池。 AI (人工智能)听了当然会干活,而且干得很卖力。它会生成一堆看似合理的输出,然后你在里面挑。挑到凌晨一点半,眼睛发干,脑子也发干。

不对。

正确的起点应该是:用户行为要发生什么变化?

比如,不要说“登录体验更好”,而是说“新用户能在 30 秒内完成注册,并且不需要问客服验证码在哪里”。不要说“页面更有转化率”,而是说“在 20 个目标用户里,至少 14 个能准确说出这个产品解决什么问题”。不要说“这个功能更智能”,而是说“用户第二次回来时,愿意继续沿用上一次生成的结果”。

这就是 Outcome (结果)和 Output (产出)的区别。

Output (产出)是页面、文案、原型、代码。 Outcome (结果)是用户真的改变了什么行为。

如果你说不清 Outcome (结果), AI (人工智能)会无限满足你的 Output (产出)欲望。

嗯。

这个坑太滑了。

第二件事:别等做到精致了才决定停

Jeff 的第二条习惯是:提前决定停止标准。

我特别喜欢这个点,因为它有点残酷。

大多数团队不是没有迭代能力,而是没有刹车能力。尤其在 AI (人工智能)工具进来以后,“再试一版”的成本低到像不要钱。真的,太容易瞎折腾。

今天换成卡片式。明天换成对话式。后天加一个 Agent (人工智能代理)头像。再过一天,老板说能不能更年轻化一点。

然后大家都很忙。

忙得像在推进项目,其实是在经营一个抛光工厂。

停止标准可以很土,但必须提前写。比如:

我们只做 3 轮迭代。 我们只比较 2 个方向。 我们找 5 个真实用户试用, 3 个以上完成关键任务就先进入下一步。 周五中午 12 点之前还没有显著差异,就保留当前版本,不再加新方案。

别嫌粗糙。粗糙的停止标准,也比“谁职位高谁说了算”靠谱。

这里我想插一句题外话。很多公司嘴上说数据驱动,开会时还是审美驱动;嘴上说用户第一,真到拍板时还是老板第一。 AI (人工智能)没有改变这个毛病,只是给它穿了一件更时髦的外套。

扯远了。说回正题。

停止标准不是为了限制创造力。它是为了保护团队的注意力。因为注意力一旦被无限版本吃掉,真正该被讨论的问题就没人管了:用户到底有没有更快完成任务?有没有更愿意回来?有没有少骂两句?

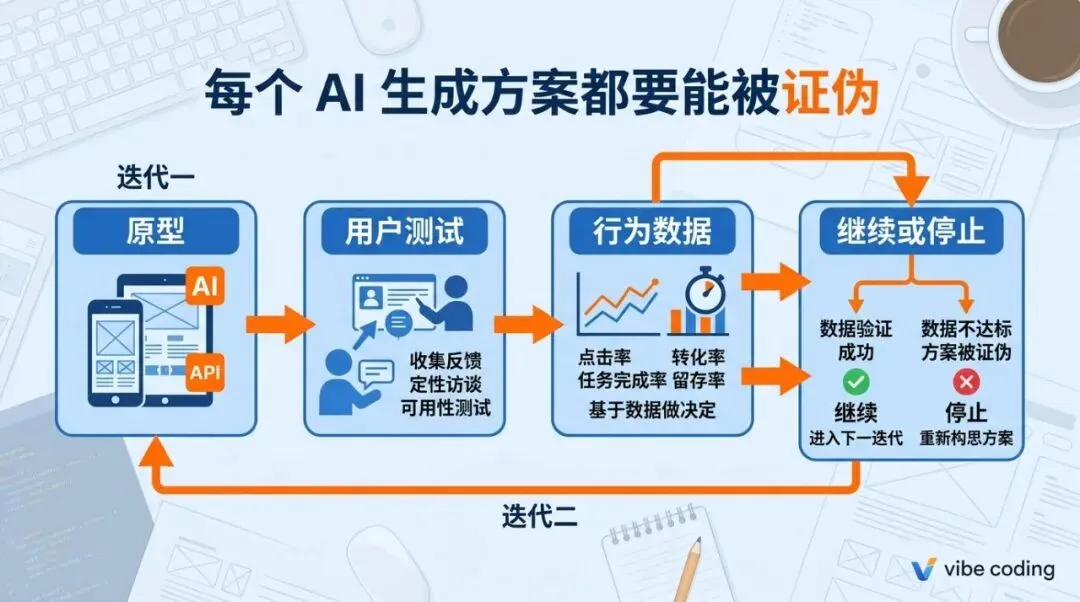

第三件事:每个方案都要能被证伪

第三条习惯更像 Lean UX (精益用户体验)的老传统:把每个方案当成 Hypothesis (假设),设计一个能证明你错了的测试。

这句话不好听。

谁愿意证明自己错了?尤其你刚用 AI (人工智能)做出一个漂亮得要命的原型,按钮有微动效,配色很克制,文案还带一点人味儿。你看着它,心里已经开始给自己鼓掌了。

但用户不会因为你生成得快就买账。

Jeff Gothelf 本人长期写 Lean UX (精益用户体验)、 Product Discovery (产品发现)和 OKR (目标与关键结果)。这套思想里有个很硬的底层逻辑:产品工作不是比谁产出更多,而是比谁更快接近真实。

真实通常不温柔。

一个方案看起来高级,用户可能根本不知道下一步点哪里。一个流程看起来完整,销售同事可能第一天就发现客户不认这个价值主张。一个 AI Agent (人工智能代理)看起来全能,用户可能只想让它做好一件小事。

所以测试要便宜,要短,要能杀死幻觉。

比如你有两个首页版本,不要让内部同事投票“哪个更好看”。拿给 5 个目标用户,让他们用 30 秒说出产品帮谁解决什么问题。说不出来,这个版本就别硬撑。

比如你做了一个 AI (人工智能)需求分析助手,不要先开发完整工作流。让 3 个产品经理拿真实 PRD (产品需求文档)试一下,看它能不能指出遗漏的边界条件。指出不来,说明“智能”只是个壳。

这就是证伪。

不是找证据证明我对,而是找最便宜的方法看看我是不是错得离谱。

真正的 AI (人工智能)能力,是把判断前置

我现在越来越觉得,未来 18 个月里, AI (人工智能)工具熟练度会变成基本功。

不是加分项。

就像会用搜索引擎、会做表格、会写邮件一样。到某个时间点,大家都会。你会用 Claude Code ( Claude 代码工具),别人也会;你会用 Lovable (无代码应用生成工具),别人也会;你能一晚上生成 20 个方案,别人也能。

那差距在哪里?

差距在三个问题:

我们这次到底要改变哪个用户行为? 做到什么程度就停止? 用什么测试证明自己可能错了?

这三个问题不性感。没有新工具截图,也没有“10 倍效率”的爽感。但它们决定了团队是不是在靠近价值,还是只是在制造更多看起来很厉害的东西。

AI (人工智能)最危险的地方,不是它会胡说八道。胡说八道还能查。

更危险的是,它会把一个方向不清楚的团队,武装成一个产能很高的团队。

产能很高,方向很湿。

那就麻烦了。

这个星期,可以先试一张纸

如果你团队正在用 AI (人工智能)做产品、设计、运营方案,别急着换工具。

拿一张纸,写三行:

第一行:这次迭代服务哪个具体结果? 第二行:什么数字或现象出现,我们就停止? 第三行:哪个测试能最快证明当前方向不靠谱?

然后再打开 AI (人工智能)工具。

顺序别反。

工具应该服务判断,不应该替代判断。 Prompt (提示词)写得再漂亮,也救不了一个没定义结果的任务。原型生成得再快,也掩盖不了团队不敢拍板的事实。

我也不敢说这三件事能解决所有问题。产品世界没那么乖。

但它能帮人少一点无效兴奋。

AI (人工智能)已经让“做出来”变得便宜了。接下来,贵的是判断。

夜雨聆风

夜雨聆风