从“工具”到“主体”:新加坡AI智能体治理框架的突破与数据治理新机遇

2026年1月22日,在瑞士达沃斯世界经济论坛上,新加坡信息通信媒体发展局(IMDA)发布了全球首个《AI智能体治理框架》(Model AI Governance Framework for Agentic AI)V1.0版本。这份框架的发布,标志着全球AI治理从传统生成式AI的“输出管控”阶段,迈入了针对自主决策型AI的“行为规制”新纪元。

对于关注数据治理的从业者而言,这份框架的意义远超一份政策文件——它预示着一场深刻的范式转移:当AI智能体开始以“类人主体”的身份参与数据生产、处理与决策时,治理的逻辑起点正在被重新定义。

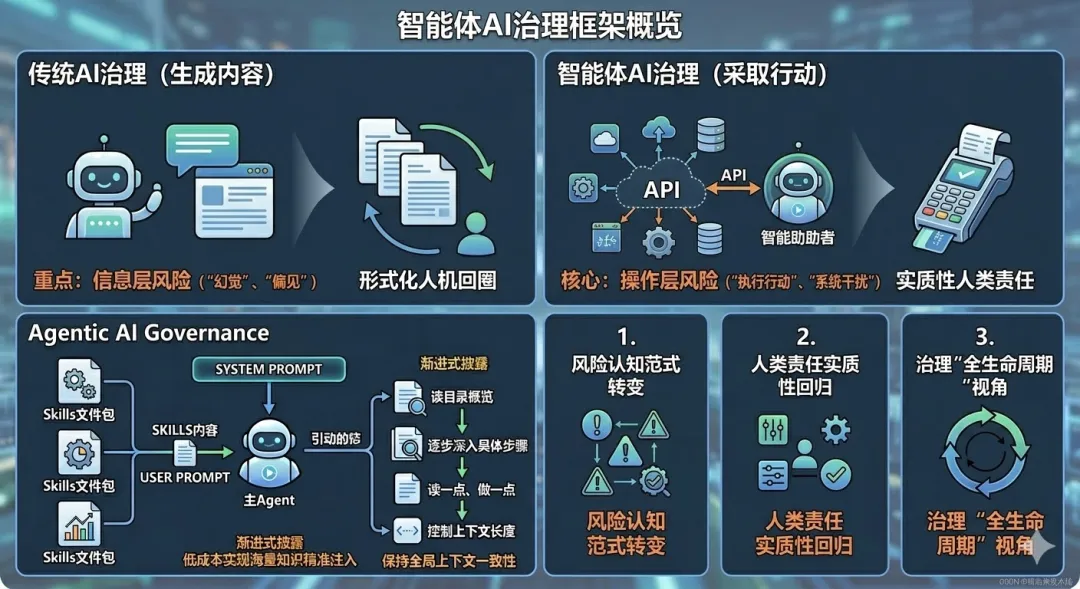

一、核心理念:从“形式化人机回圈”到“实质性人类责任”

新加坡IMDA的智能体AI治理框架并非凭空而来,而是建立在2020年以来“AI治理示范框架”的基础之上。但与传统AI治理相比,智能体AI的特殊性迫使治理理念发生了根本性转变。

(一)风险认知的范式转变

智能体AI与传统AI的本质区别在于:它不仅能生成内容,还能“采取行动”。IMDA在框架中明确指出,AI智能体可以“访问敏感数据、对环境进行更改、执行金融交易、更新客户数据库”。这种行动能力的赋予,使得风险形态发生了质变——从信息层面的“幻觉”和“偏见”,扩展到了操作层面的“错误操作”“未经授权的行为”和“对连接系统的干扰”。

更具挑战性的是,当多个智能体相互协作时,一个智能体的错误可能通过“连锁反应”在整个系统中传播,导致不可预测的后果。这不再是传统IT系统中可预判的单点故障,而是一种系统性的、涌现性的风险形态。

(二)人类责任的“实质性”回归

面对这一挑战,IMDA框架确立了一条核心原则:组织和个人应对其智能体的行为承担最终责任,人类的监督必须是“有意义的”而非“形式化的”。

所谓“有意义的”人类责任,体现在三个层面:

① 责任分配的清晰化:框架要求明确界定关键决策者、产品团队、网络安全团队和终端用户的各自职责。这不是简单的“谁签字谁负责”,而是将责任嵌入到智能体生命周期的每一个环节。

② 监督机制的实质性:对于高风险或不可逆的操作(如编辑敏感数据、对外转账),必须设置明确的人工审批检查点。IMDA建议采用“渐进式部署”策略——从内部辅助、低风险场景入手,验证安全后再逐步扩大应用范围。

③ 问责闭环的完整性:即使智能体自主运行,其行为也必须可追溯、可审计、可干预。这要求建立实时监控、日志记录和中断机制,确保人类能够在必要时“拉下闸门”。

(三)治理的“全生命周期”视角

IMDA框架的另一核心理念,是将治理从“上线前的合规检查”转变为“贯穿全生命周期的持续管理”。这一视角体现在三个关键的手段:

① 设计阶段的风险前置:要求在设计之初就明确智能体的权限边界、自主程度和影响范围,贯彻“最小权限原则”。

② 部署前的红队测试:针对智能体AI开展定制化的对抗性测试,模拟提示注入、工具滥用、目标操纵等攻击场景。

③ 运行中的持续监控:建立行为阈值和监控指标,实时追踪智能体的决策过程、工具使用和权限变更。

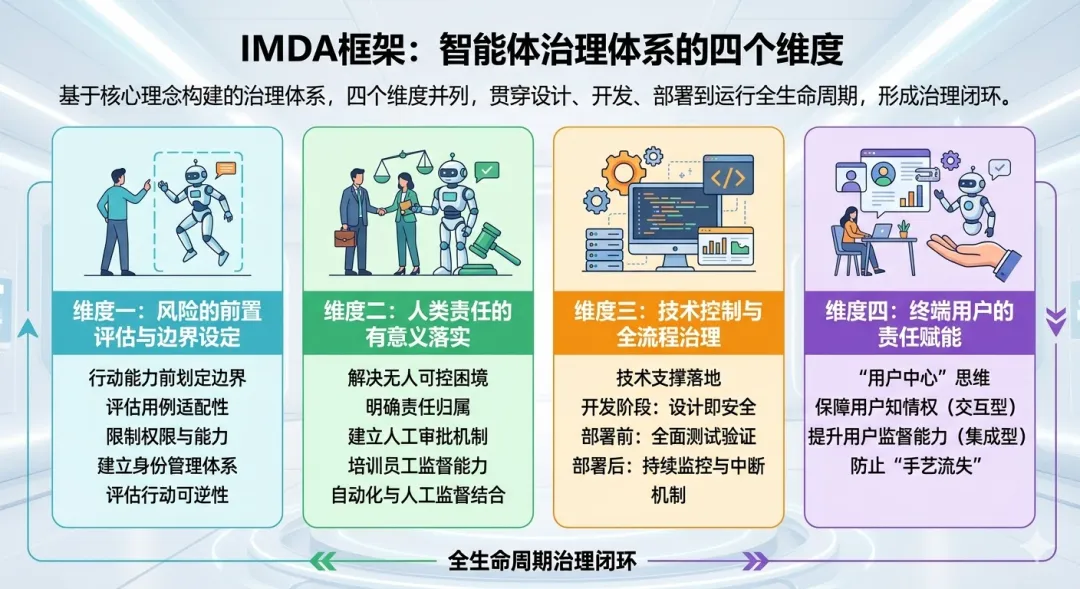

二、核心内容:四大治理维度的体系化构建

基于上述核心理念,IMDA框架构建了一个包含四个维度的治理体系:①风险的前置评估与边界设定,②人类责任的有意义落实,③技术控制与全流程治理,④终端用户的责任赋能。这四个维度贯穿了智能体从设计、开发、部署到运行的全生命周期,形成了一个完整的治理闭环。

以下是对四个维度的简要介绍:

维度一:风险的前置评估与边界设定——在智能体获得行动能力之前,先划定其行动边界。这一维度强调通过评估用例的适配性、限制权限与能力、评估行动可逆性等手段,将风险控制在可接受范围内。

这一维度的核心是“在智能体获得行动能力之前,先划定其行动边界”。框架核心要求组织:

① 评估用例的适配性:根据自主性级别、数据敏感度、任务复杂性等因素,判断智能体的应用场景是否在可接受风险范围内。框架特别指出,影响风险水平的因素包括:智能体的行动范围、行动的可逆性、自主程度、任务复杂度、对外部系统的访问权限等。

② 限制权限与能力:为智能体设定清晰的操作边界——只能访问完成功能所必需的工具和数据,只能执行预定义范围内的操作。对于高风险任务,甚至要求采用“沙箱运行”机制,在隔离环境中验证安全性后再放开权限。

③ 建立智能体身份管理体系:框架要求为每个智能体建立唯一身份标识,使其能够向组织、用户或其他智能体表明身份。智能体的权限应与其所代表的人类用户的权限挂钩,且不得超越该用户的授权范围。

④ 评估行动可逆性:区分低风险可逆操作(如整理信息)与高风险不可逆操作(如删除数据、对外转账),对后者设置更严格的护栏。组织在完成风险缓释措施后,需要对残余风险进行评估,判断是否在可接受范围内。

维度二:人类责任的有意义落实——解决“名义上有人负责、实际上无人可控”的治理困境。这一维度通过明确责任归属、建立人工审批机制、培训员工监督能力,确保人类对智能体承担实质性责任。

这一维度旨在解决“名义上有人负责、实际上无人可控”的治理困境。核心措施包括:

① 明确责任归属:框架要求组织内部的决策者、产品团队、网络安全团队、终端用户各司其职。其中,关键决策者(如董事会、高管)负责设定智能体的使用目标和总体治理策略;产品团队负责智能体的设计、开发、测试和部署;网络安全团队负责安全防护、红队测试和威胁建模;终端用户负责遵守使用政策、及时报告问题。同时,对模型开发者、智能体提供商等外部参与者也应明确责任边界。

② 建立人工审批机制:对于高风险行为,必须设置人工审批检查点。框架明确要求对以下行为设置审批:高风险的行动和决策(如编辑敏感数据、医疗或法律领域的最终决定)、不可逆操作(如永久删除数据、发送通信、进行支付)、异常或偏离行为(如智能体访问工作范围外的系统)、以及用户自定义的高风险操作(如超过一定金额的采购)。当智能体试图执行超出其权限范围的操作时,系统应自动触发人工介入。

③ 培训员工的监督能力:框架强调,培训不应止于“如何使用AI”,还应包括“如何审计、质疑和监督智能体的行为”。这包括让人类监督者了解常见的智能体故障模式(如推理不一致、引用过时政策),并定期审计人类监督的有效性。这实际上是要求人类从“操作者”转变为“监督者”。

④ 自动化监控与人工监督相结合:框架建议在人工审批的基础上,辅以自动化实时监控机制。通过设置告警阈值(如智能体尝试未授权访问、在特定时间内重复调用工具),或使用数据科学技术识别异常行为轨迹,甚至在多智能体系统中设置“智能体监督智能体”的机制,确保在人工介入之前能够及时发现并响应异常。

维度三:技术控制与全流程治理——为前两个维度的落地提供技术支撑。这一维度涵盖开发阶段的安全设计、部署前的测试验证、部署后的持续监控,构建起贯穿智能体全生命周期的技术防线。

这一维度为前两个维度的落地提供了技术支撑。IMDA框架建议采取以下关键控制措施:

① 开发阶段:设计即安全。实施安全软件开发生命周期(SDLC),确保系统提示的稳健性。对模型进行加固,训练其识别并拒绝被禁止的任务。针对智能体的新组件增加专门控制:在规划环节,可提示智能体反思其计划是否符合用户指令,并在执行前总结理解、请求确认;在工具环节,配置严格输入格式,应用最小权限原则限制工具访问,对数据相关工具,除非绝对必要,否则不授予对敏感数据库的写入权限。

② 部署前阶段:全面测试。组织应开展整体性的任务执行测试,评估政策合规性和工具使用准确性。测试应覆盖多个维度:整体任务执行准确率、政策遵循情况、工具调用的正确性(包括调用的工具、权限、输入和顺序)、以及智能体对错误和边缘情况的鲁棒性。测试应在真实或接近真实的环境中进行,使用适当配置的执行环境(如工具集成、外部API、沙箱),并在多个数据集上重复测试,以捕捉低概率但高影响的行为。

③ 部署后阶段:渐进式上线与持续监控。框架建议采用渐进式部署策略——可以先向经过培训或有经验的用户开放,或先限制智能体使用更安全的白名单工具,或先在低风险内部系统中使用。同时建立实时监控系统,记录智能体的每一步操作和智能体间的交互。监控系统的设置需要考虑:记录什么(优先监控高风险活动如数据库更新、金融交易)、如何有效监控(设置程序化阈值告警、使用异常检测技术、或让智能体监控其他智能体)、以及定义具体干预措施(低优先级告警可安排定时审查,高优先级告警需暂停智能体执行等待人工评估)。一旦智能体出现异常行为、陷入推理循环或偏离既定目标,系统应自动报警并触发中断机制。

维度四:终端用户的责任赋能——体现框架的“用户中心”思维。这一维度通过保障用户知情权和提升用户监督能力,让安全不仅依赖于开发方和部署方,也需要终端用户的参与。

这一维度体现了框架的“用户中心”思维——安全不仅是开发方和部署方的责任,也需要用户的参与。框架根据用户类型的不同,区分了两种场景:

① 保障用户知情权(面向交互型用户):这类用户通常与代表组织的智能体交互(如客服智能体、销售智能体)。用户应当清楚知晓自己面对的是AI系统,理解该系统的能力边界和使用限制。框架要求向用户明确告知:用户的职责(如核对智能体提供的信息)、正在与智能体交互的事实、智能体被授权执行的操作范围、数据收集和使用方式(需符合数据隐私政策)、以及负责人工问责的联系方式。这既是透明度要求,也是防止用户过度依赖或误操作的必要措施。

② 提升用户监督能力(面向集成型用户):这类用户将智能体集成到自身工作流程中(如代码助手、企业流程自动化)。除了上述透明性要求外,还需要提供额外的教育和培训。培训内容应包括:智能体的基础知识、适用用例(理解如何将智能体融入日常工作、何时应限制使用)、如何有效指导智能体(提示词最佳实践、关键词表)、智能体的能力范围、有效的监督方法(常见故障模式如幻觉、陷入循环)、持续支持(定期更新最新功能和常见错误)。特别值得注意的是,框架还强调了对“手艺流失”(tradecraft)的关注——随着智能体接管入门级任务(传统上这些任务是新员工的训练场),可能导致用户基础操作知识的流失。组织应识别每个岗位的核心能力,提供充分的培训和工作实践,确保用户保留基础技能。

二、反观数据治理,这是全新的新机会

在分析这份框架时,最强烈的感受是:数据治理正在经历一场从“被动合规”到“主动赋能”的范式重构。而这背后,恰恰孕育着数据治理领域的新机会。

(一)治理对象的转变:从“数据”到“智能体”

传统数据治理的核心关注点是数据本身——如何保证数据质量、如何管理数据生命周期、如何确保数据安全与合规。但在智能体AI时代,治理对象正在发生根本性转变:我们不仅要治理数据,还要治理“能够操作数据的主体”。

这种转变的深层含义在于:数据不再是被动的“被治理对象”,而是智能体行动的“媒介”和“资源”。当智能体能够自主访问、处理、甚至修改数据时,数据治理的逻辑起点就从“如何保护数据”转变为“如何约束主体对数据的使用”。

这意味着,传统以MELT(指标、事件、日志、链路)为核心的可观测性治理框架,在面对多智能体协作时显得力不从心。业界已经提出了以“语义为中心”的五层治理架构——语义层、认知层、协作层、成本层、安全层,试图穿透智能体的“行为表象”进行深度治理。这恰恰验证了一个趋势:数据治理正在从“系统状态监控”走向“智能行为规制”。

(二)治理方式的转变:从“静态规则”到“动态信任”

新加坡框架中反复出现的“渐进式部署”“实时监控”“人工干预检查点”等概念,揭示了一种治理方式的深层转变:从预设静态规则的事前管控,转向动态评估信任的持续监督。

这与传统数据治理的逻辑形成鲜明对比。过去,我们习惯于在系统上线前制定完所有的数据访问规则、质量标准和合规要求,然后“一劳永逸”。但在智能体AI场景中,这种静态模式显然失效了——因为智能体的行为不是预设的,而是与环境交互中涌现的。

正如有学者提出的观点:治理智能体的核心不是约束具体行为,而是建立信任关系。这种信任关系的构建,需要技术层面(动态数字合约、使用控制)和制度层面(身份确认、协议管理)的双重支撑。换言之,未来的数据治理可能更接近于“社会信用体系”而非“交通信号灯”——不是简单地规定什么能做、什么不能做,而是建立一套动态评估、持续监督、事后追责的信任机制。

(三)智能体治理与数据治理的深度相似性:从业者的天然转型路径

当我们仔细拆解IMDA框架的核心要素时,会发现一个被忽视的事实:智能体治理与数据治理在底层逻辑上高度同构,数据治理从业者具备转型为智能体治理专家的天然能力基础。

这种相似性主要体现在以下几个维度:

第一,治理对象的行为属性高度一致。数据治理的核心是管理“人对数据的访问和操作行为”——谁在什么条件下、基于什么权限、对哪些数据执行了何种操作。而智能体治理的核心,本质上是在管理“智能体对数据和系统的访问与操作行为”。两者的治理逻辑完全一致:都需要定义主体身份、划定权限边界、记录操作轨迹、建立审计机制。

IMDA框架中反复强调的“最小权限原则”“身份管理”“访问控制”“操作日志”,正是数据治理领域过去十年积累的核心能力。当一个数据治理专家看到框架中“为智能体建立唯一身份标识”“将智能体权限绑定至其代表的用户”等要求时,会感到格外熟悉——这与数据治理中“服务账号管理”“权限继承”“角色基访问控制”如出一辙。

第二,责任链条的逻辑完全同构。数据治理的核心责任模型是:数据的“所有者”对数据安全负责,数据的“处理者”按所有者授权行事,所有操作可追溯至具体责任人。IMDA框架构建的责任模型几乎是对这一逻辑的直接映射:关键决策者(相当于数据所有者)定义智能体的行为边界;产品团队和网络安全团队(相当于数据处理者)负责具体实施;终端用户(相当于数据操作者)承担使用过程中的监督责任。

这种同构性意味着,数据治理领域成熟的责任分配框架、问责机制设计、合规审计方法,都可以直接迁移到智能体治理场景中。数据治理从业者所熟悉的RACI矩阵、控制矩阵、审计轨迹设计等工具,在智能体治理中同样适用。

第三,风险识别框架高度重合。IMDA框架将智能体风险归纳为四类:错误操作、未授权操作、数据泄露、对连接系统的破坏。这四类风险,恰恰是数据治理过去十年重点应对的领域——数据质量(错误数据写入)、权限管理(越权访问)、数据安全(泄露防护)、系统稳定性(变更管控)。

框架中要求的“威胁建模”“污点追踪”“红队测试”等技术方法,同样是数据安全领域的成熟实践。数据治理从业者对数据流图的绘制、敏感数据的识别、异常访问行为的检测,都构成了智能体治理所需的核心技能。

第四,治理工具链高度相通。IMDA框架要求建立的技术控制体系——身份认证、权限管理、操作日志、实时监控、异常告警——与数据治理平台的技术栈高度重叠。数据治理领域成熟的数据目录、元数据管理、数据血缘追踪、数据审计平台,经过适度扩展后,完全可以成为智能体治理的基础设施。

事实上,这正是当前市场正在发生的趋势,数据治理平台与智能体治理平台的融合,将是未来两年最值得关注的技术趋势之一。

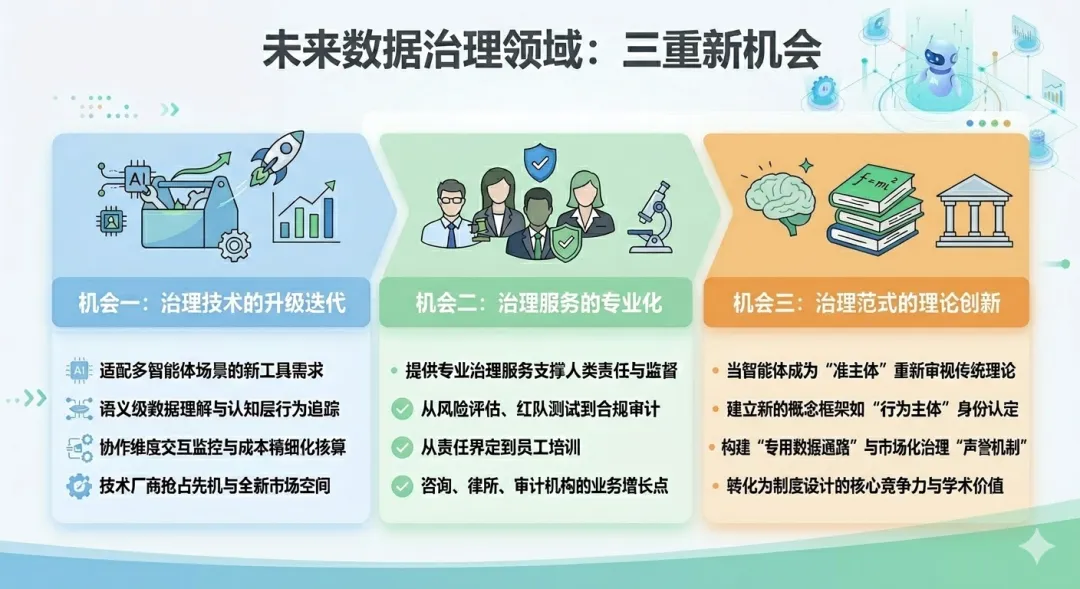

(四)数据治理的新机会:从“成本中心”到“价值引擎”

未来数据治理领域应该会迎来三重新机会:

机会一:治理技术的升级迭代

当智能体成为数据治理的新对象时,传统的治理工具显然不够用了。这催生了新的技术需求——语义级的数据理解、认知层面的行为追踪、协作维度的交互监控、成本层面的精细化核算。对于技术厂商而言,这意味着一个全新的市场空间:谁能率先开发出适配多智能体场景的治理工具,谁就能占据先机。

机会二:治理服务的专业化

新加坡框架反复强调“人类责任”和“监督能力”,这意味着企业需要专业的治理服务来支撑。从风险评估、红队测试到员工培训,从责任界定到合规审计,这些服务需求将催生一批专注于AI治理的中介机构。对于咨询公司、律所、审计机构而言,这无疑是重要的业务增长点。

机会三:治理范式的理论创新

当智能体开始以“准主体”的身份参与数据活动时,传统以“所有权”“控制权”为核心的数据治理理论需要被重新审视。我们可能需要建立新的概念框架——比如“行为主体”的身份认定、“专用数据通路”的构建、“声誉机制”的市场化治理。这些理论创新不仅具有学术价值,更可能转化为制度设计的核心竞争力。

三、后记

我们需要跳出传统的“数据管理”思维,站在“智能体行为规制”的高度重新审视自己的能力和定位。谁能在这场范式重构中率先抢占市场,或许谁就能在智能体AI时代的竞争中占据主动权。

紧跟时代。。。紧跟时代。。。

四、参考资料

(1)IMDA. (2026). Model AI Governance Framework for Agentic AI V1.0. Infocomm Media Development Authority, Singapore.

(2)用友. (2026年3月6日). 数据治理新范式|用友数据治理多Agents协作平台发布。

(3)博睿数据. (2026年1月22日). 从MELT到语义治理:深度解析多智能体协作下的新一代数据治理.

(4)36氪. (2026年3月12日). 2026年智能体人工智能治理框架:风险、监督和标准.

夜雨聆风

夜雨聆风