元以AI早报-2026年04月25日

1.DeepSeek V4 重磅开源!首次打通华为Ascend,也没丢掉英伟达,百万上下文夺回国产模型话语权 2.KernelSwift率先实现DeepSeek-V4核心算子在多元国产芯片上0Day适配 3.第一时间,寒武纪原生适配DeepSeek-V4!两大国产之光再次强强联合

元以AI早报

DeepSeek V4 重磅开源!首次打通华为Ascend,也没丢掉英伟达,百万上下文夺回国产模型话语权

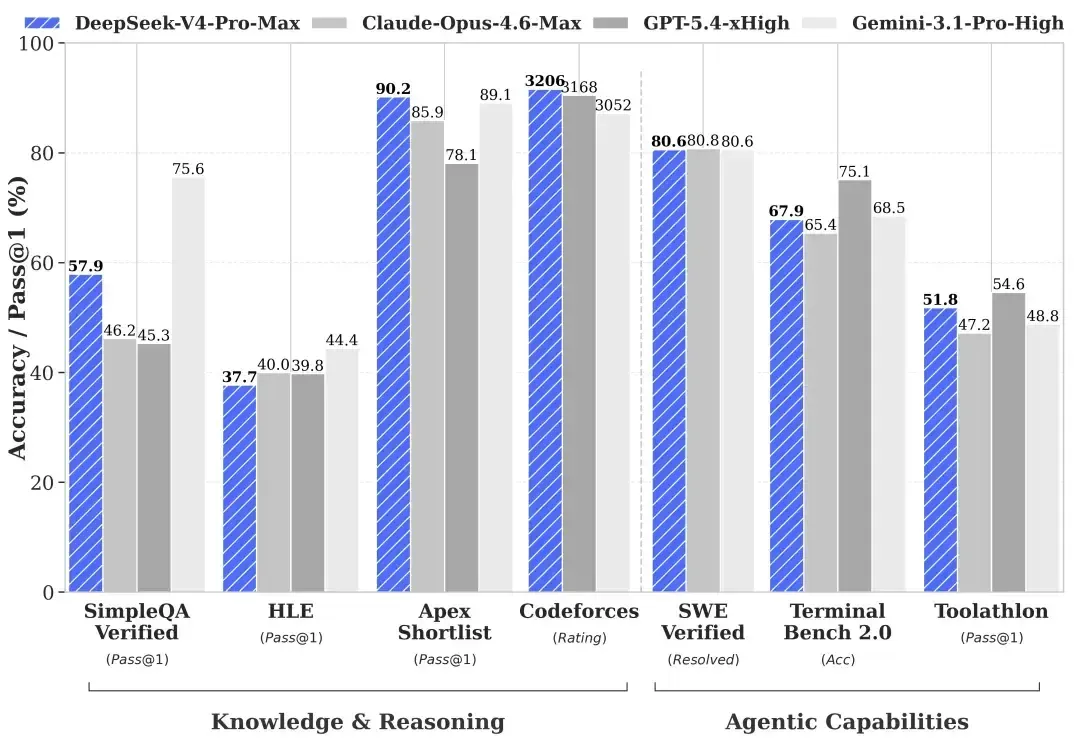

本次DeepSeek正式推出全新DeepSeek-V4预览版本并同步开源,推出面向高性能的Pro版本和主攻性价比的Flash两个版本,API服务已同步更新,用户只需修改model名称即可调用,旧版模型名将于2026年7月正式停用。该模型全系标配百万字超长上下文,开创性采用压缩稀疏注意力(CSA)与高度压缩注意力(HCA)的交错架构,大幅降低长上下文处理的计算与显存消耗,同时新增Engram条件记忆模块实现记忆推理分离、mHC流形约束超连接解决深层网络训练不稳定问题,多项核心架构创新大幅提升模型效率与性能。性能层面,V4-Pro在多项基准测试中刷新开源模型天花板:Codeforces Elo达3206分追平GPT-5.4,SWE-Verified得分80.6%接近Claude Opus 4.6,中文功能性写作胜率优于Gemini 3.1 Pro。技术层面,DeepSeek首次将细粒度专家并行方案同时在NVIDIA GPU和华为昇腾NPU完成验证,在优化现有CUDA生态的同时,也为模型摆脱单一硬件依赖完成了前期布局,整体性能与适配能力都将国产开源大模型推到了新高度。

信息来源:https://mp.weixin.qq.com/s/_7pbCnEraPj1ndtIysznJw

KernelSwift率先实现DeepSeek-V4核心算子在多元国产芯片上0Day适配

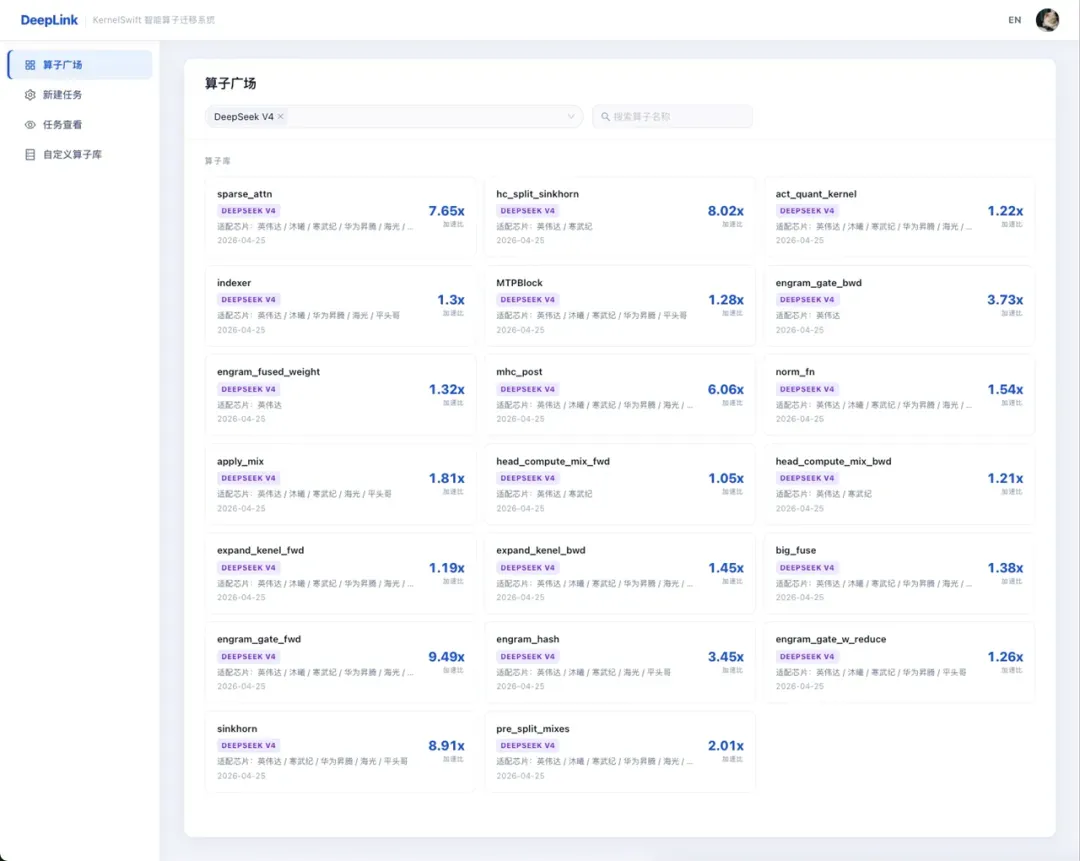

今日DeepSeek-V4预览版本正式发布并开源,上海AI实验室DeepLink团队凭借大模型驱动的智能算子迁移系统KernelSwift,率先完成DeepSeek-V4核心算子在昇腾、沐曦、摩尔线程、海光等多家国产芯片的0Day适配,算子平均通过率约80%,实现了顶级大模型发布与国产算力适配同步落地,为开发者带来无缝部署体验。作为支持多元算力的智能系统,KernelSwift可提供指定芯片的Triton算子定制优化服务,凭借高级抽象与自动算子生成能力,将原本需要数月的适配周期压缩至小时级,能为多元国产AI芯片提供开箱即用的高性能算子支持,同时支持全链路支撑,摆脱单一生态绑定。本次适配全程无人工干预,21个核心算子中,KernelSwift实现NV芯片100%正确性,核心算子性能相比tilelang提升1.2倍以上;国产芯片原生平均达75%以上正确性,平均加速比达3.4x,仅需少量人工修改即可实现100%正确性,大幅提升了开发迁移效率,相关算子也预备上线官方算子库供开发者取用。

信息来源:https://mp.weixin.qq.com/s/x756kzEwwMixlXoBdVvi4g

第一时间,寒武纪原生适配DeepSeek-V4!两大国产之光再次强强联合

DeepSeek发布V4系列大模型后,国产AI芯片厂商寒武纪第一时间基于vLLM推理框架,完成了对285B DeepSeek-V4-flash 和 1.6T DeepSeek-V4-pro两个版本的Day 0适配,适配代码已经正式开源到GitHub社区。这也是寒武纪继去年DeepSeek-V3.2发布后,连续两次第一时间完成DeepSeek新模型适配的国产芯片厂商。本次深度合作,既得益于寒武纪长期积累的自研NeuWare软件生态与芯片设计技术,也是寒武纪持续投入芯片与算法联合创新的成果,DeepSeek-V4原生运行在寒武纪芯片上,对中国人工智能产业发展具有里程碑意义。本次适配从快速模型迁移、极致性能优化两大维度,充分展现了寒武纪软硬件协同的核心技术实力,通过一体化优化释放硬件潜能、降低部署算力成本,寒武纪后续也将继续深耕协同生态,提供更高效的大模型部署方案。

信息来源:https://mp.weixin.qq.com/s/6Atg77qiirLKvOyzNOVtWQ

阶跃 StepAudio 2.5 ASR 上线!500TPS 极速推理,30分钟语音“秒级转写”

近日阶跃星辰正式发布新一代自动语音识别模型StepAudio 2.5 ASR,这款模型的核心突破在于实现了速度与精度的兼得,它率先将大语言模型的推理加速技术引入语音识别领域,采用ASR+MTP-5深度融合架构,带来了堪称飞跃的性能提升:实测推理吞吐量提升400%、时延降低60%,推理峰值可达500 tokens/s,推理成本更是直降80%,日常5分钟左右的音视频转写仅需“一眨眼”,30分钟长音频也能实现秒级转写。精度方面,StepAudio 2.5 ASR在中英文多个权威开源测试集上,字错误率、词错误率均显著低于同类模型,即使30分钟满负载长音频输入也不会出现“越转写精度越低”的衰减问题,整体精度达到业内SOTA水平。针对传统长音频转写依赖切片拼接导致的上下文断裂问题,该模型直接复用LLM原生32K上下文窗口,可单次完整转写30分钟音频,转写全程都能保留完整上下文信息,彻底解决了传统方案的痛点,目前已全量上线开放平台供用户体验。

信息来源:https://mp.weixin.qq.com/s/jGeJxEsGHaLNT00BoqcTZw

大模型上车两年,为什么「真·AI 汽车」现在才出现?

过去两年大模型上车成为行业热潮,几乎所有车企都宣布接入大模型,座舱语音助手的聊天、查询能力确实有所提升,但本质上只是在座舱里加了一个外接的对话机器人,智驾系统和座舱智能完全是两条平行线,就像给人装了聪明的大脑却没连接四肢的神经,根本没法实现一句话调动全车的整车智能。行业长期面临三大痛点:拼接式模型没法真正理解物理世界、智驾智舱两套架构难以打通、量产落地很难跑通闭环。直到原生融合方案出现才打破僵局,阶跃星辰联合千里科技打造原生智驾基座模型,从预训练阶段就融合通识数据与智驾数据,走原生强耦合路线。阶跃星辰的旗舰基座模型Step 3.5 Flash发布后,在OpenRouter调用量登顶全球第一,还具备覆盖汽车全链路感知的多模态模型矩阵,后续又和腾讯云合作补上了生态服务层。该方案落地的极氪8X首发搭载超级Eva整车智能体,上市仅29分钟大定就突破10000台,获得市场认可,真正的AI汽车变革才刚刚开启。

信息来源:https://mp.weixin.qq.com/s/HOPmMYH9OxVLdgSf36sVrw

豆包上车2.0:用一个AI大脑,联动整车

在北京车展开幕首日,字节旗下火山引擎发布基于Agentic AI架构的新一代汽车AI解决方案,其中核心产品豆包座舱助手方案将于今年年内量产上车,可与豆包APP互联互通、能力同步进化。不同于以往大模型上车仅接入云端API的浅合作模式,本次火山引擎与头部明星车企深度共创,车企投入上亿元开发费用,火山引擎从各部门抽调上百人组建专项组推进落地,目前已经有超过700万辆智能汽车搭载豆包大模型,搭载量稳居行业前列。本次推出的豆包座舱助手突破了传统一问一答的指令交互,实现全双工免唤醒自然对话,可理解模糊指令、联动车控与出行服务,还能主动识别沿途景点推荐路线。火山引擎还创新性地在车端部署30B规模大模型实现全域感知,搭配定制的英伟达芯片AI Box方案,打造统一的整车AI大脑,当前阿里通义千问等科技巨头也纷纷切入赛道,汽车座舱智能化迎来新竞争热潮。

信息来源:https://mp.weixin.qq.com/s/Kj_gMLegsO0XXqespEN2hw

宝马北京车展首发AI座舱智能体 基于阿里千问大模型专为中国定制

本次北京车展上,宝马基于阿里巴巴AI能力定制的座舱智能体正式首发亮相,这款新智能体以阿里千问大模型为底座,依托斑马智能元神AI打造,实现了车机从“能听懂”到“会办事”的跨越,标志着宝马与阿里的合作正式迈入智能体AI新阶段。针对传统车机语音助手语义理解弱、无法完成复杂出行需求的痛点,宝马专为中国市场定制了“用车专家”“出行伙伴”“百科达人”三款AI智能体,从被动响应升级为主动决策,真正做到“听得懂、办得妥”。全新新世代BMW iX3长轴距版将成为首款搭载这三款智能体的车型,随后全新BMW 7系也将跟进落地。这款智能体的规模化落地离不开阿里巴巴全栈AI能力支撑,双方合作始于2015年,至今已有十年,是跨国车企与中国科技公司合作创新的典范,未来还将继续深化合作打造更多智能化新体验。

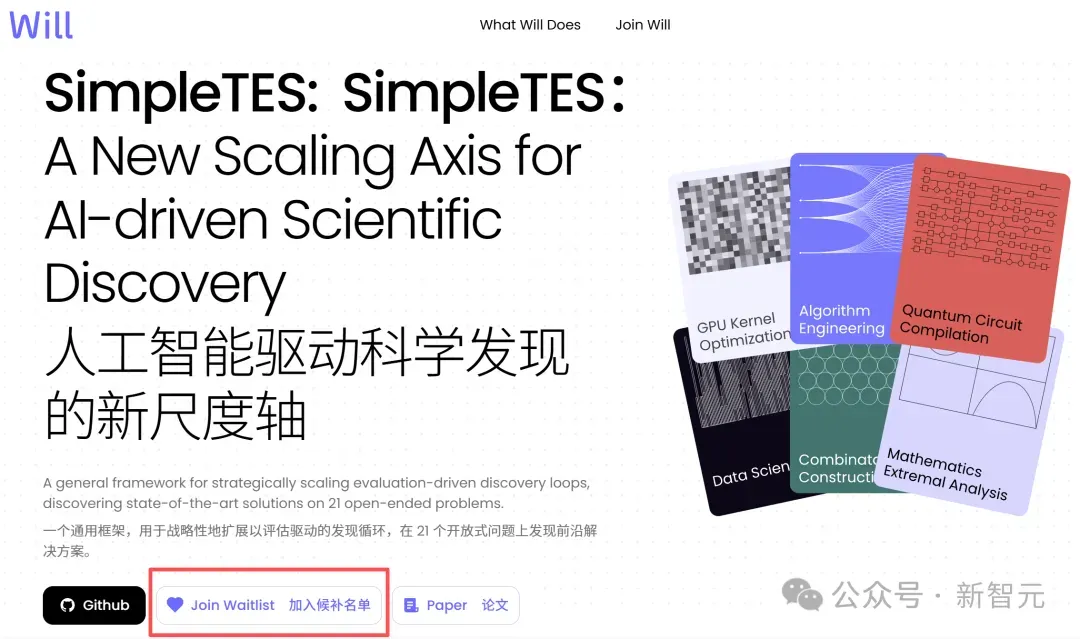

夯爆了!清北斯坦福联手,SimpleTES横扫21个科学难题

过去一年AI科研圈普遍痴迷更大参数、更长推理,认为只要模型足够聪明就能自动催生科学发现,而宽德智能学习实验室联合斯坦福、北京大学、清华大学、香港科技大学(广州)推出的SimpleTES框架,直接打破了这一共识,提出将科学发现的核心——试错环节系统化放大,靠优化科研工作流而非堆模型参数就能突破前沿。SimpleTES在6大领域21个开放科学问题上成绩惊人:它在经典圆填充问题的n=26、n=32规模双双刷新世界纪录,将经典LASSO算法路径求解速度提升超2倍;在量子计算领域把IBM Q20芯片的额外CNOT门开销从60189砍到45441;在GPU算子优化中,把蛋白质结构预测核心算子TriMul在MI300上的运行时间从2.657毫秒压到1.352毫秒;在组合构造问题上,性能超越Google的AlphaEvolve V2达2.05%。它靠开源模型就击败了众多闭源模型基线,还通过轨迹级后训练让模型学会可迁移的科研探索能力,为AI for Science打开了全新发展方向,目前试用平台和代码均已开源。

信息来源:https://mp.weixin.qq.com/s/uLj5Q_CKBUsT180I5yGJew

智平方郭彦东:VLA终结了吗?它只是变得更强!

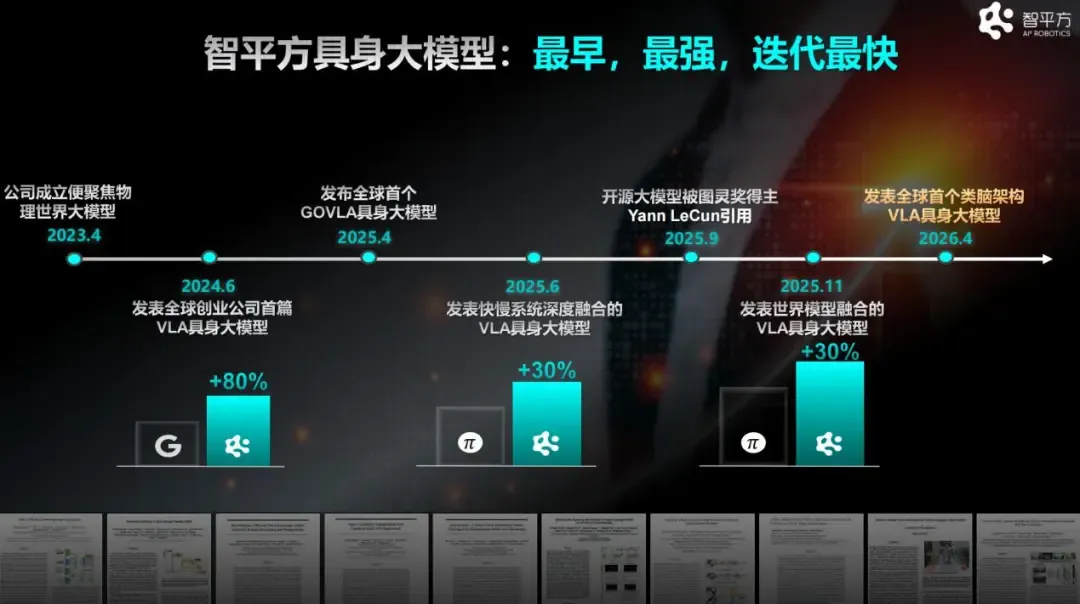

近年来世界模型概念持续升温,行业出现“VLA(视觉-语言-行动)时代即将终结,将被世界模型取代”的争议声音。在2026 POWER Robot未来大会主论坛上,智平方创始人兼CEO郭彦东正面回应这一争论,明确给出定调:VLA时代并未结束,反而在持续变强,依旧是通往物理世界智能的最强主航道,世界模型并非VLA的颠覆者,而是能力加持者。郭彦东指出,任何真实世界的智能系统都离不开感知、推理、控制三大核心,变化的只是三者的组织方式,智平方将VLA发展划分为三阶段,最新演进方向是类脑分层结构的VLA智能系统。在技术落地层面,智平方不断实现代际突破:2024年推出全球创业公司首个VLA大模型,模型规模仅为谷歌同类的1/20,性能提升超80%;2025年新一代架构性能超越国际标杆Pi0达30%;本次大会发布全球首个类脑架构VLA(NeuroVLA),让机器人拥有类似“肌肉记忆”的持续进化能力,实现毫秒级响应,标志着机器人从执行工具向可自优化智能体迈出关键一步。本次大会还同步推出全球首个一站式开箱即用的具身模型开源社区AlphaBrain Platform,推动具身智能进入生态竞争新阶段。

信息来源:https://mp.weixin.qq.com/s/unr6Q0HA9wUw0GisoBmPMA

机器人马拉松超越人类之后:本体走到尽头,智能成为下半场

2026年北京亦庄人形机器人半程马拉松赛上,荣耀人形机器人“闪电”以50分26秒的净用时夺冠,大幅领先人类男子半程马拉松57分20秒的世界纪录,宇树H1也按比例计算打破了人类1500米世界纪录,这是人形机器人成绩首次真正意义超越人类,也引发了具身智能行业对发展路线的讨论。当前具身智能行业融资火热,2026年前三个月行业融资接近200起,规模超300亿元,达到2025年全年的近六成,它石智航更是创下中国具身智能单轮融资纪录,拿到4.55亿美金Pre-A轮融资。目前行业分化出两条发展路线:一条是宇树代表的硬件本体路线,深耕十年打磨机器人运动能力,却被外行荣耀用一年时间超越,暴露出硬件优势易被抹平、“四肢发达头脑简单”的问题,宇树也开始投入20亿补大脑研发的短板;另一条是它石智航代表的AI原生模型路线,聚焦具身大脑研发,落地高价值高难度场景,获得资本青睐,行业已经进入本体竞赛结束、智能竞赛开启的下半场。

信息来源:https://mp.weixin.qq.com/s/NYAHoj8EOHWxNpi3t3IbrA

早报内容及素材均来自网络公开渠道,版权归原作者所有,仅作信息分享使用。

—— END ——

夜雨聆风

夜雨聆风