AI系列|AI发展的隐忧:伦理难题如何破解?

将水木上岸设为“星标⭐”

掌握第一手top院校信息

水木上岸自2017年开始辅导清华347应用心理,近年上岸率高达67%-88%,团队的讲师均来自清华大学,本硕博都有,覆盖考研体系中所有课程,我们是心理学领域唯一专业人工智能的团队。

2026考研中,水木上岸21位学员被录取(共29人),占总录取人数72.4%,前五名均为水木上岸学员。

2025考研中,水木上岸21位学员被录取(共录取 24人),占总录取人数88%,前五名均为水木上岸学员(包含总分第一和专业第一)。2024考研中,水木上岸学员录取率67%,其中包含专业第一。

人工智能作为现代科技的明珠,正以前所未有的速度改变人类的生产和生活方式。随着技术的不断进步和应用领域的日益拓展,AI 所引发的伦理道德问题也逐渐浮出水面,成为社会各界关注的焦点。这些问题不仅涉及个人隐私、数据安全、算法偏见与歧视等具体领域,还触及责任归属、失业、人机道德界限以及主体异化与 “数字鸿沟” 等更深层次的社会问题。

核心伦理问题剖析

数据隐私与安全

AI 系统依赖于大量数据进行训练和优化,这些数据往往包含个人隐私信息。然而,数据泄露和滥用的风险时刻威胁着个人隐私安全。一旦数据被不法分子获取,不仅可能导致个人隐私的曝光,还可能引发更严重的社会问题,如网络诈骗、身份盗窃等。因此,如何在利用数据提升 AI 性能的同时,保障个人隐私安全,成为一个亟待解决的难题。

算法偏见与歧视

由于数据标注、算法设计等因素,AI 系统可能在对某些群体的决策中表现出不公平性。这种偏见不仅可能导致社会资源的分配不公,还可能加剧社会不平等现象。例如,在招聘、信贷、教育等领域,如果 AI 系统存在歧视性决策,将严重影响个体的权益和社会的公平正义。

责任归属问题

随着 AI 系统自主性的增强,当 AI 系统出现错误或导致损害时,确定责任归属变得复杂而困难。这不仅可能引发法律纠纷和社会争议,还可能影响 AI 技术的推广和应用。例如,在自动驾驶汽车领域,一旦发生交通事故,责任应如何在制造商、软件开发者、车主等多方之间划分,是亟待解决的法律与伦理议题。

失业问题

随着 AI 在各行各业的应用增多,许多传统岗位将被自动化取代,导致大量劳动力面临失业风险。这不仅影响个人的生计和福利,还可能引发社会不稳定和贫困问题。

人机道德界限的模糊性

随着 AI 技术的不断进步,机器可能在某种程度上具备自主意识和情感。这引发了关于机器是否应具有权利和责任的讨论。如何界定人与机器之间的道德界限,确保机器的行为符合道德原则和社会价值观,成为一个亟待解决的深层伦理问题。

主体异化与 “数字鸿沟”

在人工智能阶段,机器人与人类的关系可能出现异化,甚至存在人工智能失控的风险。这可能导致机器预设的 “增进人类福祉” 的价值目标难以实现,甚至给人类社会带来巨大的灾难。同时,“数字鸿沟” 是指先进技术的成果不能被社会公众公平分享,出现 “富者越富,穷者越穷” 的现象。

解决策略与应对方向

为解决上述伦理问题,推动 AI 技术健康发展,需要政府、企业和社会各界的共同努力。

完善法律法规与规范

政府应制定严格的法规和政策,明确数据收集、存储和使用的规范与标准,确立数据加密和防护技术的研发方向,提升数据安全的整体水平。同时,针对责任归属、自动驾驶等特定领域,制定专门的法律来规范责任认定,明确制造商、软件开发者、车主等各方的责任和义务。

加强算法审查与优化

为了消除或减少算法偏见与歧视,需要在 AI 系统的开发和部署过程中,加强对算法的审查和评估。通过引入多元文化背景的数据集、优化算法设计等方式,确保 AI 系统的决策公平、公正。同时,加强跨学科的伦理研究,制定明确的伦理准则和政策框架,为 AI 技术的发展提供道德指引。

2026清华复试名单与所报水木上岸班型

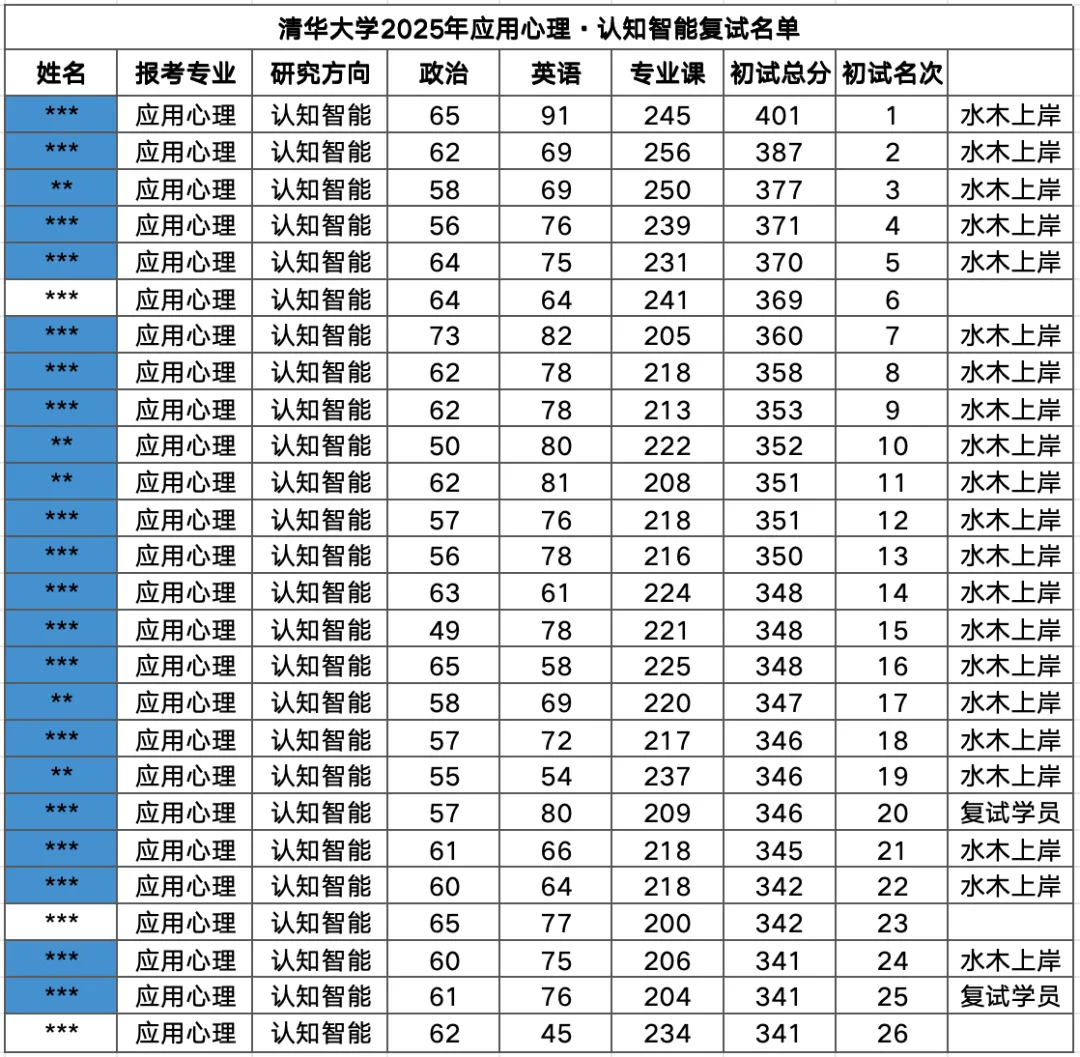

2025清华复试名单

往期精选

【26水木上岸40位学员进入清华复试】

【25上岸经验贴】

【清华录取通知书】

【26喜报】

公众号安利

水木上岸官方总号

由水木上岸学术团队打造的”智能心理测量”公众号,是心理学与人工智能深度交融的先锋平台。我们以”用算法解析心智,以科技赋能心灵”为使命,聚焦AI+心理学的跨学科创新,持续追踪全球顶尖实验室的科研动态,为读者搭建认知升级的智识桥梁。

水木上岸联合清华计算机系AI团队

推出了

心理学考研版 AI 助教

24 小时答疑

夜雨聆风

夜雨聆风