我给飞书AI助手装了个’仪表盘’,Token烧到哪一眼看清

用openclaw介入我的工作已经有一个多月了,干活越来越多,有的时候一干就是一整天,晚上一看AI费用账单,把人给吓傻了每轮庞大的上下文 再加上Agent的核心文件SOUL.md、USER.md、AGENTS.md等等这些文件,每轮的token多得恐怖!

现在用了自己部署的footer,看着context去到35%左右就压缩一次,token用量直线降低300%

今天,我就把这个好东西直接分享给大家了!

文末有一键部署教程领取方式!

一、先看对比:一行字 vs 一块表

如果你用OpenClaw把AI助手接进了飞书,默认的回复Footer长这样:

就一行。你知道它跑完了,但不知道烧了多少钱、用了什么模型、上下文是不是快炸了。像开着一辆没有仪表盘的车——油门踩着,转速多少、油量多少、水温高不高,全凭感觉。

🪙Token今/月: 1.4M丨203.7M · 04/28-15:40

✅已完成 · ⏳️6m 45s · deepseek-v4-pro

↑ 85.8k ↓ 3.3k · 缓存 42.9k/0 (33%) · 📑 44.2k/1.0M (4%) · 🚀首token 2.09s

(文末有一键部署领取方法)

这篇文章,我把这套配置的完整方案和思路一次性讲清楚。

二、为什么默认Footer不够?三个真实焦虑

焦虑1:月底账单像开盲盒

Kimi-K2.6的定价是输入6.5元/百万Token、输出27元/百万Token(moonshot官方定价,2025年4月)。一个带长上下文的复杂任务轻松烧掉几万Token。默认Footer不显示累计消耗,你只能月底登录平台看账单——那时候已经晚了。

焦虑2:模型切换了你都不知道

OpenClaw支持多模型+自动fallback。主模型额度用完,会自动切到备用模型。但默认Footer不显示模型名,你可能一直在跟DeepSeek对话,却以为自己还在用Kimi。

焦虑3:长对话时AI突然”失忆”

上下文窗口是有限的。Kimi-K2.6是256k,MiniMax-M2.7是200k。当历史对话越堆越多,接近上限时,早期的信息会被截断。默认Footer不显示上下文占用率,你只能在AI”答非所问”时才发现——它已经忘了你三分钟前说过什么。

简单说:默认Footer让AI助手成了一个黑盒。输入问题,输出答案,中间过程完全不可见。

三、效果解读:这些数字到底在说什么?

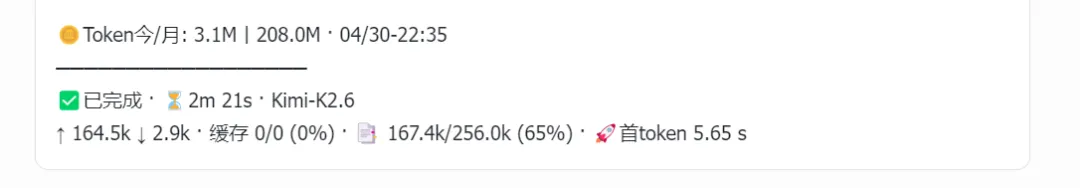

配置完成后,你会在每条AI回复下方看到类似这样的Footer:

🪙Token今/月: 1.4M丨203.7M · 04/28-15:40

✅已完成 · ⏳️6m 45s · deepseek-v4-flash

↑ 85.8k ↓ 3.3k · 缓存 42.9k/0 (33%) · 📑 44.2k/1.0M (4%) · 🚀首token 2.09s

– `203.7M` = 本月累计用了203.7万Token

– `✅已完成` = 任务正常结束(失败时显示❌,手动停止时显示⏹️)

– `deepseek-v4-flash` = 实际调用的模型

– `↑ 85.8k` = 输入85,800 Token(你的prompt+上下文)

– `↓ 3.3k` = 输出3,300 Token(AI的回复)

– `缓存 42.9k/0 (33%)` = 缓存写入42.9k、缓存读取0、命中率33%

– `📑 44.2k/1.0M (4%)` = 上下文已用44.2k / 上限1.0M / 占比4%

– `🚀首token 2.09s` = 从发请求到收到第一个字,等了2.09秒

四、实战案例:这些数字帮我省了什么?

案例1:发现prompt冗余

有一次我看到一条任务的Footer:`↑ 52.0k ↓ 120`。输入5万多Token,输出只有120 Token。一看上下文占用已经到了60%——历史对话里塞了一堆之前的文件内容。`/reset`重置会话后,同样的任务变成了`↑ 3.2k ↓ 150`,输入直接少了93%。

结论:上下文膨胀是隐形杀手,Footer让你早发现、早处理。

案例2:定位模型卡顿

某天我发现`🚀首token`从平时的1.5秒突然飙到了12秒。Footer显示模型还是Kimi-K2.6,但响应异常慢。查了一下,发现是上游API的某个节点在维护,OpenClaw自动fallback到了备用节点——但模型名没变,只是延迟变了。如果没有首Token指标,我可能会以为是自己的网络问题,排查半天。

结论:首Token时间是网络/模型健康的”脉搏”。

案例3:缓存优化验证

我在做日报生成的模板prompt,同样的结构每天重复。优化前缓存命中率一直是0%,Footer:`缓存 0/0 (0%)`。后来调整了prompt结构,把固定部分前置、变量部分后置,第二次调用时Footer变成了`缓存 1/1 (100%)`——命中了。

结论:没有缓存指标,你优化了半天也不知道有没有生效。

五、写在最后

AI助手不是魔法,它是一连串Token计算+网络传输+模型推理的组合。默认的”黑盒”模式让这一切不可见,而这个Footer配置就是把透明度还给了使用者。

每一条消息底部的数字,是AI服务真实消耗的记录,是运维排查问题的线索,是成本分析的起点。是让AI服务从”黑盒”变成”可观测”的第一步。

花3分钟改个配置,换回来的是对整个AI工作流的可观测性。值不值,你自己判断。

配置改完、网关重启后,给我发条消息,告诉我你的Footer长什么样——我很好奇大家的Token都烧到哪去了。

关注本公众号之后回复:部署文档 即可获取最新部署文档!

回复prompt 则直接获取agent 一键部署prompt,复制即用!

夜雨聆风

夜雨聆风