Mac才是个人AI的终极答案

两台Mac,隔着一个AI时代

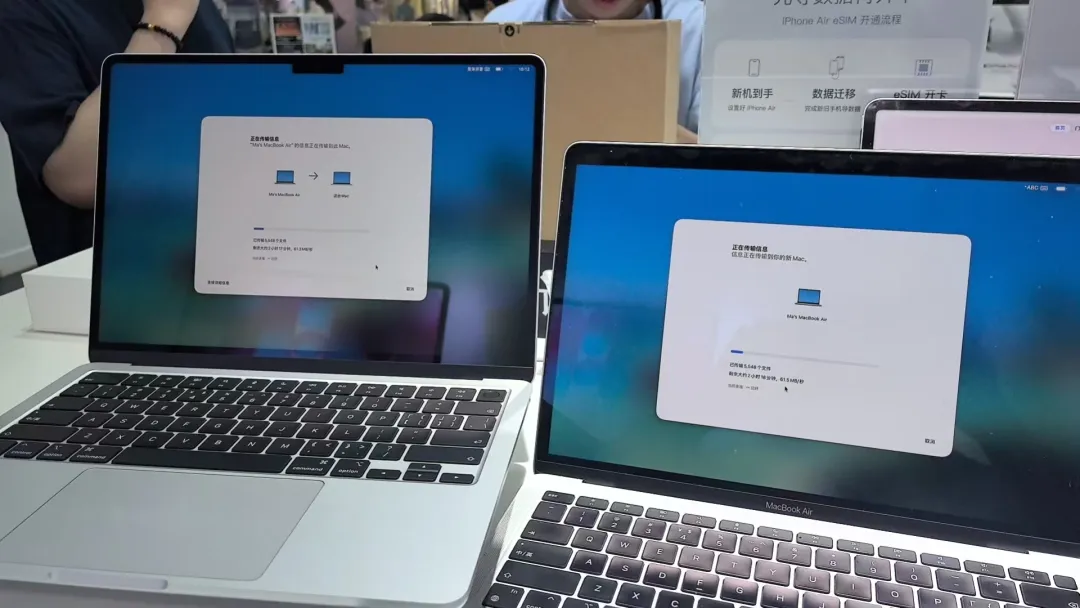

今年换机,两台 MacBook Air 面对面,迁移助手显示”5,548个文件,剩余约2小时18分钟”。

那一瞬间我突然意识到:这不止是一次换机。旧 Mac 上的每一个文件、每一段聊天记录、每一次调研笔记,正在被完整地交接到新 Mac 上。而新 Mac 要做的事,旧的那台做不到——跑我完整的 AI 工作流。

三年前,我用的是 8GB M1。现在这台是 M5,24GB。

回头再看,这个升级不是”更好用”,而是”能用和不能用的区别”。

M5 的硬件底牌

先看一组数字。我这台 MacBook Air 的配置:M5 芯片,24GB 统一内存。

Apple Silicon 最被低估的东西,是它的统一内存架构。

传统 PC 的 CPU 和 GPU 各有各的显存。中间靠 PCIe 通道连着,带宽 32GB/s。跑大模型的时候,70B 参数塞不进 24GB 显存,数据就得在 CPU 和 GPU 之间来回搬,性能塌方。

M 系列芯片不一样。CPU、GPU、Neural Engine 全部挂在同一块内存池上。M4 Max 的带宽做到 546GB/s——比传统 PCIe 高了 17 倍。

实际意义是什么?一台 64GB 的 M3 Max MacBook Pro,用 MLX 加载 Q4 量化的 70B 模型,稳定跑 8-12 token/s。同等价位的 PC 方案,你连模型都加载不进去。

还有 Neural Engine。M4 上做到 38 TOPS。我把 Whisper 语音识别部署到 Neural Engine 上,转录速度比纯 GPU 方案快 30%。语音备忘、实时翻译、口述初稿——完全不联网,本地跑。

8GB 是个骗局

说一句得罪厂商的话:8GB 内存的 Mac,在 AI 时代是个残血版。

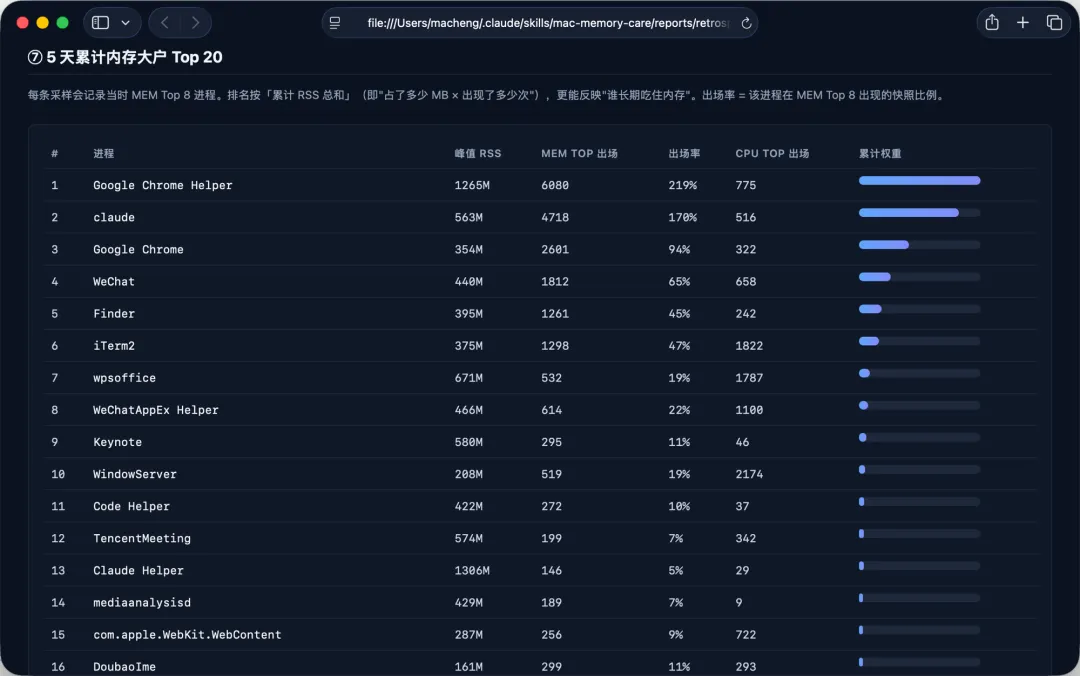

我跑了 5 天的内存监控,采样了全部进程的实时内存占用。结果一看,触目惊心。

光是日常 AI 工作流——Claude Code、Chrome、微信、WPS、iTerm2——这几个进程加起来,峰值 RSS 就超过 12GB。

Claude 的 Helper 进程,单进程吃 1.3GB。Google Chrome Helper 更猛,累计权重冲到 6000+,峰值 RSS 1.2GB。微信 440MB,WPS 671MB,Finder 395MB。这还不算 WindowServer、mediaanalysisd 这些系统进程。

8GB 内存跑这套,swap 直接打满,卡到怀疑人生。

24GB 是基准线。如果跑本地大模型,64GB 起步。这不是”买好一点”的问题,是能不能正常干活的问题。

离线 AI,真正的隐私

Mac 上还有一个很少被提到的能力:断网也能跑 AI。

macOS 自带 Vision 框架——OCR 文字提取、场景分类、人脸检测,全部本地执行。Whisper 语音识别通过 Core ML 部署到 Neural Engine,不需要任何网络请求。

应用场景是什么?飞机上口述一段产品思路,本地转写,交给本地小模型做结构化整理,落成初稿。全程数据不出这台电脑。

在 AI 隐私焦虑越来越重的当下,能说”你的数据没上传过任何地方”,本身就是一种竞争力。

macOS 的 AI 基因,Windows 学不会

macOS 有一套 Accessibility API(AXUIElement)。它能把任意应用的 UI 元素树完整暴露出来——按钮位置、输入框内容、菜单层级。

对 AI agent 来说,这意味着不需要靠截图”猜”界面。直接读结构化的 UI 描述,精确点击、输入、导航。

我现在的日常:AI 操作浏览器做功能验证,自动截图,再用本地 Vision 框架判断 UI 还原是否合格,最后给我一个通过/不通过的结论。从打开浏览器到出报告,全程不碰鼠标。

Anthropic 今年的 Claude Code Computer Use 能力,本质就是把这套逻辑产品化。而这些能力目前只在 macOS 上能完整跑通。

Windows 这边,底层指令集对 AI 的直接操控不友好。同样一个自动化操作,macOS 上原生支持,Windows 上需要额外的中间层,甚至根本做不了。不是性能差距,是架构差距。

服务器做不到的事

企业级 AI 架在服务器上,处理标准化任务。但个人的工作流是高度非标的。

一个项目里:调研资料在浏览器书签,需求文档在飞书聊天,竞品分析在本地 Markdown,参考代码在 GitHub,还有随手记的语音备忘。

这些东西分布在不同的应用、格式和时间线上。在服务器上,你不可能把这些异构信息全喂给 AI。

但在自己的 Mac 上,你可以。

我把这些全部丢给 Claude Code,它能在我的 Mac 上横跨信息源,最终产出一个完整方案。这个过程中,AI 不是”写手”,是一个能访问我全部工作上下文的协作者。

服务器上的 AI 不认识你的文件系统,看不到你的聊天记录,不知道你上周在做什么。它只是工具,不是搭档。

我的日常 AI 工作流

目前我的技术栈:Claude Code 做主调度引擎,DeepSeek v4 做 API 后端,Mac 本地跑语音和图像识别。

安装豆包语音输入法,全程语音控制。”动嘴不动手”不是口号,是日常。

调研阶段,AI 去搜索、抓取、整合。开发阶段,AI 写代码、跑测试、截图验证 UI。交付阶段,AI 整合产物成文档和 PPT,通过飞书推到手机上。

不需要企业级基础设施。一台高配 MacBook Pro,一个 Claude Code 账号,足够了。

最后

如果你正考虑升级个人 AI 工作环境,我的建议很简单:

换一台高配 Apple Silicon Mac。M3 Max 64GB 以上,或者等 M5 高配。8GB 的 M1 该退休了。

Windows 以后会不会赶上?有可能。但在当下,Mac 就是个人 AI 的终极答案。

这不止是硬件参数的胜利,更是系统设计哲学的胜利。一个平台在设计之初就为 AI 准备好了接口、算力和内存架构,你用的时间越长,越会发现那些隐藏的能力点,像是提前预留好,等着你发现。

官方网站:https://claude.ai

Claude Code 文档:https://code.claude.com/docs

夜雨聆风

夜雨聆风