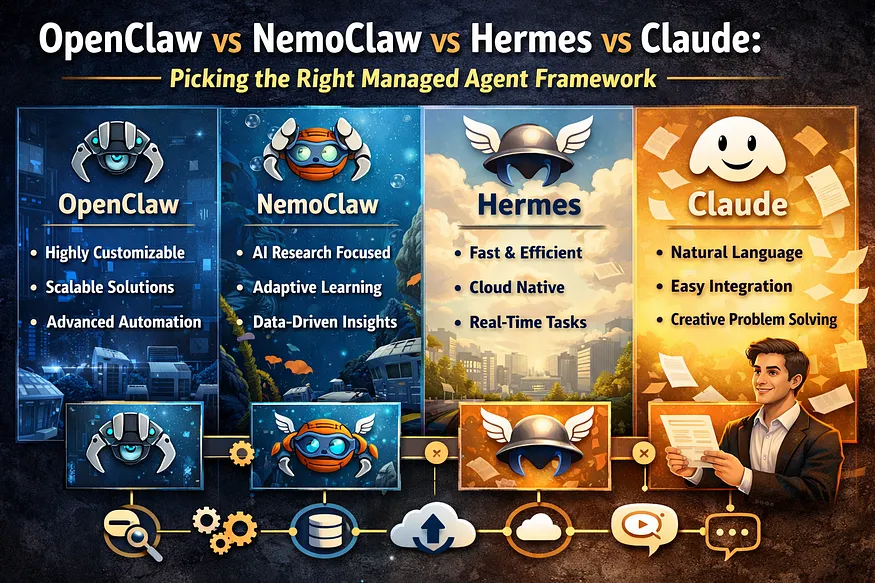

选择合适的AI代理框架:OpenClaw、NemoClaw、Hermes 和 Claude

对 OpenClaw、NemoClaw、Hermes 和 Claude 的托管代理进行实际比较——涵盖架构、工具、故障模式以及每种代理最擅长处理的工作负载。 OpenClaw、NemoClaw、Hermes 和 Claude:选择合适的托管代理框架 基于代理的流水线正越来越多地应用于数据提取、代码生成和多步骤分析工作流。实际上,OpenClaw、NemoClaw、Hermes 和 Anthropic 的托管 Claude 代理等框架在实际工作负载中都能表现良好,但它们在控制性、可靠性、调试体验和运维适应性方面存在显著差异。 这并非简单的功能对比。更重要的差异体现在这些系统的故障方式、它们对执行循环的控制程度、它们的易观察性和调试性,以及每个框架在生产环境中最具价值的方面。 在直接比较它们之前,有必要先明确一下这里“托管代理”的含义。该术语指的是为工具调用代理提供预设运行时环境的框架,它可以处理诸如以下循环:模型推理、选择工具、执行工具、接收结果,并根据需要重复此过程。“托管”意味着框架会负责重试逻辑、内存管理、上下文管理,有时还会负责模型选择等方面的决策。 这四种方法都在这个大范围内运作,但它们在架构、灵活性、安全性和操作复杂性方面做出了截然不同的权衡。 在四款工具中,OpenClaw 对开发者而言最为透明。其核心理念在于开发者对执行循环的控制。它提供了工具注册、上下文线程和步骤回调等基本功能,而将执行图的构建很大程度上留给了用户。 OpenClaw 的一大优势在于其可观测性。每个代理步骤都可以添加自定义日志和遥测功能,这使其对需要深入了解运行时行为的团队极具吸引力。工具注册简单明了,使得该框架易于理解和扩展。 from openclaw import Agent, tool @tool( description= “对仓库运行 SQL 查询” ) def run_sql ( query: str ) -> str : result = warehouse_client.execute(query) return result.to_csv() agent = Agent(model= “gpt-4o” , tools=[run_sql]) response = agent.run( “上周发货了多少订单?” ) 简单明了。回调钩子意味着您可以将遥测数据精确地放置在需要的地方。 问题在于?OpenClaw 对代理程序运行异常几乎无能为力。它没有内置的无限循环断路器。在一个流程中,模型不断地使用略有不同的过滤器重复查询相同的数据,在添加了自定义循环检测之前,连续 20 次迭代都消耗了大量令牌。这本应是基本功能,不应该成为用户自行解决的问题。 最适合:希望实现完全可观测性且不介意自行构建安全防护措施的团队。非常适合概念验证工作,或当您有关于日志记录的特定合规性要求时。 NemoClaw 源自 NVIDIA 生态系统,这一点显而易见。它的设计以推理效率和模型并行执行为核心。如果您在 GPU 集群上自行托管大型模型——例如在您自己的基础设施上运行 Llama 3.1 70B 或 Mixtral——NemoClaw 与 TensorRT-LLM 和 Triton 的集成,让您无需离开 NVIDIA 技术栈即可实现代理编排。 这里的代理运行时环境比 OpenClaw 更具个性化。内存管理通过可插拔的后端实现(开箱即用支持 Redis 和内存存储),并且内置了“代理配置文件”的概念,允许用户对代理状态进行快照和恢复。对于需要在工作流程中途进行检查点操作的长时间运行的数据管道代理来说,最后一点尤为实用。 # agent_profile.yaml name: etl_agent model: meta/llama-3.1-70b-instruct memory: backend: redis ttl_seconds: 3600 tools: – name: run_sql endpoint: http://tool-server:8080/sql – name: write_to_s3 endpoint: http://tool-server:8080/s3 max_iterations: 15 默认情况下会设置迭代次数上限。仅此一项就有助于避免 OpenClaw 中常见的循环问题。 NemoClaw 的不足之处在于:工具生态系统较小,文档假定用户已经深入了解 NVIDIA/NeMo 生态系统,而且 Python SDK 在错误传播方面存在一些缺陷——来自工具服务器的异常有时会被吞入一个上下文信息ToolExecutionError极少的通用异常中。在生产环境中调试这类问题非常棘手。 最适合:在 GPU 基础设施上进行自托管的团队,特别是如果您已经使用 NeMo 或 Triton 进行推理。 Hermes 采用了完全不同的方法。它在路由层与模型无关——你将代理定义为可组合的单元,Hermes 会根据你定义的成本、延迟和能力配置来决定为哪个任务调用哪个模型。你可以把它想象成一个元编排器。 这对于数据平台工作来说非常强大。在一个流程中,低成本、快速的调用(数据验证、简单转换)被路由到一个较小的模型,而复杂的推理步骤(从混乱的 CSV 文件中推断模式、生成 DBT 模型)则被发送到 GPT-4o 或 Claude。Hermes 透明地处理了这种路由: from hermes import Pipeline, AgentStep pipeline = Pipeline() pipeline.add_step(AgentStep( name= “validate_schema” , task_type= “classification” , # 路由到快速/低成本模型 tools=[validate_schema_tool] )) pipeline.add_step(AgentStep( name= “generate_dbt_model” , task_type= “complex_reasoning” , # 路由到功能强大的模型 tools=[read_schema_tool, write_file_tool] )) result = pipeline.run(input_data) 成本节省是实实在在的——与全部通过 GPT-4o 处理相比,大批量管道的成本降低了约 40%。 但问题在于:Hermes 的抽象层存在一些令人恼火的漏洞。当路由做出错误决策时——这种情况确实会发生,尤其是在处理模糊的任务类型时——故障很难追踪,因为实际的模型调用被隔离了一层。虽然其可观测性工具尚可,但并不出色。在实践中,这意味着可能需要添加大量自定义中间件才能获得所需的可见性。 此外,多代理协调机制(步骤间传递上下文、处理管道中途故障)所需的配置比预期要多。用于复杂管道的 YAML DSL 很快就会变得难以管理。 最适合:注重成本、运行高容量代理工作流程且涉及多种模型层的团队。尤其适用于分析流程,其中大部分步骤都是常规的,但少数步骤需要复杂的推理。 Anthropic 的托管代理方案是四款方案中最新的,也是功能最齐全的。它包含计算机操作、工具调用以及完善的代理循环文档——所有这些都得益于 Claude 强大的指令执行能力,以及它在何时不调用工具方面表现出的显著优势。 最引人注目的是:Claude 作为智能体,在工具使用方面确实比 GPT-4o 更加谨慎。它会提出澄清性问题,而不是胡乱猜测;它更擅长说“我没有足够的信息来安全地执行此操作”,而不是凭空臆造出一个工具调用。对于涉及生产数据的工作流程来说,这一点至关重要。 托管式 API 可自动处理上下文窗口管理——较旧的消息会被汇总而不是截断,从而保持长时间代理运行的连贯性。否则,团队就必须自行构建此功能。 import anthropic client = anthropic.Anthropic() tools = [{ “name” : “query_database” , “description” : “执行只读 SQL 查询” , “input_schema” : { “type” : “object” , “properties” : { “query” : { “type” : “string” , “description” : “要执行的 SQL 查询” } }, “required” : [ “query” ] } }] response = client.messages.create( model= “claude-opus-4-5” , max_tokens=4096, tools=tools, messages=[{ “role” : “user” , “content” : “按地区汇总上月收入” }] ) 不过,这些局限性确实存在。Anthropic 的托管代理与 Anthropic 的模型绑定——对于简单的步骤,无法路由到更便宜的模型。在高容量工作流程中,成本会迅速累积。而且,其自定义选项比 OpenClaw 或 Hermes 少;如果需要对代理循环进行细粒度控制,通常需要绕过托管层,而不能直接使用。 批处理作业的速率限制也可能比预期更早出现。在限流开始之前,托管层无法提供关于这些限制的具体信息。 最适合:优先考虑可靠性和安全性而非成本优化的团队,或者希望快速实现某些功能而无需构建代理基础设施的团队。

如果需要最大程度的可观测性,并且团队能够掌控安全防护措施, 则可以使用 OpenClaw。它非常适合受监管的环境,在这些环境中,每一步操作的审计跟踪都至关重要。

如果满足以下条件,请使用 NemoClaw: 技术栈托管在 GPU 基础设施上,并且已与 NVIDIA 生态系统兼容。仅凭其检查点/恢复功能,就足以使其成为长时间运行工作流程的理想选择。

如果存在以下情况,请使用 Hermes: 数据量大、复杂度混合的管道,并且需要优化各模型层级的成本。选择 Hermes 通常意味着需要额外投资于可观测性工具。

如果以下情况发生,请使用 Claude 管理的代理: 推理质量和安全的工具使用行为比成本更重要,或者需要在不构建代理基础架构的情况下快速交付。

更广泛的一点是:这些工具都不像 Airflow 或 dbt 那样成熟。极端情况肯定会出现。真正的问题在于,这些极端情况是在框架层面处理更好(因为框架层面可以贡献修复程序),还是在 API 层面处理更好(因为 API 层面通常需要提交支持工单)。这既是一个技术问题,也是一个团队能力问题。 Hermes 中与模型无关的路由方法似乎是整个生态系统的发展方向。随着不同提供商的模型质量趋于一致,路由层的成本和延迟优化将成为真正的关键。能够解决可观测性问题并实现智能路由的框架很可能赢得大多数企业工作负载的青睐。

夜雨聆风

夜雨聆风