端侧 RAG:让你的 App 拥有离线智能的记忆

对于我们应用开发者而言,大语言模型(LLM)早已不是什么新鲜事物。无论是构建一个能理解用户自然语言指令的智能助理,还是打造一个能提供千人千面内容推荐的信息流,云端 LLM 的强大能力已经一次次地证明了自己。

但一个新的问题也随之而来:当 AI 需要理解和处理那些高度私密、只存在于用户设备上的数据时——比如你的聊天记录、家庭相册、个人日记、或是内部 CRM 里的客户笔记——我们该怎么办?

将这些数据全部上传到云端,不仅会引发用户对隐私的强烈担忧,还意味着应用的核心智能将彻底依赖于网络连接。一旦离线,一切都会瘫痪。这正是“端侧 RAG”(On-Device RAG)试图解决的核心痛点。它旨在为你的 App 安装一个本地的、无需联网的“记忆系统”,让 AI 既能保护用户隐私,又能随时随地提供个性化、上下文感知的智能服务。

LLM 的“记忆”难题与 RAG 的破局之道

要让 LLM “知道”它本身训练语料之外的知识,我们通常会想到几种方法。

一种是简单粗暴地将所有相关信息直接塞进 Prompt。比如,为了让 AI 回答“我上周接触过的潜在客户有哪些”,你把本地 CRM 数据库里几百个联系人的信息一股脑儿全喂给它。这种方法的弊端显而易见:

-

上下文长度限制:端侧模型的上下文窗口(Context Window)通常不大(例如 8K-32K token),海量数据根本塞不下。 -

性能与功耗灾难:更长的上下文意味着更慢的响应速度和更高的功耗,对于移动设备来说这是不可接受的。 -

信噪比过低:LLM 很容易在冗长的上下文中“迷失”,忽略掉那些真正关键的信息。

另一种是微调(Fine-tuning)模型。听起来很美,让模型把私有知识“学”进去。但这更适合静态知识。对于像联系人、聊天记录这样每天都在变化的动态数据,难道我们每天都为每个用户重新训练一次模型吗?这在工程上和成本上都是不切实际的。

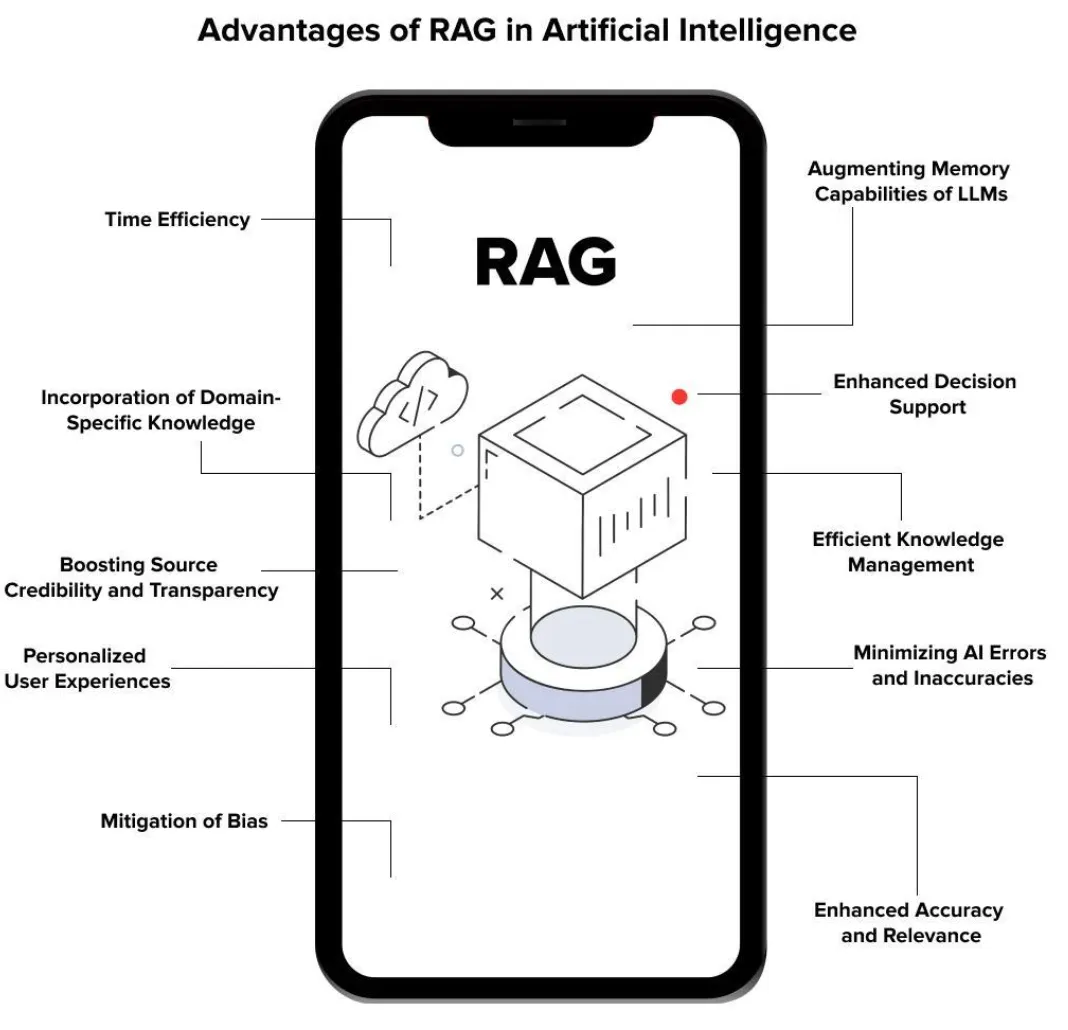

于是,检索增强生成(Retrieval-Augmented Generation, RAG) 登上了舞台。它的思路非常直观:不要给模型全部,只给它相关。

当用户提问时,我们不再将整个知识库抛给 LLM,而是先通过一个“检索”步骤,从本地数据库中精准地找出与问题最相关的几条信息,然后将这几条信息连同用户的问题一起,组合成一个简洁、高效的 Prompt 交给 LLM 进行“生成”。

这个过程就像一个开卷考试的高手,他不会试图背下整本书,而是在拿到问题后,迅速翻书找到最相关的章节,然后基于这些信息组织出答案。

RAG 的优势在于:

-

知识永远新鲜:数据在查询时实时检索,保证了信息的时效性。 -

可扩展性强:无论本地知识库有多大,每次处理的都只是少数相关片段,模型本身无需改变。 -

上下文更聚焦:LLM 只会看到它完成任务所需的最少信息,避免了信息过载和干扰。

最激动人心的是,从检索到生成的整个 RAG 流程,完全可以在用户的设备上闭环完成。这就是我们今天要深入探讨的——端侧 RAG 的工程实践。

端侧 RAG 的工程蓝图:从嵌入到检索

实现一个完整的端侧 RAG 系统,本质上是构建一条数据处理流水线:原始数据 -> 文本分块 -> 向量嵌入 -> 索引存储 -> 语义检索 -> 结果生成。接下来,我们将从工程视角,一步步拆解其中的关键环节。

第一站:知识的数字化表达 —— Embedding

RAG 的第一步,是让机器理解文本的“语义”。我们不能指望机器像人一样阅读文字,但我们可以将文字转换成一种机器擅长处理的格式——向量(Vector)。这个转换过程,就是嵌入(Embedding)。

一个 Embedding 模型,能将一段文本(一个词、一句话、一个段落)映射到一个高维向量空间中的一个点。在这个空间里,语义相近的文本,它们的向量在空间中的距离也更近。

-

"企业级销售主管"→[0.12, -0.45, 0.78, ...] -

"大公司业务负责人"→[0.11, -0.44, 0.77, ...](向量非常相似) -

"香蕉奶昔的做法"→[0.89, 0.12, -0.34, ...](向量截然不同)

模型选择的权衡

在端侧,我们无法像在云端那样动辄使用数十亿参数的庞大模型。模型的大小、速度和精度之间存在着永恒的权衡。

|

|

|

|

|

|

|---|---|---|---|---|

| 高精度模型

|

|

|

|

|

| 轻量级模型

|

|

|

|

|

作为开发者,你需要根据你的具体业务场景来做出选择。一个好的实践是,将模型选择作为可配置项,允许在应用的不同阶段(甚至针对不同性能的设备)采用不同的模型。

此外,模型量化是端侧部署的必备工序。通过将模型参数从 32 位浮点数(FP32)转换为 16 位浮点数(FP16)甚至是 8 位整数(INT8),可以在牺牲极少精度的情况下,大幅压缩模型体积(通常能减少 50%-75%),并显著提升推理速度。

第二站:知识的高效安放 —— 端侧向量索引

当我们把所有私有数据(例如,上千条聊天记录)都转换成向量之后,接下来的问题是:当用户提问时,如何快速地从这上千个向量里,找到与问题向量最“近”的那几个?

最朴素的方法是暴力搜索(Brute-force):计算问题向量与数据库中每一个向量的余弦相似度,然后排序取 Top-K。在数据量很小(比如几百条)时,这确实可行。但当数据量增长到成千上万,每次查询都进行数万次计算,延迟将变得无法忍受。

我们需要更聪明的方法,这就是近似最近邻(Approximate Nearest Neighbor, ANN) 搜索算法大显身手的地方。其中,HNSW(Hierarchical Navigable Small World) 是目前业界最主流、最高效的算法之一。

你可以把 HNSW 想象成一个精心设计的多层级城市交通网络:

-

顶层网络是“高速公路”,只连接几个相距很远的核心枢纽。 -

中间层网络是“城市主干道”,连接各个区域的中心。 -

底层网络是“胡同小巷”,密集地连接着每一个具体地址。

当你想从城市的一端到另一端时,你会先上高速(顶层),快速跨越大部分距离,然后下到主干道(中层),最后进入小巷(底层)找到精确的目的地。HNSW 的搜索过程与此类似,它从稀疏的顶层图开始,快速定位到目标向量所在的区域,然后逐层向下,最终在稠密的底层图中进行精确查找。这使得其搜索效率从暴力搜索的 O(n) 奇迹般地提升到了 O(log n)。

技术选型与实现

在端侧实现向量索引,我们有几种选择:

-

功能完备的端侧数据库:像 ObjectBox 这样的产品,从设计之初就为移动和物联网而生,内置了基于 HNSW 的向量搜索功能,并且提供了对 Flutter、Kotlin、Swift 等主流移动开发语言的良好支持。 -

“零依赖”的 SQLite 方案:对于不想引入额外数据库依赖的 App 来说,这是一个极具吸引力的选项。几乎所有移动平台都内置了 SQLite。我们可以利用它来存储向量数据(通常存为 BLOB类型),并自行实现或集成一个轻量级的 HNSW 索引库。例如,在 Android 上使用SQLiteOpenHelper,在 iOS 上直接调用sqlite3C API,在 Web 端借助wa-sqlite(一个 SQLite 的 WebAssembly 移植版)。

无论选择哪种方案,索引的构建和使用都需要关注几个核心工程问题:

-

内存占用:HNSW 索引本身需要消耗相当可观的内存。索引的参数,如 M(每个节点的最大连接数)和ef_construction(构建时搜索的候选节点数),直接影响内存占用和索引质量。你需要在这两者之间找到平衡。 -

构建时间:在用户的设备上构建索引是一个计算密集型任务,尤其是在首次启动、需要处理大量历史数据时。 -

数据一致性:向量索引库本质上是主数据源的一个“缓存”或“衍生品”。如何保证它与主数据(如 App 的业务数据库)保持同步,是一个必须解决的工程问题。

第三站:工程落地中的“脏活累活”

理论总是优雅的,但工程实践中充满了琐碎而关键的细节。一个稳定、高效的端侧 RAG 系统,需要我们像对待 App 的其他任何核心功能一样,细致地处理各种边界情况。

1. 数据预处理与分块(Chunking)

在将数据喂给 Embedding 模型之前,我们需要将其切分成合适的“块”(Chunk)。这直接决定了检索结果的粒度和上下文的完整性。

-

对于结构化数据:比如联系人、商品信息,天然的单元(一条联系人记录、一个商品 SKU)就是最好的 Chunk。 -

对于非结构化长文本:比如一篇长文章、一段会议录音转写的文字稿,分块策略就至关重要。 -

固定大小分块:最简单,但容易在句子或段落中间硬生生切断,导致语义不完整。 -

按文档结构分块:更优的选择,例如按段落、章节来切分。 -

语义分块:更高级的策略,利用 NLP 技术找到文本中的语义边界,但这在端侧可能计算成本过高。

一个非常实用的技巧是块间重叠(Overlap)。比如,设定每个 Chunk 为 512 个 token,同时让相邻的两个 Chunk 之间有 50 个 token 的重叠部分。这就像在拼接照片时保留一小部分公共区域,可以有效避免因切分而丢失处于边界位置的关键信息。

2. 冷启动与增量更新

用户的设备上可能已经积累了大量的历史数据。如何处理这些数据,是端侧 RAG 系统必须面对的第一个挑战。

-

冷启动(首次索引):当用户首次安装或启用 RAG 功能时,App 需要对所有存量数据进行一次性的 Embedding 计算和索引构建。这是一个非常耗时且消耗资源的过程。明智的做法是:

-

后台执行:将这个过程放在一个低优先级的后台任务中。 -

择机执行:最好只在设备充电且连接 Wi-Fi 时才启动大规模的索引构建。 -

给予明确反馈:在 UI 上告知用户“正在为您准备智能服务,可能需要一些时间”,避免用户因 App 卡顿或耗电而困惑。 -

增量更新:一旦初始索引构建完成,我们就进入了“维护模式”。系统需要监听主数据源的变化,并实时地同步到向量索引中。

-

创建:新增一条聊天记录 -> 计算其 Embedding -> 添加到 HNSW 索引中。 -

更新:修改一个联系人的备注 -> 重新计算 Embedding -> 在索引中更新(通常是先删除旧的,再插入新的)。 -

删除:删除一封邮件 -> 从索引中移除对应的向量。

这个同步机制的健壮性,直接决定了 RAG 系统能否提供准确、无延迟的检索结果。

3. 功耗与内存的精细化管理

移动设备的资源是极其宝贵的。一个表现优异的端侧 AI 功能,绝不能以牺牲用户的基础体验为代价。

-

计算任务调度:Embedding 计算和索引更新都应该被视为可延迟的后台任务。避免在用户正在与 App 交互时抢占 CPU 资源。 -

内存映射(Memory Mapping):对于大型索引文件,可以考虑使用内存映射( mmap)技术。它允许操作系统将文件内容直接映射到进程的虚拟地址空间,从而实现按需加载,避免一次性将整个索引读入内存,这对于管理内存峰值至关重要。 -

索引的加载与卸载:当 App 退到后台且长时间未使用时,可以考虑卸载 HNSW 索引以释放内存。当用户再次返回时,再通过内存映射快速恢复。

将端侧 RAG 融入 App,需要开发者具备一种“资源管家”的心态,时刻对计算、内存和电量保持敏感。

超越简单的向量检索:当“语义”不够用时

纯粹的语义搜索非常强大,它能理解“找找我那些大客户的联系方式”可能等同于检索笔记中包含“财富 500 强”、“重要合作”、“大单”等词语的联系人。

但它也有明显的短板。试试问它:“我昨天跟谁聊过来着?”

“昨天”这个词的 Embedding 向量,捕捉的是一个模糊的时间概念,与“最近”、“过去”相似。但你的聊天记录里存储的是具体的日期,比如 2026-03-31。在向量空间中,“昨天”和 2026-03-31 的向量可能相距甚远。语义搜索在此失效了。

同样,对于“查找所有未分配销售的潜在客户”、“所有在A公司的联系人,按最后联系时间排序”这类包含精确筛选、排序、聚合等逻辑的查询,单纯的向量相似度计算也无能为力。

怎么办?我们需要将“语义”和“逻辑”结合起来。

混合搜索:向量检索 + 结构化查询

这里的核心思想是,让合适的技术做合适的事。我们将用户的自然语言查询,拆解成两部分:

-

语义部分:需要理解深层含义的模糊描述,如“感兴趣的客户”、“重要的会议”。 -

逻辑部分:精确的、结构化的筛选条件,如 公司="A公司",状态="潜在客户",日期 > "2026-01-01"。

查询流程演变为:

-

首先,执行结构化查询,从数据库中筛选出满足所有逻辑条件的记录子集。 -

然后,在这个子集内部,再执行向量检索,根据语义部分找到最相关的结果。

或者反过来,先进行向量检索,得到一个候选集,再对这个候选集应用结构化过滤器进行精确筛选。

Agentic RAG:让 LLM 成为查询的“指挥官”

混合搜索虽然有效,但它要求我们(开发者)提前预判并编写解析用户查询的逻辑。一个更优雅、更智能的方案是,把这个“指挥”工作交给一个专门的 LLM Agent。

这个流程被称为 Agentic RAG,是目前 RAG 领域最前沿的探索方向:

-

意图理解:用户发出查询,例如“帮我找一下去年Q4接触过的,对我们企业版套餐感兴趣的北京客户”。

-

查询规划 (Query Planning):我们不再直接用这个查询去检索。而是先将它交给一个具备函数调用(Function Calling)能力的、轻量的端侧 LLM(例如 FunctionGemma)。这个 LLM 的任务不是回答问题,而是解析这个自然语言查询,并将其转换为一个结构化的函数调用指令。

它可能会输出类似这样的结果:

{

"function_name": "searchContacts",

"parameters": {

"semantic_query": "对企业版套餐感兴趣",

"company_location": "北京",

"start_date": "2025-10-01",

"end_date": "2025-12-31"

}

} -

工具执行 (Tool Execution):App 的本地代码接收到这个指令后,调用名为

searchContacts的本地函数,并传入解析好的参数。这个函数内部实现了我们前面提到的混合搜索逻辑。 -

结果增强与生成:

searchContacts函数返回最终的联系人列表。我们将这个列表作为上下文,连同用户的原始问题,一起交给另一个(或同一个)LLM,让它以自然、友好的语言生成最终的回答。

在这个模式下,LLM 扮演了“大脑”和“指挥官”的角色,负责理解复杂意图、进行逻辑推理(比如计算出“去年Q4”的具体日期范围);而你的 App 代码则扮演了“手脚”的角色,负责执行精确的数据查询操作。各司其职,完美协作。

评估、挑战与展望

一个端侧 RAG 系统上线后,我们如何评估它的好坏?除了常规的性能指标(延迟、功耗、内存占用),更重要的是检索质量。我们可以关注:

-

召回率(Recall):相关的文档,有多少被我们成功召回了? -

准确率(Precision):召回的文档里,有多少是真正相关的?

在实践中,这往往需要人工构建一个评测集,通过主观打分来持续追踪和优化。

展望未来,端侧 RAG 依然面临诸多挑战与机遇:模型需要更小更快、索引算法需要更节省内存、整个流程需要与操作系统(如 iOS 的 Core Spotlight)进行更深度的整合。但无论如何,它已经为我们打开了一扇通往真正“个性化 AI”的大门。

结语

将 RAG 从云端搬到设备端,不仅仅是一次技术上的平移,它更是一场关于产品理念的变革。它让我们有机会在充分尊重用户隐私的前提下,打造出真正懂用户、有记忆、有温度的智能应用。

这个过程充满了工程挑战,从模型量化到索引调优,从增量同步到功耗管理,每一步都需要我们开发者投入心血去打磨。但其回报也是巨大的——一个离线的、低延迟的、高私密性的 AI 体验,将成为未来优秀应用的护城河。希望这篇从工程视角出发的梳理,能为你探索端侧 RAG 之路,提供一份有价值的地图。

— END —

推荐阅读

夜雨聆风

夜雨聆风