AI小白入门 Day 8/10

《AI的”翻车”现场——局限性与伦理挑战》

嘿,我是你们的AI科普搭子!

前七天咱们把AI夸上了天——能聊天、能画画、能写歌、能编程,简直万能。但今天,我得泼盆冷水:

AI不是神,它会翻车,而且翻得比你想象的更离谱。

作为一个负责任的AI科普博主,今天咱们专门聊AI的局限性、风险和伦理挑战。看完这期,你会成为一个清醒的AI使用者,而不是盲目崇拜的”AI韭菜”。🧊

😵 一、AI幻觉:一本正经地胡说八道

“幻觉”(Hallucination)是AI界最臭名昭著的bug——生成看起来合理但实际错误的内容,而且语气非常肯定。

经典翻车案例

事件 详情 后果

律师诉状案 美国律师用ChatGPT写诉状,引用了6个完全虚构的法院判例 被法官发现,罚款5000美元,职业生涯蒙羞

爱因斯坦文学奖 GPT信誓旦旦说”爱因斯坦获得过诺贝尔文学奖”,还编了颁奖词 用户信以为真,到处传播

假论文引用 学者用AI生成文献综述,引用的论文根本不存在 论文被撤稿,学术声誉受损

为什么会幻觉?

> 因为GPT的目标是”生成流畅合理的文本”,不是”说真话”。

当训练数据里没有答案,GPT不会说”我不知道”,而是根据概率瞎编——凑出一个语法正确、逻辑通顺、但内容虚假的回答。

应对口诀:

– 重要事实必须人工核实

– 要求GPT给出信息来源(虽然它可能编来源)

– 用RAG(检索增强生成):先让AI查可靠资料库,再回答

👀 二、AI偏见:镜子里的社会偏见

AI不是凭空产生的,它吃的是人类产生的数据。而人类数据里,充满了偏见。

真实案例

场景 偏见表现 原因

招聘AI 某大厂招聘系统给女性工程师简历打低分 训练数据里高管男性居多,AI学会”男性=更适合技术岗”

面部识别 对深色皮肤人种识别错误率高 训练数据里白人照片占多数

司法评估 美国COMPAS系统对黑人被告的再犯罪风险评分系统性偏高 历史司法数据本身存在种族偏见

核心问题: AI是”偏见的放大器”。如果训练数据有偏见,AI会把它”自动化、规模化”地执行,而且包装成”客观算法”的样子。

应对方向: 多样化训练数据、算法公平性审计、人工复核关键决策。

🎭 三、对抗样本:AI的”视觉错觉”

人类有视觉错觉(比如两条一样长的线看起来不一样长),AI也有——而且更脆弱。

对抗样本(Adversarial Examples):对图片做肉眼不可见的微小修改,就能让AI彻底认错。

经典实验

原图 修改方式 AI识别结果

熊猫照片 添加人眼不可见的噪声 长臂猿(置信度99%)

“停车”交通标志 贴几个贴纸 “限速45”

乌龟3D模型 特定纹理涂装 步枪

危险之处: 自动驾驶如果识别错交通标志,医疗AI如果看错病灶……后果不堪设想。

原因: AI靠的是统计模式匹配,不是”理解”物体本质。人类看熊猫看的是”圆脸黑眼圈”,AI看的是像素分布——稍微扰动就翻车。

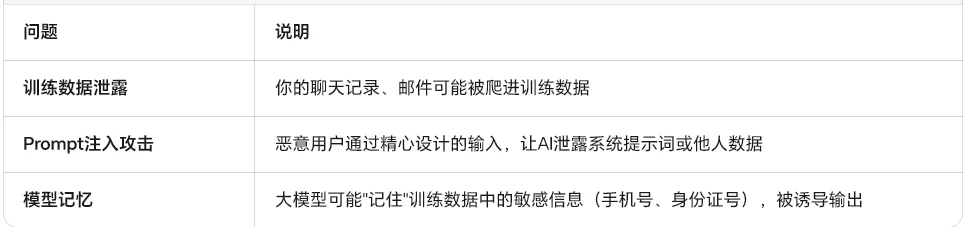

🔒 四、隐私与安全:你的数据去哪了?

隐私风险

真实案例: 2023年,ChatGPT曾出现bug,部分用户能看到其他用户的对话标题。三星员工把机密代码发给ChatGPT,导致公司数据泄露。

安全威胁

– 深度伪造(Deepfake):用AI换脸、克隆声音,制造假视频诈骗

– AI诈骗:克隆老板声音打电话骗转账,已有多起百万级案件

– 自动化攻击:AI生成钓鱼邮件、恶意代码,门槛大幅降低

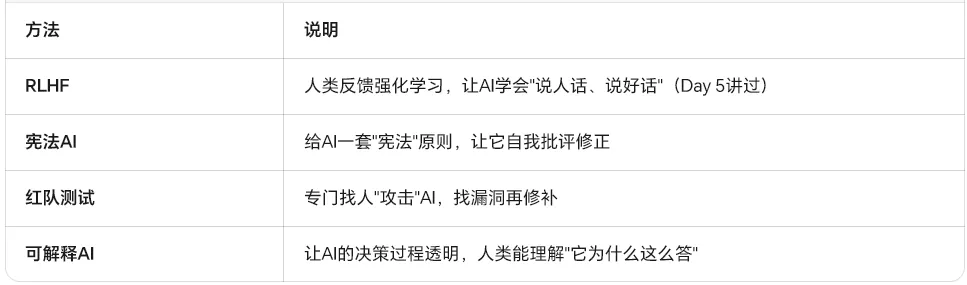

🤖 五、AI对齐:让AI符合人类价值观

面对这么多问题,AI界提出了”AI对齐”(AI Alignment)——让AI的目标和行为与人类的价值观、意图保持一致。

当前主要手段

但说实话: 对齐问题至今没有完全解决。什么是”人类价值观”?不同文化、不同群体的价值观冲突怎么办?AI的”道德”该由谁定义?

这些没有标准答案,是全人类正在探索的难题。

💡 六、给普通人的实用建议

🔔 明日预告

今天咱们给AI泼了冷水,但别被吓到——AI依然是超级生产力工具。关键是普通人怎么上手?从哪开始学?

明天Day 9:《普通人如何上手AI?——工具与学习路径》,给你一份”从0到1″的AI实践路线图!

关注不迷路,咱们明天见! 👋

夜雨聆风

夜雨聆风