当员工积极拥抱AI,那些你不知道的"数据泄露"

OpenAI完成1220亿美元融资,GPT-6即将发布。硅谷的工程师们在推特上疯狂刷屏,仿佛通用人工智能就在明天。

但我最近跟几位企业CIO和IT负责人聊天,听到的却是另一种焦虑:

“员工都在用AI,但没人知道他们把什么传上去了。”

“上个月发现有人把客户名单喂给了某个AI工具,我们连告警都没收到。”

“合规来查AI使用记录,我们一条都拿不出来。”

这不是某家公司的个案。

麦肯锡最新调研显示:近90%的企业至少有一个部门已常态化使用AI,但只有不到三分之一实现了规模化部署。

更让人后背发凉的是:员工用AI处理了什么数据,企业大概率是一无所知的。

01 员工们正在”自发”拥抱AI

2026年,AI工具迎来了大爆发,不只是OpenClaw引爆了Agent赛道,Anthropic的Claude、Perplexity Computer,以及最近火出圈的Hermes,让AI助手变得前所未有的强大和易用。

用户的热情也是真实的:

-

产品经理用AI写需求文档 -

销售用AI分析客户通话记录 -

行政用AI生成会议纪要 -

法务用AI审合同条款 -

HR用AI筛选简历

但问题是:你知道他们把什么传给了AI吗?

02 那些你不知道的”数据泄露”

让我说几个真实的场景:

场景一:销售部的小王。

他在用某款热门的AI助手分析客户画像。为了让AI”更懂”客户,他顺手把三百多份客户档案复制粘贴了进去。

这些档案里有什么?姓名、电话、购买记录,甚至有些还包含需求备注和沟通细节。

他不知道的是:这些数据可能被用来训练AI模型,可能被存储在第三方服务器,可能已经被别人访问过了。

场景二:研发部的小张。

他在用AI辅助写代码。为了让AI理解业务背景,他把部分技术方案和接口文档也喂给了AI。

这些文档里有什么?系统架构、数据库结构、API密钥模式。

场景三:HR的李姐。

她在用AI筛选简历。为了提高效率,她把公司所有在职员工的简历和绩效数据都传了上去,让AI学习”什么样的员工是优秀的”。

公司最核心的人才数据、薪酬结构、晋升规则,如果这些数据都在云上裸奔,企业的安全合规就没有保障可言。

三个人,三次”无心之失”。

但对企业来说,这可能是一次数据泄露事件。

而企业IT部门,很可能对此一无所知。

03 法规还在路上,但风险是真实的

你可能会说:让员工别用AI不就行了?

没那么简单。

2026年,全球AI治理正在加速推进。欧盟的《AI法案》按风险分级监管,美国NIST发布了AI风险管理框架,中国也在完善生成式人工智能服务管理暂行办法。

但法规的完善需要时间,而企业的数据风险是实时的。

更现实的问题是:即使法规完善了,责任最终还是落在企业身上。

你的员工把客户数据传给了AI,出了问题,罚款和赔偿是你的。

你的员工把商业机密喂给了AI,竞争对手用上了,受损的还是你。

“不知道员工用了什么AI”本身,就是一个巨大的合规漏洞。

04 效率与安全的矛盾,真的无解吗?

现在摆在你面前的有两条路:

路径一:堵。

严格限制员工使用AI,禁止使用一切外部AI工具。

效果:数据安全了,但员工怨声载道,效率一夜回到解放前。

路径二:疏。

给员工配备企业级的AI平台,在安全可控的框架内使用AI。

效果:效率提升的同时,数据安全、合规审计、权限管控都能做到。

第二条路,听起来很美好,但落地却并不容易。

关键在于:你需要的不是一个”更安全的AI”,而是一套”能把AI管起来的平台”。

05 企业级AI Agent平台

到底在管什么?

IDC最新报告显示,超过78%的中大型企业已将AI智能体纳入关键业务流程。

但与此同时,CIO们面临的核心挑战已从”缺乏算力、数据”等技术问题,转变为”应用效果不达预期”、”缺少成熟流程方法论”和”ROI不明确”等管理问题。

说白了:AI用起来了,但不知道怎么管。

一套合格的企业级AI Agent平台,至少要解决这几个问题:

|

核心能力 |

具体解决什么问题 |

|

统一管控 |

所有AI能力有统一入口,按需授权,IT不再两眼一抹黑 |

|

数据安全 |

敏感数据调用需要审批,影子AI实时拦截 |

|

合规审计 |

所有AI操作留痕,不可篡改,随时可查 |

|

多租户隔离 |

集团、子公司、部门数据互不穿透 |

|

Skills治理 |

企业可自建Skills,每一步都有管控 |

用一个CIO的话说:“我们需要的不只是让员工用上AI,而是让AI在企业的规则里运行。”

06 FinClaw:让AI在企业的规则里运行

说到企业级AI Agent平台,就不得不提FinClaw。

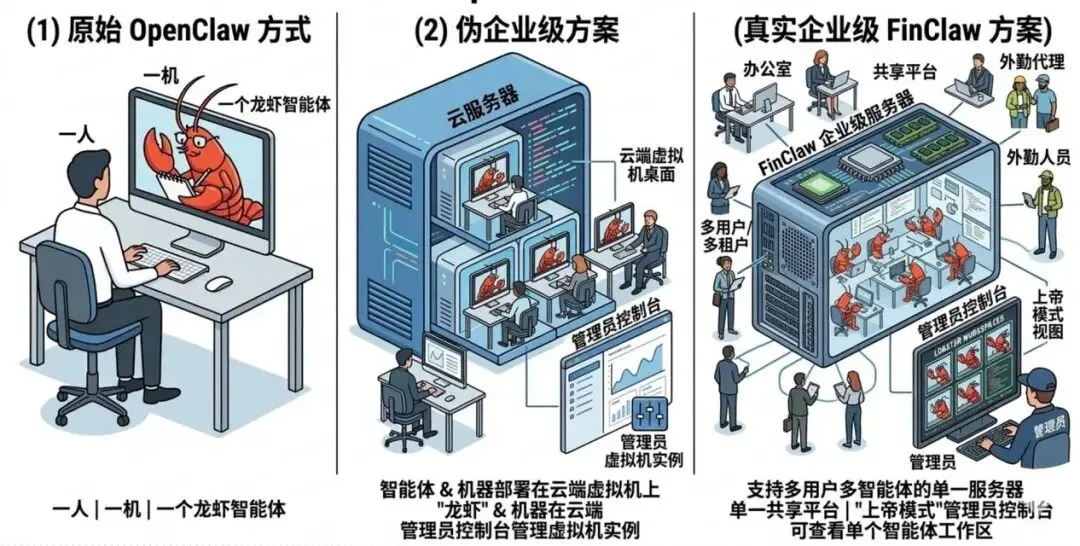

凡泰极客推出的FinClaw,在OpenClaw范式的基础上,为企业场景重构了三个关键能力:

第一,16层纵深防御体系。

从MicroVM物理级隔离到应用层审计,覆盖智能体运行的每一个环节。工具调用三态控制,确保敏感操作必须经过人工审批;影子AI拦截机制,实时监测并阻断未授权AI工具的使用;不可篡改的审计日志满足金融级合规要求。

第二,多租户隔离架构。

FinClaw支持集团、子公司、部门、账户四级租户体系,不同业务单元的智能体运行在完全隔离的环境中,数据互不穿透。同时与企业SSO/IAM无缝集成,账号体系与权限管理纳入企业统一管控。

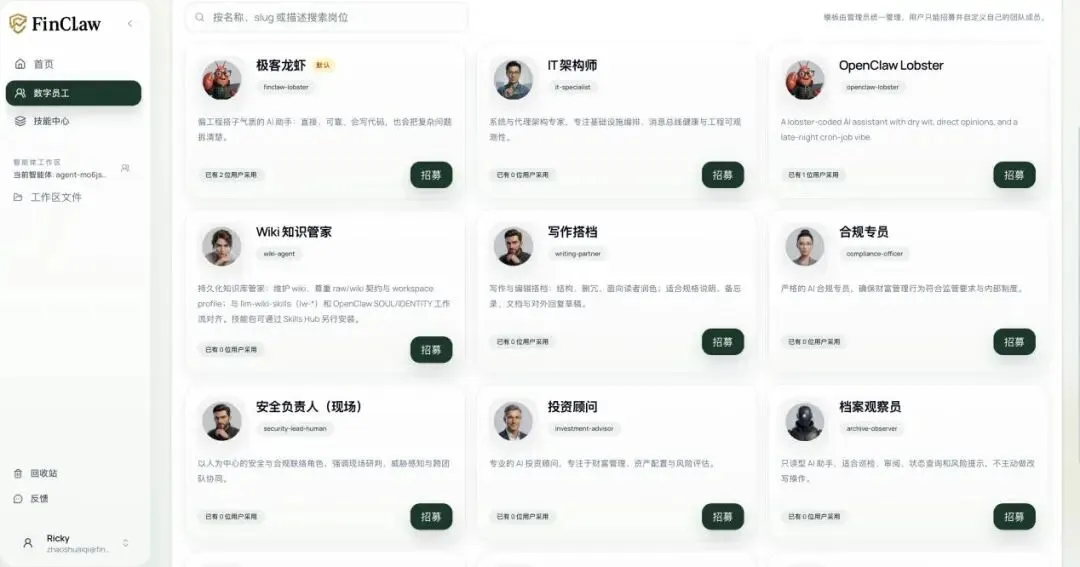

第三,技能治理与协作框架。

FinClaw的私有化Skills Hub提供技能的全生命周期管理。企业多年沉淀的SOP与专家经验,可以转化为标准化的数字资产。新员工入职不再靠”培训”,而是靠”装配AI技能”直接上岗。

更重要的是,FinClaw不需要企业推翻现有系统。它可以嵌入企业的存量系统资产,让ERP、CRM、OA们在不改造的前提下,获得智能体调用能力。

企业级AI Agent平台

FinClaw解决什么?

不是替代ERP、CRM,而是在填补系统之间的空白:

|

问题类型 |

具体表现 |

企业级AI Agent |

|

流程模糊 |

规则频繁变化,无法固化 |

AI执行+人工审批 |

|

跨系统操作 |

多系统切换,靠人串联 |

AI自动串联 |

|

数据安全 |

敏感数据调用无法管控 |

权限+审批 |

|

合规审计 |

AI操作无记录可查 |

完整日志 |

统一智能体管理:所有AI能力有统一入口,按需授权

Token计费审计:精确管控AI调用成本,每笔开销清晰可查

Skills强管控:企业可自建Skills,平台提供基础Skills

隔多租户隔离:集团、子公司、部门数据互不穿透

审合规审计:所有AI操作留痕,不可篡改,随时可查

07 给CIO们的选型建议

如果你正在评估企业级AI Agent平台,建议重点关注以下几点:

1. 谁能用AI、用多少,有管控吗?

按部门、角色精细化授权?Token用量精确到个人或团队?敏感数据调用需要审批?

2. Skills谁来管、怎么管?

企业能否自建Skills?Skills上线需要审核吗?如何防止未授权Skills被执行?

3. AI操作能审计吗?

每个AI调用有完整日志?日志能防篡改吗?合规审查能一键导出吗?

4. 现有系统能利旧吗?

AI Agent能调用现有ERP、CRM、OA吗?需要改造现有系统吗?

5. 部署方式灵活吗?

支持私有化部署?(金融客户通常必须)支持混合云架构?

太多企业花大量时间”选哪个AI工具”,却很少认真思考”怎么管住AI”。

当AI开始处理企业核心数据的时候,“失控的AI”比”没有AI”更危险。

员工的热情是真实的,AI的效率提升也是真实的。但如果没有一套有效的管控机制,这种”散兵游勇”式的AI使用方式,迟早会捅出大篓子。

关于企业AI管控,你有哪些困惑或经验?欢迎在评论区聊聊。

或者扫码了解更多企业级AI Agent平台的完整方案。

夜雨聆风

夜雨聆风