AI能不能把抑郁筛查做得更准?——《npj Digital Medicine》一项系统综述与Meta分析的启示

抑郁筛查长期面临一个现实难题:传统方法高度依赖量表、自述和访谈,虽然重要,但在大规模筛查、早期发现和客观评估方面仍有局限。发表于 npj Digital Medicine 的这篇系统综述与Meta分析,聚焦一个越来越受关注的问题:如果把 EEG、眼动、视频、音频、步态等客观生理与行为信息,与人工智能结合起来,抑郁筛查能不能做得更准? 研究结果给出的答案是肯定的。作者发现,AI辅助多模态方法的合并 AUC 达到 0.95(95% CI: 0.92–0.96),整体优于单模态方法;其中,深度学习模型的合并 AUC 也是 0.95(95% CI: 0.93–0.97)。这说明,多模态和AI结合,正在把抑郁筛查从“主观判断”推进到“客观信号融合”的新阶段。

一、研究背景

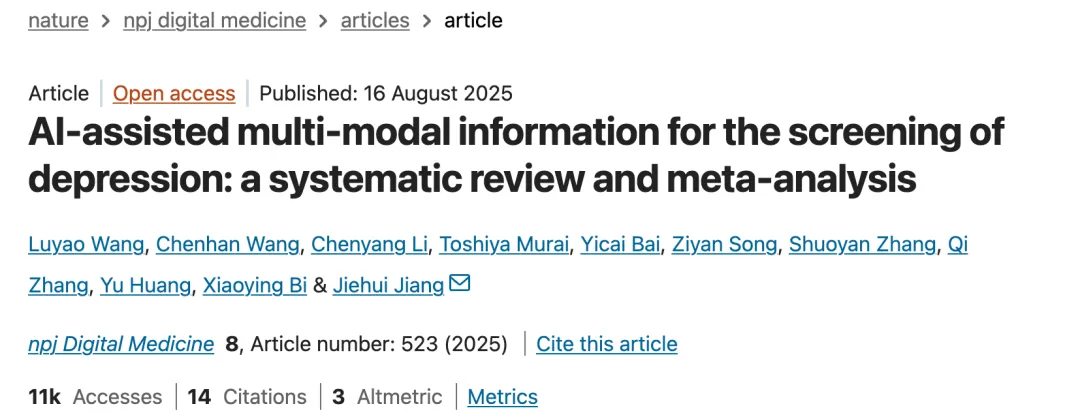

抑郁症是全球范围内常见且负担沉重的精神障碍之一。论文指出,当前临床筛查仍主要依赖病史和自我报告,这不仅增加了漏诊风险,也使大规模社区筛查变得困难。正因如此,越来越多研究开始尝试使用低成本、非侵入、易采集的客观信号来辅助识别抑郁,例如 EEG、眼动、视频、音频和步态。这些信号能够提供比自述更稳定的生理和行为信息。

作者认为,虽然过去已经有不少单模态研究,比如只用 EEG 或只用语音去区分抑郁和非抑郁人群,但现实中的抑郁表现本来就具有多维特征:既可能反映在脑活动,也可能反映在语音节律、面部表情、注视模式甚至步态上。因此,把多种模态整合起来,再用 AI 建模,理论上更有可能提高筛查性能。

二、研究目的

这篇文章的核心目标,不是开发一个新模型,而是系统回答一个更基础的问题:AI辅助的多模态生理和行为信息,是否真的比单模态方法更适合用于抑郁筛查。 作者特别关注三件事。第一,不同模态的总体分类表现如何。第二,多模态融合是否优于单模态。第三,机器学习和深度学习在这类任务中的总体表现差异如何。

换句话说,这篇研究真正想解决的是:在越来越多“AI+抑郁筛查”论文出现的背景下,我们到底能不能从总体证据上说,多模态客观信号是一个值得认真推进的方向。

三、研究方法

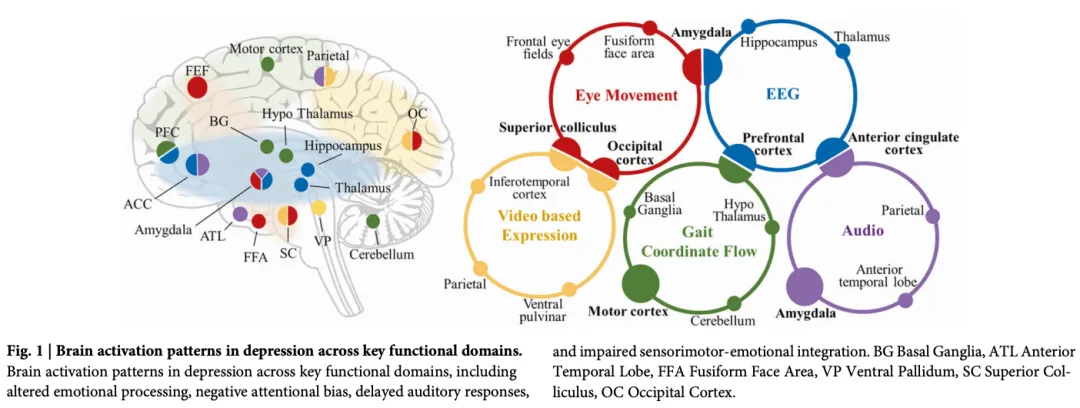

这项研究采用了系统综述和Meta分析方法,并按 PRISMA 标准执行,同时在 PROSPERO 完成注册。作者检索了 Google Scholar、Web of Science 和 IEEE Xplore,检索截止日期为 2025年6月7日。纳入标准要求研究必须使用 AI 方法,对抑郁与正常对照进行分类,并报告足以计算 2×2 列联表的数据,也就是敏感度、特异度等指标。

最终,作者纳入了 80 项研究 进入Meta分析。论文把抑郁筛查信号大致分为 EEG、音频、眼动、视频、步态 以及多模态融合等几类,并使用 AUC 作为主要综合指标,同时报告 敏感度(SE) 和 特异度(SP)。这样的设计使研究不只是在比较“哪个模型最好”,而是在比较“哪类信号组合更有前景”。

四、研究主要发现

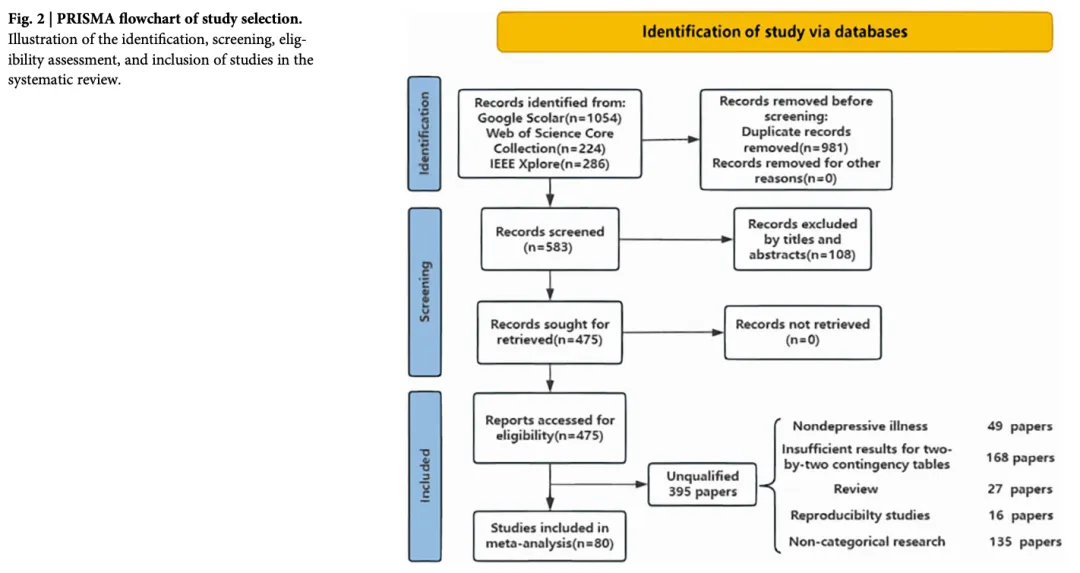

1. 多模态方法整体表现最好,合并AUC达到0.95

这是全文最核心的结果。论文摘要直接给出,多模态 AI 方法的合并 AUC 为 0.95(95% CI: 0.92–0.96),明显优于单模态方法,而单模态方法的合并 AUC 大约落在 0.84–0.92 之间。作者据此认为,多模态融合确实能带来更强的抑郁筛查能力。

2. 深度学习方法表现突出,合并AUC同样达到0.95

在算法层面,作者发现深度学习模型整体表现更强,其合并 AUC 为 0.95(95% CI: 0.93–0.97)。这说明,在多模态信号整合任务中,深度学习可能比传统机器学习更能发挥优势,尤其是在处理不同数据格式和跨模态特征关联时。

3. 单独用EEG其实已经不差,AUC达到0.92

虽然多模态最好,但 EEG 单独表现也很有竞争力。论文指出,共有 33 项 EEG 研究 提供了足够数据,构建出 88 个列联表。其合并结果为:敏感度 0.85(95% CI: 0.84–0.87)、特异度 0.86(95% CI: 0.84–0.88),AUC 为 0.92(95% CI: 0.89–0.94)。这说明 EEG 作为单一客观模态,已经具备较强筛查潜力。

4. 语音也是表现较强的单模态之一

作者在讨论中提到,单模态中的语音和 EEG 都能达到“令人满意”的诊断表现。对于语音,论文进一步指出,不同算法路线各有特点:基于韵律特征的传统机器学习与深度学习总体 AUC 接近,分别约为 0.92 和 0.94;前者特异度更高约 17%,但敏感度低约 8%。作者认为,这说明筛查工具不能只追求总体准确率,还要兼顾漏诊风险。

5. 两种当前主流多模态融合路线都表现不错

论文特别总结了两类常见多模态融合方案。第一类是 EEG + 音频,其合并结果为:敏感度 0.89(95% CI: 0.83–0.92)、特异度 0.88(95% CI: 0.85–0.91)、AUC 0.93(95% CI: 0.91–0.95)。第二类是 视频 + 音频 + 文本,其合并结果更高:敏感度 0.88(95% CI: 0.84–0.92)、特异度 0.91(95% CI: 0.88–0.93)、AUC 0.95(95% CI: 0.93–0.97)。这说明,多模态提升不只是理论想象,而是已经在主流组合方式中表现出来。

6. 研究还给出了对未来建模很有用的“高频特征”

这篇文章还有一个很实用的价值,就是它统计了不同模态中高频使用的特征。作者指出,在 EEG 研究里,功率谱密度(power spectral density) 和 Lempel–Ziv complexity 是很常见且重要的特征;在眼动研究里,注视持续时间(fixation duration) 是常见指标。这些结果虽然不像 AUC 那样抓眼,但对真正做模型和设计研究的人非常有参考意义。

五、研究结论

总体来看,这篇 npj Digital Medicine 论文传递出的信息非常明确:AI辅助多模态客观信号,在抑郁筛查中已经显示出比单模态更好的总体性能。 其中,EEG 和语音作为单模态已经有较强表现,而当多种模态被融合后,筛查能力还能进一步提高。

这项研究的意义,不只是证明“AI 可以做抑郁筛查”,而是说明未来真正有潜力的方向,可能不是单纯依赖量表,也不是只看一种信号,而是把脑活动、行为表现和外在表达整合进一个更客观的数字筛查框架中。

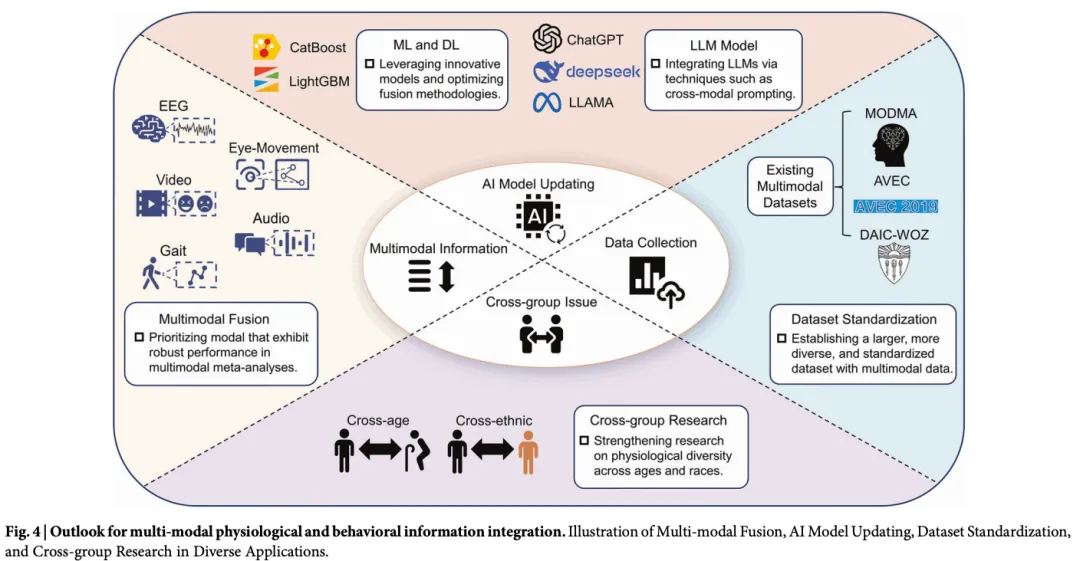

当然,作者也强调,目前这一领域仍存在一些关键问题,例如不同研究的数据格式差异大、数据库标准化不足、研究设计参差不齐。因此,这篇文章虽然给出了乐观结论,但并没有说“问题已经解决”。更准确的理解应该是:多模态AI抑郁筛查已经显示出很强潜力,但距离真正稳健、标准化、可广泛部署的临床工具,还需要更高质量的数据和更规范的研究设计。

论文出处

Wang L, Wang C, Li C, et al. AI-assisted multi-modal information for the screening of depression: a systematic review and meta-analysis. npj Digital Medicine. 2025;8:523. Published 16 August 2025. DOI: 10.1038/s41746-025-01933-3.

夜雨聆风

夜雨聆风