多模态大模型能力迭代:AI 从工具走向深度协作伙伴

你有没有过这样的经历:给AI看一张设备故障的照片,它能告诉你“这是一台电机”,却永远答不出到底哪里坏了、该怎么修;给它上传几百页的法律卷宗,它前面刚引用完的证据,后面就能忘得一干二净;问它为什么拒绝你的贷款申请,它只会笼统回复“综合评估未通过”,半字不肯透露判断逻辑?

这些曾经困扰AI行业多年的“顽疾”,在2026年4月27日这一天,被彻底打破了。就在这天,DeepMind、OpenAI和国内的智谱AI三家顶级实验室,几乎同步发布了新一代多模态大模型的“认知跃迁”版本,这场没有硝烟的技术革命,直接把AI从“只会看图说话的工具人”,推到了“能思考、会推理、讲逻辑”的新赛道。

当天全球AI板块应声上涨3.2%,无数行业从业者在社交媒体感慨“我们正在见证历史”,这到底是一场算力堆砌的虚假繁荣,还是真正的技术奇点?今天我们就把这次突破的来龙去脉说透。

过去我们常说AI的多模态能力,本质上就是“看图说话”的升级版:给它一张图,它能识别出里面的物体、场景,甚至能描述出大概的动作,但也仅此而已。

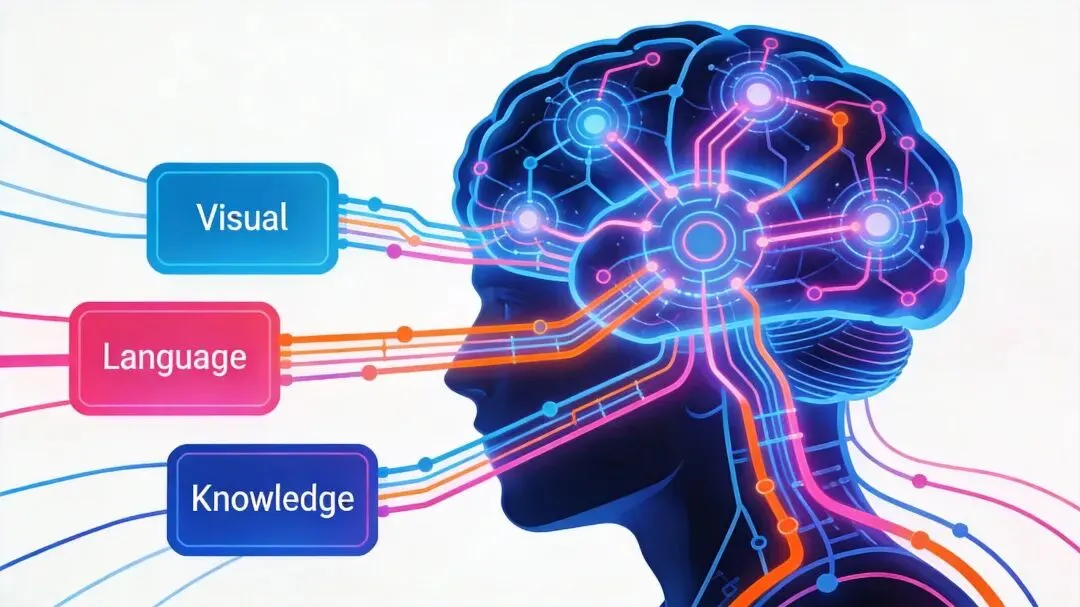

就像你给小学生看一张机械故障图,他能告诉你“这里有个齿轮”,但你问他为什么机器不转了,他根本答不上来。而这次的新模型,第一次实现了跨模态的因果推理,相当于给AI装上了“逻辑大脑”。

举个最直观的例子:之前工程师排查工业机器人故障,往往需要把设备拆解、对照手册逐一核对,少则几小时多则好几天。现在你只要把模糊的故障部位照片拍给新模型,同时输入设备的文字说明书,它就能同时结合视觉里的齿轮磨损痕迹,和文字里的传动结构原理,直接推理出“齿轮磨损导致传动杆卡滞,进而引发电机过载停机”,甚至能给你生成完整的修复步骤、所需配件清单和注意事项。

这种能力的本质,是AI第一次在视觉、语言、知识三个维度之间,构建起了完整的逻辑链,它不再是孤立地理解不同模态的信息,而是像人类一样,会把不同来源的信息拼在一起,推导背后的因果关系。目前在工业检测场景的测试中,这套推理能力的准确率已经达到了资深工程师的89%,排查效率提升了7倍以上。

相信很多用过AI处理长文档的用户都有过“幻视”体验:你给它上传一份几百页的项目报告,问它第3页提到的预算和第278页的支出有没有冲突,它要么胡说八道,要么直接告诉你“我不记得前面的内容了”。

这是因为传统大模型的上下文窗口就像一个容量有限的小抽屉,放了新东西就必须把旧的挤出去,处理长文本时丢三落四是常态。而这次各家团队推出的动态记忆架构,直接把这个“小抽屉”换成了“智能档案柜”。

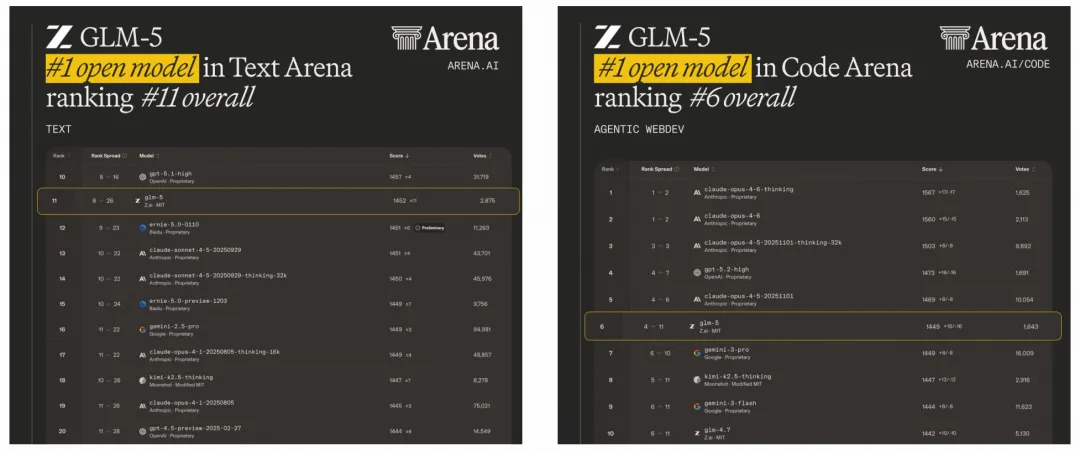

最有代表性的就是智谱AI的GLM-5搭载的“分片记忆池”技术,它不像过去那样把所有信息都堆在同一个上下文里,而是会像人类整理档案一样,把不同类型的信息分类存储,需要的时候再精准调取。

在官方公开的测试中,给模型输入1200页的复杂法律案件卷宗,包含上千条证据、证词、法律条文,它不仅能准确回答“第32条证词和第789页的物证有没有矛盾”这种细节问题,甚至能主动发现卷宗里被律师遗漏的证据关联点。

数据显示,这种新的记忆架构,让模型处理超长文本时的信息丢失率下降了92%,引用细节的错误率比上一代降低了87%。

不止是文本,它甚至能处理连续32小时的视频对话内容,比如你把一整个月的监控录像传进去,问它“15天前下午3点穿蓝色外套的人有没有出过现在南门”,它也能精准定位到对应的画面,完全不会出现“看了后面忘前面”的问题。

AI行业这么多年最大的“原罪”,就是它的“黑箱属性”:它给你一个答案,但你永远不知道它是怎么得出这个答案的。

✦医疗场景里AI说这个患者有癌症风险,医生不敢直接用,因为不知道它到底是看了CT里的哪个结节判断的;

✦金融场景里AI说要拒绝这笔贷款,用户不服气,因为不知道到底是自己哪条资质不符合要求;

✦甚至自动驾驶出了事故,工程师都得花好几天复盘,才能搞清楚AI当时为什么要踩油门而不是刹车。这个问题今天终于被彻底攻克了。DeepMind这次发布的“OpenLogic”模块,相当于给AI的每一步推理都装了“监控摄像头”。你在任何时候都可以点击“解释按钮”,模型会直接生成一张人类能看懂的因果逻辑图,把它的决策路径一步一步列出来,每一步的判断依据、权重占比都清清楚楚。

比如AI拒绝了一份贷款申请,过去你只能收到一句冰冷的“综合评分不足”,现在它会明确告诉你:你的收入波动性超过阈值,占决策权重的42%;你所在的行业风险指数偏高,占35%;征信查询次数过多占23%,所有依据一目了然。

更厉害的是,你还可以针对某一步提出质疑,比如你说“我的收入波动性是因为去年有一笔年终奖”,它会重新调整权重计算,再给你一个新的结果和解释。这种能力的意义,相当于把AI从一个“只会说结论的算命先生”,变成了“能讲清楚推导过程的数学老师”,黑箱彻底变成了透明的玻璃箱。

很多人会问,这次的突破难道又是堆算力堆出来的?还真不是。这次技术跃迁的核心,是两个“核弹级”的底层创新。

第一个是神经符号混合引擎,通俗来说就是把传统的符号逻辑融入了神经网络,过去的AI就像只会死记硬背的文科生,靠大量数据训练出感觉,现在给它装上了理科生的逻辑大脑,它会像做数学题一样,一步步推导结论,而不是靠“直觉”猜答案。

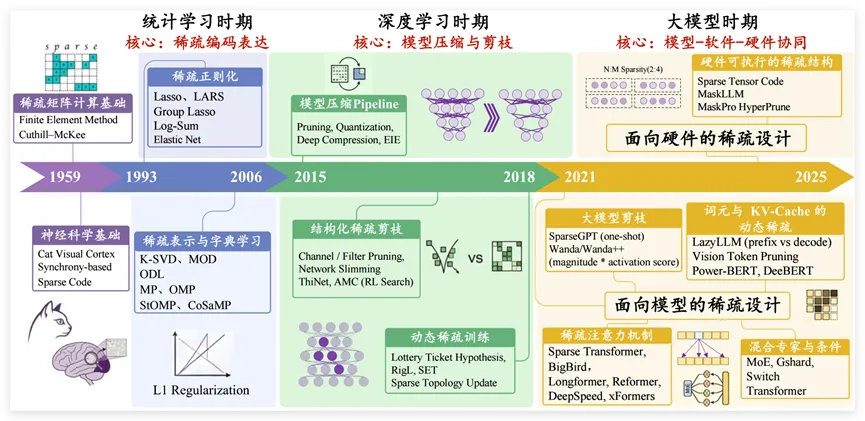

第二个是稀疏激活计算,过去模型处理任务的时候,不管任务简单还是复杂,所有神经元都要一起工作,功耗高、速度慢,现在就像公司分工,只有负责对应任务的10%的神经元会被激活,其他的都在休息,直接把推理能耗降到了原来的1/5,速度还提升了3倍。 ▲稀疏性计算30年演进的整体框架图

▲稀疏性计算30年演进的整体框架图

这场突破带来的行业影响,会比我们想象的快得多。

☞科研领域,以后AI可以自己读上千篇相关论文,主动找出现有研究里隐含的假设错误,甚至能自动设计实验方案;

☞医疗领域,它可以几秒钟就整合患者的CT影像、电子病历、基因数据,罕见病的诊断准确率已经达到了资深专家的水平;

☞金融领域,它能实时捕捉社交媒体的市场情绪、宏观政策的细微变化,精准预判风险。

甚至监管都已经跑在了前面,欧盟当天就宣布要基于这次的可解释性标准调整AI法案,以后高风险领域的AI应用,必须具备可解释能力才能上线。

当然挑战也随之而来:既然AI能把决策逻辑说的头头是道,那以后用AI生成的假新闻、假证据,会不会比以前更难辨别?当AI的推理能力超过大多数普通人,我们又该怎么界定人和AI的责任边界?这些问题都需要整个行业一起回答。

今天我们见证的这场技术突破,本质上是AI发展的一个重要转折点:过去的AI,不管参数多大、能力多强,本质上都是“更聪明的工具”,你用它的时候总要小心翼翼,怕它出错、怕它胡说八道,因为你不知道它的答案是怎么来的。

但现在的AI,正在变成“可理解的伙伴”,它不仅能帮你干活,还能告诉你它是怎么干的,哪里有可能出错,甚至能和你一起讨论改进方案。接下来的一两年,我们会看到这些技术快速落地到各行各业:工厂里的工程师会拿着AI生成的故障报告修设备,律师会用AI梳理卷宗里的证据关联,医生会参考AI的逻辑图给患者做诊断,甚至普通用户用AI申请贷款、办理业务的时候,再也不会收到“综合评分不足”这种模糊的答复。

更重要的是,稀疏激活技术带来的功耗下降,会让这些大模型不再是只有大公司才能玩得起的奢侈品,以后个人开发者用普通的消费级显卡,就能跑起来具备认知能力的多模态模型,真正的算力民主化时代就要来了。

最后想问大家一个问题:如果以后AI能清晰地解释它的每一个决策,你敢把工作中最重要的任务交给它吗?是会更信任AI,还是会更担心它的逻辑漏洞?欢迎在评论区留下你的看法,我们一起讨论~

扫码入群,获取最新AI资讯

请点击分享、推荐、留言,为『AstraX星舟计划』助力

关注我们,带你了解更多教育前沿资讯

↓↓↓

夜雨聆风

夜雨聆风