别再乱发了!即梦被约谈,AI内容不标识可能直接违规

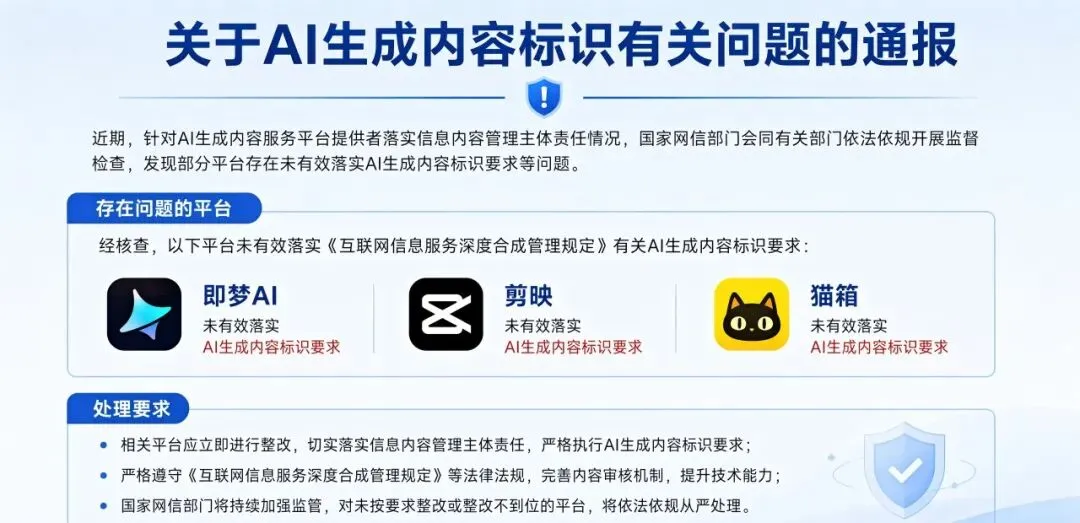

根据官方通报,这次被点名的是:

-

即梦AI -

剪映 -

猫箱

这些平台被监管部门发现:

👉 未有效落实“AI生成内容标识”要求

这不是“模糊问题”,而是明确违法/违规:

涉及三类核心法规:

-

《网络安全法》 -

《生成式人工智能服务管理暂行办法》 -

《人工智能生成合成内容标识办法》

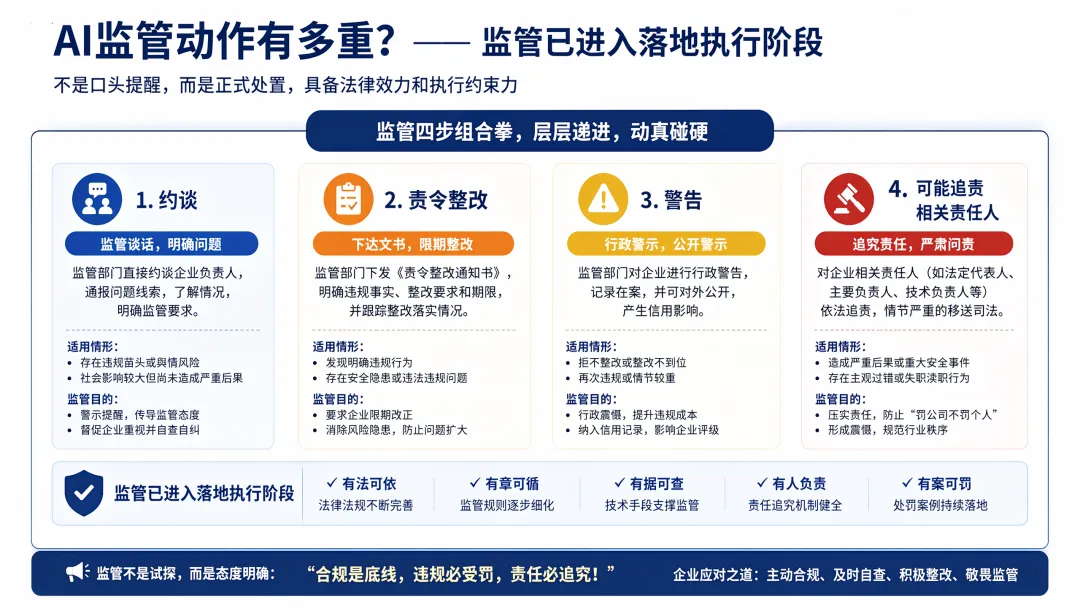

监管动作有多重?

不是口头提醒,是正式处置:

-

约谈 -

责令整改 -

警告 -

可能追责相关责任人

👉 这已经属于“监管落地执行阶段”,不是试探。

为什么现在开始严查?

这点其实很现实:

👉 AI内容已经到了“真假难辨”的阶段

政策文件里讲得很清楚:

-

AI内容越来越拟真 -

普通用户难以分辨真假 -

可能带来误导、欺诈等风险

所以必须:

👉 强制标识 = 给信息打“身份证”

现在不是“某个平台翻车”,

而是三件事:

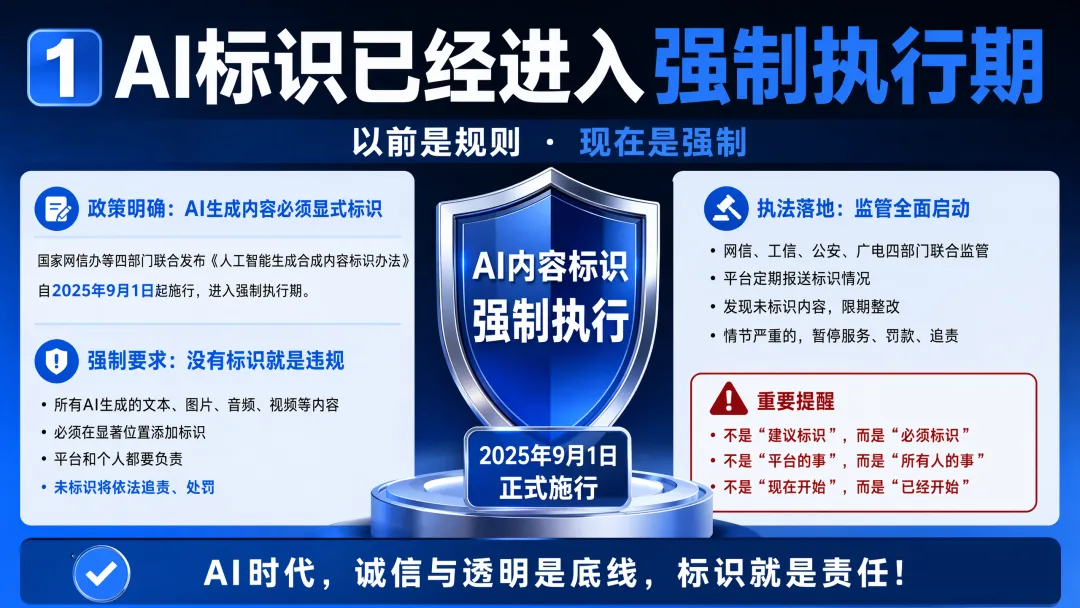

1️⃣ 标识已经进入“强制执行期”

以前是规则现在是强制

2️⃣ AI平台开始被“按内容平台管理”

不是工具而是内容生产源

3️⃣ 行业进入“合规竞争阶段”

以后拼的不只是技术,而是:

👉 谁更合规,才能活得更长久。

2025年9月1日之前:规则存在,但执行相对宽松👉 9月1日之后:进入“必须做,否则可能被处理”的阶段

因为:

👉 2025年9月1日 = 规则落地👉 2026年 = 开始集中、查平台

现在的AI内容已经到了真假难辨的时刻,平台如果不能起到一个很好的监督作用,那用户根本无法分辨,所以才有了强制监管,AI生成的内容必须添加“醒目标识”。

即梦被约谈之后:自媒体人,该收一收“野路子”了。

这两天很多人都在讨论一件事:即梦被约谈。

表面看,是平台的问题。但如果你是做内容的,其实更该问一句:

👉 下一步,会不会轮到创作者?

先别急着焦虑,这件事没有那么“恐怖”,但也绝对不轻。

它更像是一种提醒——AI这条路,还能走,但不能再“随便走”。

以前我们怎么玩AI,现在可能不太行了

说实话,过去一年很多玩法确实很“野”:

-

用AI做得像真人一样的视频 -

模仿某些人物说话、出镜 -

做一些“真假难辨”的内容吸点击

那时候的逻辑很简单:👉 好看就行,能火就行

但现在规则已经变了。

不是你做得不好,而是——AI已经强到,必须被认真对待了。

⚠️ 这次约谈,其实是在告诉你一件事

一句话讲透:

👉 以后,AI内容必须让人知道“这是AI”。

听起来很简单,但影响很大。

以前你可能追求的是:👉 越像真人越好

但现在你要考虑的是:👉 既好看,又不能让人误以为是真的

这中间,其实是一种创作能力的升级。

💡 那我们该怎么调整?

不是让你停,而是换一种方式继续往前走。

我更建议你,从三个方向慢慢调整。

① 别再“藏AI”,学会“用AI表达”

以前很多人会刻意去隐藏:

👉 不说这是AI👉 不留任何痕迹

但未来更安全的方式,是反过来:

👉 大方承认它是AI,同时让内容依然有吸引力

你会发现,真正好的内容,靠的不是“真假”,而是情绪和表达。

② 控制“拟真感”,不是越真越好

一个很现实的问题:

现在AI已经可以做到——像到让人分不清真假。

但问题也恰恰在这里。

如果你的内容:

-

太像真实事件 -

太像真实人物

那风险就会越来越高。

所以更聪明的做法是:

👉 保留一点“AI的痕迹”

让人一眼知道这是创作,而不是现实。

③ 从“拼数量”,转向“拼判断力”

过去你可能可以靠:

-

批量生成 -

快速铺内容

但未来,这条路会越来越难走。

因为真正决定你能不能留下来的,不是产量,而是:

👉 你知不知道什么能发,什么不能发

这其实是一种“内容判断力”。

🔍 这次约谈,影响最大的不是平台

而是一个趋势已经很清晰了:

👉 AI内容,正在从“自由生长”,进入“规则时代”。

这并不一定是坏事。

反而意味着:

-

门槛会提高 -

低质量内容会被淘汰 -

有能力的人会更容易跑出来

🎯 最后想说一句很现实的话

未来不会是谁会用AI就能赢,而是:

👉 谁在用AI的同时,还知道边界在哪。

你可以继续做,甚至可以做得更大胆。

但前提是——你知道什么时候该收。

夜雨聆风

夜雨聆风