问了AI两遍"契诃夫"的读音,我默默打开了百度

嗨,朋友你好!我是诗康妈咪!

上周闺女预习语文课文,作者介绍里出现了”契诃夫”。

她问我:”妈妈,这个字读kē还是hē?”

我顺手打开豆包,把问题发了过去。大概因为网络有点卡,第一条发出去没什么反应,我又点了一次发送。

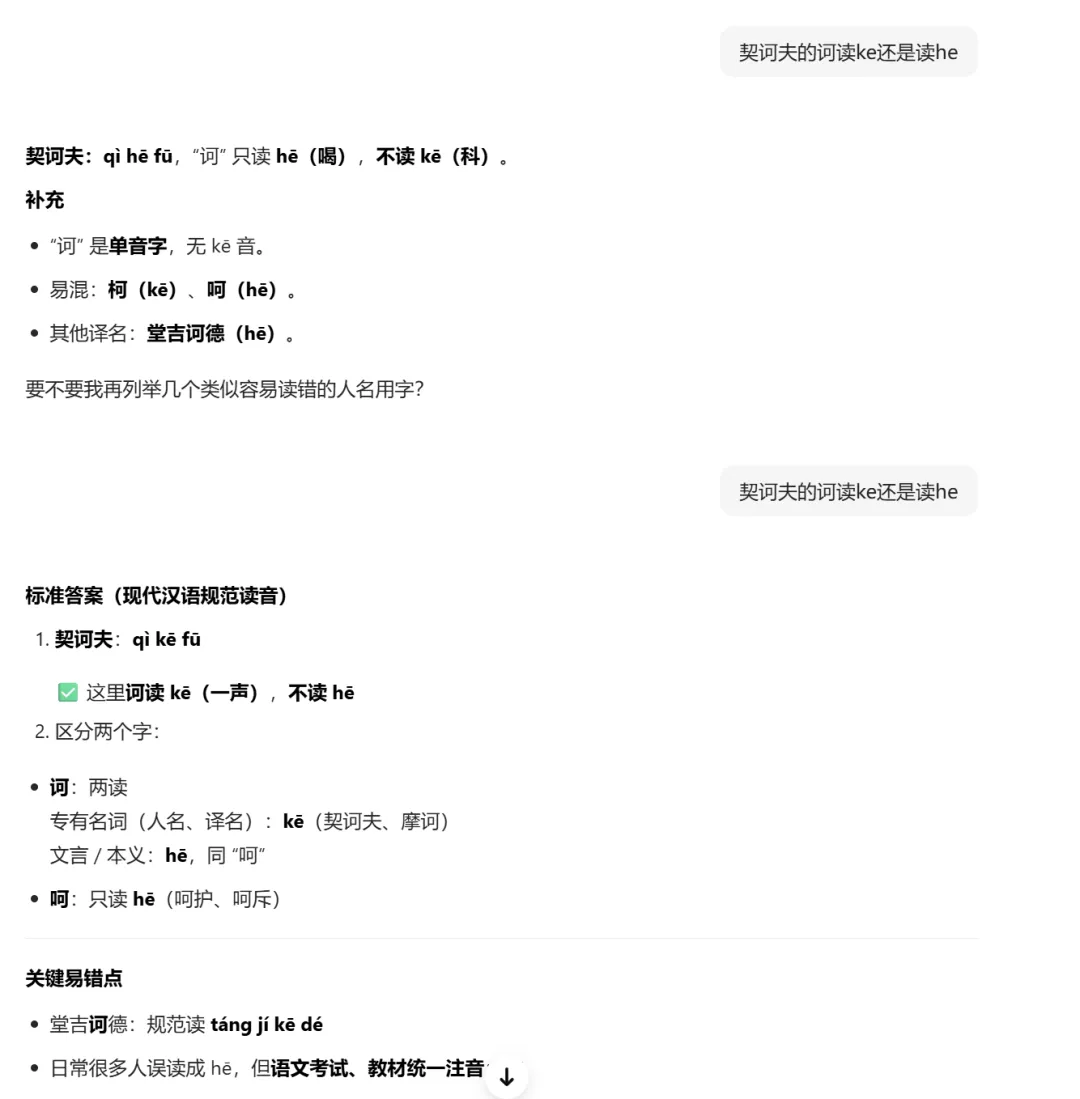

过了一会儿,屏幕上蹦出来两条回复。我先看到的是:”读hē”,紧接着下面又弹出一条:”读kē”

我盯着屏幕愣了三秒。同一个问题,同一个App,前后脚给了我两个完全不同的答案。

闺女在旁边催:”到底读什么啊?”

我说:”等一下,妈妈在拆盲盒。”

不是AI错了,是它”太自由”了

说实话,如果只是豆包一个人”精神分裂”,我顶多觉得是它抽风了。但当我把同样的问题丢给其他几个AI工具时,发现——它们都告诉我读”契诃(hē)夫”。

答案都是对的。

但问题在于:我敢信吗?

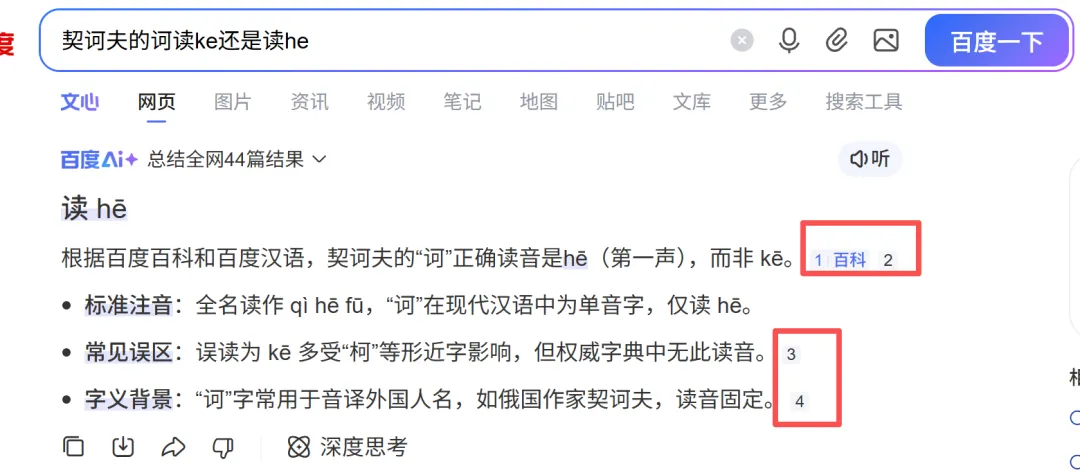

我又打开百度搜了搜。结果页上,第一条就是百度百科的词条,拼音标注着hē。往下翻,还有汉语词典、语文教学相关的文章。每个结果都指向一个具体的出处——哪本字典、哪个出版社、哪篇权威文章。

那一刻我明白了:AI们是在”回答”我,但它们没法让我”相信”它们。 每次回答都像是一次独立的”即兴演出”,演得好不好,全看当天的状态。而百度做的不是演出,而是把我带到了答案的”老家”——那里有字典、有辞书、有备案的百科词条,我可以自己看、自己判断。

这不是”百度一定对、AI一定错”的问题。这是“谁愿意为答案负责”的问题。

为什么AI会”变来变去”

被搞懵了几次之后,我专门去查了一下原理。不是AI故意骗我,而是它的底层设计,本来就不是为了”稳定”而生。

大模型本质是个”概率接龙机”。 你问它一个问题,它不是去查字典,而是根据训练时见过的海量文本,预测”下一个词最可能是什么”。每一次生成答案,它都在做概率抽样。

这意味着:同样的输入,不同的输出,是正常的。就像你掷骰子,每次结果本就可能不同。

更麻烦的是,AI没有”字典”的概念。它没有一本权威的《现代汉语词典》放在旁边随时查。当它”记不清”的时候,不会说”我不知道”,而是会根据概率”猜一个”——而且猜得自信满满。它给你一个答案,但不给你”如果错了怎么办”的退路。错了,你找不到人负责;对了,你也无法向老师证明”这个答案有权威来源”。

在AI时代,”得到答案”变容易了,”确认答案是真的”变难了。

那么百度为什么”不猜”

这里必须先说清楚:百度现在也有AI,搜索结果页上面常常直接给一段AI总结,用起来很顺。我们不是要把百度和AI对立起来,而是要看看,同样用了AI,百度做了哪些不一样的事。

这么说吧,百度的AI就像个”有参照证的考霸“。

它给你答案之前,会先去做三件事:

第一,看”出身”。 不是什么信息都能进入候选池,只有那些来自权威专业领域、时效性强的信息源,才有资格。就像招聘一样,简历关就筛掉一大半。

第二,”多方对质”。 针对同一个问题,它会去找多个可信来源,看看大家的结论是不是一致的。只有多个权威来源都说”读hē”,它才会把这个答案给你。这就像你查一个生词,不会只看一个人的说法,会翻几本不同的词典对一下。

第三,”有人盯着”。 百度搭了一套”秒级响应”的巡检系统,一旦发现内容有偏,系统和人工会立刻介入。相当于有个监考老师一直在旁边盯着,发现不对劲马上纠正。

所以当我搜”契诃夫 读音”时,百度不是让AI”猜”一个读音,而是先去索引库里找到百度百科的词条、汉语词典的注音、语文教学的文章——这些都是真实存在的权威网页——然后再把它们的结论呈现给我。

而且,百度不是只给我一个答案。它把百科释义、词典注音、教师讲解都列了出来。我可以点进去看:为什么这个字读hē,有没有其他说法,教材上是怎么标的。这是可验证性——不是”百度告诉你”,是”百度帮你看清了这条结论是怎么从千万个网页里长出来的”。

这种”能找到源头”的感觉,在辅导孩子作业这种”不能差不多”的场景里,就是刚需。

从”拆盲盒”到”找依据”

我不是说AI一无是处。平时查资料、写大纲、找灵感,AI依然是效率神器。它在”快”的维度上,没有任何工具能比。

但在需要”确认”的时刻——比如孩子的语文作业明天要默写、比如一个读音关系到考试扣分、比如你发现不同AI给出了不同答案——我们需要的不是再赌一个概率,而是找到一个敢说”这话有据可查”的地方。

那天我和闺女达成了一个新约定:遇到不确定的读音、字义、文学常识,先问AI可以,但最后一定要去百度”盖个章”——看看有没有字典、教材或官方文件为它背书。

因为在这个”无人担保”的时代,有出处的答案,才是硬通货。

而我,至少不想再被同一个问题气笑两次了。

夜雨聆风

夜雨聆风