女明星开源AI记忆系统,24小时5400星:但真正离谱的不是它

01 这事一开始看起来很魔幻

这事刚冒出来的时候,我第一反应是:啊?

《生化危机》女主 Milla Jovovich,突然和开发者 Ben Sigman 开源了一个 AI 记忆系统,叫 MemPalace。不是拍广告,不是站台,是放到 GitHub 上真开源。

然后更魔幻的来了。

24 小时 5400+ star,相关推文触达 150 万人。一个 AI memory 项目,靠女明星账号直接冲出技术圈。它还打出了一个特别狠的宣传点:LongMemEval 100% 满分,超过一堆付费记忆方案。

这句话太抓人了。

你想想,AI 现在最大的问题之一就是”失忆”。今天聊得好好的,明天换个会话,它又像刚认识你。突然来了个开源项目说:我记忆能力满分,而且免费、本地、MIT。

谁不想点进去看看?

但很快,Penfield Labs 出来拆了这个 benchmark。拆完以后事情就没那么热血了。

我觉得这事真正有意思的地方,不是 MemPalace 到底是不是神项目,而是一个更麻烦的问题:

AI 工具天天喊 benchmark 第一,我们到底还能不能信?

02 MemPalace 是什么:别急着骂,想法不蠢

先别急着把它打成”明星带货开源”。

MemPalace 这个想法本身,不蠢,甚至挺有意思。

它借鉴的是古希腊的”记忆宫殿术”。简单说,就是把记忆放进一个空间结构里。不是一坨文本丢进数据库,而是分层存放:翅膀、大厅、房间、壁橱、隧道。

听起来有点中二,但作为 AI 记忆系统,这个隐喻还挺顺。

因为人的记忆本来就不是一张 Excel 表。我们经常是靠场景、关系、时间线、某个具体句子,把过去的东西串回来。

更关键的是,MemPalace 的核心立场是:不让 AI 替你总结记忆。

很多 AI memory 产品会把对话丢给大模型,让它提取”重要事实”。比如”用户喜欢 Next.js”、”用户在做 SEO 项目”。这看着很聪明,但问题也很明显:AI 觉得重要的,不一定是你真正需要的。

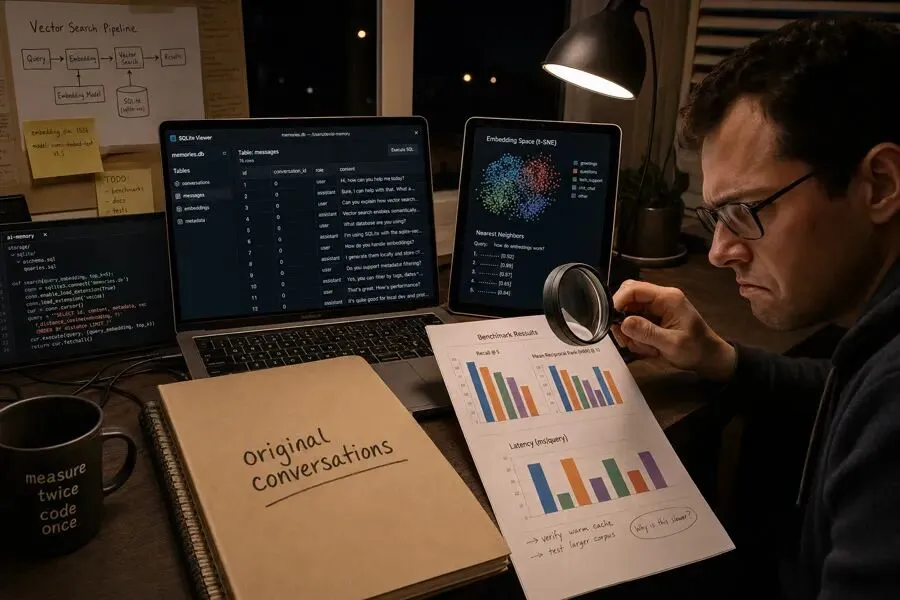

MemPalace 选择保留原始对话的每个 token。SQLite + ChromaDB,本地跑,MIT 协议,不依赖云服务。

说实话,我挺喜欢这个立场。

因为 AI 不该擅自替你决定什么重要。尤其是做内容、做产品、做 SEO 的人,很多价值就藏在一句原话、一个语气、一个当时没被总结出来的小细节里。

如果 AI 一上来就帮你”提炼精华”,emmm,有时候精华没了,只剩鸡汤味。

03 问题在哪:不是项目有 bug,是宣传删了 caveat

但问题也在这里。

MemPalace 不是说完全不能看,它的问题更像是:项目文档里其实挺诚实,营销传播里却把 caveat 删得太干净了。

比如 LoCoMo 100%。

Penfield Labs 指出,它的 top_k 设到了 50,而对话本身才 32 个 session。说白了,这就像考试的时候老师说”从这 32 页里找答案”,你直接把 32 页全塞给 Claude 读。

那这到底是在测记忆系统,还是在测 Claude 的阅读理解?

再看 LongMemEval 满分。项目自己的 BENCHMARKS.md 里承认过,99.4% 到 100% 这一步,是针对 3 个错题写代码修的,还用了 “teaching to the test” 这个说法。

这就很微妙。

不是说不能修 bug。修 bug 当然可以。但如果你是看着标准答案修到满分,再拿”满分”做最大卖点,那味道就变了。

还有一个更尴尬的点:宣传里提到的”矛盾检测”功能,代码里并不存在。

再比如 AAAK 压缩。宣传说是”无损”,但 benchmark 数据显示,压缩后 R@5 从 96.6% 掉到 84.2%,掉了 12.4 个百分点。

这还能叫无损吗?

最反差的是,BENCHMARKS.md 大概 5000 字,写得其实很细,也承认了不少限制。你能看出作者不是完全装傻。

但到了营销推文里,这些 caveat 基本没了。

只剩下最适合传播的那几个词:100%、满分、超越付费方案。

这才是我觉得最值得聊的地方。

04 核心:不是 MemPalace 一家的问题,是整个赛道的问题

如果只骂 MemPalace,其实有点偷懒。

AI 记忆赛道这两年本来就乱。

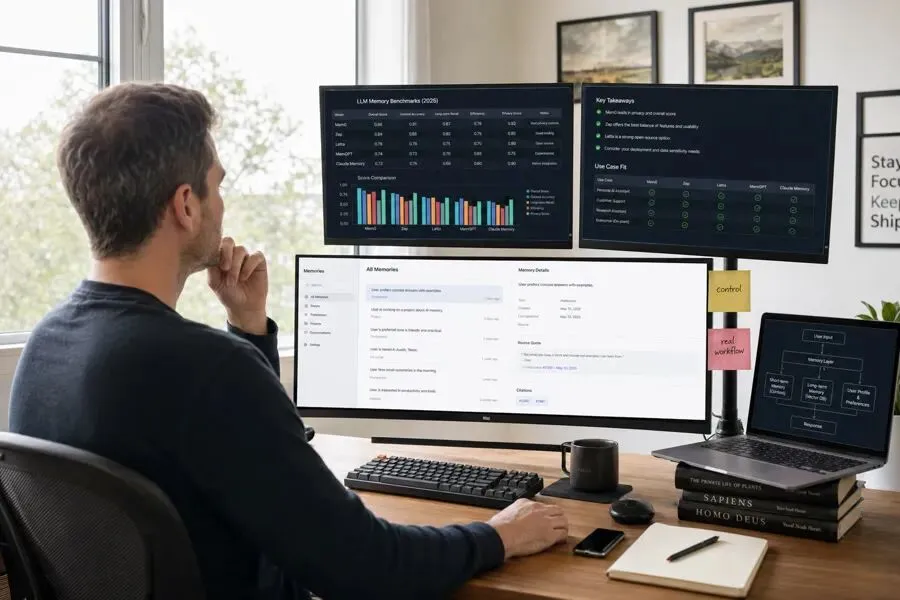

Zep 质疑 Mem0 的 benchmark 数据,Mem0 反过来说 Zep 实际只有 58.44%。Letta 又出来说,有些结果不可复现,甚至用文件系统存对话都能跑出不错成绩。

你看,这就很尴尬。

每家都说自己记忆好,每家都能拿出一个看起来很硬的数字。但你认真看方法,会发现大家测的东西不一定一样。

有的测 retrieval。

有的测回答准确率。

有的给了很长上下文。

有的让大模型二次 rerank。

有的 benchmark 本身数据量不大,稍微调一调参数,成绩就能很好看。

最后用户看到的是什么?

一个大标题:我们比对手强 20%。

但你不知道它到底强在哪里。是检索强?是模型强?是提示词强?还是测试设计刚好适合它?

我很喜欢一句话:

“大家都在说自己记性好,但很多测试其实是在比谁更会考试。”

这不是阴谋论,这是 AI 产品里越来越常见的情况。

Benchmark 当然有用。没有 benchmark,大家更容易吹到天上去。但如果 benchmark 变成了营销素材,而不是产品理解工具,它就会反过来骗用户。

尤其是 AI memory 这种东西,它不是跑一次题库就完事。

真正难的是:半年后,它还能不能记得你为什么做这个项目;能不能分清你改过的偏好;能不能让你删掉、纠正、追溯一条记忆。

这些东西,很多 benchmark 测不到。

05 新的开源分发渠道

对了,这件事还有一个很现实的启发:开源分发逻辑变了。

一个类似的 AI memory 项目,如果是普通开发者发在 GitHub 上,可能一周 50 star 都不错了。你写 README,发 Hacker News,转 X,求朋友帮忙点一下。

然后 Milla 一条推文,150 万人看到。

这不是一个量级。

过去我们说明星是代言人。品牌做好产品,明星负责曝光。

但在开源这件事上,明星可能已经不只是代言人了,而是分发基础设施。

她不是给项目贴个脸,她直接把项目扔进了一个普通开发者根本碰不到的流量池。

这对独立开发者其实挺刺激的。

技术项目也需要叙事。

不是让你去编故事,也不是让你碰瓷明星。而是你要让别人知道:为什么这个东西现在值得看?它解决了谁的痛?它跟市面上的方案到底有什么立场差异?

很多开发者以为”代码好就会被看见”。

坦白讲,越来越不一定了。

代码要好,但故事也得能传出去。

06 别只骂它:MemPalace 反而提醒了一个真需求

所以我不想把 MemPalace 写成一个翻车故事。

它的营销有问题,但它提醒的需求是真的。

“不让 AI 摘要”这个理念,被低估了。

我们现在太习惯让 AI 总结一切了。网页太长,让 AI 总结。会议太长,让 AI 总结。聊天太多,让 AI 总结。

总结当然有用。

但总结一定会丢信息。更麻烦的是,它丢的时候不会告诉你”我把这个删了”。它会特别自信地给你一段看起来很合理的摘要。

最怕的不是记不住,而是记错了还很自信。

Penfield 的拆解里其实也承认,原始文本 + 默认 embedding,在某些场景下可能比复杂方案更好。

这点我很认同。

因为记忆系统不是越像魔法越好。很多时候,你需要的不是一个会脑补的管家,而是一个可靠的档案柜。

能存原话。

能查来源。

能让你知道它为什么这么回答。

尤其是内容创作者和 SEO 人,原话真的很值钱。用户怎么描述痛点、客户怎么抱怨竞品、你当时为什么改标题,这些东西一旦被 AI 总结成”用户关注效率”,味道就没了。

所以那句我想再说一遍:

“AI 记忆最怕的不是记不住,而是它自信满满地替你记错了。”

07 普通用户怎么判断”benchmark 第一”:看这 6 件事

那怎么办呢?

以后你再看到一个 AI 工具说自己 benchmark 第一,别急着兴奋。先看 6 件事。

第一,测的是记忆系统,还是大模型阅读理解?

如果它把大量候选内容直接塞进长上下文,再让 Claude、GPT、Gemini 读完回答,那成绩好不一定说明 memory 强。可能只是模型阅读理解强。

记忆系统真正该证明的是:它能不能在大量历史里找到该找的东西,并且不给模型塞一堆无关内容。

第二,看 top_k、上下文长度、候选数量合不合理。

top_k 是检索返回多少条。候选总共 32 条,你 top_k=50,那基本就是全给。这个时候说”检索命中率高”,意义就不大。

还要看上下文窗口。现在大模型上下文越来越长,很多 memory benchmark 会被”暴力塞进去”稀释掉难度。

第三,有没有针对测试集修题。

这个很关键。

如果项目公开说:我们发现 3 个错题,然后针对这 3 个 case 改代码,最后 100%。那你就要把这个 100% 打个折。

不是说它造假,而是它更像考试前押题押中了。

第四,benchmark 能不能复现。

有没有脚本?有没有数据?有没有固定参数?有没有告诉你用了哪个模型、哪个版本、哪个 embedding?

如果只给一张截图,或者只给营销页数字,我建议你先别太当真。

第五,敢不敢展示失败案例。

我反而更信那些愿意说”这里我们做得不好”的项目。

因为真实系统一定有失败。尤其是记忆系统,用户改主意、信息冲突、时间线变化、隐私删除,这些都会让系统出错。

如果一个项目从头到尾全是满分、领先、突破,我会有点紧张。

第六,解决的是不是你的真实场景。

这是最容易被忽略的。

你是个人用户,可能在意隐私、本地、可编辑。

你是开发者,可能在意 API、延迟、成本、可观测性。

你是内容创作者,可能在意原话、来源、语气、上下文。

Benchmark 第一,不等于适合你。

说白了,你买的不是奖杯,你买的是少添乱。

08 如果我是普通用户,我会这样选

如果我是个人用户,我会把”可控”放在”满分”前面。

能不能看见它记了什么?能不能删?能不能改?能不能关掉某些记忆?本地数据能不能导出?

这些比 100% 好看多了。

因为记忆越强,出错成本越高。一个聊天机器人忘了你喜欢喝咖啡,问题不大。但它把你某个旧偏好当成现在的需求,一路带偏你的工作流,那就烦了。

如果我是独立开发者,我会从”用户怎么改错”开始设计。

很多 memory 产品一上来就想做自动化:自动提取、自动归档、自动调用。

但我觉得更重要的是纠错入口。

用户说”这个不对”,系统怎么处理?是删掉一条 memory,还是保留冲突记录?它会不会下次又犯?你有没有日志能追?

这才是产品体验。

如果我是内容创作者或者 SEO 人,我会更重视原话。

做内容的人都知道,用户原话比总结值钱。

比如用户说”我不是不会建站,我是不知道该从哪个模板开始”,这句话就比”用户需要建站指导”更有价值。前者能写标题,能做落地页,能做广告文案。后者像废话。

所以对内容和 SEO 场景,我宁愿工具笨一点,也不要它乱总结。

保留原始材料,再给我好的检索和引用。够了。

09 回到 MemPalace:不是神,也不该一棍子打死

回到 MemPalace。

它不是神。

100% 这个宣传有问题,LoCoMo 的测试方式有问题,”无损压缩”这个说法也站不太稳。营销把 BENCHMARKS.md 里的限制删掉,这点确实不应该。

但我也不想一棍子打死它。

因为它的几个方向是有价值的:本地优先,保留原始记忆,不把所有判断权都交给 AI 总结,不强迫用户依赖云服务。

这些都值得继续做。

它更像是一个好想法,加上一次很强的传播,再加上一次有争议的 benchmark 展示。然后刚好撞上了 AI 记忆赛道最混乱的地方。

所以这事才会炸。

如果它只是一个普通项目,大家可能会说:不错,继续迭代。

但当它带着”女明星开源”、”24 小时 5400 星”、”LongMemEval 满分”一起出现,所有人都会拿放大镜看。

这也算公平。

你吃到了传播红利,就得承受更严格的质疑。

看到”benchmark 第一”,先别激动

我觉得这件事最后给普通用户的提醒很简单:

以后看到”benchmark 第一”,先别激动。

不是说 benchmark 没用,而是你要知道它到底在测什么。测题库、测阅读理解、测检索、测 rerank,还是测一套刚好适合它自己的流程。

建立判断标准,比追爆款重要。

尤其是 AI 工具现在更新太快,今天一个 100%,明天又来一个 120%。你如果只跟着数字跑,很容易被营销牵着走。

满分经常只是说明它很会做这张卷子。

你要找的不是考试状元,而是能在你真实工作流里少添乱、多帮忙的工具。

夜雨聆风

夜雨聆风