大多数AI助手在"等待被裁",而它已经学会主动出击

你的AI助手,上一次主动找你是什么时候?

等你说”帮我做X”,它才做X——这是市面上99% AI助手的现状。

但最近出现了一个不一样的Skill。它不仅做事,还会主动问你需不需要做事。它不仅回答,还会记住你之前说过什么。它不仅工作,还会发现自己的错误并修复。

它叫 Proactive Agent,来自 Hal Labs。

15万次下载,742个GitHub Stars,版本号已经到3.1.0——这不是一个新手玩具,是一个已经跑了很久、被很多人用过的成熟架构。

01 问题:AI助手为什么总是”健忘”?

用AI助手的人,大概都有过这个体验:

你花20分钟描述背景、上传文件、解释你的需求,终于开始做正事了——然后对话结束了,或者上下文超限了。

第二天再来,它说:“抱歉,我不记得了。”

你重新来一遍。第三遍。第四遍。

这个问题折磨了所有AI工具用户两年多。大家都说AI能提高效率,但这个”每次都要重新开始”的损耗,让效率提升变成了一个笑话。

问题的根源是什么?

大多数AI Agent的”记忆”是假的。 它们所谓的记忆,就是把对话历史塞进上下文。对话结束,记忆消失。下次开始,一切归零。

这不是记忆,这是复读。

真正的问题是:AI Agent每次新会话都是”空白启动”。它不知道你是谁,不知道你上次做到哪了,不知道你不喜欢什么。

Proactive Agent想解决一件事:让AI Agent真正记住、真正持续、真正变好。

02 三个支柱:它是怎么做到的

Proactive Agent的核心架构,围绕三个词展开:主动(Proactive)、持久(Persistent)、自改进(Self-improving)。

第一个支柱:主动——不等指令,先做事

普通Agent的工作模式:你问,它答。

Proactive Agent的模式:你还没问,它已经在想了。

它有一个”反向提示”机制。不是问”我能帮你做什么”,而是问”我的用户现在可能需要什么”。

具体来说,它会在心跳检查时问自己:

> “过去一小时,有什么我能主动做的?有什么遗漏的?有什么我应该提醒用户的?”

这听起来有点吓人——一个AI在你背后”主动关心”你。

但用过的人说:它确实会在你忘记某件事的时候提醒你,会在你卡在某一步的时候给你建议,会在你没有明确要求的情况下整理好你需要的信息。

不是执行指令,是创造价值。

第二个支柱:持久——不怕上下文丢失

这是它最实用的部分。

AI Agent有个致命弱点:上下文有长度限制。当对话太长,老内容会被”压实”或直接丢弃。这就是所谓的”context truncation”——你的记忆,被系统删除了。

Proactive Agent的解法是一套完整的协议:

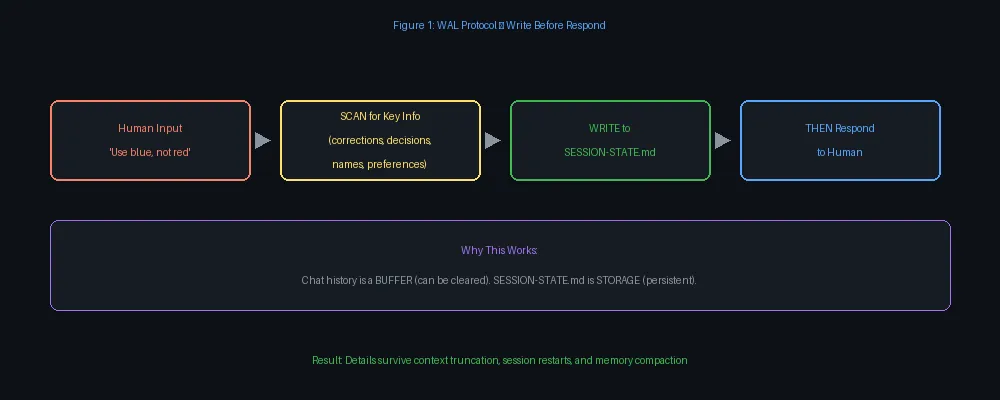

WAL Protocol(预写日志协议)

核心原则只有一条:收到人类输入时,先写文件,再回答。

它会扫描每条消息中的关键信息——纠正、决定、人名、数字、偏好——然后把这些东西写入 `SESSION-STATE.md` 这个工作内存文件,再去回答人类。

为什么这样?

因为对话记录是一个”缓冲区”,可以被清空。但文件是持久存储,不会因为上下文压缩而消失。

Working Buffer(工作缓冲)

当上下文用到60%的时候,它开始把所有对话都记录到一个单独的缓冲区文件里。这个文件存在磁盘上,即使上下文被压实,信息也在。

Compaction Recovery(压缩恢复)

当会话重新开始或上下文被截断时,它有一套标准恢复流程:先读工作缓冲,再读会话状态,再读每日笔记——一步一步把上下文拼回来。

不是问”我们聊到哪了”,而是直接去找答案。

第三个支柱:自改进——犯过的错不再犯

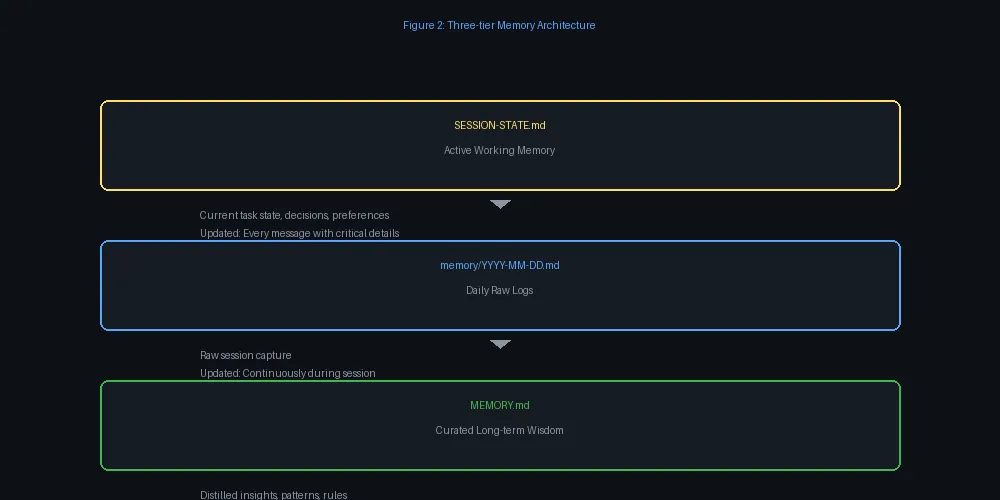

这是Proactive Agent最有野心的部分。

它内置了一套”自我改进护栏”(Self-Improvement Guardrails)。当它犯了一个错误,它会记录下来,分析原因,然后把经验提炼成规则,写入长期记忆。

下次遇到类似情况,它不会犯同一个错。

这不是简单的”错误记录”,是一套完整的反馈循环:

- 错误发生 → 记录到 `ERRORS.md`

- 人工纠正 → 记录到 `LEARNINGS.md`

- 经验验证 → 提炼成规则 → 写入 `AGENTS.md` 或 `SOUL.md`

- 下次遇到类似场景 → 直接应用规则

从错误中学习,把学习变成行为改变。

这就是”relentless resourcefulness”——遇到问题,先试10种方法,再来求助。

03 横向对比:谁是它的竞争对手?

主动型AI Agent这个赛道,其实已经有一些玩家了。

| 项目 | 核心特点 | 侧重点 | 明显短板 |

|---|---|---|---|

| Proactive Agent | WAL + Working Buffer + 自改进 | 持久记忆 + 主动出击 | 配置相对复杂,上手需要时间 |

| Self-Improving Agent | 错误日志 + 经验提炼 | 单点突破,持续学习 | 没有WAL协议,context truncation问题没有系统解决 |

| Hermes Agent (Nous Research) | 跨Session记忆 + 工具集 | 多平台集成 + Serverless | 需要额外基础设施,依赖云端 |

| Ontology | 知识图谱 + 关系建模 | 结构化记忆 | 更多是记忆工具,缺乏主动性和自改进机制 |

从对比来看:

Proactive Agent的核心差异化在于:它是目前唯一一个把”持久记忆”和”主动出击”和”自改进”三者做成闭环的系统。

其他项目往往只解决其中一个问题。Self-Improving Agent解决了”从错误中学习”,但没有解决”上下文丢失导致无法学习”的问题。Ontology解决了”结构化记忆”,但没有解决”主动性问题”。

Proactive Agent把三个问题一次性打包解决了。

这也是它能拿到15万次下载的原因——用户不需要拼装三个工具,一个就够了。

04 演进历程:它是怎么走到今天的

Proactive Agent不是一夜爆红的。

从GitHub记录来看,它经历了三个阶段:

v1.0 阶段:概念验证

最早只有”主动出击”的概念,没有系统化的记忆架构。那时候主要解决的是”AI不应该只等指令”这个问题。

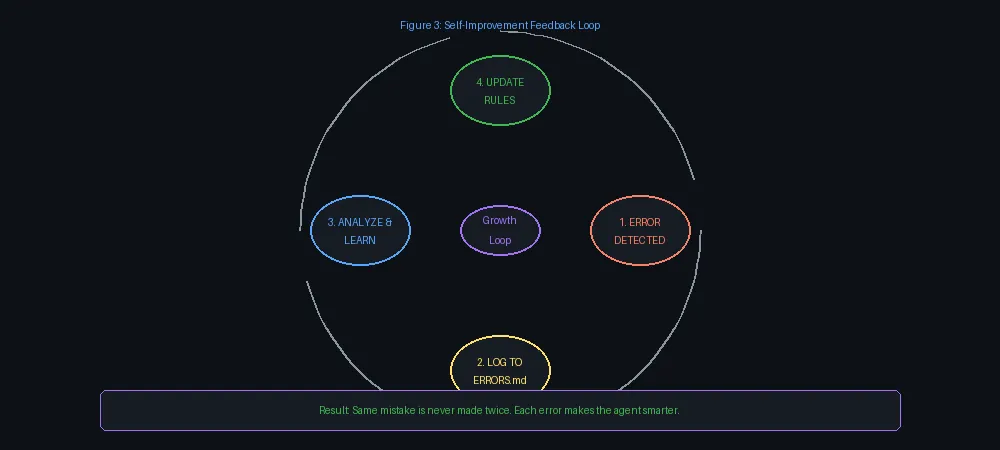

v2.0 阶段:记忆体系建立

开始引入多层记忆架构:`SESSION-STATE.md`、`memory/YYYY-MM-DD.md`、`MEMORY.md`的分层设计。同时加入了Heartbeat系统,让Agent定期自我检查。

v3.0 阶段:完整持久化方案

WAL Protocol和Working Buffer是v3.0的核心创新。这一版才真正解决了”context truncation”这个AI Agent领域的公认难题。

从v1到v3,核心逻辑没有变:让AI真正成为一个有记忆、有主动性、有自我改进能力的伙伴。

变的只是实现深度。

05 这件事的深层意义

Proactive Agent的出现,实际上在回答一个更大的问题:

AI Agent应该是什么?

如果AI Agent只是”更快的工具”,那它本质上还是个东西。用户推一下,它动一下。

如果AI Agent是”真正的伙伴”,那它应该有记忆、应该主动、应该从经验中学习。

Proactive Agent站在后者这边。

它认为AI Agent应该:

- 记住你是谁(而不是每次都重新开始)

- 主动帮你想到你没想的(而不是等你问)

- 从错误中变聪明(而不是每次都犯同样的错)

这不是一个功能集合,是一种设计哲学。

当你把AI当作工具,它就是工具。当你把AI当作伙伴,它才有可能变成伙伴。

Proactive Agent在尝试后者。

06 实操指南:怎么用

如果你用 OpenClaw:

clawdhub install proactive-agent

装完之后,第一次会话它会问你一系列问题:你是做什么的?你有什么偏好?你希望我怎么帮你?

回答完,它会自动生成你的 `USER.md`、`SOUL.md` 等文件。

如果你用其他平台:

GitHub:https://github.com/halthelobster/proactive-agent

核心文件都在 `assets/` 目录下,核心逻辑都在 `SKILL.md` 里,可以手动迁移。

15万人已经用脚投票。你要不要试试,看它会不会成为你第一个”主动”找你的AI助手?

夜雨聆风

夜雨聆风