一个50亿美金App的退场,和一个新物种的诞生——从生成视频到理解世界,2026年最被低估的转折

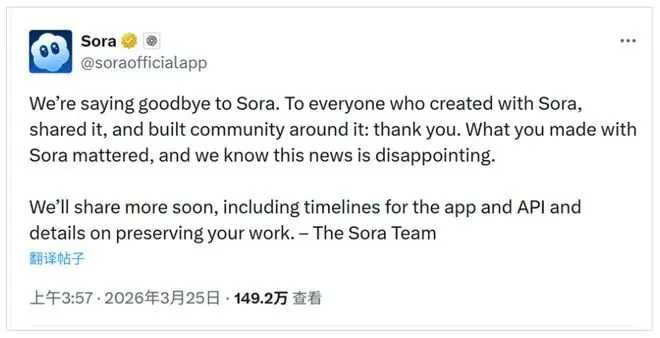

3月,OpenAI宣布关停Sora。

一个烧掉50亿美元的视频App,就这么没了。

很多人只看到了一条新闻。但如果你愿意多想一步,会发现这条新闻背后,藏着AI进化史上一次静悄悄的跨越——它关于AI如何从”想象世界”,走向”看懂世界”。

01

一个被误读的死亡

我们先来还原一下现场。

Sora是2024年初发布的。那段13秒的预览视频——一只猫在雪地里奔跑,光影流转,细节逼真——让全球科技圈沸腾。人们惊呼”AI奇点来了”。

但故事没有按剧本走下去。

2026年3月24日,OpenAI宣布关闭Sora的全部服务:独立App、API、ChatGPT内置视频功能,一刀切。

一个曾经App Store登顶的产品,活了不到6个月。

原因很简单,也很残酷——账算不过来。据福布斯估算,Sora上线以来运行成本高达50多亿美元,而收入仅约210万美元。日均用户使用时长只有13分钟,30天留存率仅1%。

一个AI视频工具,用户把它当”meme赌场”玩

——62%的内容是荒诞娱乐,原创内容只占总播放量的1%。

Sora死于商业逻辑的崩塌。

但故事到这里,才刚刚开始。

02

一条藏在废墟里的线索

关停Sora的消息传出后,一篇文章引起了我的注意。

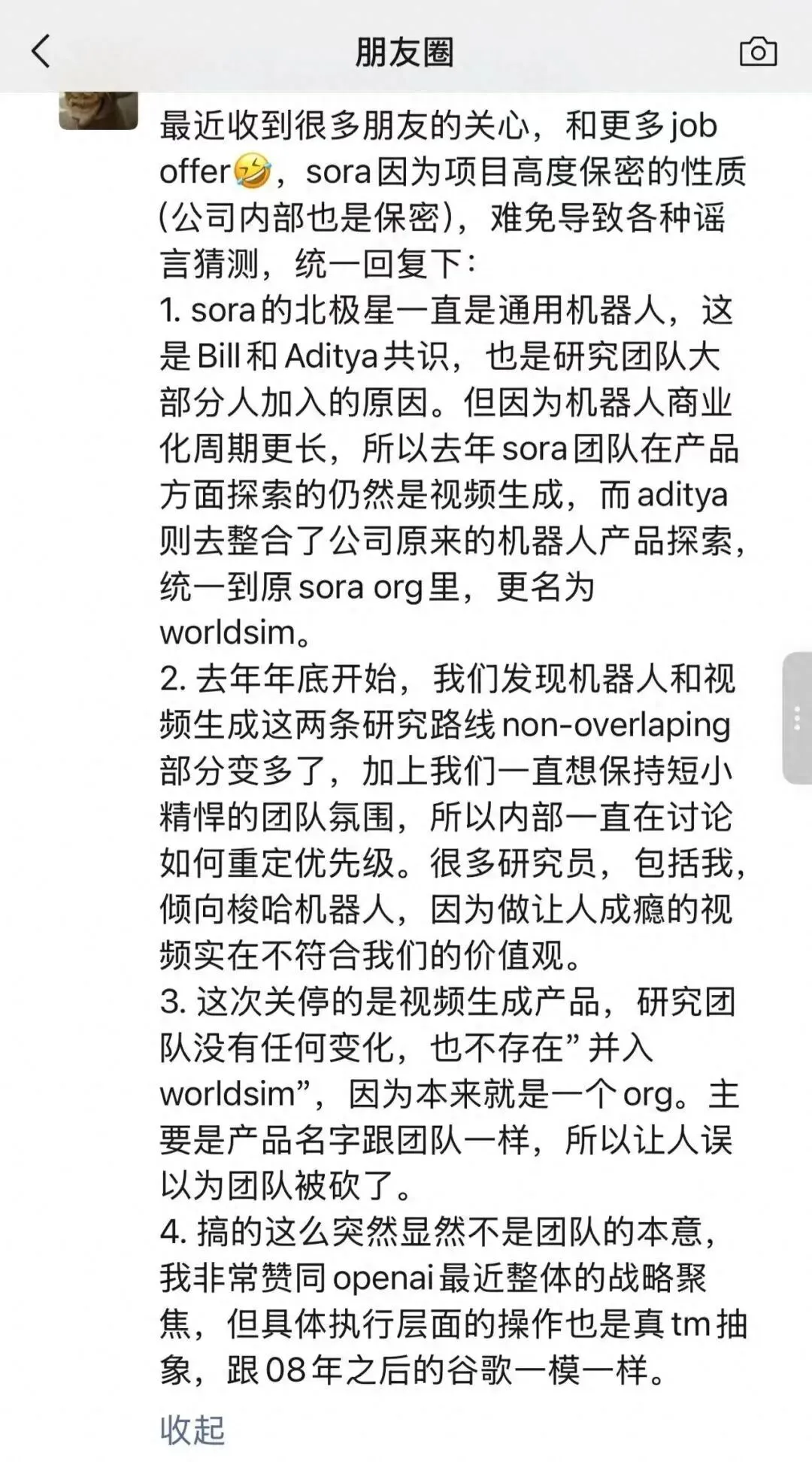

OpenAI一位华人研究员在社交媒体写了一段话,大意是:

Sora团队从一开始,终极目标就不是做一个视频App。

真正想做的事,是用视频生成来训练一个理解物理世界的大脑,然后把那个大脑装进机器人。

这段话让我重新理解了整件事。

你想想看,视频生成在做什么?

它不是在画图。它是在模拟一个物理世界——模拟重力怎么作用于物体,模拟碰撞后碎片怎么飞溅,模拟光线如何在玻璃上折射,模拟一个人的动作在下一个瞬间会是什么姿态。

每生成一秒视频,模型就必须对物理规律做一次完整的”内化推演”。

这不是巧合一一视频生成的本质,就是一种对物理世界的持续模拟和理解。

所以Sora虽然作为一个产品”死了”,但它花50亿美元算力烧出来的物理世界理解能力,不会消失。它会变成OpenAI机器人项目的底座。

Sora不是失败了。它是完成了训练任务,然后退役了。

03

一场感知革命的三重奏

顺着”AI理解物理世界”这条线往下看,你会发现,

2026年初的AI领域,正在发生三件看似独立、实则紧密关联的事。

它们不是三条平行线,而是同一个进化故事的三幕。

第一幕:AI学会了”模拟”世界

2026年2月,字节跳动发布Seedance 2.0。

一张人物照片,一段提示词,几分钟就能生成一段角色高度一致、物理光影真实的”功夫大片”——人物在打斗中衣角翻飞、火花四溅,镜头调度甚至有导演级的叙事感。

这不再是一年前的”抽卡赌脸”。一次成型,质量稳定。

Seedance 2.0背后是统一的多模态音视频联合架构

——它不是在拼接画面,而是在理解一个连贯的物理场景后,把它”渲染”出来。

从Sora到Seedance 2.0,AI模拟物理世界的能力完成了从”形似”到”神似”的跃迁。

能生成真实的视频,意味着模型内部已经建立了一套对物理规律的”隐性理解”。

第二幕:AI学会了”实时”理解

但生成和理解还不是同一件事。

你能默写一篇课文,不代表你读懂了。

你能画出一张桌子,不代表你理解桌子的结构。

同样,AI能生成视频,不代表它能实时理解一段连续的视频流

——像人眼一样边看边懂。

这个问题的突破,来自一个意想不到的地方。

2026年3月底,理想汽车的MindGPT-ov团队发布了一篇论文,提出一个叫StreamingClaw的框架。

它解决的核心问题很朴素:让AI不再只能”看录像”,而是能”看直播”。

以前的视频AI,你得给它一段完整的、已经录制好的视频,它才能分析。StreamingClaw让AI实现了三个能力——

- 实时推理:增量处理每一帧画面,边看边理解,不用等视频结束

- 长期记忆:把碎片化的画面自动拼合成连贯的事件——就像你看了两小时电影,能完整复述剧情

- 主动交互:它不是等你提问才回答,而是发现异常主动行动

AI从”被动的录像分析员”,变成了”主动的现场目击者”。

第三幕:理解之后,是行动

到这里,你可能会问:AI模拟世界、实时理解世界,然后呢?

然后就是具身智能。

当你把一个能理解物理世界的AI,装进一个有”眼睛”(摄像头)和”手”(机械臂)的机器人身体里,会发生什么?

它能通过观看人类操作视频自主学习技能

——不是被程序员一行行代码教出来的,而是像人一样,看会了。

你教孩子做菜,不会给他写”左手持锅,右手颠勺”的代码。

你让他站在旁边看你做。

视频理解,就是AI学习物理世界的”语言”。

它不再是抽象的语法课。它是沉浸式的语言环境。

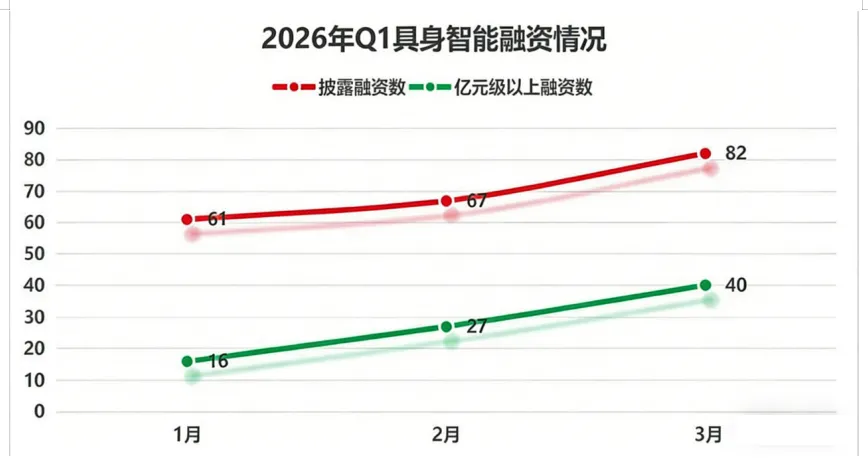

这就是为什么2026年具身智能突然成了所有大厂的主赛道。

不是因为机器人硬件突飞猛进了,而是因为AI终于”学会了看”。

04

如果你用系统思维看这件事

到目前为止,我说了三件事:Sora关停、Seedance发布、StreamingClaw登场。

但如果只是把它们当成三条新闻来看,你只看到了故事的三分之一。

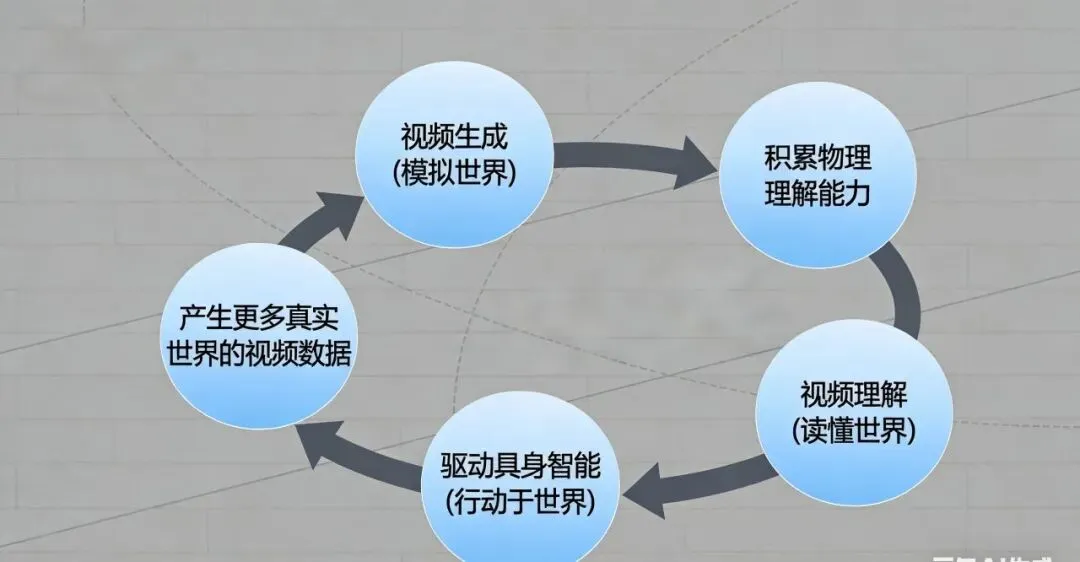

用系统思维的视角看,这三件事其实构成了AI感知能力进化的一个完整正反馈循环:

生成和理解不是两件事,是一个飞轮的两面。

每生成一段高质量视频,模型对物理世界的理解就深一层;理解越深,生成的视频就越真实;生成越真实,具身智能获得的”训练素材”就越丰富——机器人能看得更懂,学得更快。

这就是OpenAI关停Sora的真正逻辑:不是放弃视频,而是把”生成”阶段积累的物理理解能力,迁移到”理解和行动”阶段。

从系统层面看,这不是一个产品的死亡,而是一个进化周期的完成。

05

接下来会发生什么

说了这么多底层逻辑,落实到每个人的生活里,你会看到什么?

短期内,最直接的变化在内容创作。Seedance 2.0这类工具正在把短视频、短剧、广告的制作门槛打到地板——一个人5分钟就能生成以前需要摄制组一周的作品。但核心竞争力正在转移:从”执行能力”变成”创意和判断力”。工具越来越好用,但”拍什么”和”为什么拍”仍然需要人来决定。

中期内,你会感到”身边的东西变聪明了”。车里的语音助手不再是傻傻的指令执行者,它能实时理解路况、理解你的疲劳程度、甚至预判你的需求。家里的摄像头从冷冰冰的监控变成了能理解你生活习惯、主动服务的伙伴。

长期来看,这才是真正的大事——机器人时代的基础设施正在被浇筑。

当AI通过视频学会了理解物理世界,机器人就不再是被代码僵硬驱动的机械,而是能观察、能理解、能像人一样通过模仿来学习的”新物种”。

就像你学做菜不是靠代码,而是看妈妈怎么做。

视频,就是物理世界的编程语言。

06

写在最后

回到开头那个问题——Sora为什么会死?

现在我们有了一个更完整的答案。

它死在产品层面,因为商业逻辑不成立。

但它活在能力层面——50亿美元算力烧出来的物理世界理解能力,

正在成为OpenAI机器人项目的地基。

如果说ChatGPT让AI学会了”思考”,那视频理解正在让AI学会”观察”。

而观察,是行动的前提。

两年前,我们看着Sora那段13秒的猫的视频,惊叹于AI”想象世界”的能力。

两年后,AI已经不再满足于想象。

它正在学着看懂世界,走进世界,改变世界。

一个视频App死了,一个物种正在觉醒。

这才是2026年春天,AI领域最值得被记住的故事。

💬 互动话题:

如果AI真的学会了”看懂世界”,你觉得它最先改变你生活的哪个场景?欢迎在评论区聊聊。

参考资料:

- 复旦发展研究院《浪潮之后断舍离:OpenAI关停Sora的三本账》

- 澎湃新闻《2026年,AI的三个关键趋势》

- 理想汽车 StreamingClaw 论文(arXiv:2603.22120v1)

- 新京报《实测Seedance 2.0:当AI成为导演》

- 知乎专栏《OpenAI华人研究员揭秘:关闭Sora是为了”梭哈”机器人》

- 36氪《一组隐秘的数据,揭开了Sora失败的真相》

夜雨聆风

夜雨聆风