AI是怎么思考的:详解神经网络系统

之前我写了两篇文章,一个讲AI数据中心,一个讲什么是Token。

很多人看完之后,开始问一个更核心的问题:

AI到底是怎么“思考”的?

说实话,这个问题如果你不搞清楚,后面你看AI、看大模型、甚至看投资,都会判断失误。

今天我就把这件事情给你讲明白。

⸻

一、先说结论:AI根本不会思考

我们先把最关键的一句话放在最前面:

AI不是在思考,它是在做概率预测。

很多人脑子里有一个画面:

AI像人在下围棋一样,在脑子里模拟各种可能性,然后选一个最优解。

这个画面——只对了一半,而且关键地方是错的。

AI不是在“穷举可能性”,而是在做一件更简单、但更恐怖的事情:

👉 预测下一个最有可能出现的内容

⸻

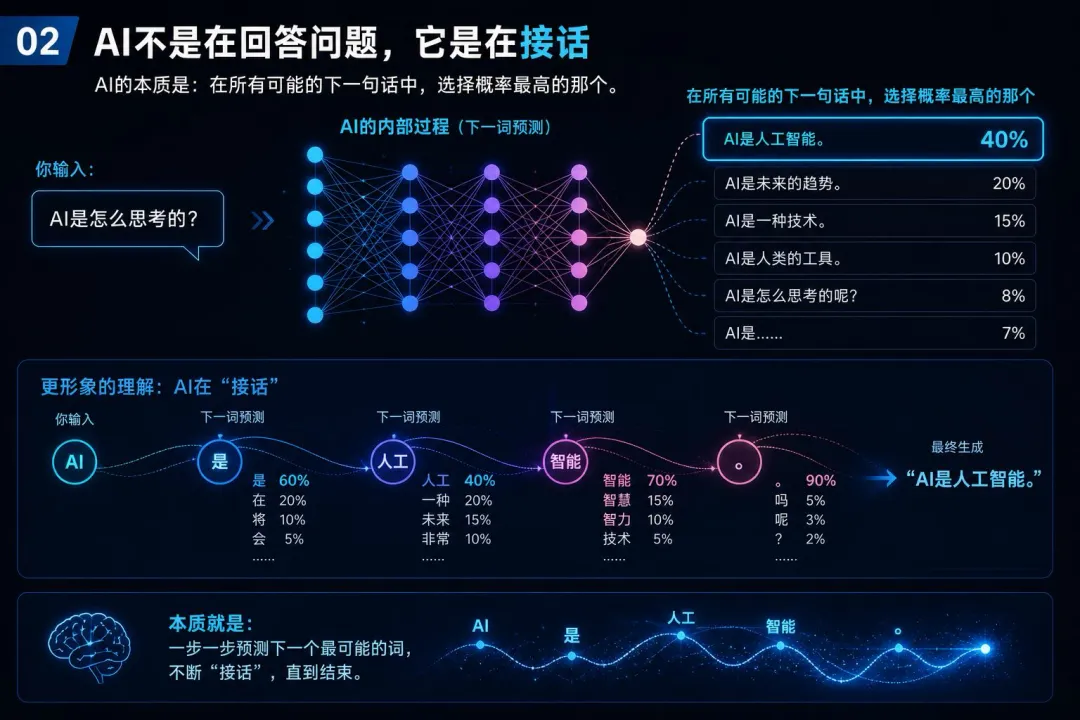

二、什么是AI真正的工作方式?

你现在在和我对话,其实背后发生的事情非常简单:

你输入一句话,比如:

“AI是怎么思考的?”

AI不会去理解“思考”这个概念,也不会去分析哲学问题。

它只做一件事:

👉 在所有可能的下一句话里,选一个概率最高的答案

比如(简化理解):

* “AI是人工智能” → 概率 40%

* “AI是未来趋势” → 概率 20%

* “AI是骗局” → 概率 5%

它直接选第一个。

这件事情在技术上有个名字:

👉 Next Token Prediction(下一词预测)

你可以这么理解:

AI不是在回答问题,它是在“接话”。

⸻

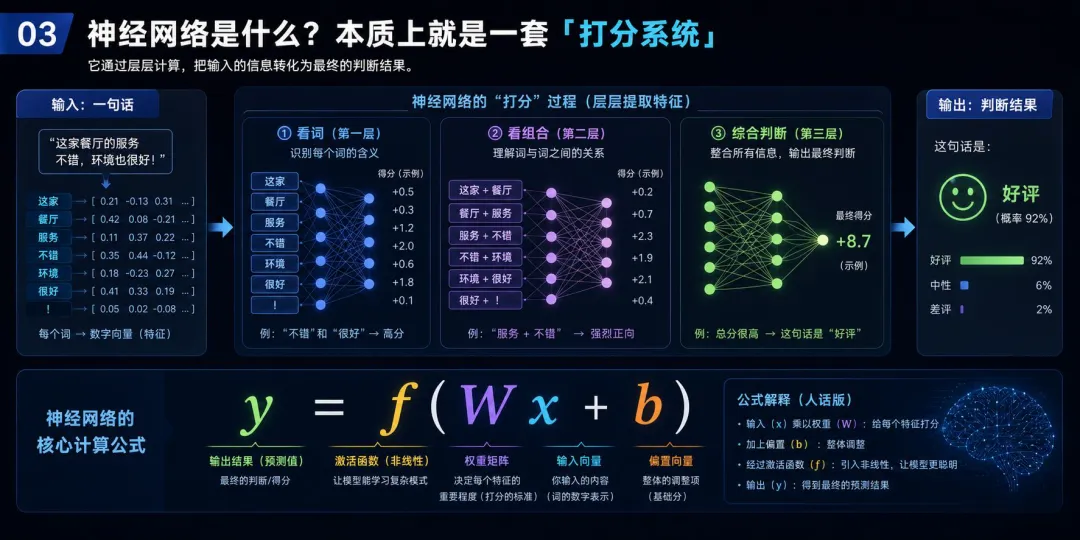

三、那“神经网络”到底是什么?

很多人一听“神经网络”,就觉得很玄,像大脑一样。

其实你把它拆开看,很简单:

👉 它就是一层一层的“打分系统”

我举个最接地气的例子:

假设AI要判断一句话是好评还是差评。

⸻

第一层:看词

* “好” → +2分

* “差” → -2分

* “不错” → +1分

⸻

第二层:看组合

* “不 + 好” → 反转 → -2分

* “还不错” → +2分

⸻

第三层:综合判断

最后一算:

👉 这句话有80%概率是好评

⸻

真实的神经网络,本质就是这个逻辑:

* 层数:几百层

* 参数:几千亿个

* 运算:全是矩阵计算

如果你要稍微专业一点,可以提一句核心表达:

y = f(Wx + b)

一句话解释就是:

输入 → 加权 → 修正 → 输出

就这么简单。

⸻

四、那它为什么“看起来像人”?

重点来了,这一段是很多人真正想不明白的。

既然AI只是概率预测,那为什么它说话这么像人?甚至有逻辑、有情绪、有观点?

答案只有一个:

👉 因为它学过人类写过的海量内容

包括:

* 书

* 论文

* 论坛

* 新闻

* 对话

所以它学到的,不是“思考能力”,而是:

👉 人类思考的表达方式

你可以用一句话总结:

AI不是在思考,它是在模仿人类思考留下的痕迹。

我个人更喜欢这么说:

AI不是一个大脑,它更像一个“看过所有答案的人”。

⸻

五、那围棋AI是不是在穷举?

很多人会反驳:

那围棋AI不是在计算所有可能吗?

比如 AlphaGo

答案是:也不是。

因为围棋的可能性数量:

👉 大到无法穷举(10^170 级别)

它真正的做法是:

👉 神经网络 + 搜索

简单讲:

* 神经网络:判断“哪一步更有希望”

* 搜索算法:只探索最可能赢的路径

👉 它不是全算,而是“挑着算”

这和人其实很像:

高手不是算得多,而是知道哪里值得算

⸻

六、你真正应该理解的一点

如果你看到这里,其实你应该意识到一件事情:

AI的强大,不是因为它会思考,而是因为它“见得太多”。

它本质上是在做一件事:

👉 把世界变成概率模型

你问任何问题,它都在算:

* 人类通常怎么说

* 什么答案最合理

* 哪种表达最像人

然后给你一个最“像人类”的输出。

⸻

AI所谓的“思考”,并不是理解世界,而是对世界进行概率建模。

它不是在寻找真相,而是在预测人类最可能说什么。

所以AI越强,不是因为它更聪明,而是因为它“看过的世界更多”。

最后说的是:

-看过不点赞,投资亏一半。-

夜雨聆风

夜雨聆风