别再神话AI了:它能写代码却做不好三岁小孩的题目

来了!AI智商大翻车:GPT-5.5和Claude Opus 4.7在智商测试上栽了跟头

你听说了吗?那个号称要取代人类的AI,在智商测试上,连1分都没拿到。

对,你没看错。GPT-5.5,0.43%。Claude Opus 4.7,0.18%。人类,100%。

这个测试叫做ARC-AGI-3,是专门给AI做的”智商测试”。测试内容很简单——给AI一些从来没见过的游戏规则,让它自己摸索、自己推理、自己找到答案。这不就是我们人类最擅长的事情吗?看一眼,懂了,搞定。

结果呢?人类随便玩,100%全对。AI玩命算,0.43%。

你品,你细品。

一、这到底是个什么测试?

先别急着骂,让我给你解释一下这个测试在干嘛。

ARC-AGI-3是ARC Prize基金会推出的新一代AI基准测试。这套测试的设计者叫François Chollet,就是那个创造了Keras框架的大神。他设计这套测试的目的很简单——测出AI到底有多”聪明”,而不是有多”会背书”。

测试是怎么玩的?给你扔进一个从来没见过的游戏环境,没有任何说明书,没有任何教程。你得自己摸索规则,自己试错,自己想办法过关。

就像你第一次玩俄罗斯方块。没人教你怎么旋转、怎么消除,你就是看,然后试,然后突然开窍了——这根棍子放这儿能消一行。

这种事,人类做起来毫不费力。

AI呢?

AI在这个测试里,表现得像一个刚出生的婴儿盯着魔方。转来转去,瞎点一气,然后——超时了,下一个。

二、那些让AI集体翻车的题目

你可能会问:是不是题目太难了?

不,题目一点都不难。

有多简单?这么说吧,这些题目,三岁小孩看一眼都能做对。

比如,测试里有一道题,就是把画面里所有的红色方块找出来。人类看了一眼,抬手就点。AI呢?AI在那儿分析这个颜色是不是真的”红”,这个形状是不是严格意义上的”方块”,有没有可能”红色”只是光线问题……

然后超时了。

再比如,有一道题是让AI把一个物体从左边移动到右边。人类想了1秒钟:拖过去不就行了?AI想了五分钟:移动的轨迹应该怎么规划?速度要不要变化?到了右边要不要停下来?

你想的没错,AI在这些”简单题”上的表现,就像一个博士生在解小学一年级的加减法——他想得太多,反而算错了。

三、三大失败模式,看完你就懂了

ARC Prize团队分析了GPT-5.5和Claude Opus 4.7的测试录像,发现了三个特别有意思的失败模式。

看完你就会明白,AI到底在什么地方”卡壳”了。

失败模式一:看得见局部,看不懂全局

第一个失败模式最常见,ARC团队给它起了个名字,叫”True Local Effect, False World Model”——看得见局部变化,看不懂全局逻辑。

举个例子。AI在做一道题的时候,发现”按下ACTION3键,物体就会旋转”。它观察到了这一点。

然后呢?然后它就卡住了。

它知道ACTION3能让东西转,但它不知道为什么转了之后会改变什么,也不知道”转”这个动作应该和什么配合使用。它就像一个人学会了”踩油门能让车动”,但永远学不会”踩油门+方向盘=开车去目的地”。

局部观察≠全局理解。

这恰恰是人类婴儿都能做到的事情——三岁小孩摔过一次跤,就知道”往前走会掉下去”,这就是全局理解。AI不行。

失败模式二:认错游戏,张冠李戴

第二个失败模式叫”Wrong Level of Abstraction From Training Data”——把测试环境误认成了训练数据里的某种东西。

这个更绝。

AI在做一道镜子反射题的时候,看了半天,然后它的”内心独白”是:这不是镜子,这应该是俄罗斯方块。或者,这应该是贪吃蛇。或者,这应该是推箱子……

它把一个全新的游戏环境,硬塞进了它”见过”的那些游戏的框架里。就像你第一次看到咖啡机,硬把它认成了饮水机,然后在那儿研究怎么接热水——咖啡粉?你没看到,你不知道那玩意儿。

AI永远在用旧知识解释新问题,而人类永远在学习新规则解决新问题。

失败模式三:会做题,不会学

第三个失败模式最扎心,叫”Solved The Level, Didn’t Learn The Game”——把这道题做对了,但是没学会这个类型的题。

这就像什么呢?就像你背会了一道数学题的解题过程,然后换了几个数字,你就又不会了。

AI在ARC-AGI-3里的表现就是这样。做对了一道题,你以为它”懂了”?不,它只是恰好找到了答案。下一道同类型的题,它又懵了。

而人类呢?人类做对一道题,立刻就能总结出规律,然后举一反三。这才是真正的”学会”。

做题≠学习。这是AI和人类最本质的区别。

四、为什么AI这么”聪明”又这么”笨”?

你可能想问:不对啊,AI不是能写代码、能画画、能写文章吗?怎么会连这种”三岁小孩题”都做不对?

好问题。

这就要说到AI的工作原理了。现在的AI,尤其是大语言模型,本质上是一个”超级预测机器”。

它为什么能写文章?因为它见过太多文章了。它能预测”下一个词最可能是什么”。它为什么能画画?因为它见过太多图片了。它能预测”这个像素应该是什么颜色”。

换句话说,AI的强大,来自于它的记忆力和模仿能力,而不是真正的理解。

ARC测试的设计者Chollet说过一句话,我觉得特别到位:

“你可以靠记忆来获得技能——把一切都存进一个查找表里。但智能的本质,是你遇到完全没见过的任务时,能够多快地去理解它。”

翻译成人话就是:背书厉害不等于聪明。遇到新问题能快速搞懂,这才是真聪明。

而现在所有的AI,都在做一件事:把新问题变成老问题。

如果新问题和训练数据足够像,它就能答对。如果完全不像?不好意思,它就会开始胡说八道,开始”幻觉”,开始瞎猜。

五、这对普通人意味着什么?

好了,道理我都懂了。但是——这跟我有什么关系?

有,而且关系大了。

你想想,这些年你是不是被AI的各种宣传轰炸过?”AI要取代医生””AI要取代律师””AI要取代程序员””AI要取代设计师”……

各种AI厂商的发布会,一个比一个炸裂。一个个数字高得吓人——99%、98%、95%……

但你现在知道了:在真正考验”智商”的测试上,AI连1分都拿不到。

这说明什么?

第一,AI没有你想象的那么强。它能做好很多事,但它做不好的事更多。至少在”遇到新问题自己解决”这件事上,AI还差得远。

第二,你的核心竞争力还在。那些需要创造力、需要灵活应变、需要真正理解的工作,AI短时间内取代不了你。你的”举一反三”能力、你的”触类旁通”能力,是AI花几十亿美元也学不会的东西。

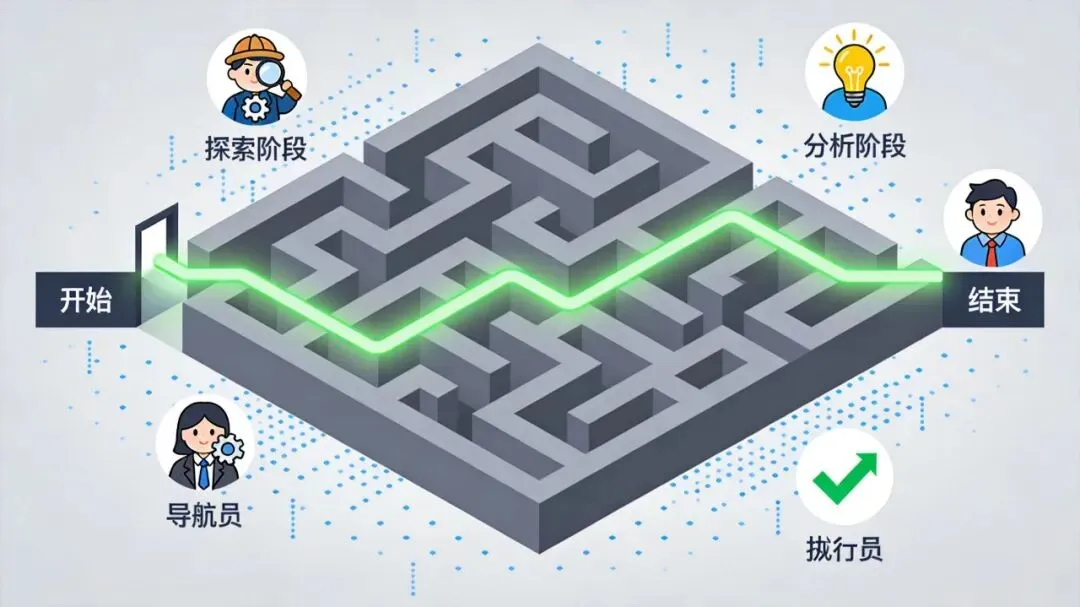

第三,学会和AI合作,比害怕AI更重要。AI不擅长从零开始理解新问题,但它特别擅长在你给定的框架里高效执行。你要做的,就是成为那个”定义问题”的人,让AI去做”执行问题”的工作。

六、所以,AI到底是真聪明还是假聪明?

现在回到最初的问题:AI到底是真聪明还是假聪明?

我的答案是:AI在某些方面是真聪明,在某些方面是假聪明。

它能背书、能模仿、能预测——这些方面,它确实比人类强,而且强得多。

但它不会真正理解、不会举一反三、不会遇到新问题自己摸索——这些方面,它连三岁小孩都不如。

就像一个把字典背得滚瓜烂熟的人,你能说他”懂语言”吗?他能告诉你”苹果”是什么意思,但他永远学不会”苹果为什么会被牛顿砸到”这种新的比喻。

AI是超级学霸,但不是真正的智者。

所以别慌。

你的工作不会那么快被取代。你要做的,是学会用AI这个超级工具,但永远保持你自己”理解问题、解决问题”的核心能力。

那句话怎么说来着?

AI负责执行,你负责定义方向。

记住这一点,你就永远不会输。

——

我是普通人用AI,每天分享一个AI实战技巧。

关注我,看懂AI,用好AI。

我们下期见。

夜雨聆风

夜雨聆风