AI耗电量也能秒算了?MIT新工具让数据中心节能成真

大家好,我是三楼楼长。

AI发展太快了。

根据劳伦斯伯克利国家实验室的预测,到2028年,数据中心将消耗美国总电力的12%。

这不是吓唬人,是实实在在的电力需求。

训练一个大模型,烧掉的是真金白银的电费。

MIT最近搞了个新工具,能快速估算AI工作负载的能耗,几秒钟就能给出可靠结果。

传统方法要几小时甚至几天。

这事儿很有意思,我给你拆解一下。

为什么要算能耗

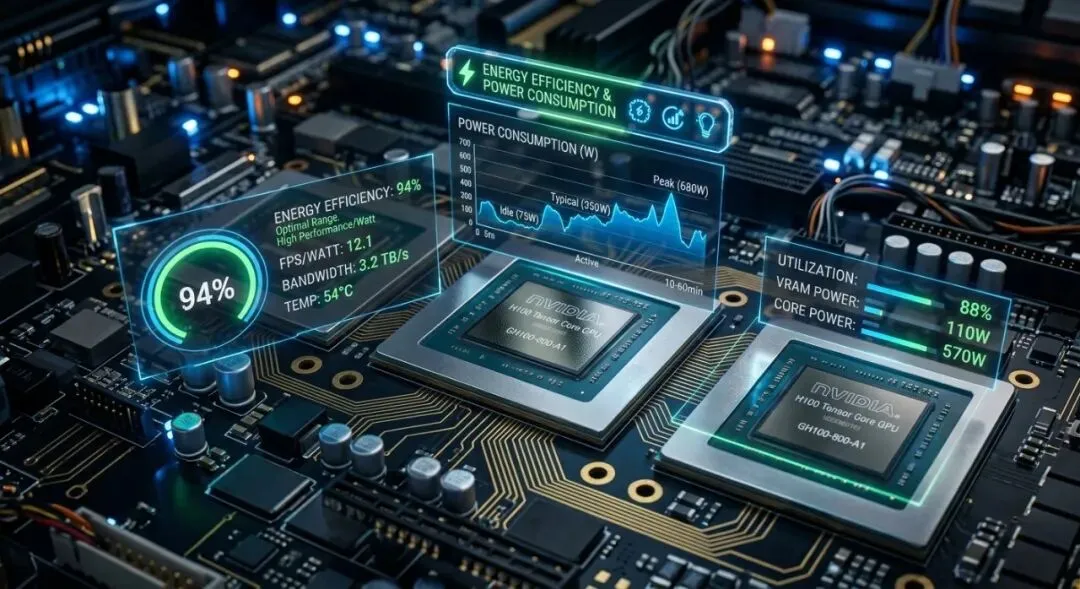

数据中心里,成千上万个GPU在跑AI模型。

每个GPU的耗电量,都跟它的配置和工作负载有关。

要找到最节能的运行方式,就得先知道不同配置下耗多少电。

问题是,传统方法太慢了。

把工作负载拆成单个步骤,一步步模拟GPU内部模块的运行——这种仿真跑一次就要好几天。

数据中心的运营者想对比不同算法或配置,等结果出来黄花菜都凉了。

MIT的思路:快比准更重要

MIT和MIT-IBM Watson AI Lab的研究人员想换个思路。

他们发现AI工作负载里有很多可重复的模式。

这些模式可以用来生成快速但可靠的功耗估算信息。

算法开发者写程序时,会做各种优化——把任务分配到并行处理核心,高效地移动数据块。

这些优化创造了一种规则结构。

MIT的研究人员就利用这种结构,开发了一个轻量级的估算模型,叫EnergAIzer。

8%误差,几秒出结果

光有快速估算还不够准。

每次GPU运行程序,都有固定的启动能耗。

每次处理数据块,又有额外的能耗。

硬件波动、数据访问冲突,这些都会让GPU无法用满带宽,拖慢速度,增加能耗。

研究人员收集了GPU的真实测量数据,生成修正项,加到估算模型里。

这样既快又准。

测试结果显示,EnergAIzer的能耗估算误差只有8%左右。

跟传统方法相当,但速度从几天变成几秒。

这个工具能干什么

数据中心运营者可以用它来分配资源,提高能效。

算法开发者可以在部署新模型前,先评估它的能耗。

甚至可以调整GPU配置或运行速度,看看这些设计选择对整体能耗的影响。

更重要的是,这个工具还能预测未来GPU和新型设备配置的能耗。

只要硬件在短时间内不发生剧烈变化就行。

真正的可持续性

MIT博士后Kyungmi Lee说得好:

“AI的可持续性挑战是我们必须回答的问题。因为我们的估算方法快速、方便,能直接给出反馈,我们希望这能让算法开发者和数据中心运营者更愿意考虑减少能耗。”

要真正实现可持续发展,需要一个能快速估算能耗的工具,让硬件设计师、数据中心运营者、算法开发者都能更关注能耗。

这个工具是朝这个目标迈出的一步。

我的看法

这个事情有两层意义。

第一层是技术层面。

快速估算能耗,能让AI部署更高效,降低运营成本,减少能源浪费。

第二层是意识层面。

当能耗估算变得简单快速,人们就会更关注这件事。

关注就是改变的开始。

AI发展这么快,能耗问题解决不了,就是给自己挖坑。

MIT这个工具,给这个坑填了第一块土。

如果你也关注AI的可持续发展,欢迎点赞、在看、转发,让更多人看到这个方向。

原文链接: https://news.mit.edu/2026/faster-way-to-estimate-ai-power-consumption-0427[1]

引用链接

[1]https://news.mit.edu/2026/faster-way-to-estimate-ai-power-consumption-0427

夜雨聆风

夜雨聆风