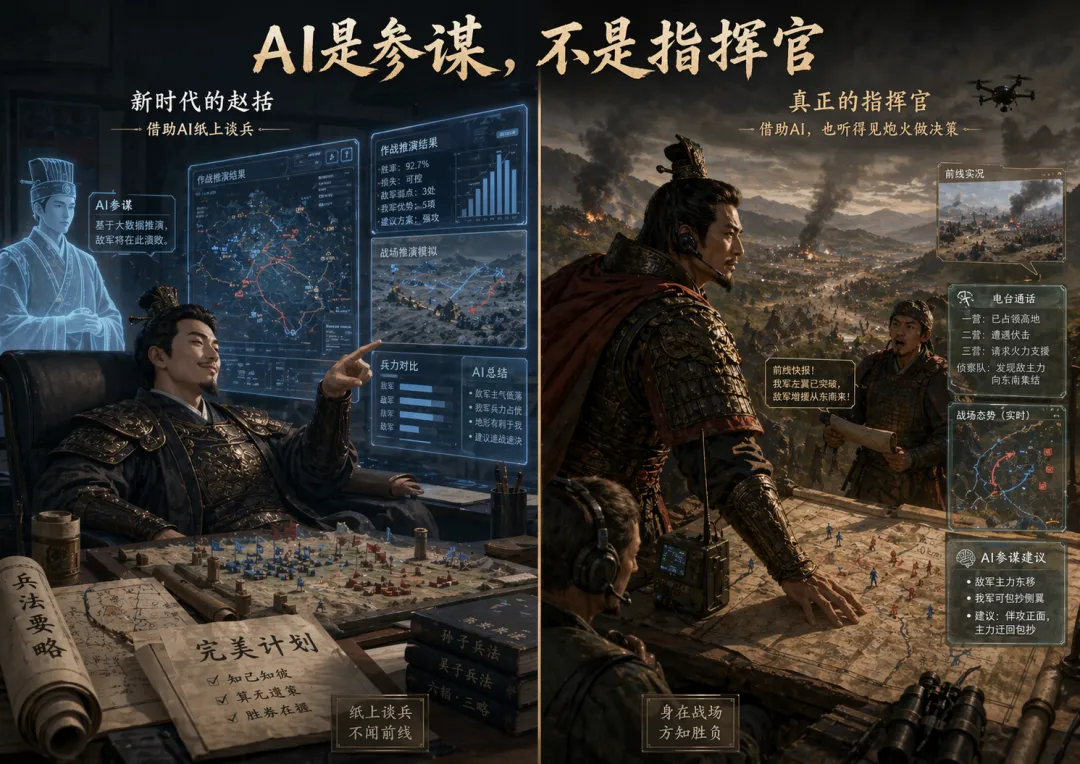

AI是参谋,不是指挥官

任正非有句很著名的话:让听得到炮火的人做决策。

这句话放在 AI 时代,会显得格外重要。

因为今天,我们第一次拥有了一个异常强大的“参谋部”。它会看地图,会读情报,会做推演,会写 briefing,会给方案,甚至还能很快搭出一个原型。它反应极快,知识极广,几乎不知疲倦。

问题也正在这里。

参谋越来越强了,很多人却在听完参谋汇报后,误以为自己已经会打仗了。

中国历史里,赵括“纸上谈兵”一直是个反面典型。后人拿它来提醒自己:不要把图上正确,误当成战场正确。到了 AI 时代,这个典故有了新版本:不再只是读了兵书就以为自己会打仗,而是听了超强参谋的汇报,看了沙盘推演、行动方案和路线拆解,就误以为自己已经具备了指挥能力。

我是在三个完全不同的场景里,越来越清楚地意识到这一点的:读书、写代码、还有试图理解一个行业并寻找创业方向的时候。

它们表面不同,底层却是一回事:AI 都在帮我快速生成某种结果的外观,而现实反馈才决定这套外观会不会真正长到我身上。

一、读书:AI给的是缩略图,实践后的反馈才形成认知

我第一次强烈意识到这一点,是在读《原则》的时候。

AI 把这本书嚼得很碎。导读、提要、框架,一层层铺开。那种感觉很容易让人上头:重点我知道了,结构我懂了,核心思想我也抓住了。这本书,我差不多已经读过了。

直到后来真正翻开原书,看到那句:“拥抱现实,应对现实。世界上最重要的事情是理解现实如何运行,以及如何应对现实。”我立刻知道,两者之间隔着很深的河。

AI 给我的,是缩略图。

原书给我的,是高清地形图。

缩略图让我快速知道这片地方大概长什么样。

高清地形图让我看见山脊、河谷、坡度、岔路和地貌细节。

但即便如此,这还不是真正属于我的认知。

真正让我开始理解这句话的,不是在导读里,也不只是翻开原书的那一刻,而是后来我试着按这些原则去看问题、做判断、处理事情时,现实不断给我的反馈。

有些判断,在脑子里觉得很顺,一落到现实里就撞墙。

有些原则,看起来懂了,真正用起来才发现自己并没有那么相信。

有些话,读的时候只是“有道理”,做过之后才变成“我知道它为什么对,也知道它哪里难”。

那时候我才明白:

知道一本书在说什么,不等于真的读过它;

读过它,也不等于真正理解它;

真正的理解,不是把书里的结论复述出来,而是你按书中的原则进入现实,在反馈里碰壁,在复盘中修正,最后把别人的原则慢慢变成自己的认知。

如果说 AI 导读给我的是缩略图,原书给我的是高清地形图,

那么实践之后留下的判断,才是真正属于我的地图和路感。

二、写代码:AI给的是原型,部署和修改中的反馈才形成掌控

借助 Claude Code,我很快搭出了一个股票投研系统原型。那种体验非常容易让人上头。脑子里原本模糊的设想,经过几轮来回,很快变成一个能跑的东西。流程出来了,功能出来了,界面和接口也开始像回事了。

这种速度会迅速把人的自信推高。

你会觉得:原来很多事情并没有想象中那么难。

再往前一步,就很容易滑向另一个更危险的判断:既然它已经跑起来了,那我应该已经掌握它了。

但后来我才明白,原型能跑,和系统在我掌控之中,是两回事。

原型成立,只能说明这套想法大致可行。

真正的工程掌控,考验的是另一套东西:多环境部署、依赖和配置、日志和异常、模块边界、改动影响面、客户需求变化后的维护路径。

这些问题,在原型阶段通常不会全部暴露。

可一旦系统开始接触真实环境,它们就会一个个站出来。

后来现实真的来了。

系统要跑在不同环境里。

客户开始提修改。

代码不再是一把梭跑通就结束,而是要反复改、持续改、带着约束地改。

这时候,问题已经不是“能不能再让 AI 生成一段代码”。

真正的问题变成了:我知不知道该改哪一层?知不知道这一处改动会牵动什么?脑子里有没有这套系统的内部结构图?

我很快发现,我没有。

问题刚出现的时候,我的第一反应不是回到系统内部,重新梳理结构、定位边界、判断影响面,而是继续向 AI 要答案:补一个 prompt,再试一版,换一种说法,再生成一段,也许这次就能把问题绕过去。

一开始,这种方式看起来是有效的。

局部问题被临时补上了。

新代码也能继续跑。

但系统并没有因此变得更清晰,反而越来越像一层层补丁叠上去的东西。

我开始越来越依赖“下一版答案”,而不是越来越理解这套系统本身。每一次修改,看起来都解决了一个点,实际上却让我更不清楚:这套系统的边界在哪里,真正的脆弱点在哪里,哪些模块是牵一发动全身的,哪些地方只是表面问题。

直到后来我想自己动手改,才真正撞见那个事实:这些代码虽然在我的电脑里,也确实是我借助 AI 搭出来的,但它们并没有在我脑子里形成一张清晰的内部结构图。

所谓“不真正属于我”,不是说它不是我生成的,

而是说一旦它出问题,我无法独立判断该从哪里下手,无法预估改动会带来什么连锁反应,也无法在没有 AI 帮助的情况下继续稳定推进。

那时我才真正意识到:

AI 很擅长帮我把一个想法迅速压成一个原型,

但它不会自动把系统的结构理解、工程 ownership 和维护判断,一起迁移到我身上。

原型是方案。

部署、报错、耦合、客户真实需求,才是炮火。

原型能跑,不等于我已经会打这场仗。

三、创业:AI给的是赛道地图,真实推进中的反馈才形成判断

第三次,是在我试图理解一个行业、寻找创业方向的时候。

在这件事上,我并没有一个足够完整的创业案例,可以拿出来证明我已经真正打过这场仗。

但也正因为如此,我反而更清楚地看见了另一件事:AI 太容易在真正上场之前,就给人一种“我已经看懂了”的感觉。

一段行业分析出来,赛道格局清楚了。

一份方案出来,切入路径清楚了。

几轮来回,玩家、模式、风险、机会点都像被摊平在眼前。

那种感觉很像突然开了全图:行业像是看懂了,方向像是有了,剩下只差执行。

可问题在于,这种“看懂”,大部分还停留在参谋部里。

客户还没真正见。

需求还没被反复验证。

钱还没真正收进来。

取舍还没在资源约束下被逼出来。

失败信号也还没真正出现。

我并不是已经打过这场仗。

我只是先听了一场非常精彩的战前汇报。

这时最危险的事就发生了:

虽然没有真实案例支撑,我却已经开始拥有一种近似成熟判断的感觉。

我能讲出赛道逻辑,能复述商业模式,能分析机会和风险,甚至能说出几条看起来很像样的路径。

但真到要决定先做什么、先验证什么、先放弃什么时,我并没有一套真正经过现实检验的判断框架。

那时我才意识到,AI 很擅长帮我把一个行业迅速压成地图,

但它不会自动把创业者在不确定中形成的判断力,一起迁移到我身上。

分析是参谋报告。

真正的炮火,是用户反馈、付费行为、推进受阻和失败信号。

地图展开,不等于我已经会打这场仗。

四、AI时代最大的风险,不是参谋太弱,而是指挥官忘了去前线

所以我后来越来越明白,AI 最大的风险,不是它偶尔会错,而是它太容易制造一种“我已经会了”的感觉。

它给你全局,给你结构,给你提要,给你原型,给你像样的答案。

但它不会自动把能力迁移到你身上。

于是我们把提要误认成阅读,把原型误认成掌控,把视野误认成经验,把参谋意见误认成自己的判断。

这也是为什么,任正非那句“让听得到炮火的人做决策”,到了 AI 时代会变得格外重要。

它今天的新含义,不是不要 AI,也不是不要参谋部,

而是:不要让参谋汇报替代炮火反馈。

真正有效的决策,从来不是参谋部单方面生成出来的,而是参谋分析、前线反馈和指挥官判断之间,不断往复校正的结果。

所以 AI 时代最重要的,不是“会不会用 AI”。

而是你能不能守住自己作为指挥官的职能。

参谋可以越来越强。

地图可以越来越清楚。

推演可以越来越漂亮。

但最后下判断、担责任、承受后果的,仍然只能是指挥官。

离开 AI,你还能不能把问题讲清楚?

还能不能解释自己的取舍?

还能不能推进下一步,而不是停在解释里?

如果不能,那你拥有的多半只是能力的外观,而不是真正的能力。

AI 是参谋,不是指挥官。

任正非提醒我们:让听得到炮火的人做决策。

赵括提醒我们:不要把图上正确,误当成战场正确。

把这两句话合在一起,就是 AI 时代一条新的生存原则:

可以用最强的参谋部,但不要脱离炮火做决策。

地图要看,推演要做,参谋意见要听;但真正让判断变得可靠的,始终是进入现实、接收反馈、不断修正。

不然,参谋越强,人越容易变成高配版的赵括。

夜雨聆风

夜雨聆风