劳动节快乐|我的 OpenClaw 产品大赛参赛作品

这阵子公司在密集地办 OpenClaw 产品大赛,指引大家都来参与一把。

我没赶上下场。一是身份上要避嫌,不便去和同事们抢这个风头;二是手里几个在跑的小东西,实现路径还在打磨,直接拿到大会上讲不太合适,自己也不太满意。

但题既然出了,作为一个旁观者也想认认真真交一份答卷。所以有了这篇文章——你可以把它看作一份迟到的、写给同好者的参赛作品。

说在前面:我不是技术出身,下面分享的也称不上什么“方案”,更像是一个普通使用者在工具迭代到今天这个程度之后,攒起来的一点小经验。如果其中有任何粗糙或不准确的地方,或者你有更好的做法,特别欢迎在评论区指点——我也还在边用边改。

OpenClaw 在这个项目里是底座

这一两年智能体仿佛雨后春笋。从 Manus、Devin 这样的通用型,到 Cursor Agent、Cline、OpenHands 这类偏码场,再到 ChatGPT Agent、Gemini Agent 和 Hermes 这类开源框架——不同路线同时在走,能力边界几乎一周一变。

但热闹归热闹,真要把一件小事每天稳定跑下来,立刻就会发现问题:脑(推理)、手(投递)、腿(采集)三件事,没有一个上层平台兜着,散在各处的工具是合不上环的。

OpenClaw 在这个项目里,干的就是“兜着”的活。

我把整个 OpenClaw 看作一个单兵的工作底座:

-

它给我统一的身份与权限——所有 agent、所有连接器、所有调度都在同一个工作空间里被管起来,不用再去拼 API key、拼 OAuth。 -

它把 Notion 数据库、企微、邮件、日历这些日常通道接成现成的连接器——晨报落档案、发提要、回看历史,都不用我自己去造管道。 -

它为 agent 提供调度、运行环境和边界——cron、agent mention、按钮触发、跨触发器复用同一个工作空间,这些是让”每天清晨自动跑一遍”能成立的前提。

也就是说,真正让一个普通使用者能在周末搭起这套晨报、并且每天稳定跑下来的,是 OpenClaw 这个底座。在它之上,我才能把”脑、手、腿”这套分工分清楚:

-

脑:推理交给 Claude Code——这一档智能体里我用得最顺手的一个,走月卡额度,边际成本接近于零。 -

手:投递交给 OpenClaw 上的 agent——写 Notion 数据库、推企微提要卡片、按需触发回看,这是 OpenClaw 最擅长的事。 -

腿:纯采集与清洗(Polymarket、RSS)写成轻脚本,不上 LLM。

这套分工想清楚之后,这个项目的形状就清楚了:它是一个搭在 OpenClaw 上的小晨报 agent——OpenClaw 是底座,Claude Code 是被调用的推理工具,脚本只跑数据。三层各司其职,缺一不可;但让这件事在我一个人手里能落地、能持续的那一层,是 OpenClaw。

这也是我这篇最想分享的第一个观察:在今天这个工具水位下,单兵能不能搭一个像样的小产品,关键不在调用了哪个最聪明的模型,而在你有没有一个把分工兜住的底座。

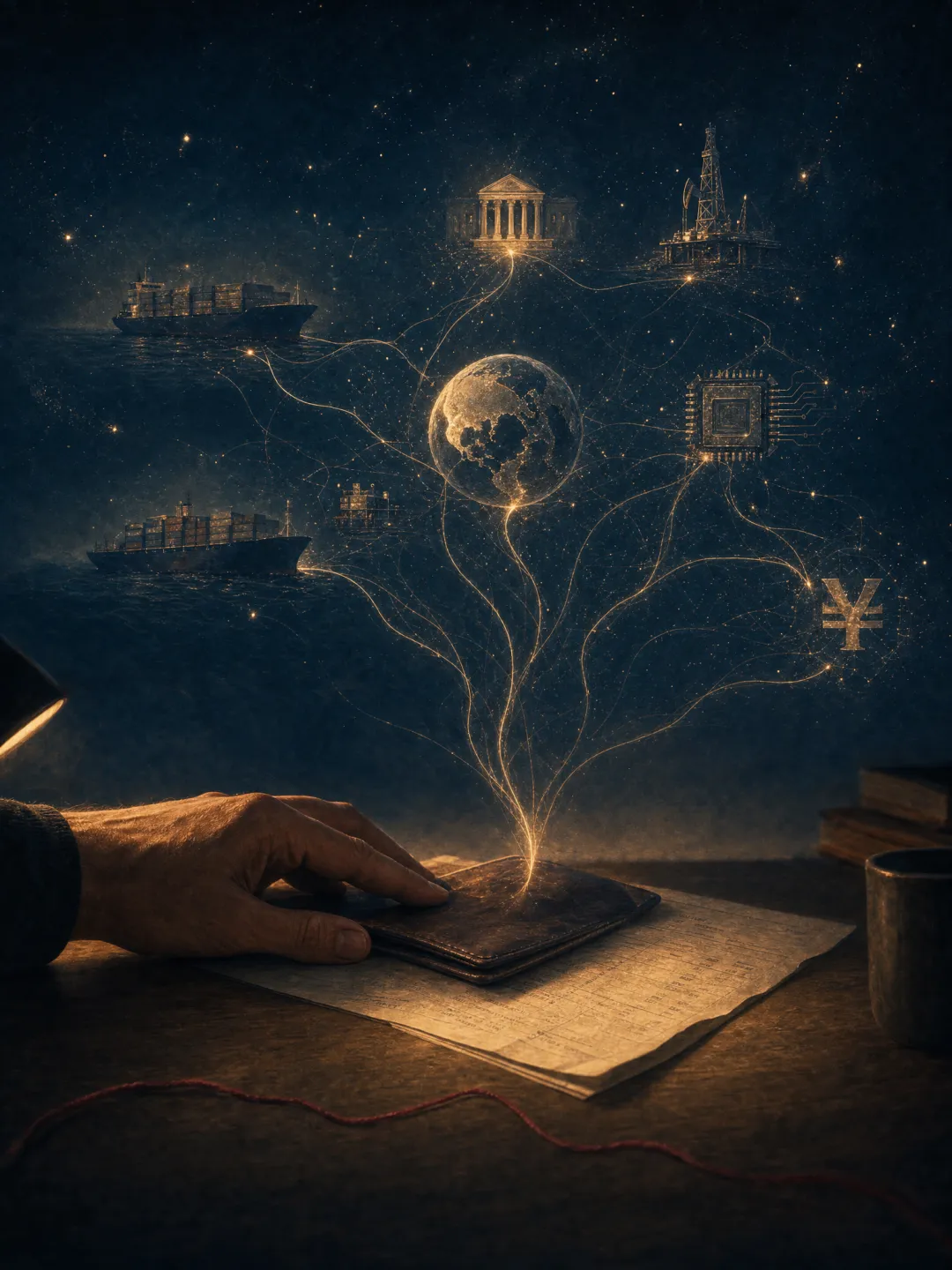

我为什么给自己做了一份地缘晨报

中年男人有一个共同的毛病:宏大叙事病。

几个中年男人聚在一起,三杯下肚,谁也不聊孩子作业、谁也不聊业绩报表,永远在聊关税、台海、AI 失业、特朗普、美元霸权——尺度越大越带劲,越宏大越上头。年轻人看这场面会觉得好笑:这帮人,能改变世界吗?

但仔细一想,这病也不是全无道理。

宏大叙事看上去离个人很远,其实每一根线最后都通到账户收支。中美关税真打起来,你做出口生意的朋友这个月没单;美元加息周期一拐弯,你的房贷、你换出去的美金、你的港股仓位全部跟着抖;AI 迭代到下一档,你这个岗位可能就没了。所以这不是空谈,是跟中年男人钱包贴得最近的一类话题。只是聊起来像空谈,因为聊的人手里没有抓手,把”宏大”翻译成”今天我该怎么动”。

中登老登们最想要的,其实是一手信息。

但这件事几乎不可能。一手信息要么在那几个真正手握牌的人桌上,要么在能影响政策的小圈子里——你我都不在那张桌上。能拿到的,都是被层层转述、层层加工、层层带情绪之后的二手三手新闻。键政上瘾,很多时候就是因为试图用大量二手信息去拼凑出一手信息的形状,结果越拼越乱、越拼越躁。

那有没有一个比新闻更”硬”一点的渠道?我后来慢慢相信:有,是 Polymarket。

坊间一直流传一种说法——江学勤老师近几年那些命中的预测,很多是回溯 Polymarket 这类预测市场之后做出来的。听上去玄,但实际并非无稽之谈。Polymarket 这一类基于虚拟货币的预测市场,本质上是大型资本口味的一个缩影:能在上面下重注的人,掌握的信息密度、决策成本、风险偏好,本就不是普通散户的层级。当你看到某个 market 在 24 小时内成交几十万美金、概率被推动了 5 个百分点,那不是一群网友在玩游戏,那是某些不便公开发声的资本,在用钱说话。

它当然不等于真理。但在饭桌上聊关税、聊台海、聊 AI 的中年男人手里,它是离一手信息最近的一个公开口子。

最后一个问题:这件事为什么放到今天才能做?

两年前我如果说”我想每天清晨自动收到一份回溯 Polymarket、对照地缘框架、写给中年男人看的晨报”,市场上没任何工具能让我一个人把它落地——除非我去找一支工程团队、说服他们这件事值得做。但今天 Claude Code 这一类工具,让单兵搭这样一条管道变成了一件周末就能做完的事。我不再需要说服任何人,我只需要花一个晚上把它做出来。

剩下的,就是每天清晨多五分钟、少一点宏大叙事病。

我是怎么搭出来的(点到即止,但完整可复制)

prompt 原文这里不展开(感兴趣可另聊),但思路、架构、关键决策、避坑点全部交底——足够你拿 Claude Code 一夜复刻一份自己的。

一、整体思路

三句话:

-

算力分工:Claude Code 做脑、OpenClaw 做手、脚本做腿。每件事交给最便宜、最擅长的那一方。 -

市场与框架分离:Polymarket 价格 = 事实层,博弈论框架 = 假设层,正文里必须分开写。永远不替自己下结论,只标示两者的张力。 -

稳定层叠:手动跑通 → 读样本 → 调提示词 → 才能上 cron。一步不能到位。

二、架构示意

五步一条线,剩下都是野路。

-

cron 06:30 → 定时触发。 -

fetch.py → 采集 Polymarket Gamma API(主信号)与英文严肃媒体 RSS(辅助,近 12h 标题),输出 raw.json。 -

build-context.py → 双阈值筛选(成交 > $50k 且 概率变动 > 5pp)+ 从博弈论 / 地缘讲稿库召回框架摘录,输出 context.md。 -

Claude Code Headless → 跑人格化 prompt,写出 report.md。 -

deliver.py → OpenClaw 写入 Notion 数据库主档,同时推送企微提要卡片。

report.md 的五段式结构:

-

市场异动 Top 3:market + 概率 + 24h 变动 + 一句事实背景,不加解读。 -

结构透视:从 Top 3 里选一个,调用框架摘录做 150 字解读,点出市场与框架的一致 / 偏离。 -

冷门雷达:成交异动但价格未动的早鸟信号;无则明说”今日雷达安静”。 -

个人议题:绑定自己的长期轴线,点评相关变动。 -

一句按语:非结论、非建议,只是观察或提醒。

三、几个真正花了时间的关键决策

-

主题白名单只锁 6 个:市场上每天有几千个 market,全部铺开就是噪音。锁住”中美关税 / 俄乌 / 美伊 / 台海 / 美联储宏观 / 美国政治”六条线,信噪比立刻可读。 -

双阈值筛信号:$50k 成交 + 5pp 变动。低流动性 market 的价格漂移基本是噪声,必须挡掉。 -

五段式产出结构:不是”今日新闻 N 条”。Top 3 / 结构透视 / 冷门雷达 / 个人议题 / 一句按语——这个结构反复调了几轮,目前是我读起来最不费力的版本。 -

人格设定:克制、文雅、不堆形容词、不用感叹号;中文为主,专有名词保留英文原文。这一块是 prompt 工程量真正所在。 -

算力账:月卡不是调用。所有推理走 Claude 月卡,边际成本几乎为零;OpenClaw 只跑投递,不耗 OpenRouter token。这一划下去,每天的账就是”包月份”而不是”按调用付”。 -

投递分工:Notion 是主舞台,企微只发卡片:企微机器人的 markdown 是子集,不渲染表格、不渲染嵌套列表,且单条有 4096 字节上限。五段式跑满的晨报,想在 IM 里读完是为难的。所以最后拆成两层:Notion 是主舞台——五段式、表格、链接、可回看历史;企微只负责”勾人”,每天清晨弹一条 30 秒能扫完的提要(全局冷热一句 + Top 3 market 名 + 一句按语 + Notion 链接),正文不在企微展开。这个取舍跟“产品该在哪读”有关:IM 天然适合“提醒”,不适合“读文档”。

四、避坑清单(我踩过下面几个)

-

市场 vs 框架必须在 prompt 里硬性分开。一旦混在一起,LLM 会替你下结论——而下结论本该是你自己的工作。 -

**不要让 LLM “从零创作”**。每一条市场异动要挂载真实数据,每一段框架要能追溯原文,避免幻觉让产出”看上去专业其实胡说”。 -

**允许 LLM 说”今日雷达安静”**。否则它会为了填满 N 条挤出不抵事的判断,这是最伤信任的。 -

周末与工作日分两套提示词。周末市场流动性低、消息面薄,照工作日的阈值跑出来全是噪音。 -

context 与每日素材分两段传。背景锁死不动,每天只换素材那一段,调优更稳、token 也省。 -

cron 里显式指定 source 与代理。否则 GitHub Actions 类环境里时区、网络、Python venv 都会埋坑。 -

改配置前先 .bak 快照。我栽过几次:改完跑出来一团糟,回不去最后一份能用的。 -

超时熔断 + 优雅降级。timeout 900s 强制熔断;任一源挂掉记 warning 继续跑,不要让一个 502 拖垮整条流水。 -

先落 Notion 再推企微。Notion 是档案,企微是通知。推送失败可以重跑,数据不会丢。

五、复刻路径(一夜可起点版)

四个文件就够了:fetch.py(拉 Polymarket + RSS)、build-context.py(双阈值筛 + 框架召回)、run-morning.sh(cron 入口,调 Claude Code Headless 跑 prompts/morning-report.md)、deliver.py(写 Notion + 推企微)。

拿着上面的思路、架构和决策,丢给 Claude Code 一句话就能出 MVP:”按这套分工和五段式给我搭起来,prompts 单独建一个 markdown 我自己写。”剩下的全部是读样本、调提示词、加守护。

这个项目还能往哪走

MVP 跑起来之后,我给自己列了四圈往外扩的路线,越外圈越偷懒,但不代表不重要。

第二圈:让信号更准

-

主题池从 6 扩到 10:加入期中选举 / AI 治理 / 能源 / 气候金融等与长期轴线相关的纯度高的 market 簇。 -

多源对照:在 Polymarket 之外,并入 Kalshi、PredictIt 的同一主题 market,用三市场价格偏离反手检验各自的噪声。 -

异动 z-score 聚类:不再单看单个 market,而是看同主题下多个 market 的偏离是否同调 —— 类似”仓位词云”。 -

框架讲稿向量化:把博弈论 / 地缘讲稿包起来走嵌入 + 检索,召回从”关键词匹配”升级为”语义匹配”。

第三圈:让交付更厚

-

日报 → 周廓清 → 月复盘 → 季度报告:同一套 pipeline 在不同时间粒度上叠加,周度才能看出趋势,月度才能复盘调仓。 -

对话式回看:让晨报 agent 可被追问——”上周关于中美关税的预测现在怎么变了”、”上个月哪些判断被现实打了脸”,这是报告变产品的关口。 -

双模型分工:Sonnet 跑每日供稿(便宜、够用),Opus 跑月度趋势复盘与重大事件重读(贵些、但深)。

第四圈:用同一套架构看别的事

这是最让我脸红的一圈。根本逻辑是:一旦你拥有一套”预测市场 + 框架库 + Claude Code 推理”的管道,它就不只能看地缘。

最让我点火的是世界杯赛事盘。同一套管道拿去跑体育 market,可以一层套一层地问三个问题:

-

🥉 弱命题:预测市场的赔率,到底比专家盘口 / 随机基准准多少?这一层不需要阴谋论,就能跑出一张实证表。 -

🥈 中命题:赛前 / 半场异常资金流入能不能预示结果?这是在测试”内幕信息是不是在定价”——只要有人提前知道了什么,资金会愿意说出来。 -

🥇 强命题:资本是否能反过来干预结果(判罚 / 球员状态 / 裁判)?这一层证据门槛极高,但问题本身值得问。

重点不是“强命题一定能被证明”,重点是:即使什么都证不到,一张”市场共识 vs 现实结果”的对账表,本身就是一架社会显微镜。它能告诉你人类集体在哪里常常看走眼、哪些领域的预测能力越过了专家、哪些反而倒退。这是预测市场被低估的价值。

执行上不需要重起炉灶:2026 世界杯开幕那个月,复用同一套 pipeline、换一套主题白名单和人格提示词,跑一个月收摊,留一篇复盘。

一句路线图

第一圈跟得上,第二圈信号准,第三圈交付厚,第四圈架构延展。真正的杠杆不在工具,在你愿意持续把哪一层问题往下问。

一点感受

做完之后回头看,这个项目对我自己的最大价值,可能不在于它每天产出的那份简报本身,而在于它逼我把“我到底想从地缘信息里得到什么”这个问题,真正想清楚了一遍。

工具到了今天这个水位,你能不能问出对的问题,比你会不会写 prompt 重要得多。

如果你也在攒类似的东西,或者想在自己的领域复刻这个思路,我也还在持续迭代——欢迎在评论区交流,听到不同视角对我帮助很大。

夜雨聆风

夜雨聆风