AI出题居然会漏条件、错答案——这5个坑你踩过几个?

AI 出的题,为什么用起来总感觉哪里不对?

不是你眼光高,是真的有问题。

我梳理了教师最常遇到的5种情况,你可能全中过。

先说一个很多老师都有的感受。

打开 AI,让它出一套数学练习题,出来了,看着挺好。题型有、数量对、答案也附上了。

然后拿去用,问题就来了。

有的题答案算出来不对,有的题学生说“老师我们好像没学过这个”,有的题让学生做,做到一半发现根本做不出来,不是学生不会,是题目本身条件缺了一块。

你会发现,这种“哪里不对但说不清楚”的感觉,其实背后有规律可循。

我把它总结成5个问题,一个一个来说。

5个坑,99%的老师都踩过

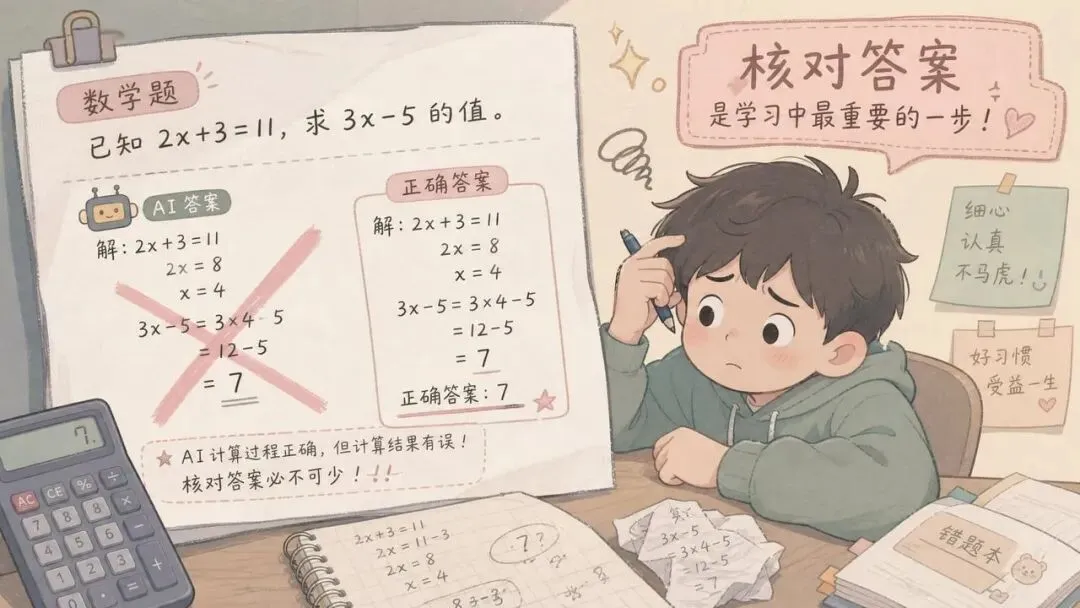

问题一:答案出错

这是最直接的问题。

AI 不是计算器,它的数学和科学知识有时候会出错,尤其是涉及多步计算、条件复杂的题目。

你会发现,有时候题目本身写得挺像那么回事,但答案就是错的。如果老师没有逐题核对就发出去,学生对着错误答案学,危害其实挺大。

问题二:悄悄超纲

这个问题更隐蔽。

AI 不知道你的教材进度,也不知道这个班上到哪里了。它只知道这个知识点“一般会涉及什么”,然后按照一个模糊的“平均标准”出题。

结果就是,有些题用了学生还没学过的概念,或者难度跳得太快。学生做不出来,不是因为没认真,是因为题目压根就不在他们现在的范围里。

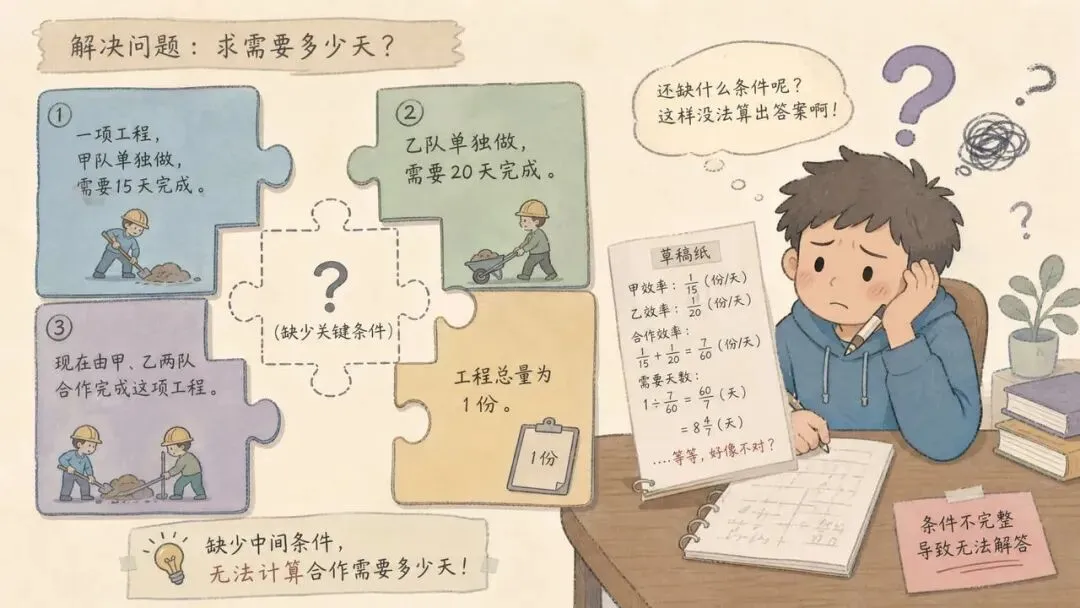

问题三:条件不完整,导致无解或多解

这是我觉得最容易被忽视的问题。

AI 在生成应用题的时候,有时候会漏掉某个关键条件。题面看着流畅,但一算就发现缺东西,学生算半天算不出来。

更麻烦的是多解的情况,题目条件不够精确,导致有多个合理答案,而 AI 只给了一个。如果拿来考试或测验,怎么评分都是问题。

问题四:难度飘移

你跟 AI 说,出三道基础题、两道提升题,结果出来的五道题难度差不多,或者它理解的“提升题”跟你理解的完全不一样。

这不是 AI 在故意敷衍,而是它对“难度”的判断,跟你对这个班学情的判断之间,有一道很大的信息鸿沟。

你知道你们班有多少学生连基础都没扎稳,AI 不知道。

问题五:开放题价值导向有偏差

这个问题在语文、道法、历史等学科里比较常见。

开放性题目,AI 有时候会给出一个“中性答案”,或者价值取向模糊的参考答案。直接拿来用,可能出现和教育目标不符合的情况。

这不是说 AI 的价值观有问题,而是它没有办法像一个真实的、了解这门课教育目标的老师一样去设定题目的导向。

根本原因:你和 AI 之间信息断层

说到这里,你可能会问:那为什么这些问题这么常见?

根本原因只有一个。

大多数老师在用 AI 出题时,给的信息太少了。

“帮我出10道数学题”——AI 收到这句话,能做的就是出10道它认为“差不多”的数学题。

它不知道你用的是哪个版本的教材,不知道这班孩子上次测验的平均分,不知道下周要考什么范围,不知道你想要几道选择、几道填空、几道解答。

信息越少,输出越模糊。

你会发现,这五个问题全都是因为“信息断层”造成的,不是 AI 不够聪明,是你和 AI 之间缺少一座桥。

最后那道门,只有老师能开

所以,怎么用才对?

我当了十年信息科技老师,这两年开始系统研究 AI 在教学里的用法。用 AI 出题这件事,我自己也走过这段弯路。

现在我的习惯是这样的——

拿到一个出题需求,我不会直接问 AI“帮我出题”,而是先让 AI 帮我做命题蓝图。

告诉它:学段、教材版本、知识点、这班孩子的大概水平、想要多少题、什么题型、难度怎么分布。让 AI 先把蓝图输出来,我看一眼,确认方向对了,再让它按蓝图出题。

这样出来的题,错误率会低很多。

但即使这样,我还是会做一件事:逐题过一遍。

至少检查:答案对不对、有没有超纲、条件完不完整、开放题的参考答案导向对不对。

这一步不能省。

AI 出题,是帮你把“出题这件事从零到有”的速度加快了。但题目进课堂的最后那道门,永远是教师的专业判断。

这不是 AI 的问题,这是出题流程本来就该有的设计。

如果你用 AI 出过题,也踩过这里提到的坑,欢迎评论区告诉我,你踩的是哪一个。

我是大白,AI 教育探索者。记录 AI 在教育里的真实用法。

夜雨聆风

夜雨聆风