告别加班!用DFI搭建3个AI助手,文档/方案/标书一键生成

1交付方案制定

1.1项目背景及目标

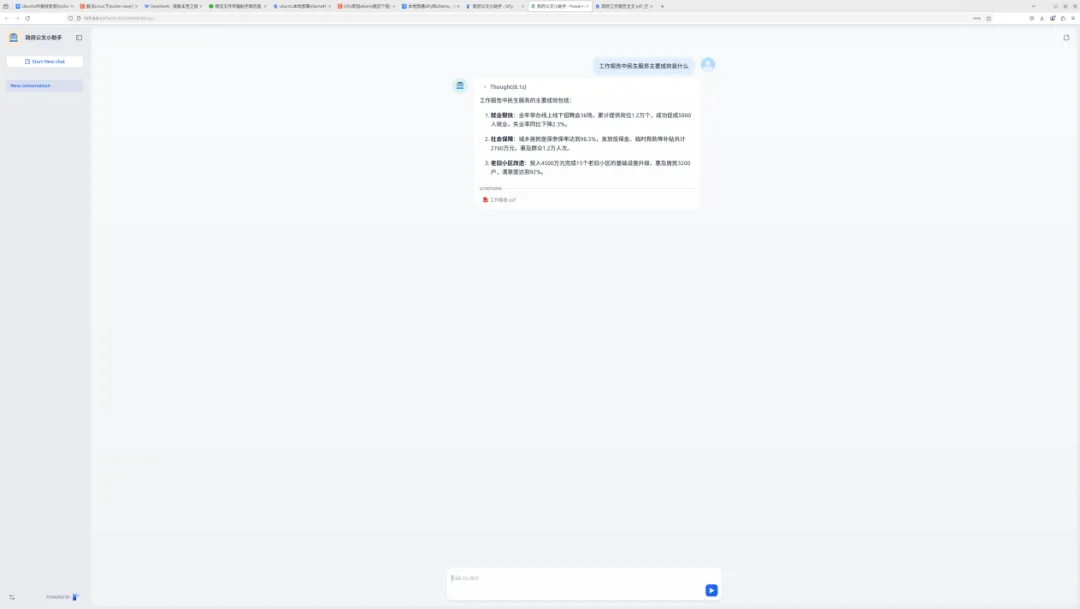

构建一套完整的文档智能书写与检查系统,包括但不限于内部解决方案模板生成与填充、投标文件内容自动撰写与合规性检查、项目竣工验收文件的标准格式套用与关键信息提取等功能模块。

在相应工作场景中全面推广应用该系统,使相关业务人员在文档撰写和检查工作中显著提升工作效率,将文档撰写和检查环节的人均处理时间缩短一半以上,同时降低文档错误率,提高投标文件的中标率和项目竣工验收文件的合规性与质量。

1.2技术选型概览

|

项目项

|

配置说明

|

|

大模型

|

DeepSeek-R1 32B 本地部署版本

|

|

知识库管理

|

Dify(开源框架)

|

|

硬件平台

|

NVIDIA 8卡4090d

|

|

主要用途

|

公司服务事项问答、招投标政策、解决方案编制、验收方案编制等

|

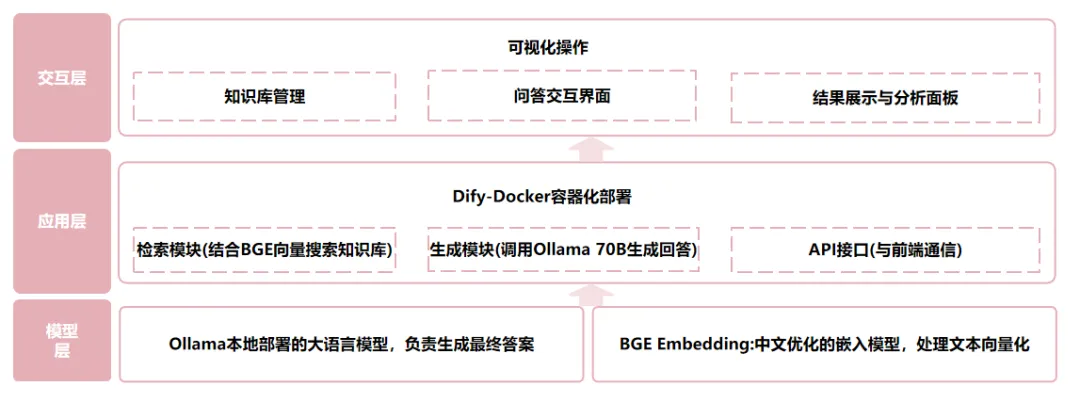

1.3整体架构

1.4技术路线

Ubuntu22.04+Ollama+Docker+Dify1.4.1

2总体步骤

(1)基础环境准备

a.硬件需求

b.系统准备

c.软件环境

Docker + Docker Compose、Ollama、Dify

lDocker:将应用及其依赖(Python 版本、CUDA 驱动、库文件)打包成轻量级容器。直接运行预配置的Dify镜像,无需手动安装PostgreSQL、Redis等依赖

lDocker Compose:知识库系统通常需要多个服务协同(RAGFlow + 模型服务)

lOllama:能够极简本地部署,主要简化了模型的下载、部署和管理流程。适合内部知识库小规模部署

(2)大模型引擎部署(Ollama+DeepSeek-R1:32B)

(3)知识库平台搭建(Dify)

Dify:docker一键部署,支持多模态知识库,可视化工作流编排,通过拖拽界面构建 AI 流程(如知识库问答、文本生成)。

(4)系统联调与测试

3具体部署实施

-

操作系统:ubuntu-22.04.5-live-server-amd64.iso

-

显卡驱动:NVIDIA-Linux-x86_64-550.144.03(tongyong).run

-

-

Ollama安装包:ollama-linux-amd64.tgz

-

Diffy安装包:dify-1.4.1.tar.gz

-

模型文件:DeepSeek-R1-Distill-Qwen-32B-Q4_K_M.gguf,bge-m3-Q4_K_M.gguf等

3.1基础环境准备

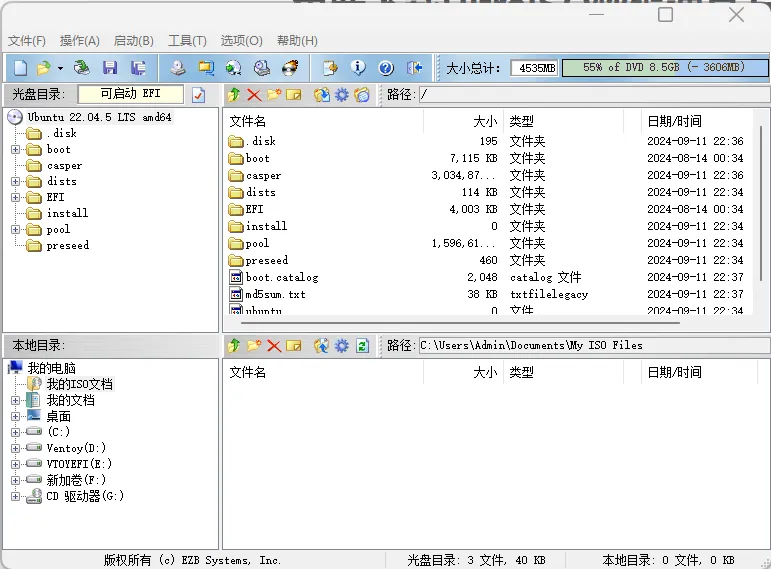

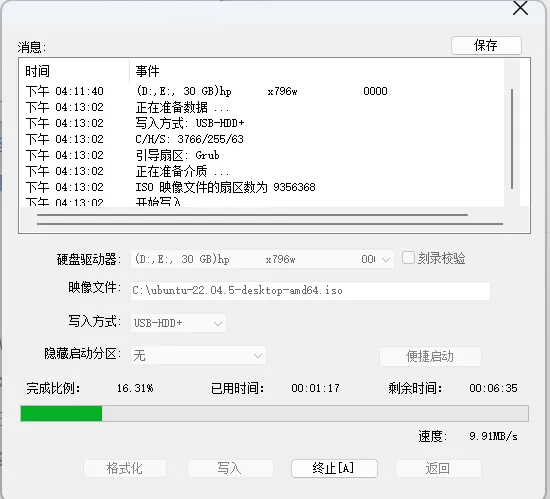

3.1.1操作系统安装准备

在软碟通中导入Ubuntu的ISO,并在U盘中写入

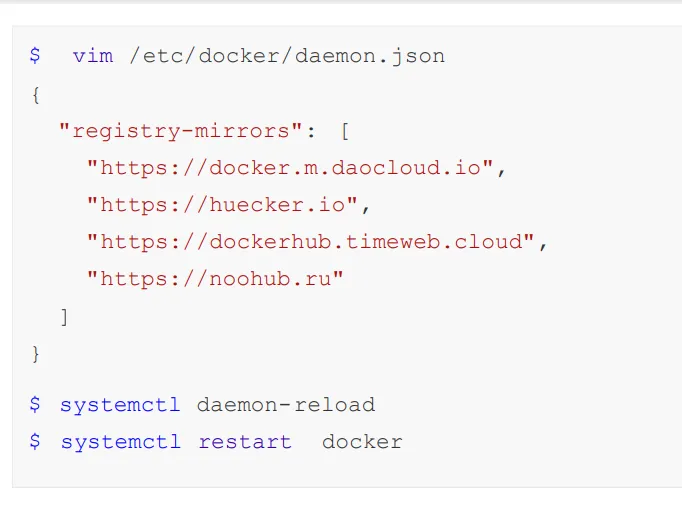

3.1.2安装docker

for pkg in docker.io docker-doc docker-compose docker-compose-v2 podman-docker containerd runc; do sudo apt-get remove $pkg; done

Add Docker’s official GPG key:

sudo apt-get install ca-certificates curl

sudo install -m 0755 -d /etc/apt/keyrings

sudo curl -fsSL https://download.docker.com/linux/ubuntu/gpg -o /etc/apt/keyrings/docker.asc

sudo chmod a+r /etc/apt/keyrings/docker.asc

Add the repository to Apt sources:

“deb[arch=$(dpkg –print-architecture) signed-by=/etc/apt/keyrings/docker.asc] https://download.docker.com/linux/ubuntu \

$(./etc/os-release && echo “${UBUNTU_CODENAME:-$VERSION_CODENAME}”) stable” | \

sudotee /etc/apt/sources.list.d/docker.list > /dev/null

sudo apt-get install docker-ce docker-ce-cli containerd.io docker-buildx-plugin docker-compose-plugin

3.2系统安装

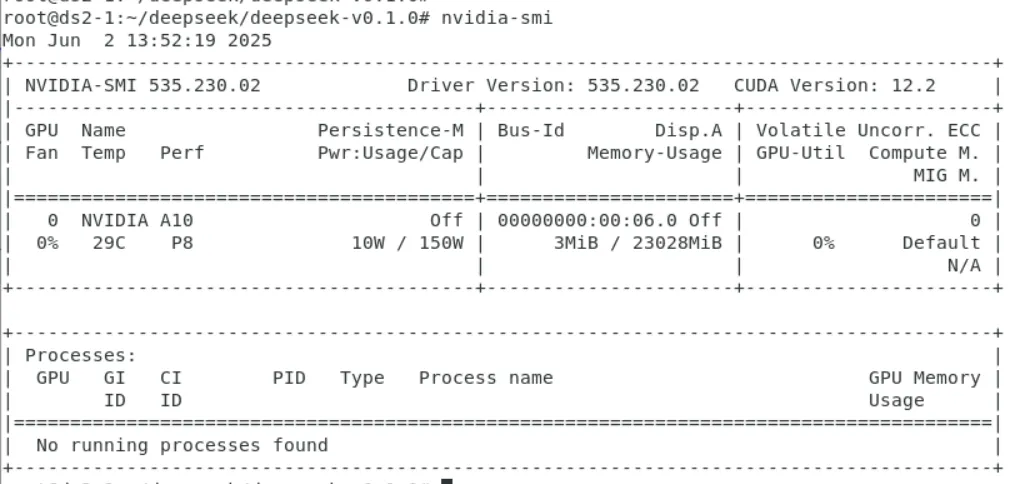

3.2.1NVIDIA驱动安装

提前下好NVIDIA-Linux-x86_64-550.144.03(tongyong).run安装包

然后直接sh NVIDIA-Linux-x86_64-535.230.02.run 安装

3.2.2Ollama安装

(1)离线安装

下载ollama-linux-amd64.tgz安装包

再mv ollama /usr/local/bin/下,输入ollama 即可有ollama

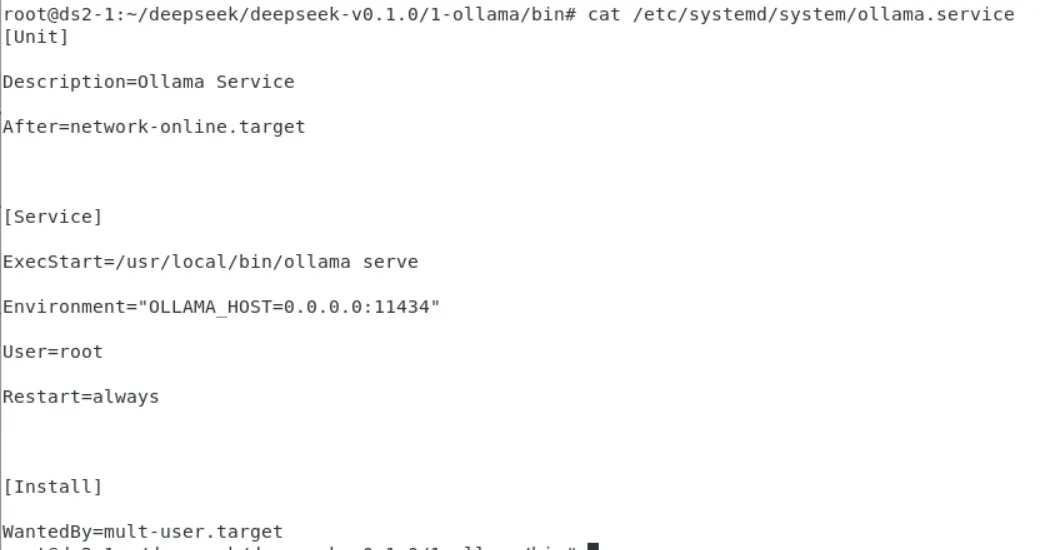

若要成为服务下次开机自启动,还需再/etc/systemd/system/下面创建ollama.service

再启用服务systemctl enable ollama –now即可。

3.2.3使用ollama加载模型

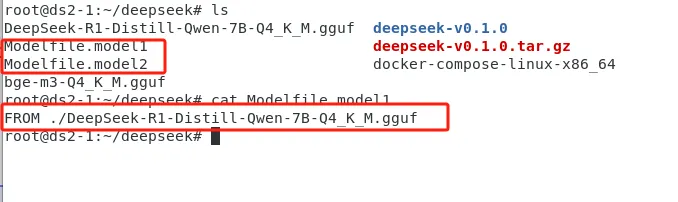

(1)离线加载

首先在https://huggingface.co/下载好.guff模型文件如:

DeepSeek-R1-Distill-Qwen-32B-Q4_K_M.gguf

bge-m3-Q4_K_M.gguf

再创建Modelfile.model文件,如下:

最后再运行:

Ollama create my-model -f ./Modelfile.model (加入到了模型列表)

Ollama run my-model (运行模型)

(2)在线加载

直接ollama pull 模型名称

运行模型ollama run 模型名称,模型不存在时会先拉取(下载)模型

3.2.4安装Dify

(1)离线安装Dify

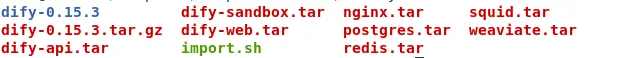

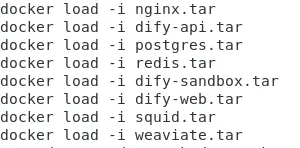

提前下载好这些包,包括dify安装包以及依赖的各种docker镜像包,然后先加载docker镜像包

然后解压:tar -zxvf dify-0.15.3.tar.gz

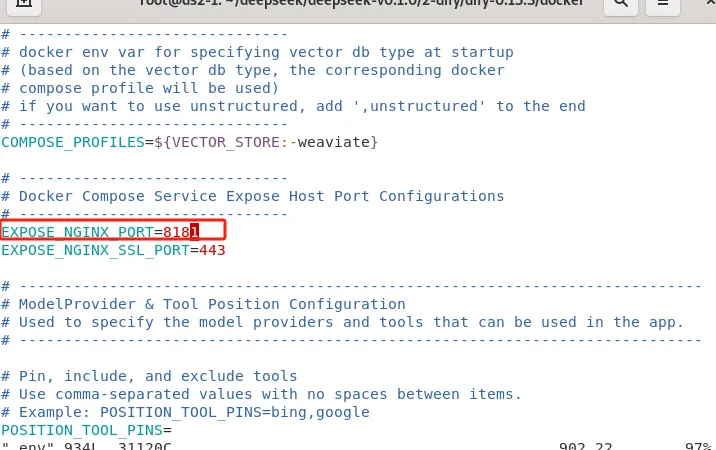

最后运行docker-compose up -d即可启动dify服务

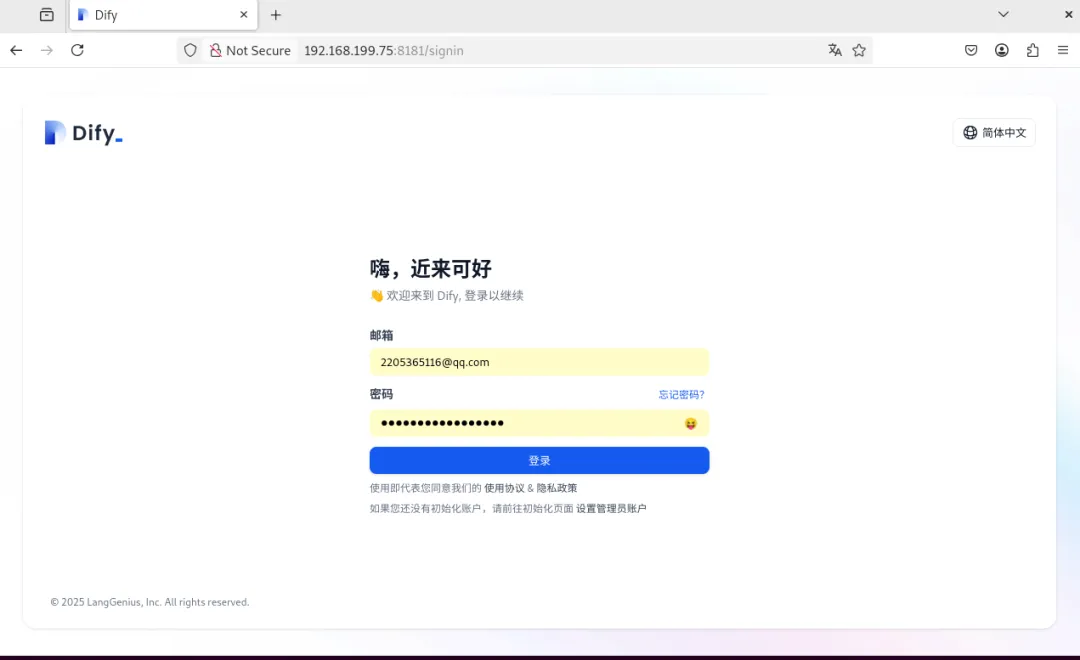

最后在浏览器里面输入:http://服务器ip:8181即可进入dify

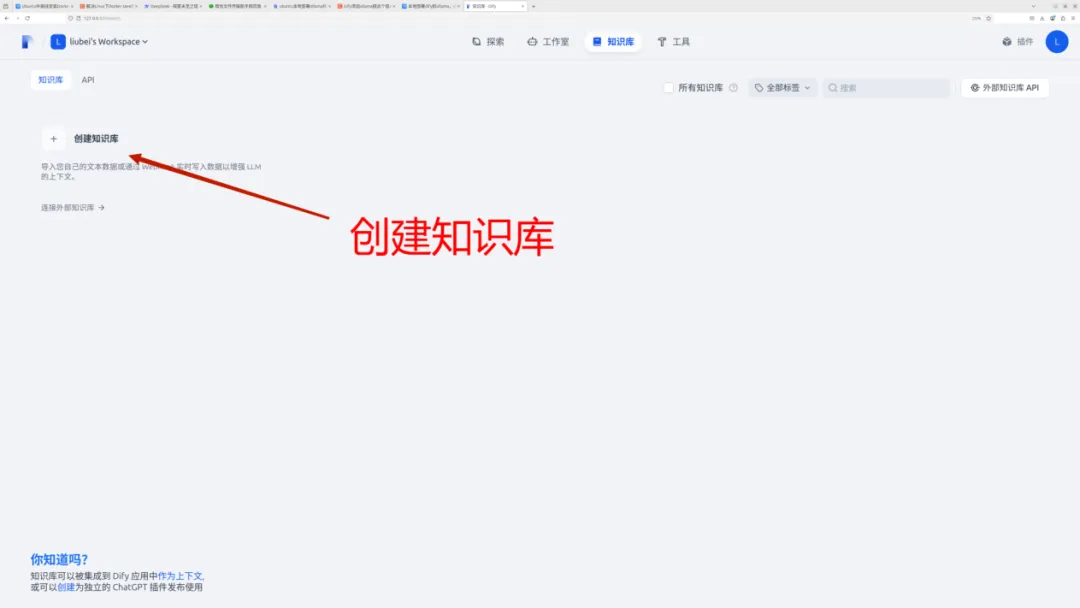

3.3dify知识助手搭建

3.3.1知识库搭建前的配置

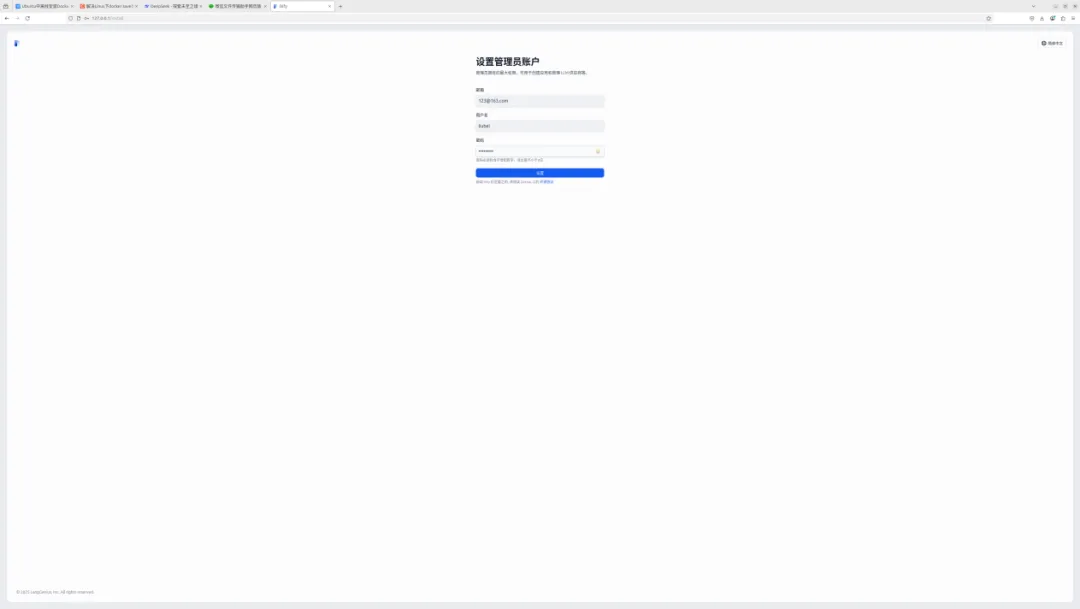

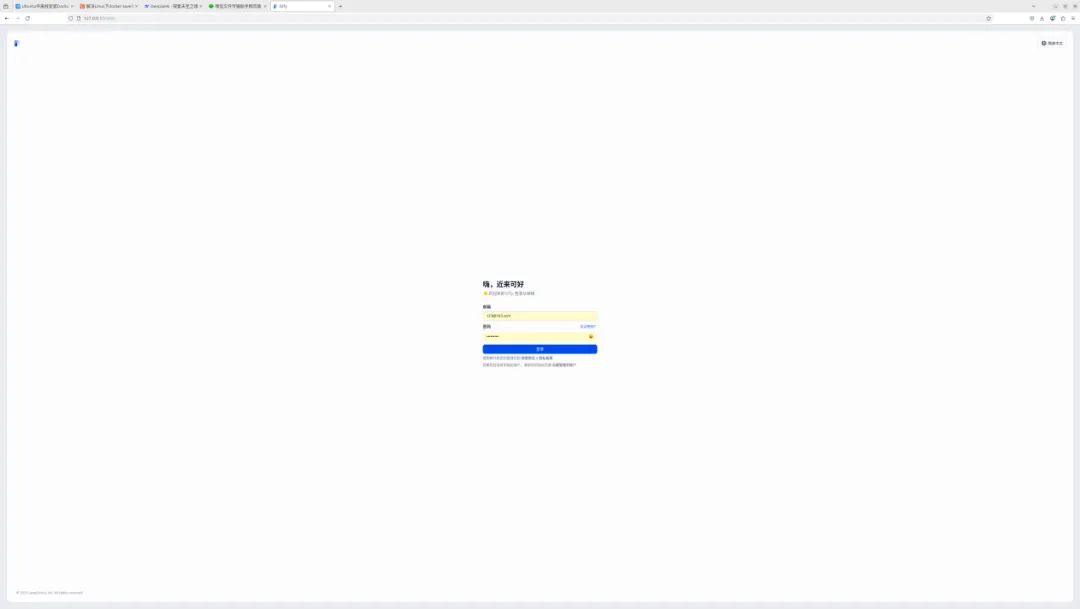

打开浏览器输入http://服务器ip–> 注册一下 –> 进入界面

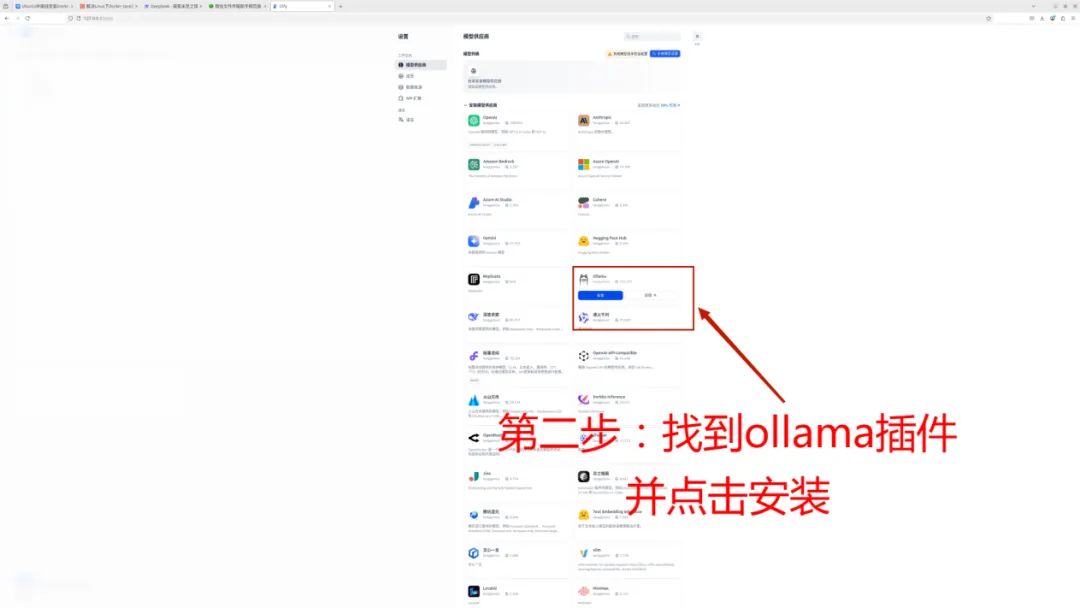

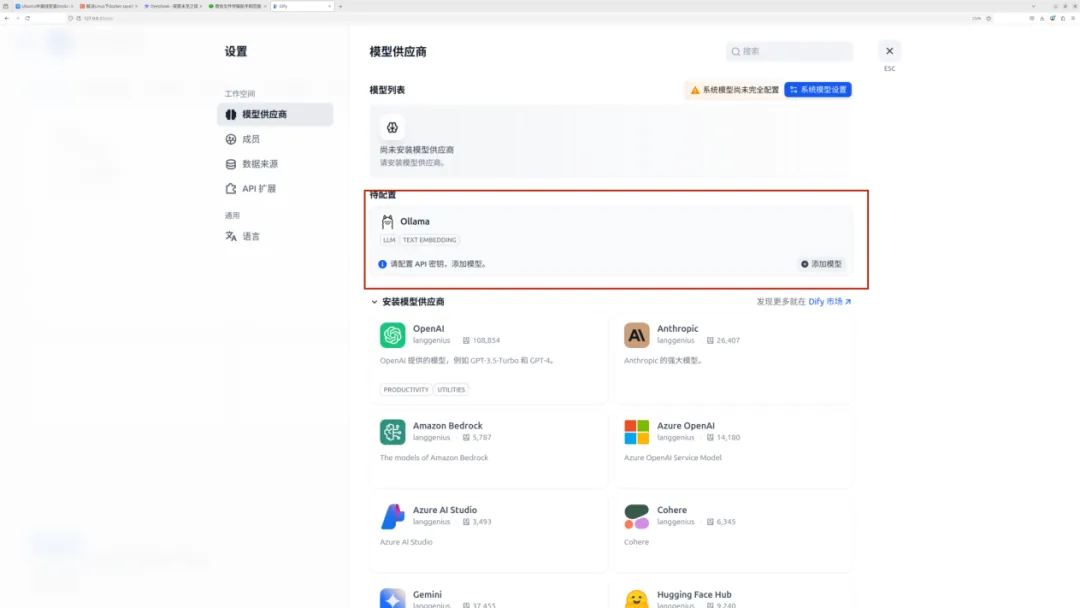

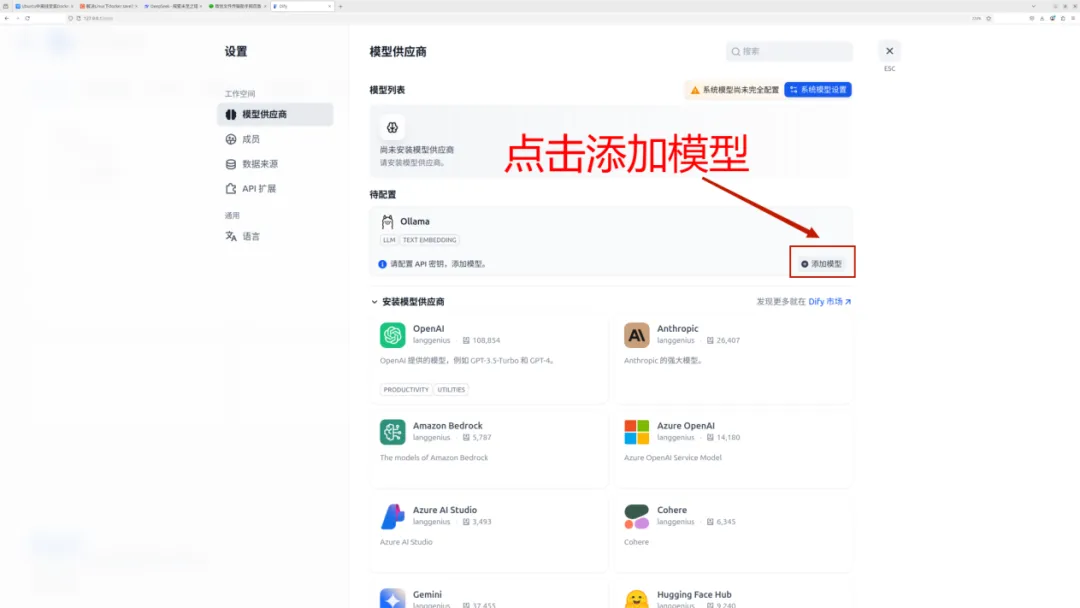

(1)设置-模型供应商-ollama-安装-添加模型,使dify能够给调用本地部署的大模型

安装成功后,在待配置项中就会显示ollama插件,最终效果如下图所示

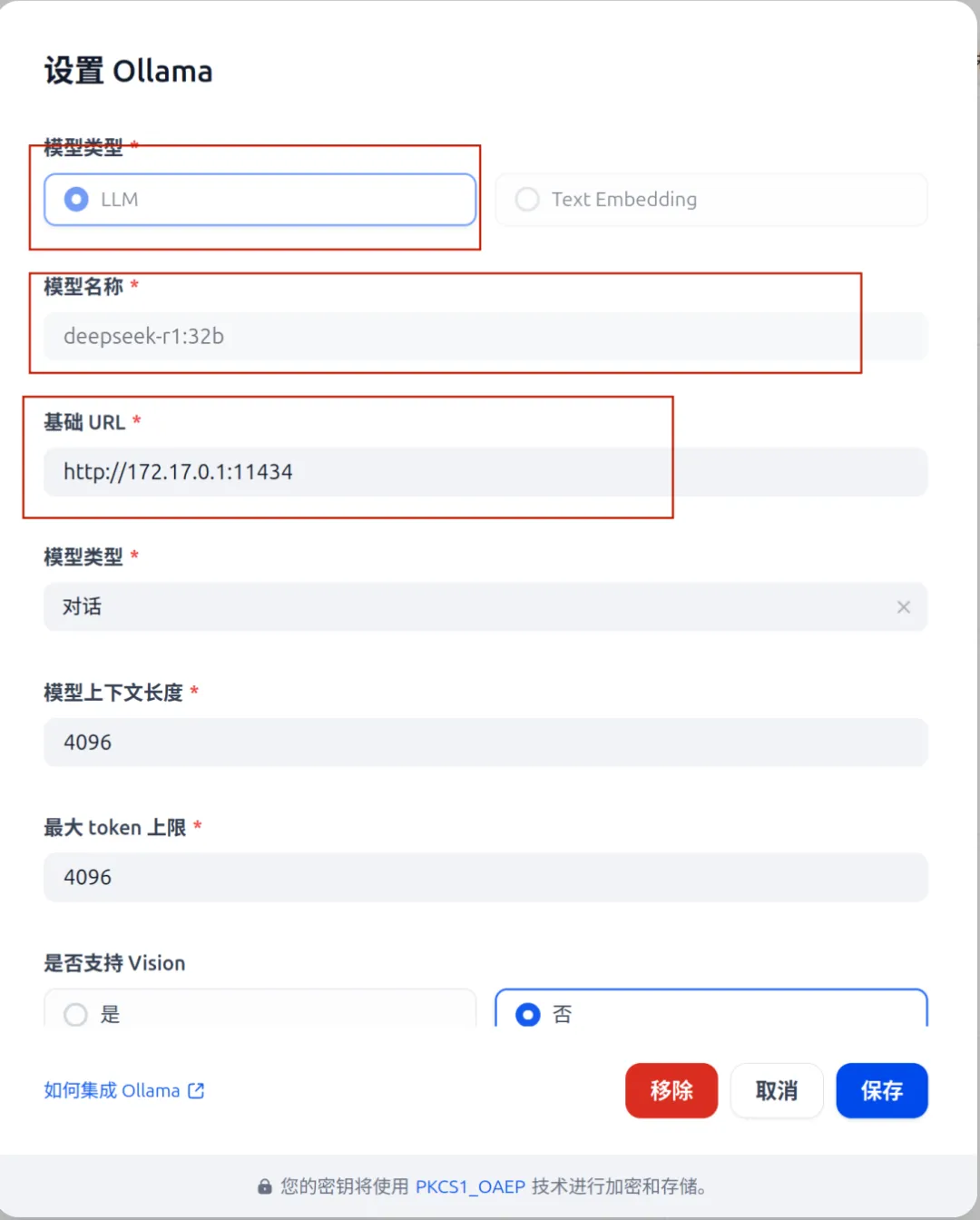

(2)在ollama插件中配置本地部署的模型(暂时提供一种大模型 deepseek-r1:32b。并同时配置embedding模型)

配置大模型的操作如下(注意模型名称和基础URL要严格保持一致)

配置embedding模型的操作如下(注意模型名称和基础URL要严格保持一致)

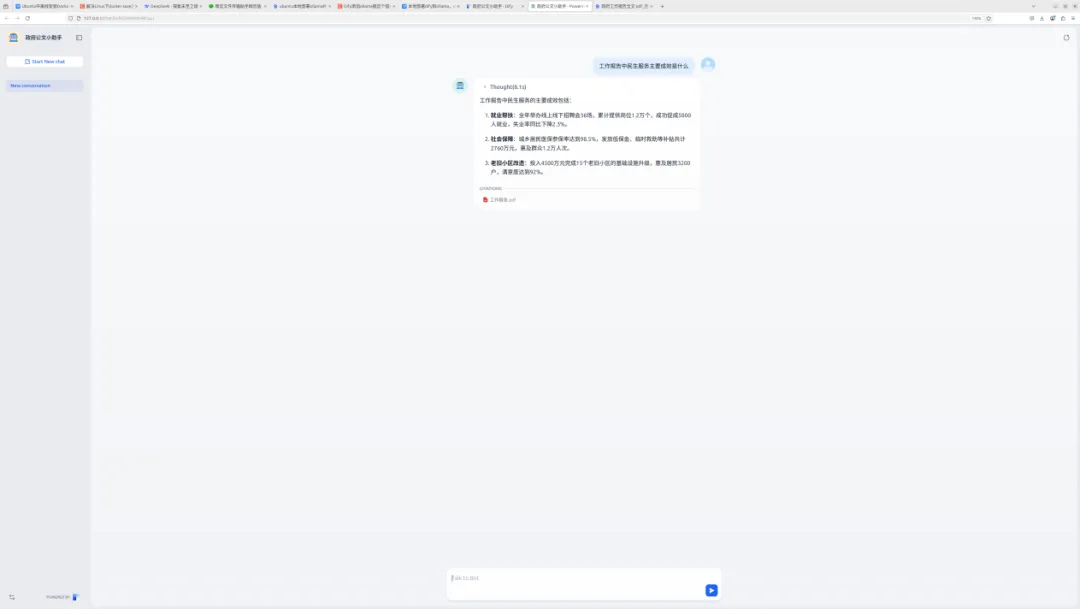

3.3.2方案助手(解决方案、实施方案)

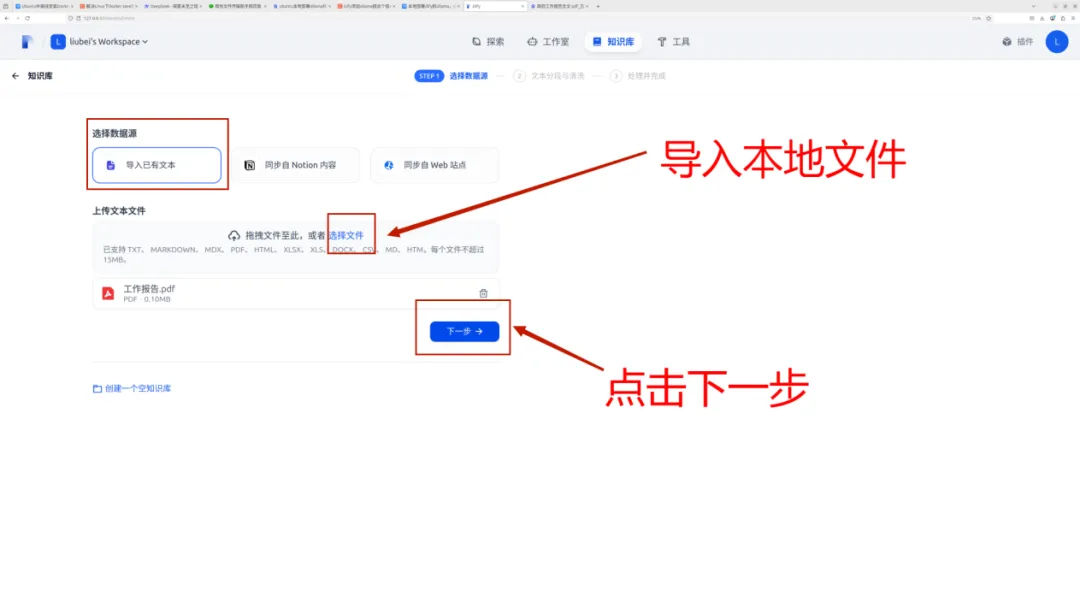

(1)提前准备好成熟完整的解决方案、实施方案PPT、Word、PDF等材料

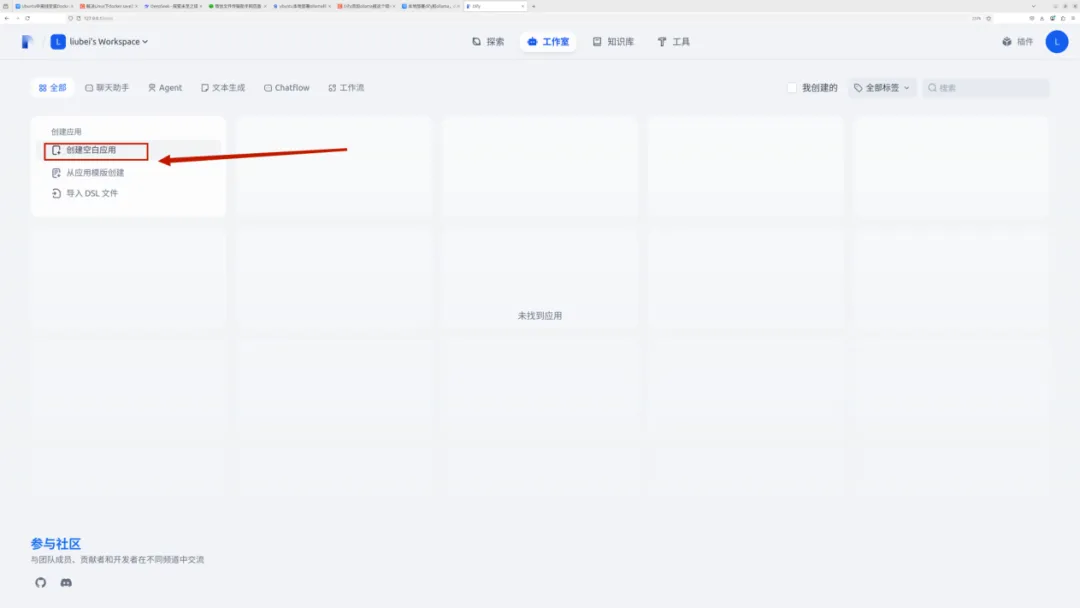

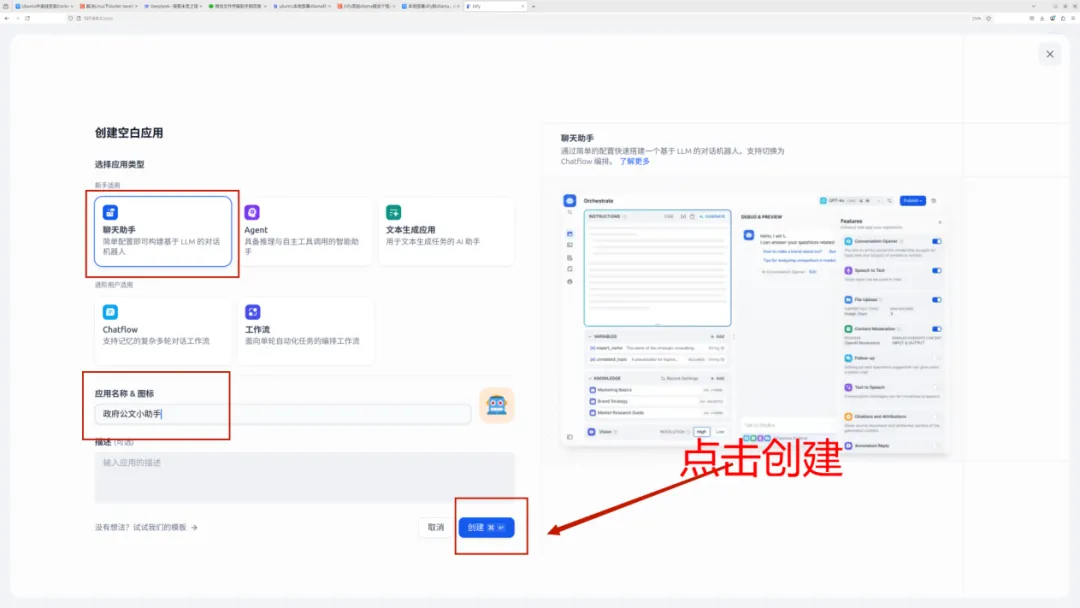

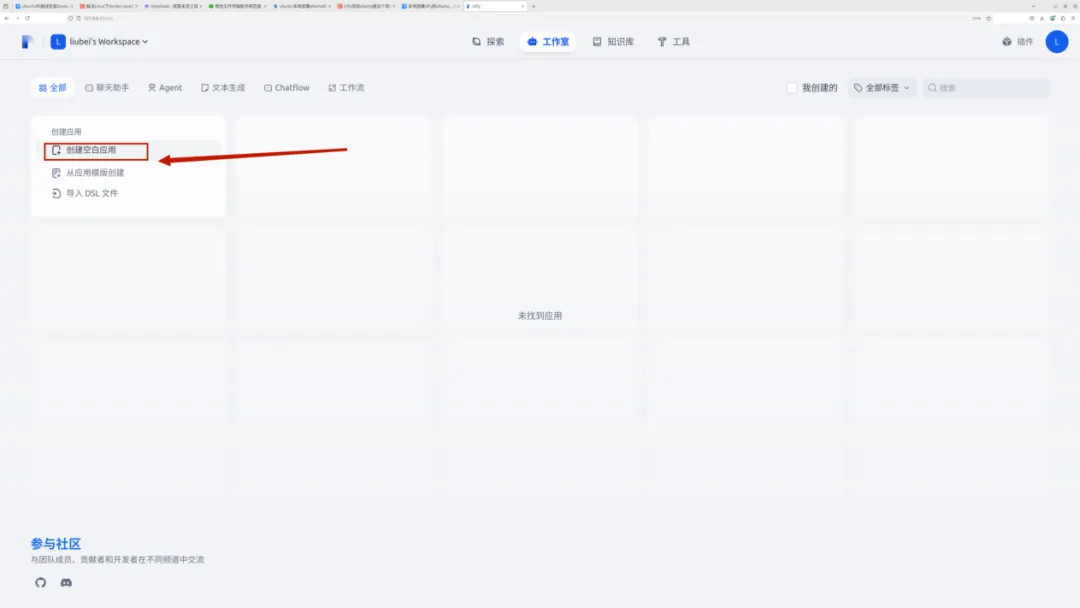

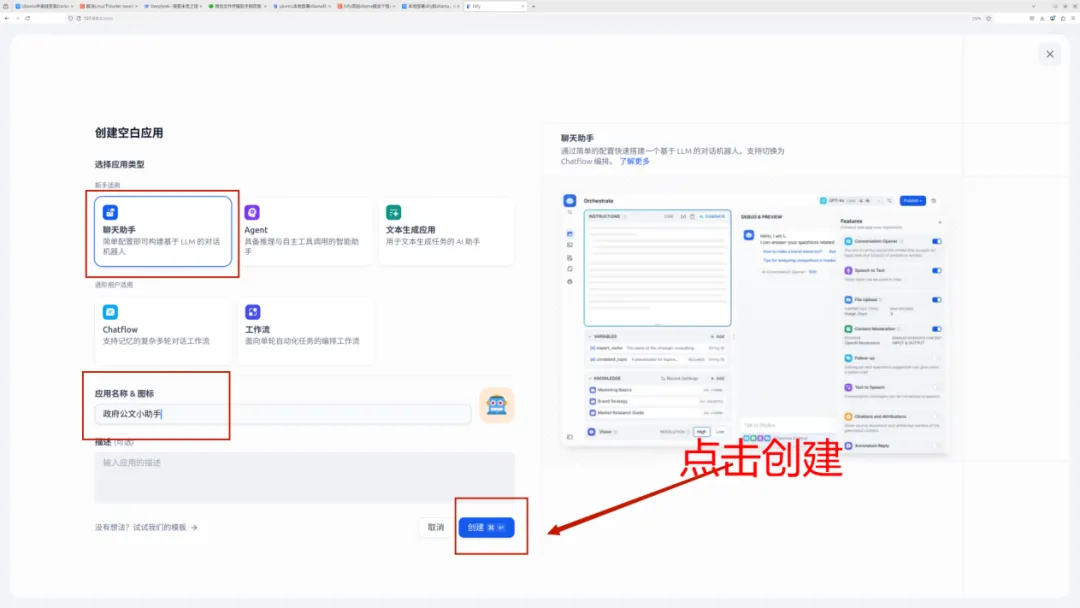

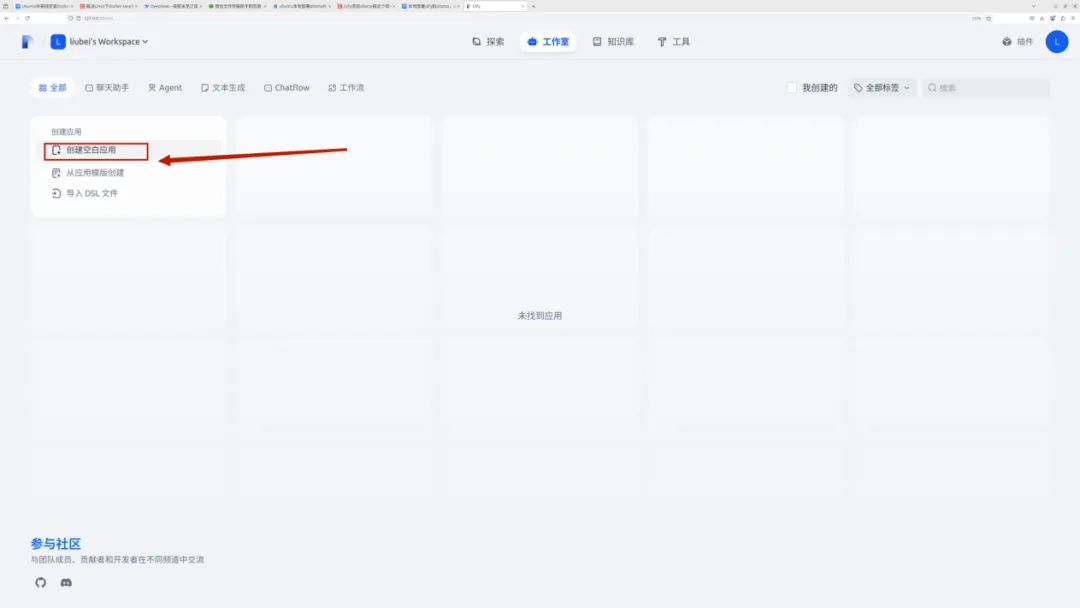

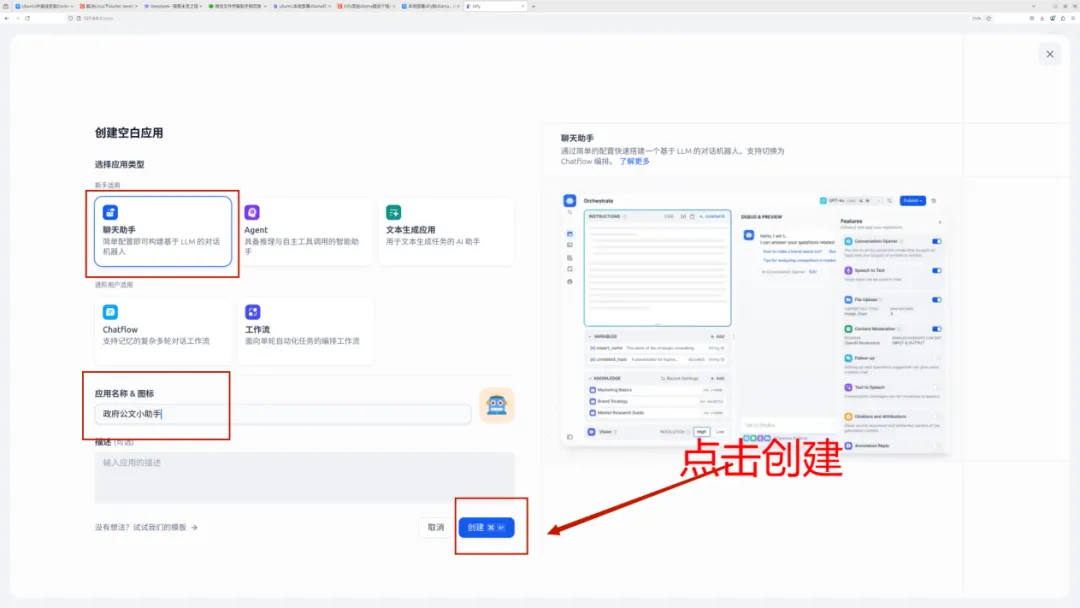

(2)点击首页,创建空白应用(以知识助手举例),输入应用名称,并点击创建

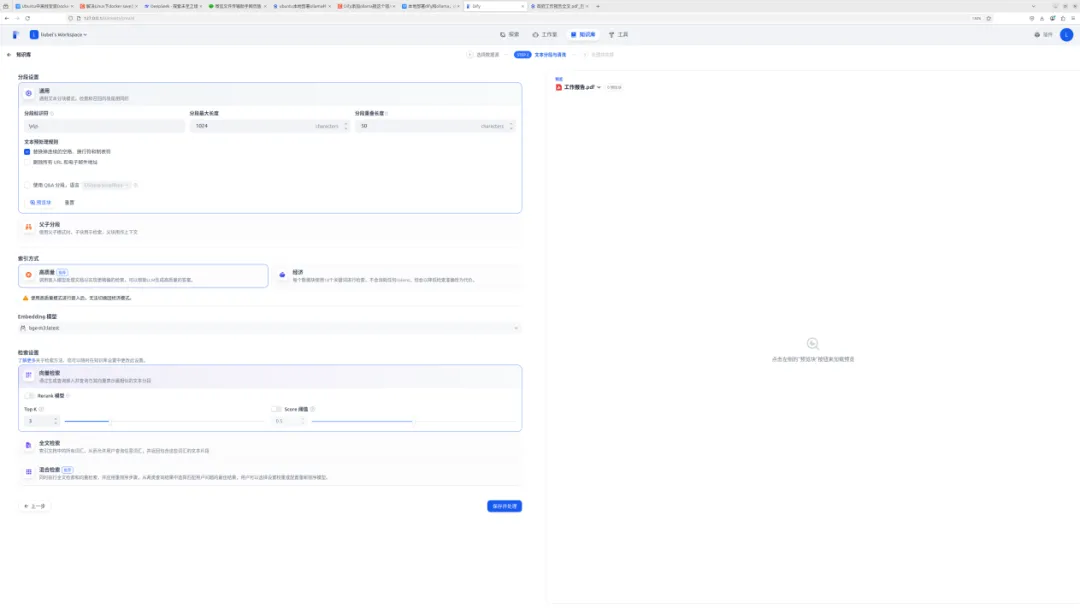

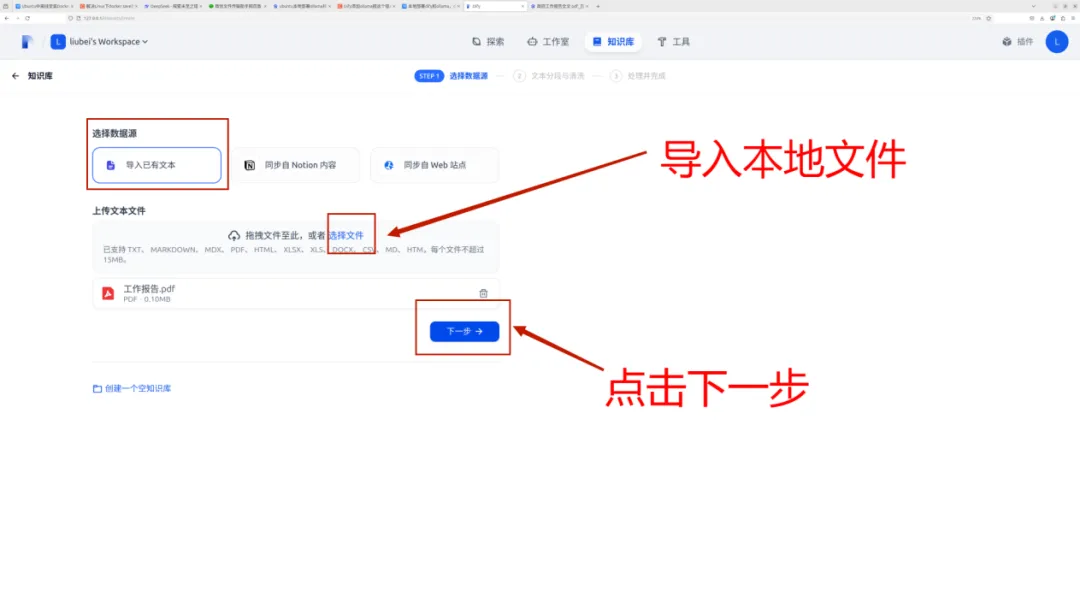

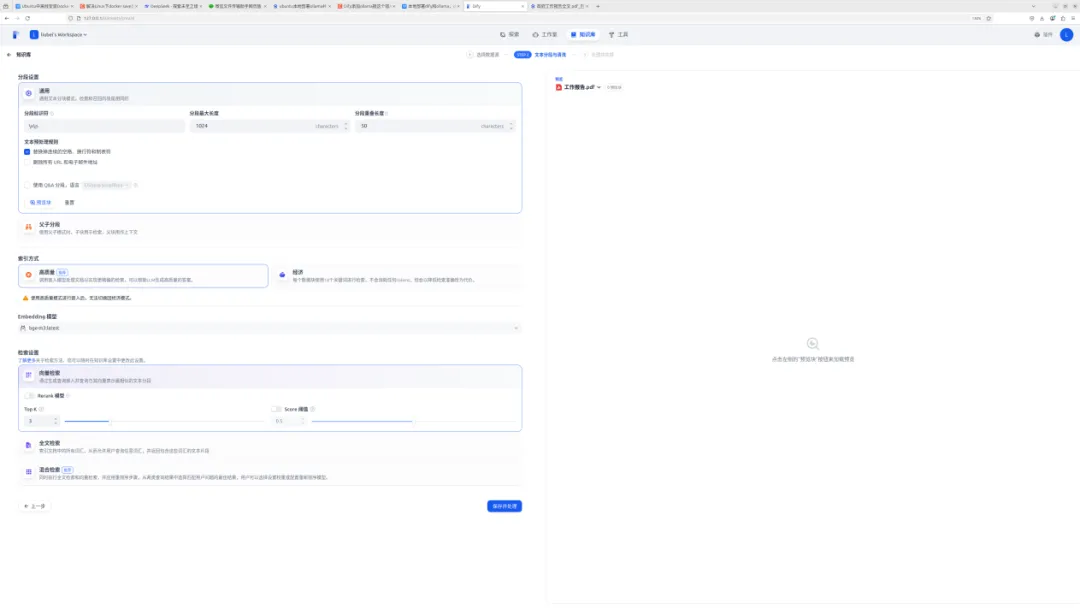

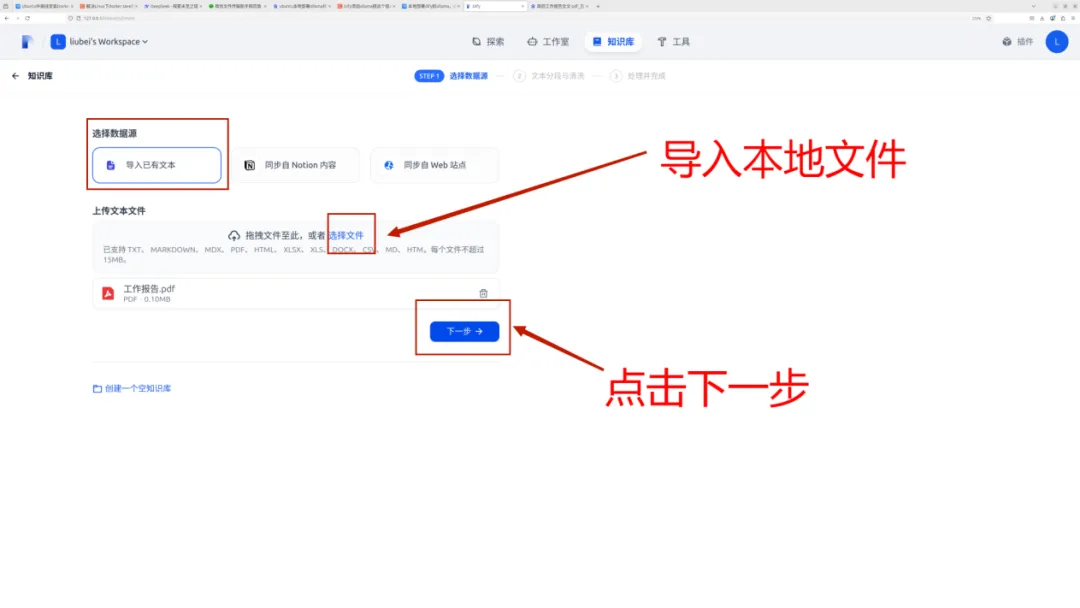

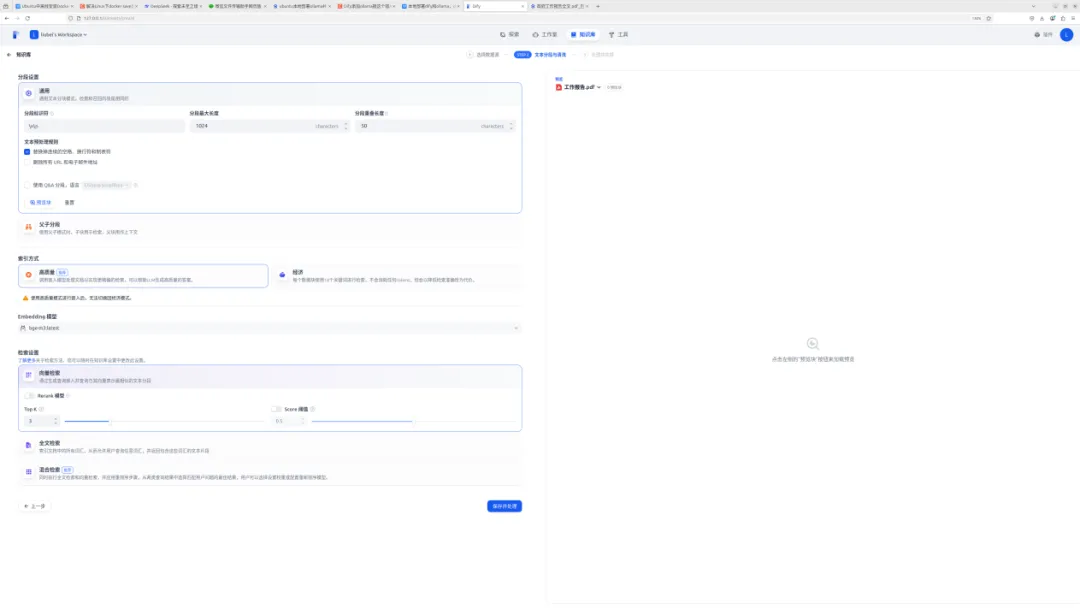

l分段设置(分段方法,三个参数的设置:分段标识符,分段长度,分段重叠长度)

l索引模式设置(高质量模式/经济模式)

lembedding模型选择

l检索参数配置:Top k以及Score阈值

l检索模式选择:混合检索(推荐),向量检索,全文检索

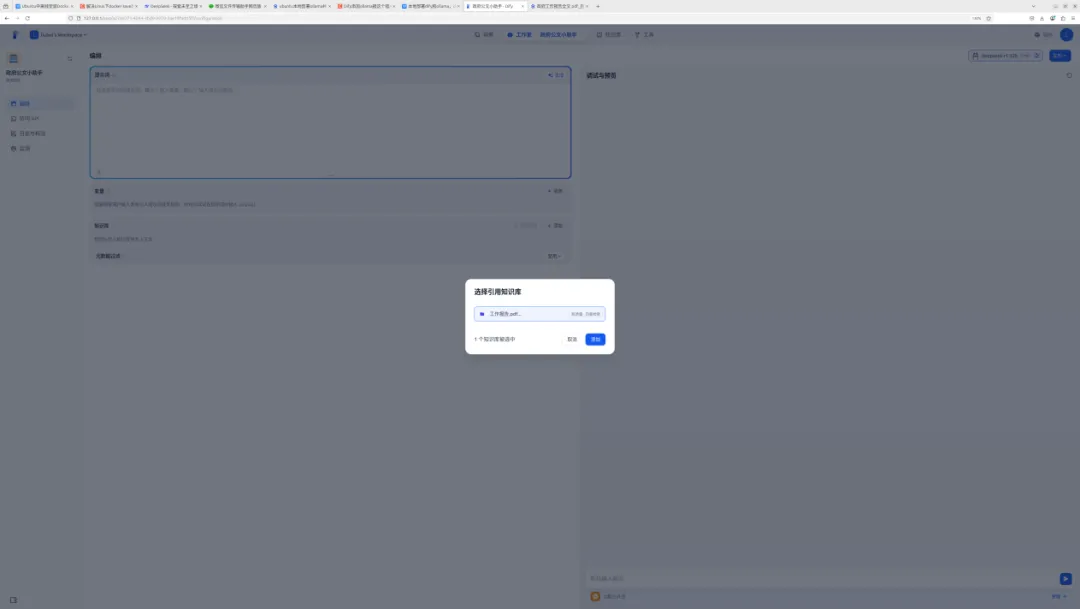

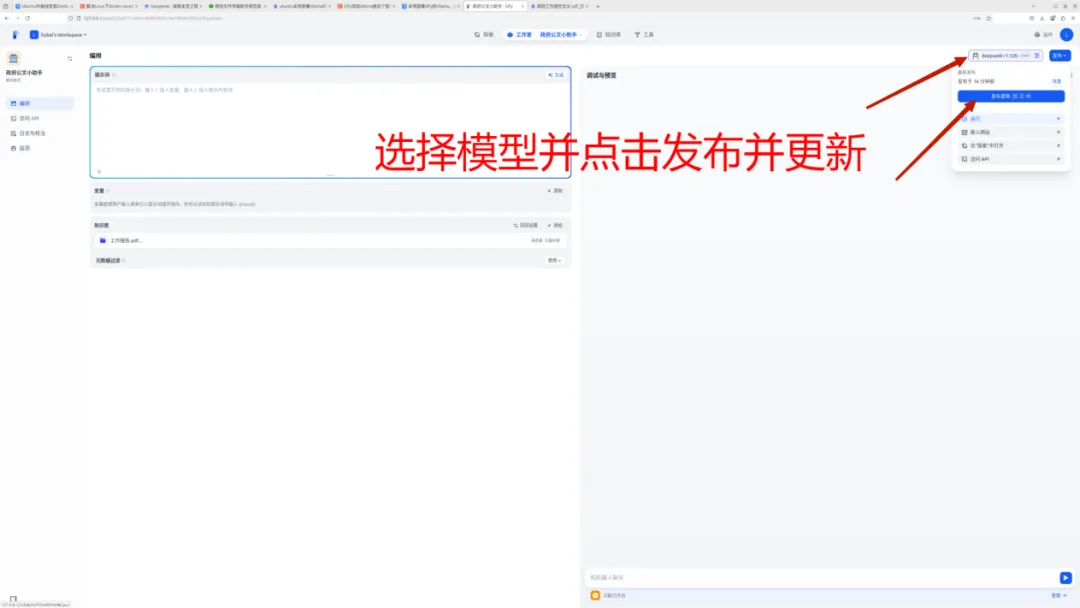

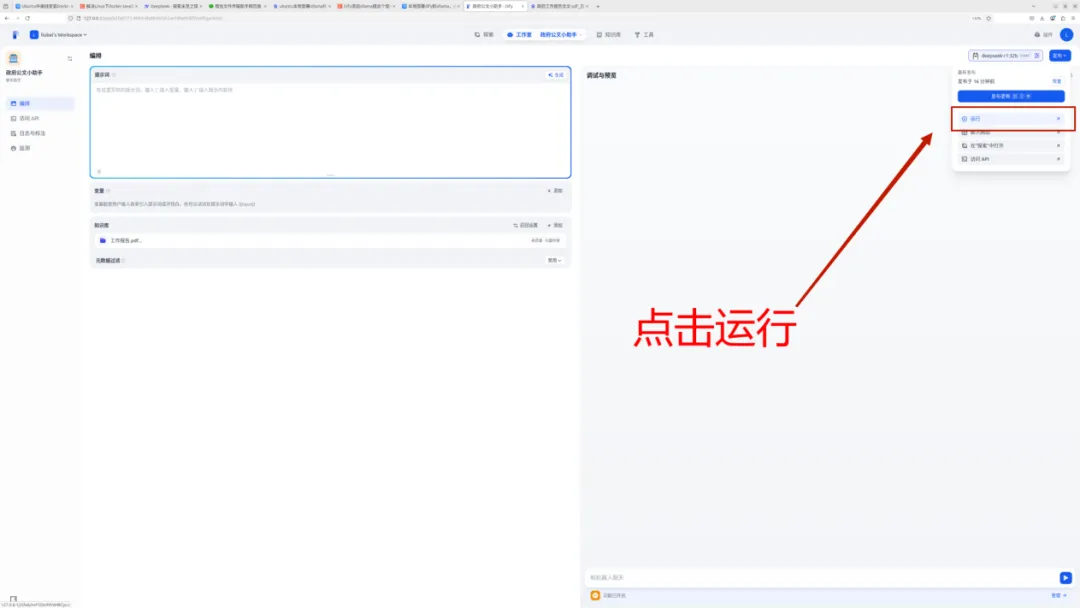

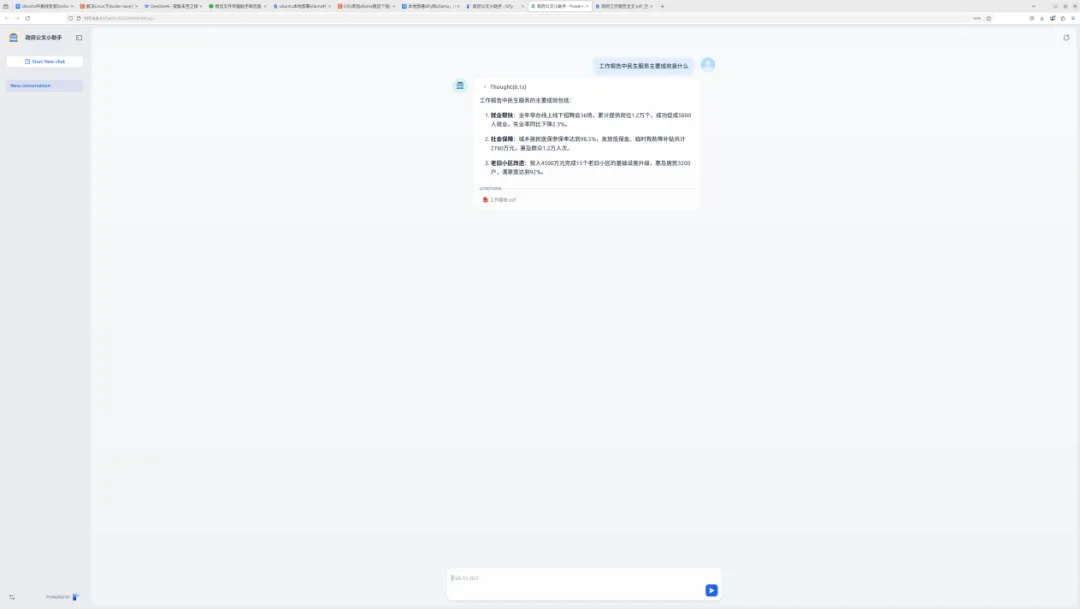

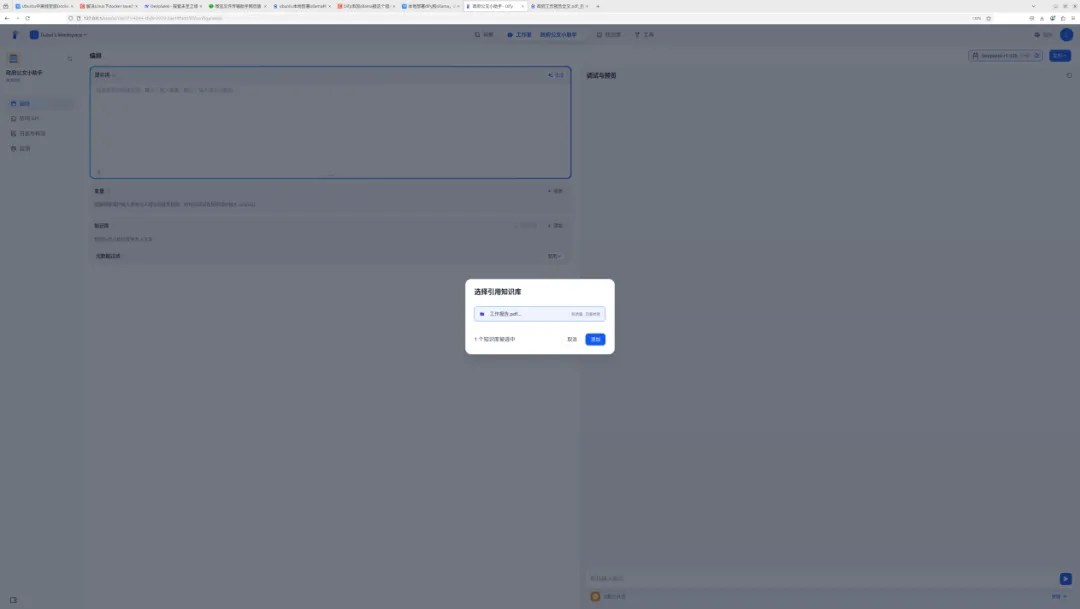

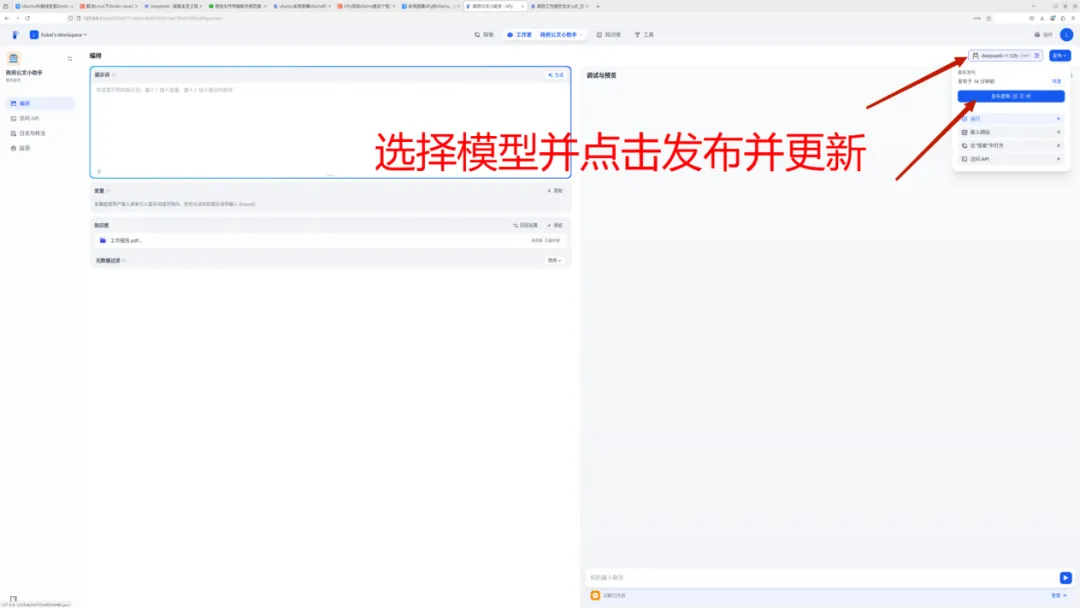

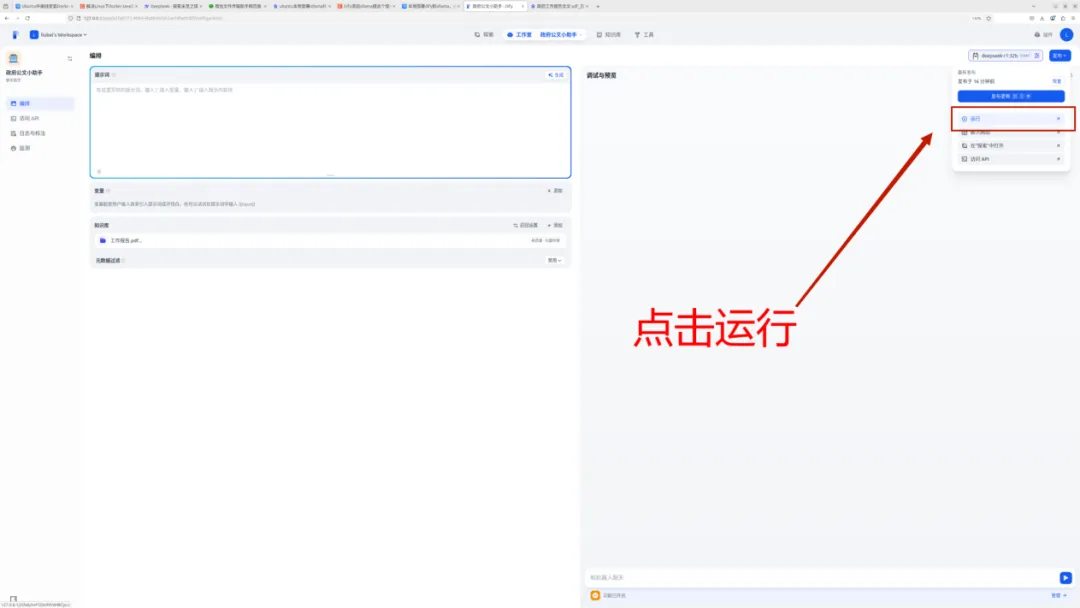

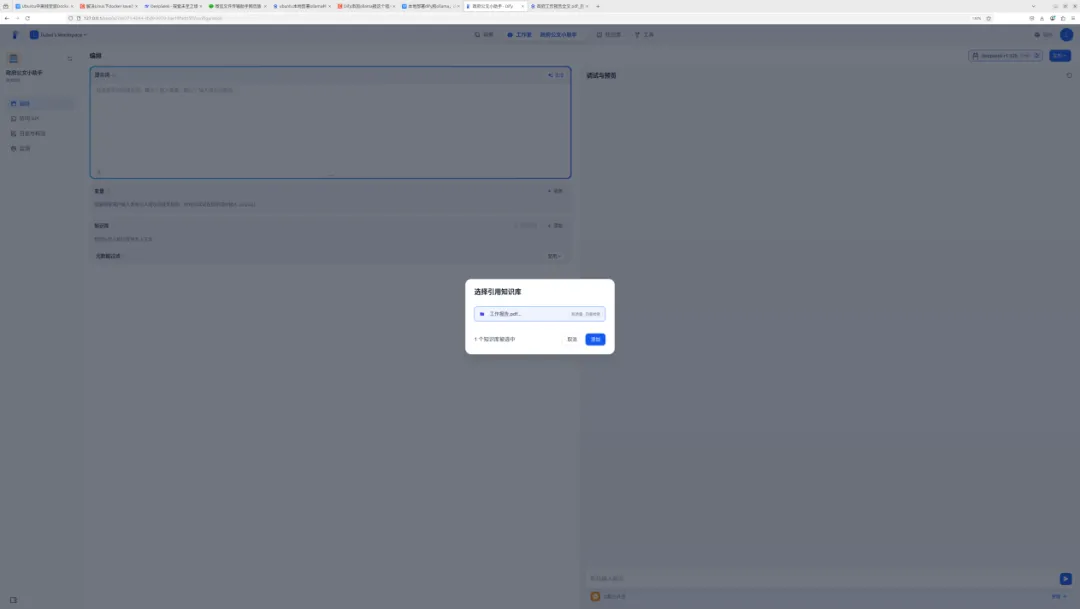

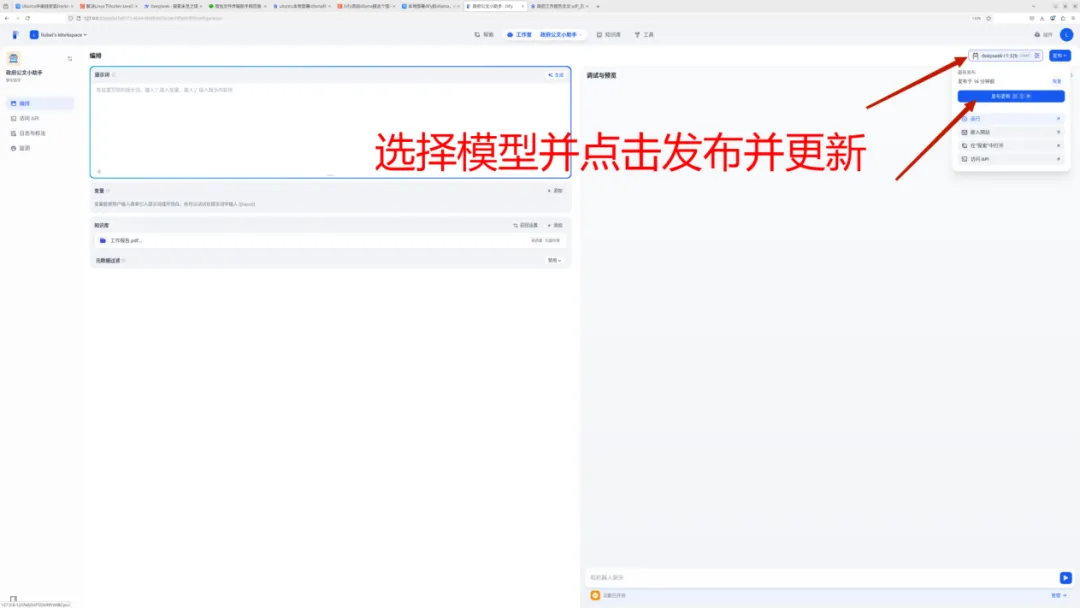

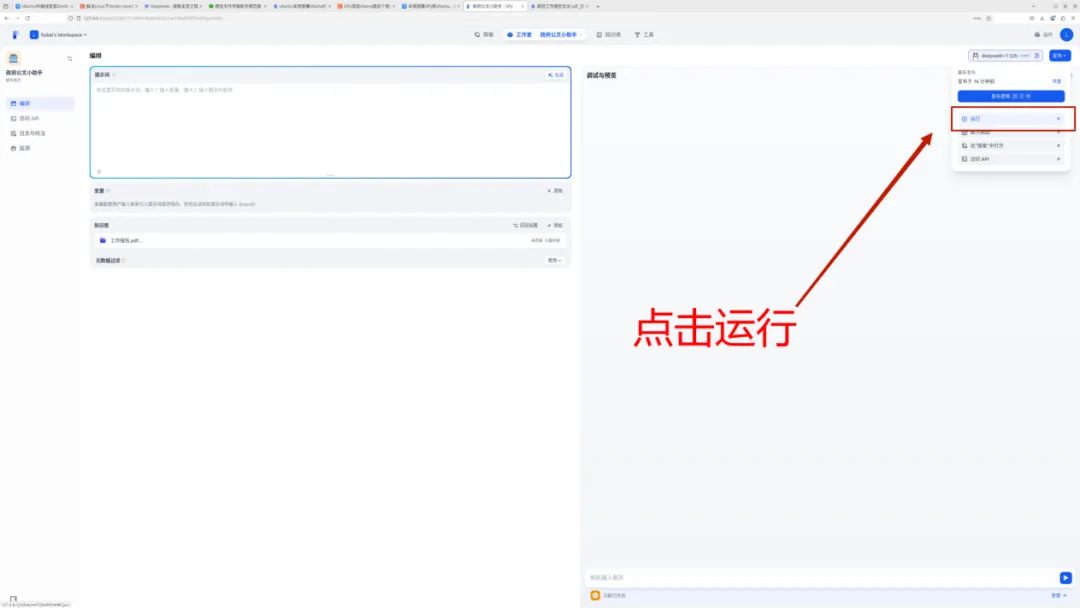

(4)返回知识助手工作流页面,关联创建的知识库并选择模型,点击发布即可关联知识库

3.3.3招投标助手

(1)提前准备好成熟完整的招标文件、投标文件Word、PDF等材料

(2)提前准备好招投标、政府采购相关法律文件Word、Pdf等

(3)点击首页,创建空白应用(以知识助手举例),输入应用名称,并点击创建

l分段设置(分段方法,三个参数的设置:分段标识符,分段长度,分段重叠长度)

l索引模式设置(高质量模式/经济模式)

lembedding模型选择

l检索参数配置:Top k以及Score阈值

l检索模式选择:混合检索(推荐),向量检索,全文检索

(5)返回知识助手工作流页面,关联创建的知识库并选择模型,点击发布即可关联知识库

3.3.4验收报告助手

(1)提前准备好成熟完整的招标文件、投标文件Word、PDF等材料

(2)点击首页,创建空白应用(以知识助手举例),输入应用名称,并点击创建

l分段设置(分段方法,三个参数的设置:分段标识符,分段长度,分段重叠长度)

l索引模式设置(高质量模式/经济模式)

lembedding模型选择

l检索参数配置:Top k以及Score阈值

l检索模式选择:混合检索(推荐),向量检索,全文检索

(4)返回知识助手工作流页面,关联创建的知识库并选择模型,点击发布即可关联知识库

关注【AI与计算机视觉】,每天一篇实战干货,紧跟技术前沿,从入门到工程落地,一步到位,新手也能快速上手、搞定毕设和职场项目!

夜雨聆风

夜雨聆风