当前时间: 2026-04-26 19:15:27

更新时间: 2026-04-26

分类:软件教程

评论(0)

影视剪辑——AI影视制作流程与剪辑的前置

大家好,前七节课,我们从产业全景一路走到AI编剧、视觉资产沉淀、视频生成、视听语言、虚拟片场调度、声音构建,几乎把AI影视创作的每一个垂直环节都拆解了一遍。但到目前为止,还有一个关键问题没有回答:所有这些环节,如何被“串”成一部完整的作品?

这就是剪辑的使命。在传统影视工业中,剪辑是“后期制作”的核心环节——拍摄完成之后,剪辑师坐在剪辑台前,面对几百小时的素材,剪出故事、剪出节奏、剪出情绪。但在AI影视工作流中,剪辑正在经历一场根本性的身份转变:它不再是一个“后期环节”,而是贯穿整个创作过程的“中枢神经”。

这节课要解决的,就是这个转变的核心命题:如何把剪辑从“最后一道工序”升级为“全流程调度机制” ——让调色、配音、作曲不再等到视频生成完毕才开始,而是与剧本写作、视觉设计、镜头生成同步并行。这就是“剪辑的前置”,也是本节课最核心的概念。

一、引子:剪辑的“身份危机”——AI时代的剪辑还是剪辑吗?

先用一个数据建立坐标。2026年1月,国内AI漫剧上线量达1.46万部,平均每天400余部,是传统短剧上线量的10倍以上。同期,AI漫剧在短剧大盘中的占比已接近三成,AI技术使制作成本降超90%。

这意味着什么?内容生产的速度正在指数级增长,但“剪片子”的人并没有同步增加。 梦境引擎武汉团队3个人(美术设定+AI生成+剪辑)一周能完成一部十几集漫剧;5人团队8天能用小云雀Agent产出播放量破亿的爆款。

当“生成”的速度远超“剪辑”的速度时,剪辑就变成了整个工作流最大的瓶颈。AI必须介入——不只是帮你加几个转场特效,而是从根本上重构剪辑的定义和位置。

在AI影视工作流中,剪辑至少扮演着四种全新的身份:

第一,剪辑是“调度中枢” ——它不是被动接收素材,而是主动调度各个AI环节的输出节奏和格式要求。

第二,剪辑是“质量控制站” ——它不再只是“把能用的素材拼起来”,而是对整个AI工作流的输出进行一致性校验、穿帮修复、节奏校准。

第三,剪辑是“资产复用引擎” ——它推动角色、场景、风格等视觉资产在多个项目间的复用,最大化AI投入的长期价值。

第四,剪辑是“叙事总指挥” ——它不只是在素材堆里“找故事”,而是从剧本阶段就开始规划叙事节奏和情绪曲线。

a16z合伙人Justine Moore的判断一针见血:下一阶段真正拉开差距的,不是生成层,而是“剪辑层”。 AI Agent正在悄然演化为那个看不见的“后期团队”。

在她的框架中,三个条件几乎同时成熟:一是视觉大模型对内容语义与叙事结构的理解力;二是多模态工具的调度与协同能力;三是生成模型在稳定性与美学品质上的跃迁。当这三点同时跨过临界值,AI不再只是“给素材”,而是开始统筹流程、打磨细节、校准节奏。

传统AI影视制作的最大问题是“手工作坊式”——每个创作者各搞一套流程,工具之间割裂,素材来回倒腾,信息不断损耗。工业化生产的前提,是一套可复制、可量化的标准化操作流程(SOP) 。

截至2026年4月,行业已经涌现出多个成熟的AI影视全流程平台,它们各自的SOP架构为我们提供了清晰的参考坐标:

国内首个工业级AI漫剧智能体生产平台“纳米漫剧流水线”,于2026年2月正式发布。其核心架构是 “分镜编剧+视觉导演”双智能体搭配纳米空间引擎,构建从剧本到成片的全流程工业化生产体系。

具体来说:分镜编剧智能体负责将剧本拆解为分镜方案、生成角色与场景设定;视觉导演智能体负责将分镜转化为可执行的生成指令,调度Seedance 2.0等视频模型进行批量生产;纳米空间引擎则提供角色一致性锁定、场景空间锚定等底层能力。

其两大专属创作模式尤其值得关注:多参生视频模式支持图片、视频、音频、剧本等多模态参考输入,自动规划分镜与叙事节奏,保障长剧集前后统一;宫格生视频模式支持多宫格故事版图片预览,确认分镜后一键成片。这意味着创作者可以在分镜阶段就“预览”整部剧的视觉走向,而非在生成过程中盲人摸象。

万兴科技旗下的万兴剧厂在2026年4月焕新上线满血版Seedance 2.0全能力,打通AI真人剧、2D/3D漫剧工业化制作等全类型工作流。其核心差异化在于多模态组合入参——支持文本、视频、音频、真人实拍等多模态组合输入。

更关键的是其 “导演级控制” 能力:可智能补全剧情、音效配乐与口型同步、人物场景音色全剧一致,并可批量直出2K高清分镜视频。这意味着传统剪辑中需要大量人工对齐的工作(如口型匹配、音画同步、角色一致),在生成阶段就被“锁死”了。

万兴喵影2026以AI大模型为基础,在通用型视频创意软件中实现了AIGC全面融入时间线剪辑,构建起从 “构思—生成—润色—输出” 的AI智能生产线。创作者输入文案即可通过“灵感成片”快速得到结构化脚本与视频初稿;在润色阶段,AI视频擦除、智能抠像、AI超清等功能可进行一体化处理;在输出阶段,AI动感字幕能从音视频中自动生成同步动态字幕。

这套流程将AI能力前置到灵感触发的第一秒,让剪辑不再是“最后收尾”,而是贯穿始终的“组织逻辑”。

2026年3月19日,字节跳动旗下小云雀AI正式上线短剧行业专属智能体,搭载Seedance 2.0算法,实现了从剧本创作到剧集成片的全流程自动化生产。

其工作流程可以概括为:上传剧本→系统自动完成角色设定、分镜拆解和场景渲染→生成“故事蓝图”→创作者可逐个分镜修改提示词和角色引用→最终输出成片。4万多字的剧本上传后,制作团队只需要在关键节点做微调。

创翊传媒使用小云雀制作60集漫剧《万兽独尊》,5人团队仅用8天便产出了上线4天播放量破亿的爆款作品。

爱奇艺于2026年3月30日发布的纳逗Pro,是目前最“懂影视”的AI智能体平台。它的独特之处在于:结合影视创作的专业分工,构建编剧、美术、分镜、视效等智能体矩阵,并将影视创作核心方法论与创作经验沉淀于工作流的每一个环节。

创作者通过自然语言交互,在角色和场景设计、构图和景别、运镜和角色走位等环节即可直接调用丰富的影视素材作为参考。其目标是让创作过程从“这次抽卡的生成结果是否满意”变成“用AI创作出接近实拍质感的故事”。

综合以上平台的架构思路,可以提炼出一套适用于大多数AI影视项目的标准化SOP框架:

-

AI工具:AI编剧智能体(小云雀Agent/纳逗Pro/WorkBuddy)

-

输出物:完整剧本+分集大纲+角色设定档案+场景设定档案

-

关键动作:利用AI编导的引导式提问,完善世界观、强化情绪冲突点

-

AI工具:文生图模型(Wan2.7-Image/Vidu Q3/可灵图片3.0)+ LoRA微调

-

输出物:核心角色三视图+多角度参考图+场景概念图+风格化模板+Prompt库

-

关键动作:建立“母版角色库”,为每个角色生成三视图并锁定视觉特征

-

质量门:跨镜头角色一致性测试(至少测试3个不同角度/场景)

-

AI工具:智能分镜系统(可灵3.0/纳米流水线分镜编剧/纳逗Pro分镜智能体)

-

输出物:完整分镜表+每个镜头绑定的参考资产+运镜参数预设

-

关键动作:利用多宫格预览功能进行全剧视觉预演,提前识别一致性风险点

-

AI工具:参考生视频模型(Seedance 2.0/HappyHorse/可灵3.0)+ 原生音画同步

-

关键动作:建立生成监控机制,实时校验角色一致性和物理正确性,不合格立即重新生成

-

质量门:素材可用率≥85%(行业平均水平,优秀团队可达90%以上)

-

AI工具:AI剪辑工具(Eddie AI v3/万兴喵影/Adobe Firefly Quick Cut)+ AI调色(Premiere Color Mode/Baselight v7/DaVinci Resolve 21)

-

动作:将本项目沉淀的角色资产、Prompt库、工作流配置归档到企业级资产库

-

输出物:可复用资产包(LoRA权重+Prompt模板+风格化参数)+ 版权存证记录

三、核心技能(二):调色、配音、作曲等前置工作与剪辑的配合

传统影视流程中,调色是纯后期环节——所有素材拍完、粗剪完成之后,调色师才开始工作。但在AI影视中,这种模式效率极低:你在后期才发现某个场景的整体色调不对,需要回到生图环节重新生成——这意味着时间和算力的双重浪费。

2026年,调色正在被“前置”到视觉资产建设阶段。

Premiere Pro Color Mode:为剪辑师设计的调色体验

Adobe在2026年4月为Premiere Pro推出了全新的Color Mode(公测中),这是首个专为剪辑师设计的调色体验,而非为专业调色师设计的工具。Color Mode的上百名剪辑师深度参与了内测,这意味着调色能力不再是一个需要“切换软件”的独立环节,而是嵌入剪辑工作流的一部分。

同时,Firefly Video Editor也内置了简单的色彩调整控件——曝光、对比度、饱和度和色温,可以直接在编辑器中通过滑块和单击式操作进行微调。对于AI短剧这种快速迭代的场景,这意味着调色不再是“等专业调色师排期”的瓶颈。

Baselight v7:智能蒙版解决复杂调色场景

FilmLight于2026年1月发布的Baselight v7,专为视效密集、细节丰富的项目设计。其核心突破在于AI驱动的蒙版工作流:全新的Segment Anything Flexi Effect可以利用直观选取实现快速的、基于对象的蒙版创建;Depth Map生成器和Depth Keyer可实现基于深度的调色,用Haze和Bokeh运算器模拟大气效果和光学风格。

这意味着AI影视创作中常见的“角色和背景分离调色”问题——比如让角色更突出而背景更灰暗——不再需要手动抠图,AI自动识别对象并创建蒙版。

DaVinci Resolve 21:AI功能全面升级

Blackmagic Design于2026年4月发布的DaVinci Resolve 21,AI功能全面升级:新增IntelliSearch内容智能检索,支持基于语义的快速素材定位;CineFocus实现画面焦点区域的精准识别与动态调整;AI Speech Generator可将文本高效转化为高质量合成语音;AI UltraSharpen提供无损纹理保留的高精度锐化。

对于AI影视创作者来说,这意味着剪辑、调色、声音、交付可以在同一个软件内完成全流程——不需要在多个工具之间来回切换。

-

在视觉资产建设阶段确定色彩体系:为每个关键场景确立色板——主色调、辅色调、光影色温——并在生成所有镜头时统一遵循这个体系。

-

使用色彩参考图控制生成一致性:在参考生视频模式下,将色彩参考图作为多模态输入源之一,确保生成素材的色调自动对齐。

-

在剪辑阶段只做微调:调色的“大方向”在生成阶段就确定,剪辑阶段只做曝光、对比度、饱和度等参数的微调。

第七节课我们详细讲过AI声音技术,这里重点讲配音和作曲如何前置。

传统流程:视频剪好→配音演员进棚录音→录音师混音→作曲配乐→音效制作→混音。每一步都依赖前一步的完成,周期长、协调成本高。

-

在剧本阶段:就可以用AI配音工具(Fun-CineForge/VoxCPM 2)生成角色声音原型,为每个核心角色“定调”——语速、音色、情绪基调。这不仅是配音选型,更是帮助编剧“听”角色说话,优化台词节奏。

-

在分镜阶段:可以用AI作曲工具(Lyria 3/MiniMax Music 2.5+)为关键情绪段落生成BGM原型,反过来影响分镜的节奏设计——音乐的起伏与镜头的推拉形成呼应。

-

在批量生成阶段:使用原生音画同步模型(HappyHorse/Seedance 2.0),配音和画面同时生成,天然对口型、天然情绪同步,不需要后期“对口型”。

梦境引擎武汉团队的实践验证了这一模式的效率:3人团队——美术设定+AI生成+剪辑——一周完成一部剧,声音环节完全由AI驱动,不依赖专业录音棚和配音演员。

在调色、配音、作曲全部前置的情况下,剪辑的角色发生了根本变化——从“后期收尾”变成“全流程协调中枢”:

-

在剧本阶段,剪辑师就开始介入,对分集节奏、情绪曲线提出建议——这直接决定了后续生成环节的镜头数量和节奏安排。

-

在资产建设阶段,剪辑师需要确认角色/场景视觉资产是否满足剪辑需求——比如同一角色是否有足够的景别变化(远景/中景/特写),以支撑剪辑时的镜头切换。

-

在分镜阶段,剪辑师参与分镜表审核——检查镜头之间的衔接逻辑、节奏设计是否符合最终成片要求。

-

在生成阶段,剪辑师可以边生成边粗剪——利用Eddie AI v3这类AI剪辑代理,对已生成的素材进行自动分类、标记和初步组装。

Adobe Firefly的Quick Cut功能代表了这一方向:用户通过自然语言描述视频目标,系统自动筛选关键片段、拼接镜头,并在不同剪辑之间生成合理过渡。创作者与营销人员最关心的是效率,整理素材等重复性操作并非创作者真正享受的部分,Quick Cut旨在帮助创作者迅速构建故事框架,加快初剪进程。

Eddie AI v3更进一步,推出Night Shift模式——用户放入一个素材文件夹,AI通宵处理,自动将采访素材与B-roll分类,同步多机位采访素材,并组装出一个粗剪版本,可以直接在Premiere、DaVinci Resolve或Final Cut Pro中打开。更令人印象深刻的是,用户可以通过短信发送素材链接给Eddie,第二天早上8点前就能收到剪辑结果。

这意味着剪辑师的时间从“整理素材”中解放出来,可以把更多精力投入到节奏精修、情绪校准、穿帮修复等高价值工作上。

4.1 “二八定律”的翻转:从80%时间剪片到80%时间创作

视频制作有一个经典的“二八定律”:创作者会把80%的时间和精力花在剪辑上,20%用在拍摄(如今是生成)上。这个比例在AI时代正在被彻底翻转。

因为剪辑本质上是在做三件事:一是“整理”——从海量素材中筛选可用片段;二是“对齐”——让不同镜头的节奏、色彩、声音协调一致;三是“修补”——修复素材中的瑕疵和穿帮。这三件事在传统流程中都发生在最后阶段,而且严重依赖人工。

-

“整理”被自动化:Eddie AI的Night Shift模式可以在夜间自动完成素材分类、日志记录和粗剪组装。Quick Cut可以通过自然语言指令自动筛选和拼接素材。

-

“对齐”被前置化:原生音画同步模型在生成阶段就完成了音画对齐;色彩参考体系在资产建设阶段就锁定了色调统一;角色一致性技术在多镜头生成中自动保持视觉稳定。

-

“修补”被智能化:Wan2.7-Video的一句话视频编辑能力、DaVinci Resolve 21的AI运动去模糊和面部精修功能,让穿帮修复从“灾难级返工”变成“轻量级微调”。

翻转后的新比例:创作者可以把80%的时间和精力花在创作决策上——叙事节奏设计、情绪曲线把控、风格调性选择——而只花20%的时间在技术执行上。

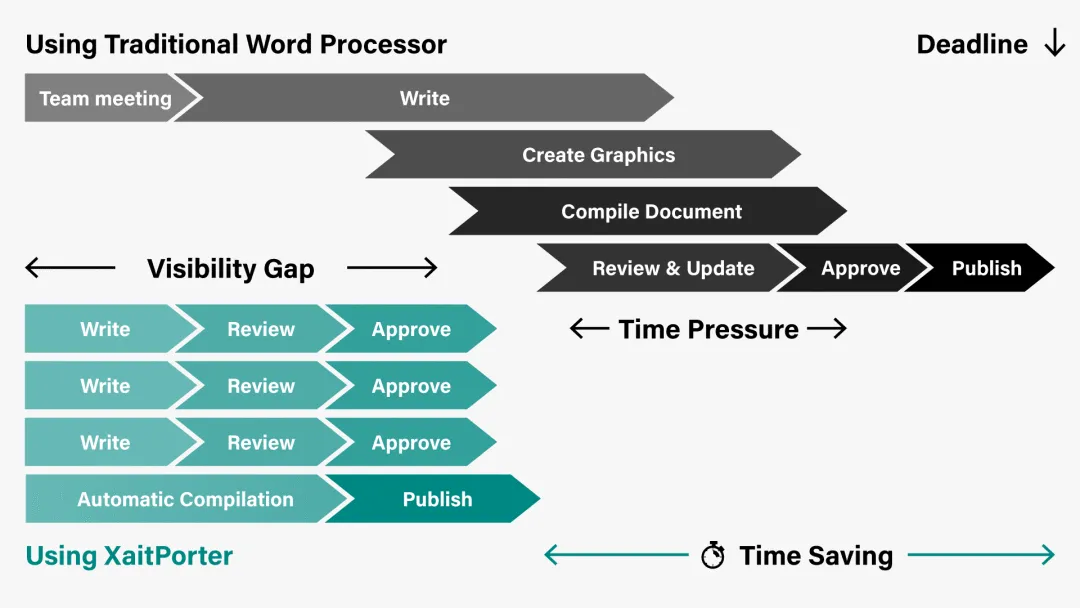

传统影视是“串行”的:写完剧本才能画分镜,画完分镜才能拍(生),拍完才能剪。每一个环节都依赖前一个环节的完成,整个项目周期是各环节时间的简单相加。

-

“边写边生” :在剧本创作阶段同步生成世界观概念图和角色视觉设定(第二课已详细展开)。

-

“边生边审” :在批量生成过程中,美术指导和导演同步审核每一批素材的可用性,不合格的立即调整参数重新生成。

-

“边审边剪” :审核通过的素材立即进入剪辑工作流,粗剪与后续镜头的生成同步推进。

-

“边剪边调” :粗剪过程中发现的问题——比如某个场景的整体色调偏差、某个角色的口型匹配有误——可以实时反馈到生成环节进行针对性修正,而非等到精剪阶段才发现。

小云雀短剧Agent的“故事蓝图”机制是这一模式的典型落地:系统生成分镜和角色设定后,创作者可以在“蓝图”界面上逐个分镜修改提示词和角色引用,资产库里还附带人物小传,不满意可以随时替换。这意味着审查和调整不是“等全部生成完再说”,而是实时并行。

梦境引擎武汉团队的3人协作模式是“并行工作流”的最佳实践:

-

美术设定负责视觉资产建设——在剧本确认后立即开始角色和场景的AI生成,锁定风格和视觉锚点。

-

AI生成师拿到分镜表和视觉资产后立即开始批量生成视频素材,每完成一批就交付给剪辑师。

-

剪辑师不等待所有素材生成完毕——而是拿到一批就剪一批,边剪边反馈需要补足的镜头或需要修复的问题。

3个人、一周、一部十几集漫剧。同期跑着8个项目。AI能够放大个人价值:“一个优秀导演的镜头感、审美判断,以前只存在他脑子里,一天只能干一部戏。现在呢?这些能力可以被复制、被复用,同时驱动十个项目。”

这个案例指向一个核心洞察:AI影视最大的效率提升,不是“生成更快了”,而是“等待消失了”。 并行工作流消除了传统影视中最大的隐性成本——沟通等待和环节切换。

-

真人短剧一部成本约100万元,同等热度的AI短剧成本约10万-20万元。

-

AI漫剧每分钟制作成本400至2500元,较传统下降90%。

-

可灵AI将《太平年》电视剧中传统需两个月的虚拟场景制作周期压缩至两周以内。

-

剪辑环节:传统短剧中剪辑师占项目成本的5%-10%;AI短剧中,由于粗剪自动化、整理智能化,剪辑人工成本压缩约70%,但剪辑师的“审美判断”价值反而更突出。

-

调色环节:传统专业调色师单集收费约1000-3000元;AI短剧中,色彩在资产阶段被锁定,调色工作大幅缩减,人力成本下降60%-80%。

-

配音环节:传统配音演员单集收费500-3000元;AI配音单集算力成本仅50-200元。

-

等待成本:这是最大的隐性节省。传统影视中,每个环节之间的等待(等档期、等审批、等返工)累计占总周期的30%-50%。AI并行工作流几乎消除了这部分成本。

梦境引擎武汉团队的例子中,AI工具的积分价格今年涨了4倍,“我们每天都得精打细算,能省就省”。这说明虽然AI显著降低了单位制作成本,但算力成本正在上升,团队需要不断优化工作流来对冲这一趋势。

a16z的Justine Moore提出的“AI剪辑代理”概念,是对这一趋势最精炼的概括。

她的核心判断是:当视觉大模型能理解内容语义与叙事结构、当多模态工具能被统一调度、当生成模型在美学品质上足够稳定时,AI不再只是“生成素材的工具”,而是能统筹流程、打磨细节、校准节奏的“代理剪辑师”。

-

生成层:负责素材生产——文生图、图生视频、文生视频、原生音画同步。这一层的技术壁垒正在迅速降低,2026年头部模型的可用率已普遍超过90%。

-

剪辑层:负责素材调度、节奏控制、情绪校准、一致性维护。这一层才是真正拉开差距的地方——同样的生成素材,经过不同的剪辑调度,成片质量可能天差地别。

正如Justine Moore所言:AI代理将大幅提升优质视频的供给,正如Cursor变革了编程,这些代理也将同样变革视频制作。

Eddie AI将自己定位为“助理剪辑师”,是最贴切的比喻:它不替代导演的审美判断,但把整理、分类、同步、粗剪这些“脏活累活”全包了。真正拉开专业创作者和业余创作者差距的,不是谁能生成更炫的画面,而是谁能用剪辑把故事讲好。

-

剪辑正在从“后期环节”进化为“全流程中枢” 。在AI影视工作流中,剪辑不再被动等待素材,而是主动调度各环节的输出——从剧本阶段的节奏规划,到资产建设阶段的色彩锁定,到生成阶段的实时审核,剪辑的触角延伸到了创作的每一个环节。

-

“后期前置”是AI影视效率革命的核心逻辑。调色在资产阶段确定色彩体系,配音在剧本阶段建立声音原型,作曲在分镜阶段生成BGM原型——所有“后期工作”被前置到创意阶段,使得批量生成环节的输出天然对齐、无需返工。

-

“边写、边生、边剪”并行工作流正在成为新常态。梦境引擎3人团队一周一部剧、小云雀Agent 5人团队8天爆款——这些效率神话的背后,不是“AI更快了”,而是“等待消失了”。并行工作流消除了传统影视最大的隐性成本。

-

剪辑层才是AI影视的终极胜负手。a16z的判断一针见血:下一阶段真正拉开差距的不是生成层,而是剪辑层。AI Agent正在演化为看不见的“后期团队”,能统筹流程、打磨细节、校准节奏甚至塑造品味的人,才是AI影视时代最有价值的创作者。

-

你目前的AI影视工作流中,剪辑是“后期收尾”还是“全流程调度”?如果你的剪辑师在剧本阶段就参与进来,能提前避免哪些返工问题?

-

你的项目中,调色、配音、作曲这些工作是在什么时候完成的?如果把它们前置到视觉资产建设阶段,预期能压缩多少总周期?

-

你的团队是“串行”还是“并行”作业?各环节之间是否存在“等待期”?如果采用梦境引擎的“3人并行”模式,你的团队结构需要做什么调整?

-

绘制你的项目全流程SOP图:用本节课提供的六阶段SOP框架为模板,绘制你当前项目的全流程SOP图,标注每个阶段的输入、输出、工具和时间。找出最耗时或最易出问题的环节,思考如何优化。

-

做一次“调色前置”实验:在下一个项目中,于视觉资产建设阶段就确定色彩体系(色板+光影参考),并记录批量生成阶段因色彩问题返工的次数。与上一个没有做调色前置的项目做对比,量化前置的效率提升。

-

尝试一次AI剪辑代理:从Eddie AI、Adobe Firefly Quick Cut、万兴喵影AI智能生产线中任选一个,用你的项目素材做一次AI粗剪实验。记录AI完成粗剪所需的时间和人工精修所需的时间,计算总体效率提升。

下节课预告:第九课《OpenClaw前瞻》——我们将深入OpenClaw(龙虾)与影视行业结合案例演示,探讨AI基建投资回报率核算,综合对比AI软硬件算力与传统人工时间成本,为整个系列课程做系统性收尾。

夜雨聆风

夜雨聆风