实战:AI,打造一条完整的“个人视频工作室流”

我用AI,从0做了一条40秒的产品视频,顺便搭了一条完整的“个人工作室流”

这件事情其实挺突然的。

就是有个新产品,朋友直接甩给我一份Word,里面是功能、卖点,还有他们希望对外讲的东西。

我当时脑子里的想法很简单:这不就是AI该干的活吗?

第一步:直接上AI,结果被打回

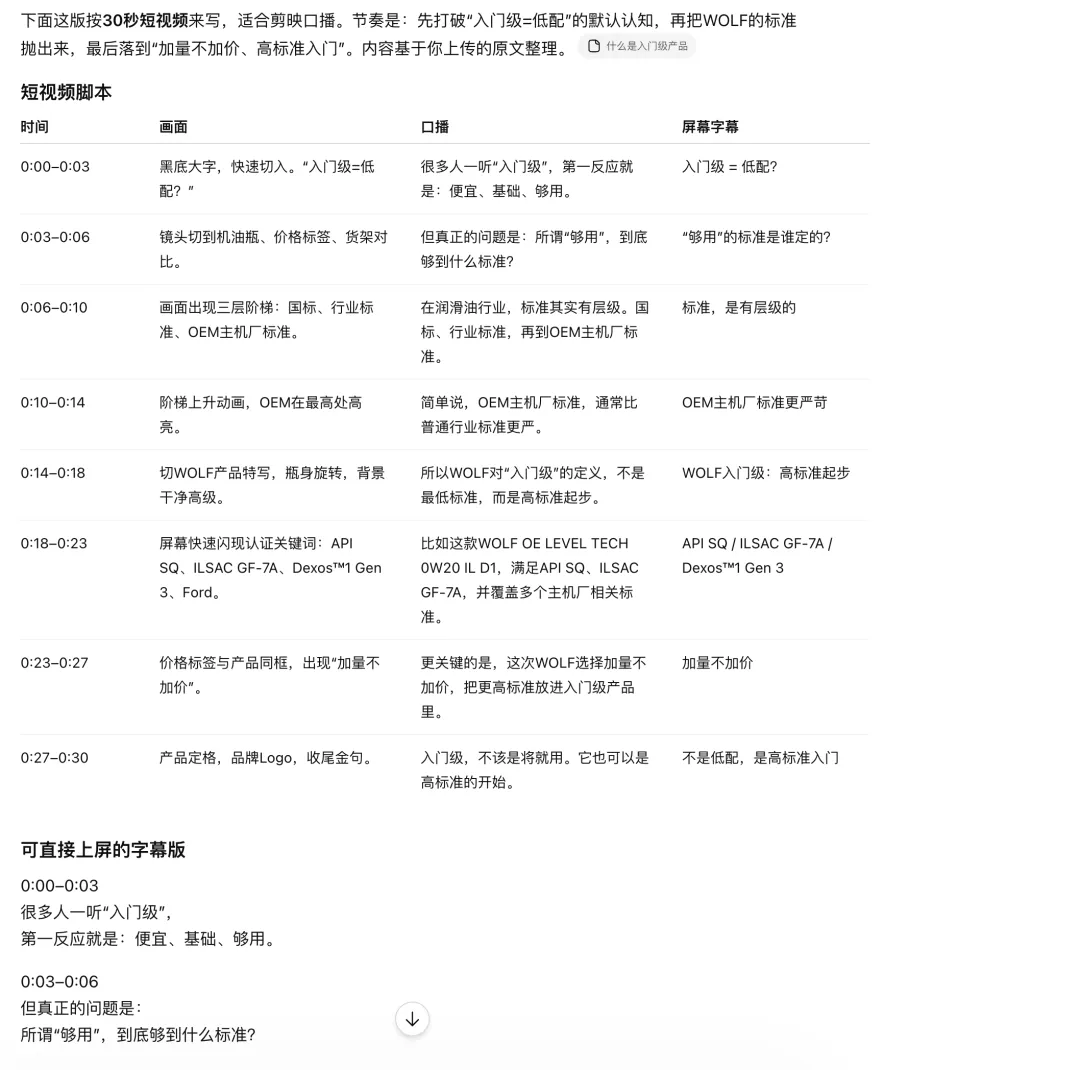

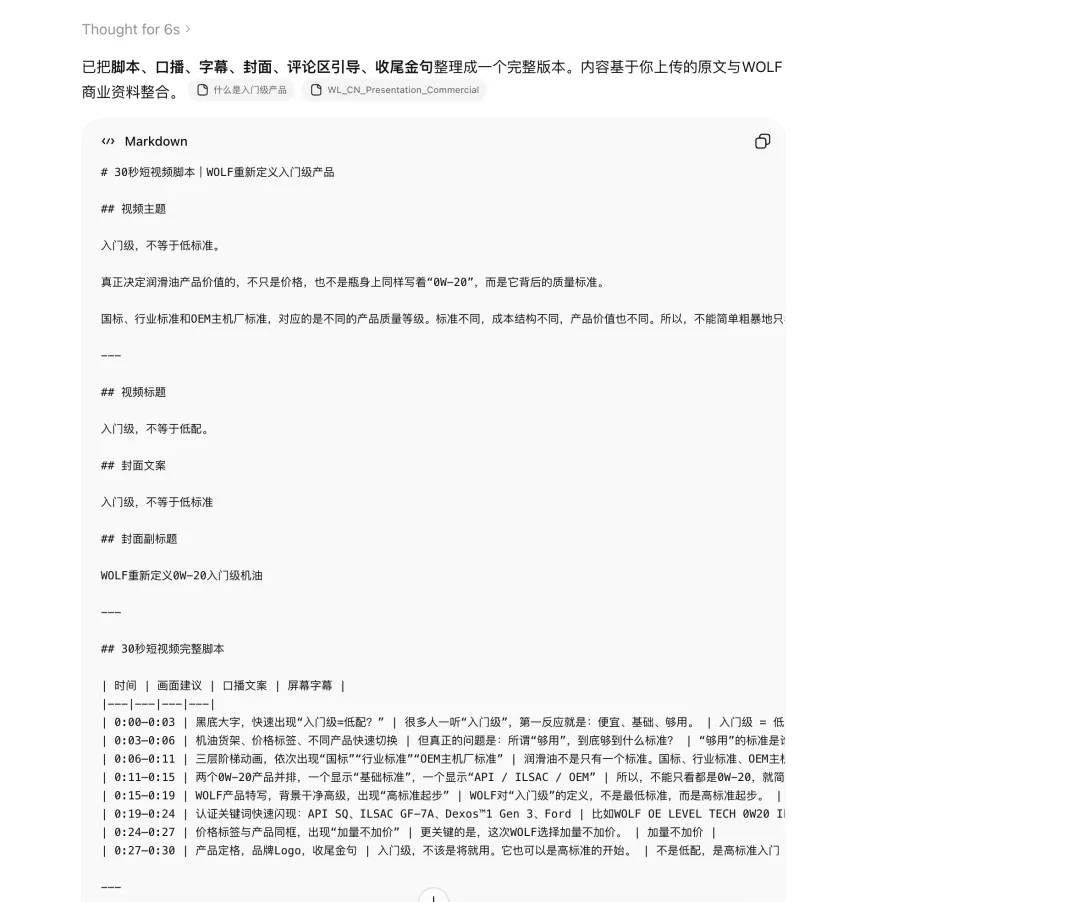

于是我几乎没怎么加工,就把整份内容丢给了AI,让它直接帮我出一版40秒的视频脚本,顺带把字幕和分镜也一起做了。

几秒钟就出来了。

第一眼看上去其实挺唬人的,结构也有,节奏也在,甚至连画面都帮你想好了,我当时的感觉是:差不多可以用了。

然后我就发给朋友。

很快就被打回来了。

对方说得很直接:内容没问题,但重点不对。

后来回头看,其实问题很简单——我把一堆信息丢给AI,但没有告诉它,哪些是必须被放大的。

第二步:重新对齐“到底要说什么”

所以我停下来,没有继续改prompt,而是重新跟对方聊了一轮。

这一轮聊得比之前细很多

聊完之后,更清晰了。

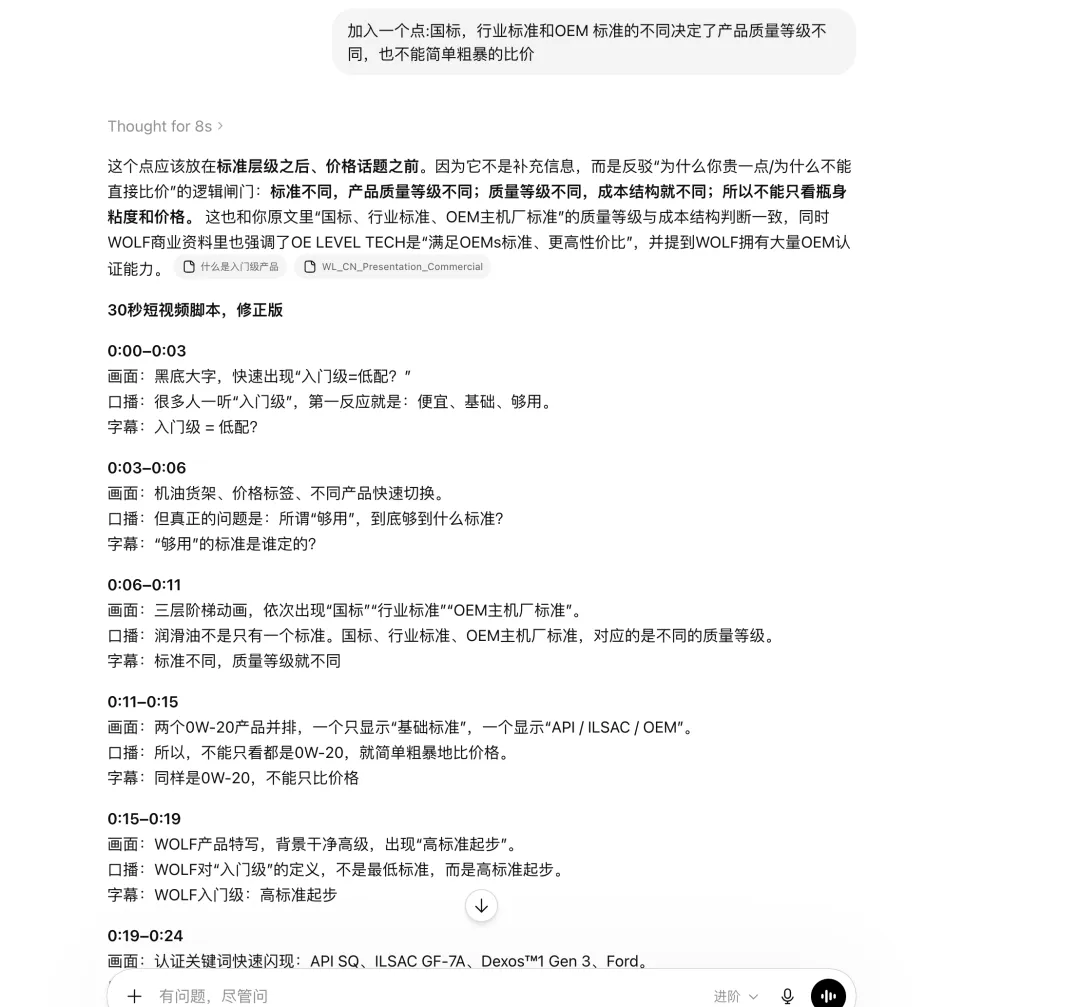

然后我再回到 AI,这一次就不再是“帮我写脚本”,而是让它围绕这些已经确认的重点,重新组织一条40秒的表达。

第二版一出来,感觉立刻就不一样了。

不是更华丽,而是更“有方向”。

第三步:把“人话”变成“机器能执行的东西”

脚本这一步搞定之后,我就想往下走了。

但很快发现一个很现实的问题:

这东西人能看懂,但工具用不了。

所以我把这份脚本丢进 code:,用一个skill把它转成 seedance 视频脚本和提示词(skill的主要内容来自松果先森)。

这一轮其实挺有意思的,同一段内容,被拆成镜头、动作、场景之后,你会明显感觉它“变形了”。

所以我没有直接拿去用,而是对了一遍,确认哪些镜头是我要的,哪些地方需要再调。

第四步:开始生成视频,但问题才刚开始

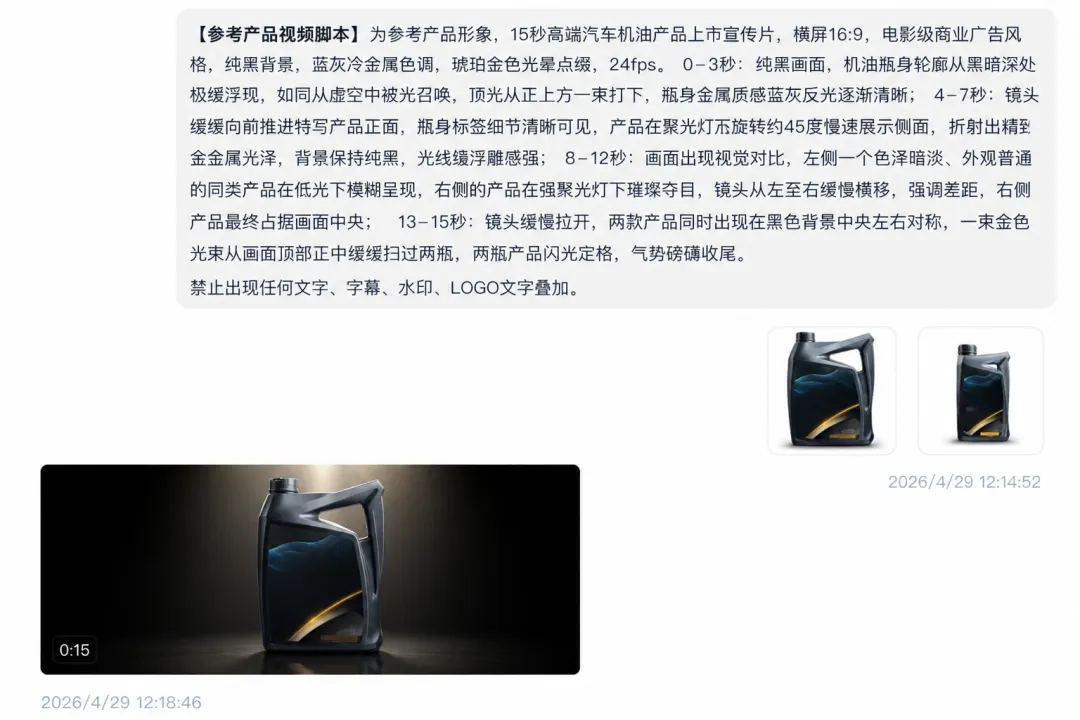

我把整套东西丢进小云雀,第一版很快就出来了。

然后问题也很快出现了。

朋友盯着一个点说:

产品标签糊了,看起来不像真的

这个问题说大不大,但挺致命的。

所以这一轮我没有去动整体,而是把标签单独拎出来处理,用 image2 的方式单独生成,然后改提示词。

重新生成一版。

第二版好很多,但还差点意思。

再调一轮。

差不多第三版的时候,这条视频基本就站住了。

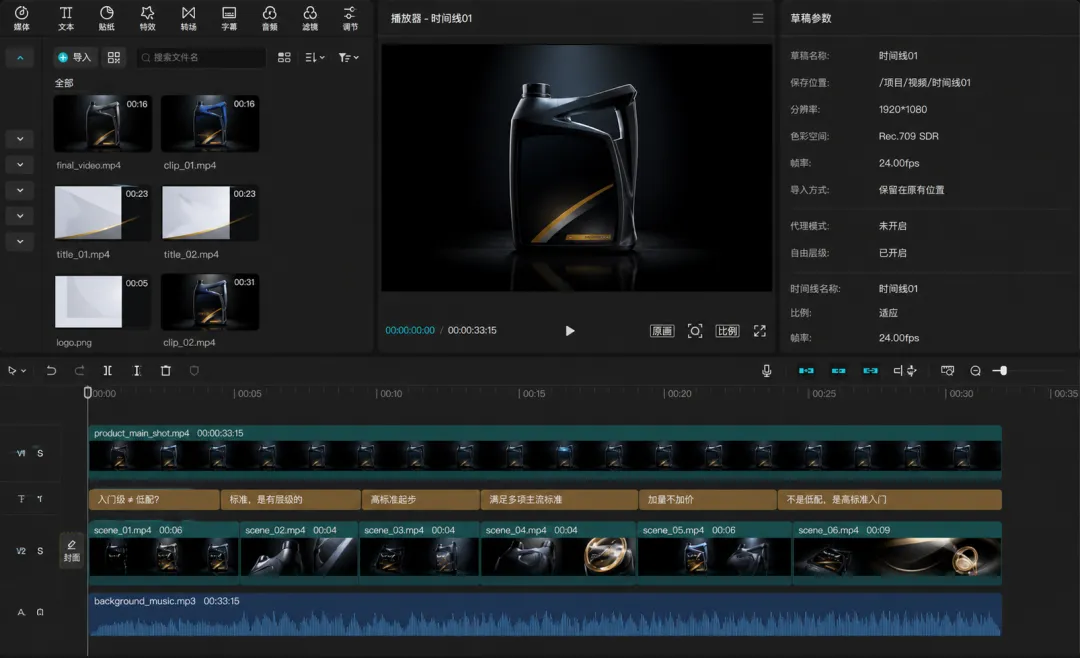

第五步:拼装画面、字幕和声音

接下来其实就是拼装。

我把视频导进剪映,然后把之前在AI里生成好的、带时间戳的字幕一起导进去。

直接用“字幕转语音”,把配音也一起做了。

这一段几乎是自动对齐的,只要字幕时间没问题,语音基本不会出错。

第六步:补最后一层“成片质感”

到这一步,其实已经是一条完整视频了。

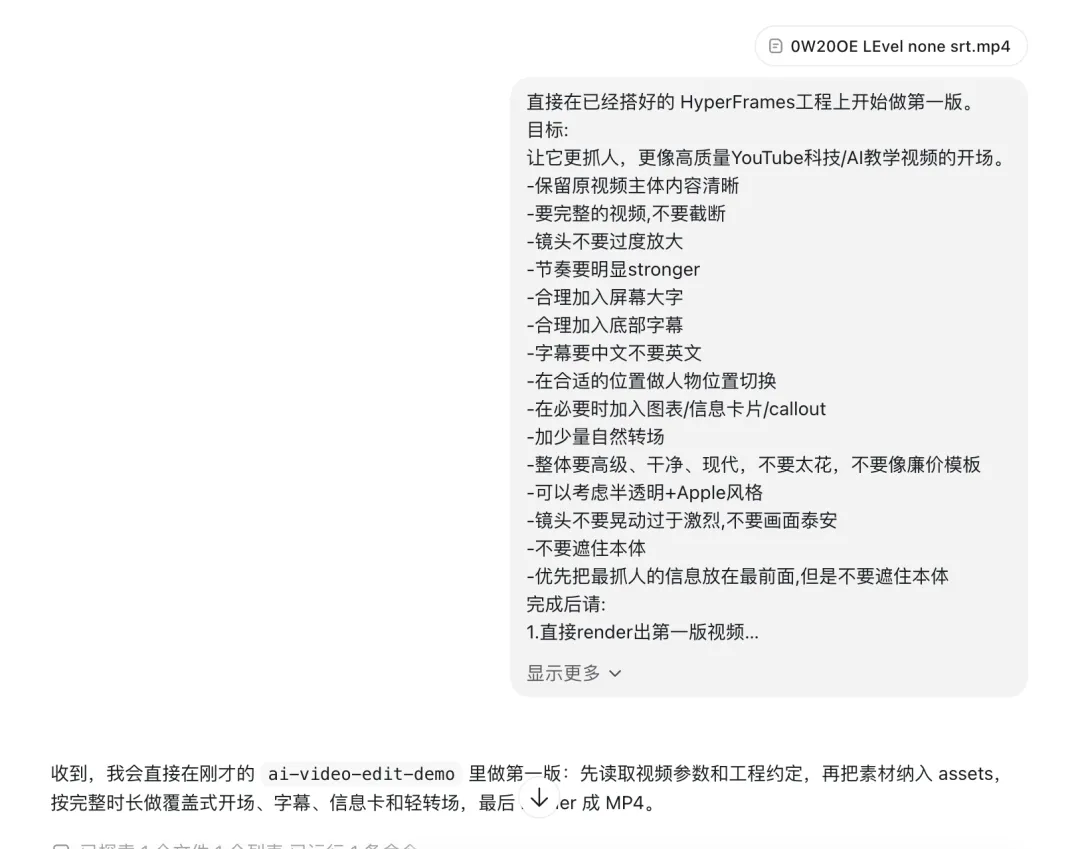

但我又做了一步:把视频和字幕丢进 Hyperframes,在 Codex 环境里跑了一轮。

这一步的感觉很明显:

原本需要手调的字幕样式、动效、节奏统一,它会帮你一次性补上。

更像是从80分,拉到可以直接交付。

最后:导出

最后只做一件事:

调整清晰度,导出。

这条40秒的视频,就结束了。看看成果吧,所有的字幕,标题,标签,动画,都是自动生成的,是不是还不错

写在最后

整个过程走下来,我有个很直观的感受:

这不是在用几个AI工具,而是在把一条原本需要几个人配合完成的流程,压缩到一个人身上。

你一会儿在干文案,一会儿在干分镜,一会儿在做制作,一会儿在做后期。

工具都在那,但每一步要不要推下去,怎么推,还是你在做判断。

这条视频看起来只有40秒,但背后其实是一整条被压缩过的工作室流程。

我只是刚好,把它用AI跑通了一遍。

夜雨聆风

夜雨聆风