AI芯片推理战场,英伟达独大被终结?

2026 年的 AI 芯片战场,早已不是当年 GPU 一家通吃的平静局面。一场围绕推理的终极争夺战,正在把整个行业拖入前所未有的大混战。

从 Anthropic 悄悄启动自研芯片,到英伟达斥资约 200 亿美元 “收编” 推理杀手 Groq,再到谷歌 TPU、亚马逊 Trainium、微软 Maia 全线出击,连英特尔都拉着 SambaNova 杀回战场。所有人都看明白了一件事:AI 的未来不在训练,而在推理;谁拿下推理,谁就拿下下一个十年。

一、战争拐点已到:推理,成了真正的主战场

过去几年,AI 行业的目光全盯在 “训练” 上 —— 烧钱、堆卡、比算力,英伟达凭借 CUDA 生态几乎垄断全局。但行业内部早已悄悄转向:大量算力需求,从训练侧疯狂涌向推理侧。

巴克莱预测很直白:到 2026 年,推理将占据 AI 总算力需求的70% 以上,是训练的 4.5 倍。

训练讲究极致并行、长时间稳定跑满;推理讲究低延迟、高吞吐、低成本、低功耗。而这些,恰恰是通用 GPU 的天生短板。

GPU 的数千个小核心、复杂调度、高功耗,在训练里是优势,放到推理场景里反而变成延迟抖动、成本高企、能耗浪费。

一个残酷现实:OpenAI 2024 年推理支出23 亿美元,是训练成本的 15 倍。推理不是一次性投入,而是永不停歇的持续烧钱。

谁能把推理成本打下来,谁就能卡住整个 AI 产业的咽喉。

二、英伟达的焦虑:200 亿拿下 Groq,守住推理防线

Groq 的出现,一度让英伟达睡不着觉。

这家由谷歌 TPU 核心成员创立的公司,直接走了一条最极端的路:扔掉硬件调度器,全部交给编译器提前规划。

芯片像一条精准到纳秒的流水线,零缓存缺失、零运行时抖动、延迟恒定。实测跑大模型:

-

推理速度达到传统 GPU 的近 10 倍 -

每 token 能耗仅为 GPU 的1/10

LPU 架构一战封神,Groq 迅速吸引 150 万开发者,估值冲到 69 亿美元。

但太强的对手,最好的归宿就是被收购。英伟达没有走传统并购,而是用人才 + 技术授权的方式,以约 200 亿美元代价把 Groq 彻底纳入版图。

表面是补强推理,深层是防御性收割:干掉最危险的挑战者,同时收走中小云厂商和模型公司的替代选项,把议价权牢牢攥在自己手里。

可这一次,英伟达挡得住单点突破,挡不住四面开花。

三、云巨头全线造反:自研芯片成标配,没人再愿被 “卡脖子”

早在 Groq 爆红之前,谷歌、亚马逊、微软就已经默默走上同一条路:自己造芯片,不看供应商脸色。

谷歌 TPU:十年磨一剑,推理时代的 “省钱杀器”

从内部应急项目,到对外开放的战略武器,谷歌用了整整十年。第七代 TPU(Ironwood)性能暴涨 4 倍,单集群可跑 9216 颗芯片。Anthropic 直接下单100 万颗,等于给 TPU 投下最硬核的信任票。谷歌的野心很简单:做推理时代最划算的公共算力引擎。

亚马逊 Trainium + Cerebras:高低搭配,通吃全场

AWS 不跟英伟达硬刚,而是走 “自研 + 外购” 双轨:

-

Trainium 负责低成本、大规模推理 -

引入 Cerebras 晶圆级芯片 WSE,啃极致低延迟的高端场景

Cerebras 有多夸张?一整块晶圆当一颗芯片,推理解码速度最高达 GPU 的25 倍。OpenAI 百亿级订单、AWS 战略合作,直接把这家曾撤回 IPO 的公司送上神坛。

Meta、微软也不闲着

Meta 与博通签下 1Gw 芯片大单;微软 Maia 早已进入 Azure 规模化服役。云厂商们的逻辑高度一致:算力是命脉,必须握在自己手里。

四、异构时代到来:没有通吃架构,只有组合最优解

这一轮混战,和当年 GPU 碾压 CPU 完全不同。不再是一家替代另一家,而是分工、分层、分场景。

-

GPU:擅长并行预填充,不会退出舞台 -

专用推理芯片(TPU/LPU/RDU):负责解码,拼速度与成本 -

CPU:重新当起 “总指挥”,管调度、工具调用、流程控制

英特尔就是靠这一点翻身。联手 SambaNova 推出三层异构推理方案:GPU 预填充 + 至强 6 CPU 调度 + RDU 解码,专门打 AI Agent 场景。测试数据很能打:

-

编译速度提升50%+ -

向量库性能快70%

曾经在 AI 浪潮里被边缘化的 Intel,正借着异构计算重回中心。

行业真相越来越清晰:未来没有万能芯片,只有最优组合。

五、算力供给侧剧变:CoreWeave 成新势力,订单直冲 878 亿美元

战场的另一边,算力基础设施也在彻底重构。一个名字越来越无法忽视:CoreWeave。

它不做模型、不做芯片,只做一件事:提供不绑定云巨头的中立 GPU 算力。

Meta 一口气签下超 350 亿美元订单;目前总储备订单已达878 亿美元。60 万张 GPU、43 座数据中心、3500 兆瓦供电容量,扩张速度恐怖。

它的存在,本身就是行业的隐喻:AI 公司需要中立、灵活、不被生态绑架的算力选项。CoreWeave 补上了这个缺口,也成为混战中最关键的 “兵力供应商”。

六、终局未至:这才是 AI 芯片最混乱、也最精彩的时刻

回到开头那一幕:Anthropic 一边签 TPU 长约,一边偷偷自研芯片。像极了当年的 Meta、微软。

这不是特例,是行业共识:模型公司必须掌握算力自主权。

2026 年的 AI 芯片战场,早已不是线性竞争:

-

英伟达守擂,但推理短板被围攻 -

云厂商自研造反,各自建生态 -

初创公司靠极致架构单点突破 -

老牌巨头借异构计算重返战场 -

模型厂下场造芯,把定义权握在手里

没有一种架构能通吃天下,没有一家公司能永久垄断,没有一条路线能绝对安全。

推理战争刚刚进入最激烈的阶段。谁能在成本、延迟、功耗、生态、可控性五项里拿到最优解,谁就是下一个时代的统治者。

而现在,胜负未定,混战正酣。

免责申明:本号聚焦相关技术分享,内容观点不代表本号立场,可追溯内容均注明来源,发布文章若存在版权等问题,请留言联系删除,谢谢。

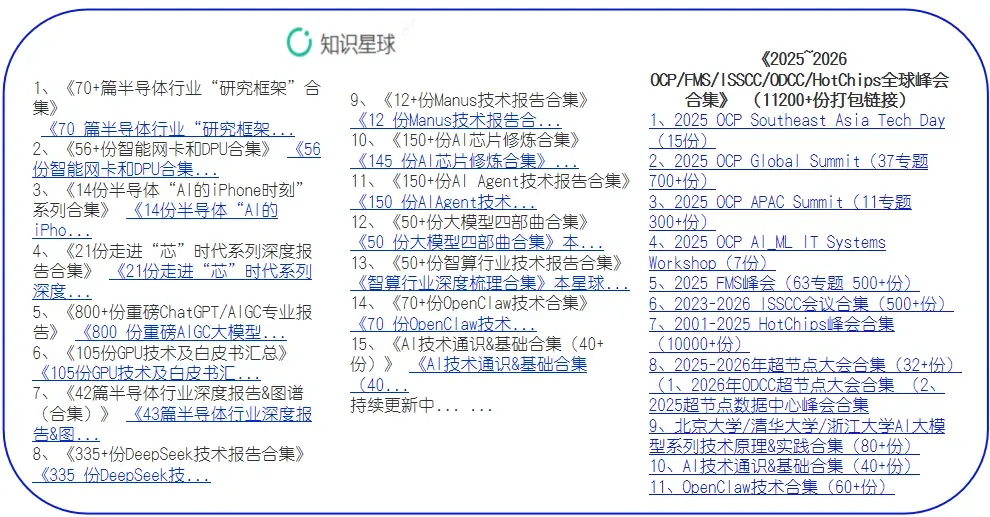

温馨提示:请通过“扫码”和“阅读原文”加入星球,获取OpenClaw合集。

夜雨聆风

夜雨聆风