Openclaw还是Hermes?还是先考虑人性吧

在真实的商业和组织系统中,任何技术选型(包括AI架构和框架选型)本质上都是受到底层的“人性选择”所驱动,而非纯粹理性的技术决定。

聊着聊着,老友抛出了他目前正在操盘的一个真实项目:他所在的集团是国内某行业头部央国企,领导要求他牵头,为集团全国的项目做一个「AI 招投标评估系统」。

当他把项目的背景、干系人和过往的历史沉淀全盘托出时,我突然陷入了沉默,并且感到一阵逻辑上的错乱。

我猛然意识到:我们刚才争论的所有技术指标,在这个真实的商业世界里,连个屁都不是。

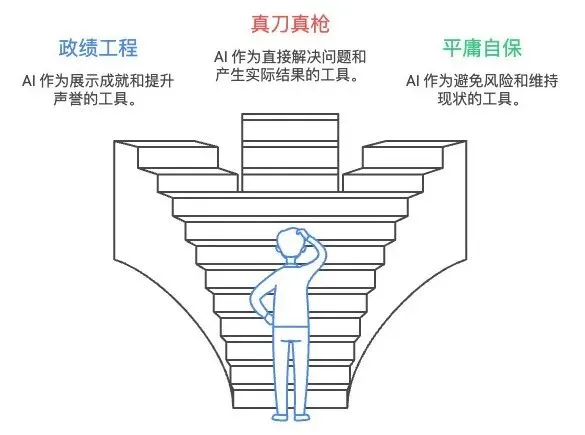

面对这个庞大的系统,我没有给他推荐任何框架,而是给出了三个截然不同的“建设剧本”。

-

剧本一:作为“投名状”的 AI(政绩工程)

这个剧本最简单。

从团队中分离出一个四五人的小团队,去 GitHub 上找几个评分最高的开源方案,接入主流的 API 进行融合、修改和封装(当然是Calude Opus)。

然后让团队中绝大部分力量投入到剧本里的核心:「可视化的 AIGC」和「算力中心」。可视化一定要炫酷,响应一定要快,一定要着重身临其境的可视化体验感。

主打一个大干快上,热热闹闹。

本质上:这里的 AI 不是工具,而是装饰。 它是负责人在年底集团大会上的一块青云梯。至于这套系统最后能不能查出有猫腻的标书?不重要。

剧本二:作为“血滴子”的 AI(真刀真枪)

这剧本,是真正属于技术原教旨主义者的狂欢。

借助 AI,做一个真正的、硬核的、没有任何死角的招投标评估系统。任何一个标书,都必须接受 AI 像素级的审视。

这种极致的专业能达到什么程度?

假设某企业投标一个“智能预测系统”,宣称其模型准确率达到 92%。我们的 AI 评估系统可以要求企业提供核心源码和测试集,然后展开一场“降维打击”:

* 代码级验证: AI 瞬间读完几万行代码,分析其算法架构。你宣称用了 Transformer,实际代码里却全是线性回归?直接毙掉。

* 复现级验证: 在沙箱环境中,AI 用企业提供的数据重新训练、测试。这 92% 是真实的,还是靠测试集泄露硬刷出来的?

* 溯源级验证: 如果这个企业宣称”我们有专利XX”,AI可以去查这个专利的实际内容、诉讼历史、甚至专利的”含金量”——是真的技术壁垒,还是防御性注册的纸面专利?

* 归因级验证: 投标书宣称“帮某大客户节省了 2000 万成本”。AI 会进行逻辑推理和穿透审查:这 2000 万,究竟是你的模型预测准了,还是赶上原材料降价,客户本来就要降成本?

这样的AI,是一把斩断一切造假和包装的利剑。它能逼出一个真相:PPT 上画的大饼,到底哪些能落地。

但这听起来无比完美的方案,却隐藏着一个致命的黑洞。

我问了老友一个问题:“系统上线后,如果集团 A 副总,笑眯眯地递给你一套 B 副总部门三年前全权负责、且已经顺利结项的招投标资料,让这套完美的 AI 系统重新评估一下。你希望你的 AI,输出什么结果?”

老友愣住了。

如果 AI 秉持专业精神,指出这个当年中标的方案放到今天看漏洞百出、存在严重利益输送风险。这等于用 AI 的名义,从根本上否定了 B 副总的历史决策。

A 副总拿到了完美的政治筹码,B 副总面临灭顶之灾。而开发这个系统的技术团队,将死无葬身之地。

所以,剧本二的本质是:AI 是一把极其锋利的武器。武器没有错,但这把武器随时可能被用来进行党同伐异。

-

剧本三:作为“免死金牌”的 AI(中庸自保)

剧本三:作为“免死金牌”的 AI(平庸自保): 这剧本,才是大多数中国复杂企业生态中的真实写照。

这套系统的核心逻辑不是“探索未知”,而是「对齐历史」。

系统基于集团过往的招投标数据进行微调与学习。这里的最高指令和核心约束是:过往项目中,凡是关键领导签字、主持过的招投标案例,AI 必须认为它是“完全合格、绝对达标、堪称完美”的。

新项目的评估基准,永远来自历史经验的“安全范围”。新标书的审核,就是与这些“完美历史标本”进行比对。

本质上:这里的 AI 不是用来突破的,而是用来锁定的。 一旦出了问题,负责人可以名正言顺地说:“这是 AI 根据张总当年定下的标杆案例为基准,审核通过的。”

AI 在这里不是智能体,而是一个拥有最强算力的“背锅侠”和维持现状的“护城河”。

选择的三层驱动范式

把这三个剧本摆在桌面上,我发现我们之前关于 OpenClaw 和 Hermes 的争论,显得无比幼稚。

因为在真实的商业和社会运行逻辑中,任何技术决策,其实都遵循着一个「三层驱动范式」:

-

第一层:人性与政治选择(为什么做?为谁做?怕什么?想保护谁?) -

第二层:业务边界划定(做什么?不做什么?底线在哪里?) -

第三层:技术工具选型(用什么框架?开源还是自研?云端还是本地?)

绝大多数的程序员和架构师,每天都在第三层(技术层)卷生卷死,以为自己在做最理性的决策。

但事实上,当你或者你的老板在第一层做出了“人性选择”的那一刻,第三层的技术路线就已经被牢牢注定了。

如果人性选择有了结果,那么第二层「业务边界划定」也一定要在不考虑具体技术(此时AI与你依然没有半毛钱关系)的前提下回答这七个问题:

|

维度 |

关键问题 |

|

任务定义 |

需要完成什么?产出物是什么? |

|

前置条件 |

需要哪些输入、数据、环境? |

|

规则约束 |

是否有必须遵循的标准、规范、流程? |

|

正确性要求 |

什么是”做对了”?如何验证? |

|

历史积累 |

过往是否有留痕、数据、经验可复用? |

|

边界界定 |

做什么?不做什么? |

|

目标导向 |

这件事最终要达成什么价值? |

当然,上面七问的答案,已经被第一层的人性选择悄悄决定了。

回到文章开头的那个问题:到底是用需要预设规则的多智能体协同,还是用具备强大“自主进化”能力的单体 Agent?

-

如果你走的是剧本二(真刀真枪),你必须需要像 Hermes 这样具备可进化能力的 AI。因为造假技术在迭代,AI 也必须不断自主进化,才能保持专业的领先。它需要敏锐地发现新的问题。 -

但如果你身处剧本三(平庸自保),你绝不能、也绝对不敢赋予 AI 任何“自主进化”的能力。

进化意味着什么?意味着系统可能会偏离安全区;意味着它某一天进化出了新标准,突然对历史的既定事实说“不”;意味着它会判断出某个“完美项目”其实是个草台班子。

在剧本三里,AI 需要的不是进化,而是「约束与传承」。它必须是一个边界焊死、绝不越雷池一步的流程机器。

结语

所以,在启动你的下一个伟大的 AI 项目之前,先关掉你的 IDE,停下对模型跑分榜单的追逐。

找个安静的地方,诚实地问自己几个问题:

-

你做这个系统,是为了解决真实的问题,还是为了营造一种“我们在拥抱 AI”的幻觉? -

你希望你的 AI,是一个敢于说出刺耳真相的孤胆英雄,还是一个永远维护你政治安全、绝不越界的沉默伙伴? -

你所在的组织,真的能够承受 AI 进化后,吐出的那个赤裸裸的真相吗?

没有绝对正确的技术。

所谓的架构设计,很多时候,只是对现实政治选择的一种技术伪装。

而在代码的世界之外,只有人性的深渊,深不见底。

夜雨聆风

夜雨聆风