生成式AI如何造“旋风”?影视创作底层技术、工具与趋势深度拆解

AI影视创作旋风狂飙:技术原理深度解析

1 引言:头部影视制作公司集体转向AI影视创作,为哪般?

2025年到2026年,如果你关注影视行业的动态,会发现一个明显的趋势:越来越多的头部制作公司开始把AI工具纳入标准工作流。从好莱坞的特效工作室到国内的短视频MCN,从广告代理商到独立电影人,AI视频生成工具不再是实验室里的玩具,而是实打实的生产力工具。

这种转向不是跟风,而是行业压力下的必然选择。

本文受众:

影视行业从业者、算法工程师、对AI技术感兴趣的行业从业者.

全文10299字,阅读时间预计20分钟。

“想象力比知识更重要。”——阿尔伯特·爱因斯坦

1.1 传统影视创作流程的资源困局

传统的影视制作是一条高度工业化的流水线,但也是一条烧钱的流水线。

一部中等规模的商业电影,前期筹备可能要半年到一年,拍摄周期两到三个月,后期制作再拖上四五个月。这还没算上宣发。在这个过程中,人力成本是最大头——导演、摄影、美术、灯光、剪辑、特效、调色,每一个环节都需要专业人员。

更麻烦的是时长风险。你拍了一部120分钟的电影,剪辑出来发现节奏拖沓,想删掉20分钟,那意味着大量镜头、场景、特效投入直接打水漂。在传统流程里,这种试错成本极高。

对于广告和短视频行业来说,问题更尖锐。客户今天说要一版方案,明天就可能推翻重来。传统流程下,一个30秒的广告片从脚本到成片可能需要两周,而AI可以在几小时内出十几版不同风格的demo。

1.2 AIGC的优势和特点

AIGC(AI Generated Content)在影视创作领域的优势可以归纳为三点:

第一,速度极快。 文本到视频、图像到视频的生成,把时间维度从”天”压缩到了”分钟”。

第二,试错成本趋近于零。 不满意?改几个提示词重新生成一版。这种低成本迭代在传统影视制作中是不可想象的。

第三,门槛大幅降低。 你不需要会操作复杂的特效软件,不需要搭建摄影棚,甚至不需要会画画。只要你有想法,能用语言描述出来,AI就能帮你可视化。

1.3 影视创作技术平权时代已来

过去,影视创作是少数人的特权。你需要昂贵的设备、专业的团队、充足的资金。现在,一个高中生用一台笔记本电脑和几款AI工具,就能做出十年前需要百万预算才能实现的视觉效果。

这不是说专业团队没价值了,而是说创作的起点被拉平了。更多人可以参与进来,更多想法可以被快速验证。这就是技术平权的本质——工具不再区分阶层,只区分创意。

2 AIGC发展历程

要理解AI视频生成现在的能力边界,得先看看它是怎么走到今天的。

2.1 从图像识别到图像生成

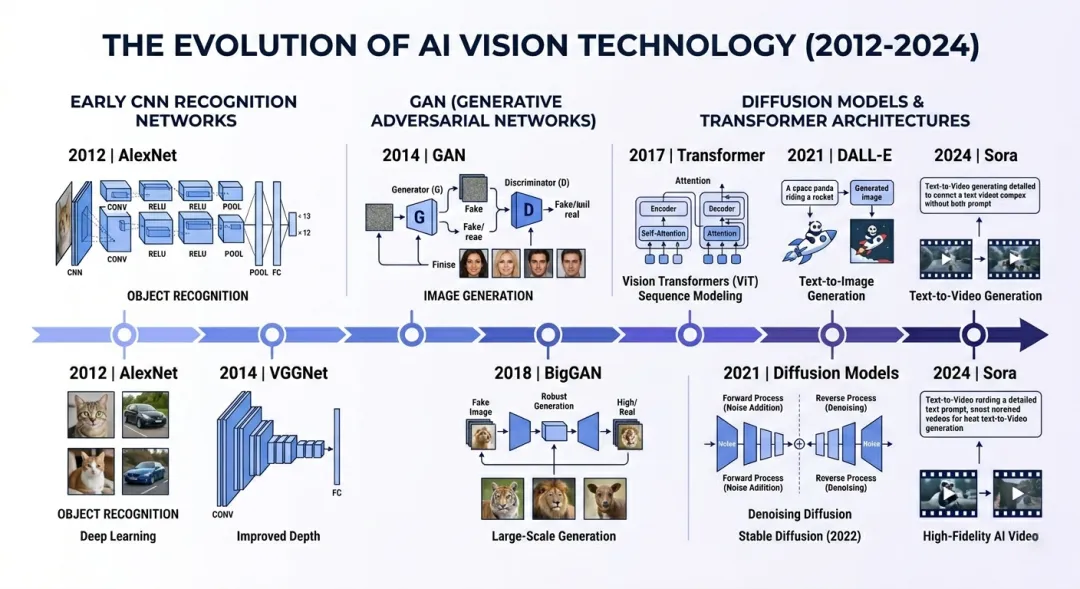

AI处理图像的早期,核心任务是识别。2012年AlexNet在ImageNet竞赛上大放异彩,开启了深度学习在计算机视觉领域的爆发。那时候AI能做的,是告诉你一张图里有猫还是狗。

随后几年,技术路线分化了。一部分人继续深耕识别、检测、分割(比如Mask R-CNN、YOLO系列),另一部分人开始探索生成——能不能让AI不仅看懂图,还能画图?

2014年,GAN(生成对抗网络)的提出是里程碑事件。GAN的核心思想很巧妙:训练两个网络互相对抗,一个生成器负责造假,一个判别器负责鉴伪,两者在博弈中共同进步。GAN能生成以假乱真的图像,但训练不稳定、模式崩溃等问题一直困扰着它。

2015年前后,VAE(变分自编码器)和自回归模型(如PixelCNN)也加入了生成阵营。这些早期尝试证明了AI生成视觉内容是可行的,但质量和可控性都还很初级。

2.2 大模型时代下的视频生成

真正的质变发生在2020年之后。

扩散模型(Diffusion Model) 的成熟彻底改变了图像生成的格局。DDPM、Stable Diffusion等模型证明,通过逐步去噪的方式,可以生成高质量、高分辨率的图像,而且训练比GAN稳定得多。

与此同时,Transformer架构 从NLP领域跨界到视觉领域。Vision Transformer(ViT)证明了自注意力机制在图像任务上的有效性。当扩散模型遇上Transformer,生成的质量和语义理解能力都上了一个台阶。

视频生成是图像生成的自然延伸,但难度指数级上升。视频不是静态图,它有时间维度——帧与帧之间要连贯,动作要流畅,物理规律要合理。早期的视频生成模型(如2022年的Make-A-Video、Imagen Video)只能生成短短几秒的低分辨率片段,动作僵硬,语义理解也有限。

直到2024年初,OpenAI发布Sora,行业被震动了。Sora能生成60秒的高清视频,画面连贯、物理合理、镜头语言丰富。虽然它当时没有对外开放,但那个demo视频让所有人意识到:视频生成模型已经跨过了”玩具”阶段,进入了”可用”阶段。

随后,国内厂商迅速跟进。快手的可灵(Kling)、字节跳动的即梦(Jimeng)、生数科技的Vidu、阿里云的通义万相等模型相继问世,形成了百花齐放的局面。

目前的视频生成模型正向着“多模态统一”的方向迈进。视频、音频、文本在同一个高维空间内进行联合训练,使得模型生成的画面不仅运动自然,甚至能自带同步的音效和精准的口型 。

2.3 全球各头部公司和模型介绍

截至2026年,视频生成领域的主要玩家和代表性模型如下:

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

这些模型各有侧重。有的强调生成时长,有的强调画面质量,有的强调可控性(比如能否精确控制镜头运动、角色动作)。目前没有一个模型能在所有维度上做到最优,所以实际工作中往往是多工具组合使用。

3 基础知识铺垫

在深入技术原理之前,我们需要先对齐几个基础概念。这些概念不复杂,但如果不理解,后面很多原理就讲不清楚。

3.1 图像的数字化表示形式

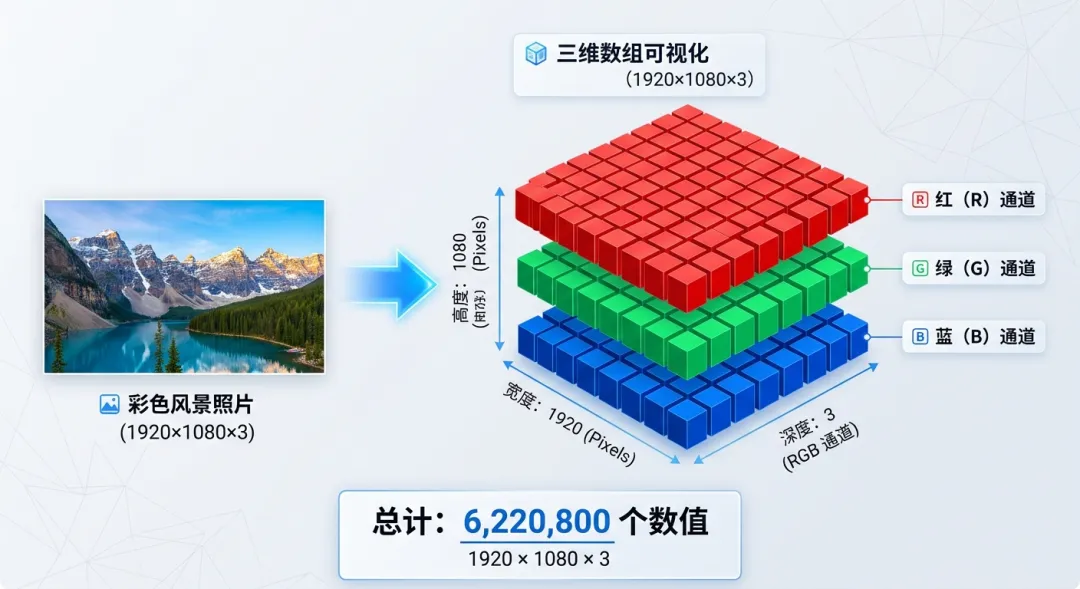

你在屏幕上看到的每一张图片,本质上都是一堆数字。

以最常见的RGB图像为例。一张1920×1080的图片,可以被看作是一个三维数组:

-

• 第一维是高度(1080个像素) -

• 第二维是宽度(1920个像素) -

• 第三维是颜色通道(R、G、B三个通道)

所以这张图片的数据量就是 1920 × 1080 × 3 = 6,220,800 个数值。每个数值通常是0到255之间的整数,表示该通道的亮度。

如果是灰度图,就只有一个通道,数据量直接减少到三分之一。

这个表示方法很直观,但它有一个问题:像素之间是孤立的。AI模型在处理时,如果直接对着这600多万个数字做运算,计算量会爆炸。所以实际中,图像会先被转换成一种更紧凑的潜在表示(Latent Representation),后面我们会详细讲。

3.2 视频是多张图片连续播放结合音频信息

视频的本质很简单:快速连续播放的静态图像,加上同步的音频轨道。

电影的标准帧率是24fps(每秒24帧),电视通常是25fps或30fps,游戏和高帧率视频可以达到60fps甚至更高。帧率越高,画面越流畅,但数据量也越大。

假设一段10秒、1920×1080、24fps的RGB视频,它的图像数据量是多少?

10秒 × 24帧/秒 × 1920 × 1080 × 3 字节 ≈ 1.49 GB

这只是未经压缩的原始数据。实际上视频文件远没有这么大,因为使用了压缩编码。

音频部分通常是独立的轨道,常见的采样率是44.1kHz或48kHz,每个采样点用16位或24位表示。音频数据量相对图像来说小得多。

视频生成模型目前主要解决的是图像序列的生成,音频部分(配音、音效、背景音乐)通常由另外的模型(如TTS、音乐生成模型)来处理,然后再合成。

3.3 现代主流音视频格式

了解一些常见的格式有助于理解视频数据的存储和处理方式:

视频编码格式:

-

• H.264/AVC:目前最通用的编码标准,兼容性好,压缩效率适中 -

• H.265/HEVC:H.264的继任者,同等画质下体积更小,但编码计算量更大 -

• AV1:新一代开源格式,提供更强的画质保留,逐渐成为流媒体新宠。 -

• ProRes/DNxHD:专业后期领域常用的中间编码格式,压缩率低但画质无损,方便剪辑调色

容器格式:

-

• MP4:最通用的容器,可以封装H.264/H.265视频和AAC音频 -

• MOV:Apple主推的格式,专业软件兼容性好 -

• MKV:开源容器,支持多音轨、多字幕,灵活性高

音频格式:

-

• AAC:目前最主流的压缩音频格式 -

• WAV/AIFF:无损格式,文件大,用于专业制作 -

• FLAC:无损压缩,音质和WAV一样但体积小一些

对于AI视频生成来说,模型内部通常不直接处理这些压缩格式,而是先解码成原始帧序列,生成完成后再编码成目标格式输出。

4 技术原理

好了,基础知识铺垫完毕,现在进入核心部分。

4.1 图像生成原理

目前主流的图像生成模型,底层技术主要有两条路线:扩散模型(Diffusion Model) 和 自回归模型(Autoregressive Model)。视频生成模型大多基于扩散模型,所以我们重点讲这个。

扩散模型的核心思想

扩散模型的灵感来自物理学中的扩散现象——比如一滴墨水滴入清水,会逐渐散开,最终均匀分布。这个过程是不可逆的:你不可能通过搅拌让墨水重新聚成一滴。

但如果我们能学习这个扩散过程的逆过程呢?也就是说,从一个完全随机的噪声图像开始,逐步去噪,最终恢复出一张清晰的图片。

这就是扩散模型的基本框架,分为两个阶段:

前向过程(Forward Process):给一张真实图片逐步加噪声,加T次之后,图片变成纯粹的随机噪声。这个过程是固定的,不需要学习。

反向过程(Reverse Process):训练一个神经网络,学习如何从噪声中逐步恢复出原始图片。给定当前噪声状态,网络预测应该去掉多少噪声,从而一步步逼近真实图像。

训练完成后,生成图片的过程就是:随机采样一个噪声图,然后用训练好的网络反复去噪T次,最终得到一张清晰的生成图像。

从像素空间到潜在空间

如果直接在原始像素空间(1920×1080×3)上做扩散,计算量太大了。Stable Diffusion的聪明之处在于引入了一个变分自编码器(VAE):

-

• 编码器(Encoder):把高维的像素图像压缩到低维的潜在空间(Latent Space),比如从 512×512×3 压缩到 64×64×4 -

• 扩散过程:在低维潜在空间中进行,计算量大幅降低 -

• 解码器(Decoder):把生成的潜在表示还原成高分辨率图像

这个压缩不是简单的缩放,而是学习了一种有意义的语义表示。在潜在空间里,相近的图像在几何距离上也相近,这让模型更容易学习图像的语义结构。

文本如何控制图像生成

扩散模型本身不知道你要生成什么。要让模型按照文本描述生成图像,需要引入条件机制。

具体做法是:把文本通过一个叫文本编码器(Text Encoder) 的模型(通常是CLIP的文本编码器或T5模型)转换成文本嵌入(Text Embedding),然后在扩散的每一步,把这个文本嵌入作为条件输入给去噪网络。

去噪网络(通常是一个U-Net或Transformer架构)在预测噪声时,会同时参考当前的噪声状态和文本条件,从而生成与文本语义匹配的图像。

这个过程可以抽象为:

生成图像 = 扩散模型(随机噪声, 文本条件)图像生成模型的关键技术组件

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

4.2 视频生成原理

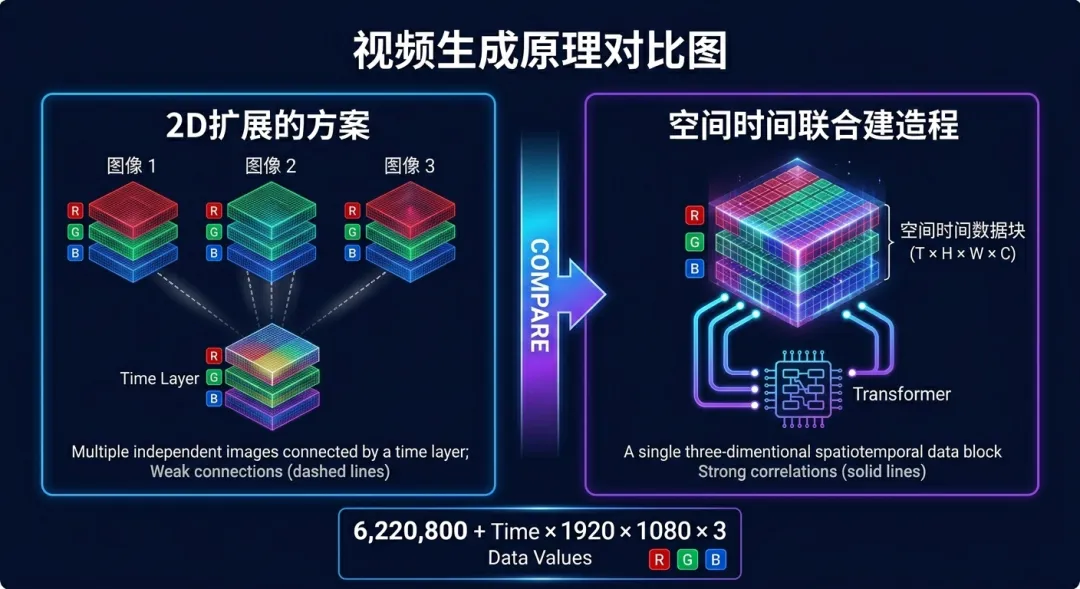

视频生成在图像生成的基础上增加了一个维度:时间。

从2D到3D:时空联合建模

如果把视频看作一个三维数据块(宽度×高度×时间),那么视频生成就是在三维空间中的扩散过程。

但直接处理三维数据计算量太大。目前的视频生成模型主要有两种策略:

策略一:基于2D扩散模型的扩展

早期的方法(如AnimateDiff、ModelScopeT2V)是在预训练的2D图像扩散模型基础上,插入时间注意力层(Temporal Attention) 或时间卷积层。这样,模型先利用2D模型生成每一帧的空间内容,再通过时间层保证帧与帧之间的连贯性。

优点是训练成本低,可以复用大量图像数据预训练的知识。缺点是时间一致性不够好,容易出现闪烁、变形等问题。

策略二:原生3D/时空联合建模

更先进的方法(如Sora、可灵)从一开始就采用时空联合的Transformer架构。输入不是单张图片的潜在表示,而是视频片段的时空潜在表示(Spacetime Latent Patches)。

具体来说:

-

1. 视频先被VAE编码成时空潜在块(类似把视频切成时空立方体) -

2. 这些时空块被展平成一维序列,输入Transformer -

3. Transformer通过自注意力机制,同时建模空间关系(同一帧内不同区域的关系)和时间关系(不同帧同一位置的变化) -

4. 输出经过解码器还原成视频帧

这种方法计算量更大,但生成质量更高,时间一致性更好,能更好地理解物体的运动和物理交互。

关键帧插值 vs 端到端生成

视频生成还有另一种思路:先生成少数关键帧,再插值生成中间帧。这种方法计算效率高,但插值的质量取决于关键帧的质量和插值算法的智能程度。

目前主流的视频生成模型(Sora、可灵、Veo等)都是端到端生成,即直接从噪声中生成完整的视频序列,不依赖显式的关键帧插值。这样生成的动作更自然,但计算成本也更高。

4.3 技术发展路径

AI视频生成技术的发展,大致经历了三个阶段:

第一阶段:基于GAN和VAE的早期尝试(2018-2021)

代表作有DVD-GAN、TGAN等。这些模型能生成非常短的视频片段(通常不到1秒),分辨率低,内容简单(如移动的数字、简单的几何图形)。主要问题是模式崩溃和训练不稳定。

第二阶段:基于扩散模型的突破(2022-2023)

Make-A-Video、Imagen Video、Gen-2等模型出现。扩散模型解决了训练稳定性问题,生成质量大幅提升。但受限于算力和模型规模,生成时长仍然很短(4-16秒),且物理合理性不足。

第三阶段:大模型+规模化数据(2024至今)

Sora的出现标志着进入第三阶段。核心变化是:

-

• 模型规模急剧扩大:从几亿参数到几十亿甚至上百亿参数 -

• 数据规模和质量提升:使用海量高质量视频数据训练 -

• 架构升级:从U-Net为主的扩散模型转向Transformer-based的扩散模型 -

• 涌现能力出现:模型开始展现出对物理世界规律的理解(如重力、碰撞、流体)

这个发展路径和NLP领域的大模型发展非常相似:当模型和数据规模突破某个临界点后,能力会出现质的飞跃。

4.4 剧本、角色、分镜、音频——长视频制作的原理

目前单个AI模型直接生成一部长电影还不现实。实际的长视频制作,是把AI能力拆解到不同环节,再整合起来。

剧本生成

这是目前最成熟的环节。大语言模型(GPT-4、Claude、通义千问等)已经能写出结构完整、情节合理的剧本。但需要注意:

-

• AI擅长套路化的叙事,对深度情感刻画和原创性隐喻还比较弱 -

• 需要人工把控核心创意和价值观导向

角色一致性

长视频最大的技术难点之一,是如何让同一个角色在不同镜头、不同场景中保持一致的外观。

目前的解决方案包括:

-

• 角色参考图(Character Reference):提供多张角色照片作为条件输入 -

• LoRA/DreamBooth微调:用特定角色的图片微调模型,让模型”记住”这个角色 -

• 面部一致性网络:在生成过程中引入面部识别和特征匹配机制 -

• ID Embedding:将角色身份编码为固定向量,在生成时注入

但这些方法都不能做到100%一致,尤其是在角色有大幅度动作、侧脸、逆光等复杂情况下,仍然会出现”变脸”问题。

分镜生成

分镜(Storyboard)是连接剧本和成片的桥梁。AI在这一环节的流程通常是:

-

1. 剧本解析:LLM提取场景描述、镜头类型、角色动作 -

2. 分镜草图生成:用图像模型生成每个关键镜头的画面 -

3. 镜头语言控制:通过提示词或控制网络(ControlNet)指定镜头运动(推、拉、摇、移、跟)

一些工具(如Runway的Storyboard模式)已经开始支持基于分镜的批量视频生成。

音频生成

视频生成模型通常只输出画面,音频需要单独处理:

-

• 配音(TTS):ElevenLabs、Azure TTS、讯飞等,支持情感控制和音色克隆 -

• 音效(SFX):ElevenLabs Sound Effects、Meta的AudioGen等 -

• 背景音乐:Suno、Udio等音乐生成模型

最终,画面和音频在剪辑软件(如Premiere、DaVinci Resolve、剪映)中进行同步和混音。

4.5 影视AI Agent的整合能力

上面说的各个环节,如果每个都用不同的工具,操作起来很繁琐。于是出现了影视AI Agent的概念。

AI Agent不是单一的模型,而是一个能够自主规划、调用工具、执行任务的智能系统。在影视创作场景中,它的工作方式大概是:

-

1. 理解需求:接收用户的创作意图(如”帮我做一个30秒的赛博朋克风格产品广告”) -

2. 任务拆解:自动分解为剧本、分镜、角色、视频生成、音频生成、剪辑等子任务 -

3. 工具调用:根据每个子任务,调用最合适的模型或API -

4. 质量检查:对生成结果进行初步评估,如果不合格就重新生成或调整参数 -

5. 输出整合:把各个环节的结果合成为最终成片

目前这个领域还在早期阶段,代表性的尝试包括一些自动化的AI视频工作流平台,例如爱奇艺的纳逗Pro。完全自主的”一键成片”还不现实,但半自动化的Agent辅助已经在大幅提升效率。

4.6 常见问题QA(技术原理相关)

Q:为什么AI生成的视频有时候会出现手指变形、物体穿模等问题?

A:根本原因是模型对三维空间结构和物理约束的理解还不够精确。扩散模型学习的是像素层面的统计规律,而不是真正的三维几何。当生成复杂交互(如手握杯子、人物拥抱)时,模型容易”猜错”空间关系。这是当前所有生成模型的共同瓶颈。

Q:视频生成模型的”理解能力”是怎么来的?

A:主要来自训练数据中的文本-视频对。模型通过看海量带有描述文字的视频,学习到”文本描述”和”视觉内容”之间的对应关系。当模型足够大、数据足够多时,它会内隐地捕捉到一些物理规律(如物体不会凭空消失、重力方向向下),但这不等于真正的物理推理能力。

5 进阶:模型发展方向

5.1 AIGC视频创作的最佳实现路径

基于当前的技术现状,我认为最高效的视频创作路径是”AI生成+人工精修”的混合工作流,而不是追求完全自动化。

具体建议:

对于短视频(15-60秒):

-

• 直接用文本/图像生成视频,快速出片 -

• 重点在于提示词工程,描述清楚风格、镜头运动、情绪 -

• 用AI配音和背景音乐补齐音频

对于中长视频(1-10分钟):

-

• 先用LLM写剧本和分镜 -

• 批量生成关键镜头,筛选可用素材 -

• 在剪辑软件中拼接,人工调整节奏和转场 -

• 对不满意的镜头局部重绘或重新生成

对于专业级项目:

-

• AI用于前期概念设计( mood board、概念图、预演动画) -

• 实拍为主,AI用于特效补充和场景延伸 -

• 后期用AI辅助调色、降噪、补帧

5.2 AIGC视频的先天缺陷

必须清醒地认识到,当前AI视频生成有几个结构性缺陷:

-

1. 物理合理性不足模型能生成看起来很真的画面,但细究起来,物体碰撞、流体运动、光影变化经常不符合物理规律。这是因为模型学习的是像素统计,而不是物理仿真。 -

2. 文本渲染能力差让AI在视频中生成准确的文字(如招牌、屏幕显示内容)非常困难。模型对字符级别的精确控制几乎为零。 -

3. 复杂交互场景崩坏多人互动、精细的手部动作、复杂的机械运动,这些场景的生成失败率很高。 -

4. 语义理解有边界模型对抽象概念、文化隐喻、情感细腻度的理解很浅。它能生成”一个悲伤的人”,但很难生成”一个强忍泪水却嘴角微微上扬的复杂表情”。

5.3 文化、人物肖像版权的压力

这是AI视频生成领域最棘手的非技术问题。

人物肖像权:如果你用AI生成了一个看起来像某位明星的角色,是否构成侵权?目前法律界还没有统一结论,但风险是真实存在的。很多平台已经开始要求用户对生成内容负责,并限制特定人物形象的生成。

文化敏感性:AI模型训练数据来自全球互联网,不可避免地会带有文化偏见。生成特定文化背景的内容时,容易出现刻板印象或不尊重的呈现。

版权归属:AI生成的视频,版权到底归谁?归用户?归模型提供商?还是不受版权保护?不同国家和地区的法律规定差异很大。

对于创作者来说,最安全的做法是:

-

• 不生成真实人物的肖像 -

• 对生成内容进行人工审核 -

• 了解并遵守所在地区的相关法律法规

5.4 OpenAI 为何叫停视频模型

OpenAI在2024年底到2025年初对Sora的开放策略非常谨慎,2026年正式宣布叫停了面向普通用户的大规模开放。原因不是技术问题,而是安全和社会影响考量:

深度伪造(Deepfake)风险:高质量视频生成技术如果被滥用,可以制造以假乱真的虚假新闻、诈骗视频、色情内容。Sora级别的生成质量,已经足以骗过大多数普通观众。

选举安全:在多个国家的选举周期内,AI生成的虚假政治视频成为重大威胁。OpenAI作为行业标杆,必须考虑政治和社会压力。

内容审核成本:开放一个能生成任意视频的工具,需要极其强大的内容审核系统。审核不到位,平台会面临法律和舆论风险。

算力成本:视频生成比文本生成消耗的计算资源高几个数量级。大规模开放意味着巨大的基础设施投入。

所以OpenAI选择了更保守的策略:仅向经过审核的企业和创作者开放API,而不是面向所有用户。这不是技术倒退,而是技术能力超前于社会治理能力时的必然选择。

OpenAI宣布下线Sora的时间是2026年3月24日(当地时间)。根据官方公布的具体时间表:Sora网页端和应用程序将于2026年4月26日下线Sora API服务将于2026年9月24日停止服务

5.5 未来技术发展方向

展望未来,AI视频生成技术可能在以下几个方向取得突破:

-

1. 世界模型(World Model)

目前的视频生成模型是”预测像素”,未来的方向是构建世界模型——让AI真正理解三维空间、物理规律和因果关系。这样生成的视频不仅看起来真,而且在物理上也是合理的。

-

2. 实时生成与交互

现在的视频生成是”批处理”模式:输入提示词,等待几分钟出片。未来的方向是实时生成,用户可以通过语音、手势、控制器与虚拟场景实时交互,类似《黑客帝国》中的即时世界构建。

-

3. 多模态统一模型

把文本、图像、视频、音频的生成能力整合到一个统一的模型中,而不是现在的”分而治之”。这样可以实现更一致的风格、更自然的音视频同步。

-

4. 可控性大幅提升

通过更精细的控制机制(如3D骨骼、运动轨迹、相机参数),让创作者能精确控制画面中的每一个元素,而不是靠运气抽卡。

-

5. 个性化与记忆

模型能够记住特定用户的偏好、风格、常用角色,越用越顺手,成为真正的创作伙伴。

6 常见问题

6.1 为什么一次只能生成最多十几秒的视频?

这是被问得最多的问题。核心原因有三个:

第一,显存限制。

视频是三维数据(宽×高×时间)。生成一段视频,模型需要在显存中同时保存所有帧的潜在表示。如果生成60秒、24fps的视频,那就是1440帧。即使经过VAE压缩,这个数据量也远超当前GPU的显存容量(通常24GB-80GB)。

目前的解决方案是分段生成:先生成前5秒,再生成后5秒,然后想办法拼接。但拼接处的连贯性是个难题。

第二,训练数据的限制。

高质量的长视频数据非常稀缺。互联网上虽然有海量视频,但绝大多数是低质量的(抖动、模糊、剪辑混乱)。用于训练的长视频数据需要是连续、稳定、有标注的,这类数据量有限。

第三,误差累积。

扩散模型是逐步去噪的。在生成过程中,每一帧的小误差会随时间累积。视频越长,后面的帧偏离预期的概率越大。这就是为什么AI视频后半段往往比前半段质量差。

技术上,这个问题正在通过滑动窗口生成、因果注意力机制、级联生成等方法缓解,但短期内还看不到生成小时级别视频的突破。

6.2 长视频的人物一致性问题如何解决?

人物一致性是长视频制作中最让人头疼的问题。目前业界的主要应对策略:

技术层面:

-

• IP-Adapter / FaceID:将参考人物的面部特征编码为固定向量,在每一帧生成时注入 -

• LoRA微调:用目标人物的10-20张图片训练一个轻量级适配器,让模型学会这个特定人物 -

• 视频到视频的转换:先生成一版低质量但人物一致的视频,再用视频重绘模型提升画质 -

• 分段一致性控制:把长视频切成短片段,每段用相同的种子和参考图生成,然后在后期拼接

工作流层面:

-

• 减少正面特写:侧脸、背影、远景对一致性要求较低 -

• 善用遮挡和转场:用物体遮挡、镜头切换来掩盖不一致 -

• 后期修复:用传统的人脸追踪和替换技术(如DeepFaceLab)修正崩坏的镜头

坦白说,目前没有任何方法能保证100%的一致性。在长视频项目中,人工干预仍然是必不可少的。

6.3 推理模型和AIGC模型的收费方式为什么不一样?

这是商业模式的问题,不是技术问题。

大语言模型(推理模型) 通常按Token数量收费。因为文本生成的计算量相对可控,输入输出都能精确计量。

AIGC视频模型 通常按生成时长或计算资源消耗收费。原因如下:

-

1. 计算成本差异巨大:生成一段5秒视频消耗的GPU算力,可能相当于生成几千字文本的几十倍甚至上百倍。 -

2. 不确定性高:同样的提示词,生成时间可能因为队列排队、模型负载而波动,按固定Token收费不公平。 -

3. 商业模式更复杂:视频生成涉及存储、带宽、后期处理等额外成本。

所以你会看到,视频生成API通常是”每生成X秒视频收费Y元”,或者按订阅制提供每月固定的生成额度。这种定价方式更直接地反映了实际的计算资源消耗。

7 总结与展望

7.1 AIGC是效率工具,不是替代方案

写到这里,我想明确一个观点:AIGC带来了视频创作效率的飞速提升,但它不是用来替代真人的。

在以下场景中,AI具有颠覆式的效率优势:

-

• 特效类:爆炸、火焰、魔法、科幻场景,传统特效需要数周,AI几小时出demo -

• 低情感表达类:产品展示、建筑漫游、数据可视化,这类内容重在信息传递,AI完全胜任 -

• 场景类:大全景、背景环境、氛围营造,AI可以快速生成多种方案供选择

但在以下场景中,AI目前还很吃力:

-

• 极值的美学表达:那些需要精确控制光影、色彩、构图的顶级影视语言 -

• 深度情感传递:演员微妙的表情变化、眼神交流,这是人类表演艺术的精髓 -

• 复杂的叙事节奏:长片中的情绪起伏、悬念构建,需要导演对人性有深刻理解

所以,优质的演员和剧本永远稀缺。AI可以帮你把想法快速可视化,但想法本身来自人。

7.2 未来是人机协同

未来的影视创作,必定是人机协同的过程。

创作者的角色会发生变化:

-

• 从执行者变为策展人:你不需要亲手画每一帧,但需要判断哪一帧是对的 -

• 从技师变为导演:技术门槛降低了,但审美门槛和创意门槛反而提高了 -

• 从单打独斗变为系统思维:你需要理解AI的能力边界,知道什么时候用它、什么时候不用

对于行业来说,这意味着:

-

• 没有沉淀演技、只靠脸吃饭的演员,确实面临被替代的风险 -

• 但那些真正理解表演艺术、有独特个人魅力的演员,价值会更加凸显 -

• 剧本的重要性会进一步提升,因为当技术不再是瓶颈时,故事就是唯一的瓶颈

AI视频生成技术正在以月为单位迭代。今天认为不可能的事情,半年后可能就实现了。但技术的本质始终是工具,工具的价值取决于使用它的人。

希望这篇教程能帮助你理解AI视频背后的技术原理,更重要的是,帮助你在创作中找到人与机器的最佳协作方式。

工具会过时,创意不会。

最后,本文技术细节基于公开资料整理,插图由AI生成,模型能力和行业动态变化较快,部分信息可能随时间更新,如有纰漏,恳请指正。创作不易,欢迎,点赞,评论,转发,你的每一个点赞都是对我最大的鼓励和创作的动力,谢谢大家~

夜雨聆风

夜雨聆风