Nature警示!过度依赖AI正在毁掉研究生的学术思维?

最近,一位博导教授在《Nature》职业专栏分享了一个扎心的真实案例:一份逻辑完美的博士研究计划书,背后的学生竟然对专业细节一问三不知。

这种由AI制造出的能力错觉,正在悄悄透支不少研究生的学术底蕴。如果你也过分依赖AI,这篇来自一线博导的警示建议你认真看完。

目录

1. 一份堪称完美的申博计划书

2. 警惕AI制造的能力错觉

3. AI科研三步走,RCRP实操指南

故事的开头,博导教授收到了一份申请读博的研究计划书。单从纸面上看,这份文档简直无懈可击。文笔流畅,逻辑严密,连参考文献都列得整整齐齐。

但是,面试现场却让教授大跌眼镜。当他就实验细节稍微深入提问的时候,刚才在计划书里指点江山的学生,竟然瞬间语塞,眼神躲闪。

真相很快大白。这位学生没怎么读过文献,也没做过田野调查,他只是把几个关键词和假设丢进AI模型,然后搬运除了这份完美计划书。

Nature这篇文章指出,这种现象正在成为一种全球性的学术问题,能力错觉。

简单地说,就是AI输出的文字会让你误以为自己已经掌握了知识。正如申教授担心的,研究生正在失去追踪学术观点演变的耐心。

AI给出的答案往往是泛泛而谈的。在生态地质学这种讲究物理机制的领域,忽略土壤,地貌等复杂背景的结论,是很不严谨的。

这种行为属于认知卸载。当你把思考的过程也外包给算法,你大脑的连接其实会变弱。

短期内你的产出质量确实提高了,可一旦脱离AI,你的真实科研能力反而会断崖式下降。

当然,AI确实是帮我们提高了效率,但我们又不想陷入这样的错觉里,应该怎么办?Nature给出了一个鲜明的建议:不要让AI当你的影子作家,要让它当你的思维伙伴。

研究表明,如果我们在求助AI之前,先试着独立解决问题,产出的结果会强很多。先思考后AI的逻辑,是保护你学术嗅觉的关键。

为了帮学生更具独立思考能力,教授提出了一套“反向认知重构协议(RCRP)”的具体方法。

在打开跟AI的聊天框前,你要先独立检索文献,形成初步的科研假设。思考的第一步不能外包。

让AI扮演你的反对派。要求AI利用基础科学概念来反驳你的理论,然后你再用真实的实证数据去回击它的反驳。这种对话才能真的帮你完善逻辑漏洞。

故意提出一些反直觉,甚至是错误的假设,看看AI能不能识别出来。如果你能“证明AI是错的”,那就说明你对该领域的认知已经超越了概率模型的预测。

AI可以帮你做科研的杂事,但它不能代替你思考。它只是你科研路上的一根拐杖,而不是你的大脑。

参考资料:

https://www.nature.com/articles/d41586-026-00627-4

研知有术是一站式科研学术服务平台,以”AI+专家“双驱动模式为核心,整合全球10000+权威专家资源(QS百强博士领衔)及14大学科100+细分领域智库,构建覆盖课题立项到成果转化的全周期解决方案。

平台通过AI智能匹配与专家深度服务,为科研工作者提供四大核心业务:

-

论文辅导:包括各类学术论文、学位论文、基金申报书、研究计划书。

-

论文发表:包括SCI、EI、Scopus、中文核心、普刊各类级别的期刊。

-

申博辅导:包括国内外知名院校博士申请规划与辅导。

-

其他学术科研服务:包括实验服务、数据分析、编译润色、科学编辑。

助力突破学术瓶颈,实现知识高效流通与成果转化。

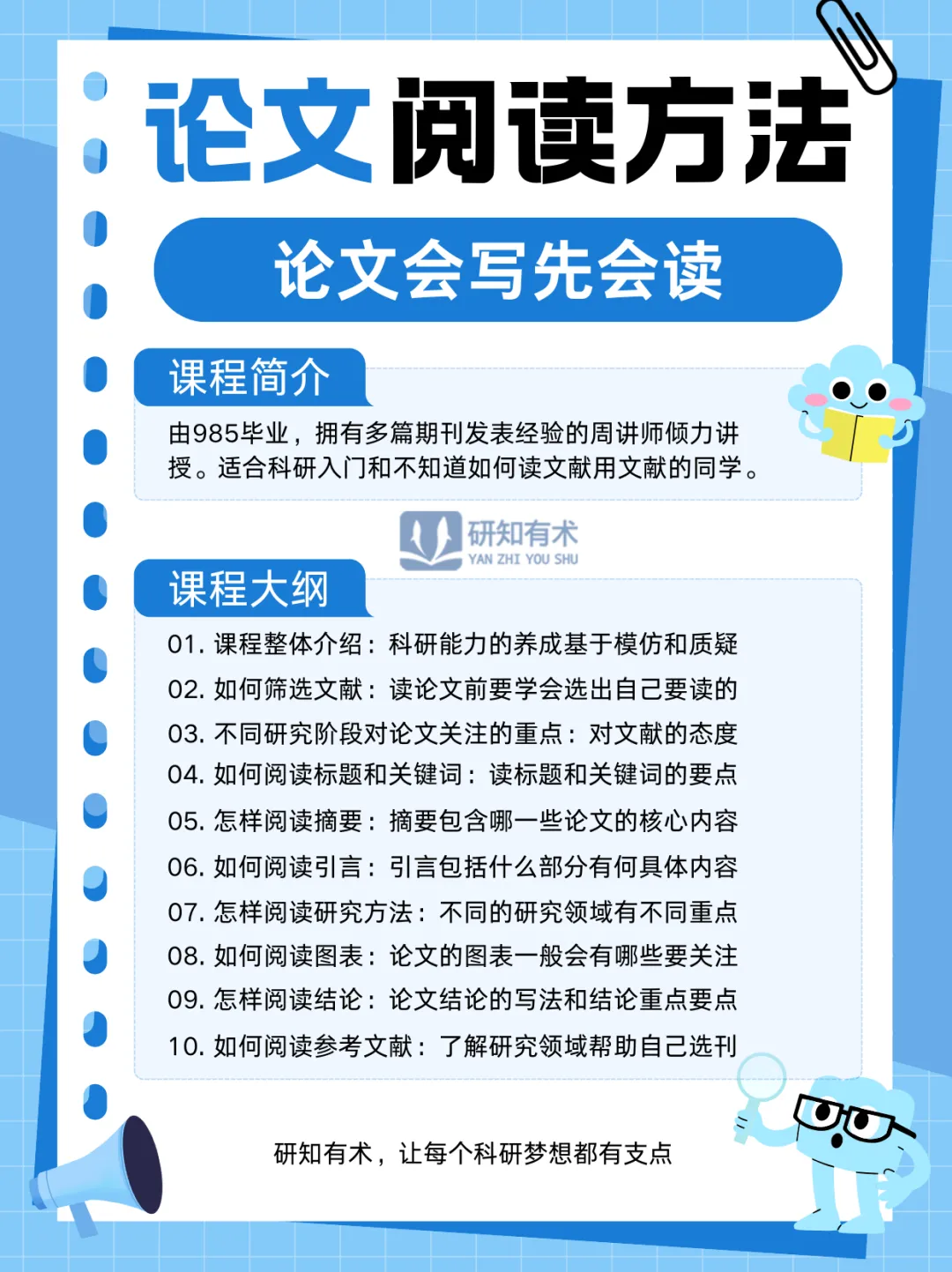

读文献慢,抓不住重点,读后即忘?研知有术特邀学术导师,系统梳理文献阅读全流程,专为科研小白录制了10节文献阅读实战免费课。

课程涵盖文献筛选、高效阅读、笔记整理、批判思考等核心模块,帮你建立系统的文献消化体系。扫码或后台滴滴即可领取~!

夜雨聆风

夜雨聆风