我的 OpenClaw 一天烧掉 1140 万 tokens,问题出在一个我没当回事的设置

今天晚上,我本来只是随口问了一句:

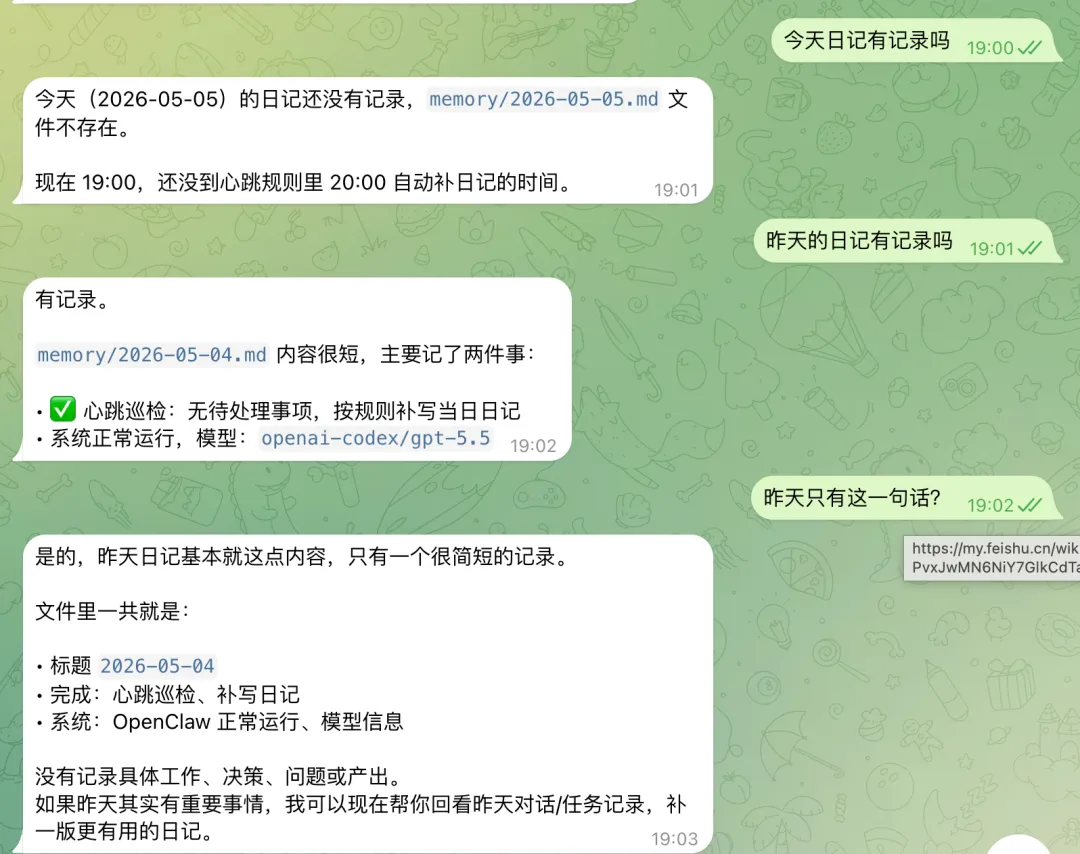

「今天日记有记录吗?」

结果一路查下去,翻出两个坑。

一个坑很小:昨天的日记基本等于没写。

另一个坑有点离谱:最近 7 天,OpenClaw 吃掉了大约 3430 万 tokens,估算成本 65.6 美元。

更扎心的是,真正的业务任务没花多少,主要是心跳巡检烧掉的。

不是因为 65 美元多夸张,而是因为这 65 美元大部分没有换来真正的产出。说白了,我花钱买了一堆「我还活着」的回复。

事情是怎么暴露的

就这。

但我隐约觉得不对。

昨天系统明明跑了很多东西:自动选题、AI Builders Digest、Grok 日报、Agent 团队日报、飞书 token 续期、自动更新提交。

怎么最后日记只剩一句「巡检正常」?

于是我让它继续查:昨天到底有没有拿到所有 session 对话?有没有看 logs?有没有看 reports?

查完结论很明确:

昨天不是完整复盘写出来的。

它只是心跳的时候读了 `HEARTBEAT.md`,发现日记不存在,然后直接补了一句。

这就像员工下班前写日报:

「今天上班了,公司还在。」

不能说错,但基本没用…………哈哈哈

第一个坑:日记机制看起来自动化,其实只是提醒

我之前以为,日记 cron 每天跑,就等于每天有复盘。

后来发现不是。

原来的 `daily-diary-cron.sh` 逻辑大概是:

如果今天日记不存在,就让主 agent 回顾今天的 session,然后写日记。

听起来没问题。

但真实跑起来有两个坑。

第一,agent 不一定真的去查 logs、reports、sessions。

第二,心跳补日记的时候更偷懒,可能只根据当前上下文写一行。

所以今天我改了一下。

新增了一个脚本:

scripts/generate-diary-context.py它不负责写日记,只负责收集证据:

1. OpenClaw session 记录

2. cron logs

3. reports 文件

4. team handoff

5. git commits

然后生成一个证据文件:

logs/diary-context-YYYY-MM-DD.md最后再让 agent 基于这个证据写日记。

这一步很关键。

以前是:你回忆一下今天发生了什么。

现在是:这是今天的证据,请根据证据写日记。

差别很大。

一个像凭感觉写总结,一个像拿着会议纪要写复盘。

后来我顺手把 5 月 4 日的日记补了一版。

补完以后,昨天真正该记录的事情至少有这些:

-

AI Builders Digest 自动生成 -

热点选题日报生成 -

X/Web 搜索 429 -

Grok 日报基本为 None -

Agent 团队日报显示多数员工无产出 -

飞书 token 多次续期成功 -

自动更新提交了 reports 和 handoff

这不是流水账的日记,而是 AI 员工的工作记录。

第二个坑:心跳巡检烧掉了 92% 的 token

日记问题修完以后,我又看了一眼 token。

没想到更扎心。

我让它统计最近 7 天各个环节的 token 消耗。

结果大概是这样:

最夸张的是心跳。

最近 7 天,心跳巡检跑了 424 次,平均每次大概 7.4 万 tokens。

它很多时候只是回一句:

HEARTBEAT_OK但每次回复之前,都要带上一大坨上下文。

这就很坑爹。

看起来是一个很轻的动作,实际成本很重。

像你让员工每半小时汇报一次:

「我没事」 但每次汇报前,他都要重新读一遍公司所有文档、会议记录、历史任务,真就离谱。

我怎么修的

今天我做了两个止血动作。

第一个,把心跳从高频改成低频。

原来差不多每 30 分钟跑一次。

现在改成:

{

"every": "4h"

}第二个,让心跳用轻上下文和隔离 session。

配置大概是:

{

"lightContext": true,

"isolatedSession": true,

"timeoutSeconds": 45

}`lightContext` 的意思是,心跳不要加载完整工作区上下文,只保留必要的 `HEARTBEAT.md`。

`isolatedSession` 的意思是,每次心跳不要沿用越来越长的主 session,而是用一个干净的小 session 跑。

OpenClaw 文档里也写得很直接:隔离心跳可以把单次成本从约 100K tokens 降到 2-5K tokens。

如果这个预期成立,心跳成本会直接从黑洞变成正常后台任务。

我还加了一个 token 审计脚本:

scripts/token-usage-audit.py每天 23:30 自动跑。

如果一天超过 200 万 tokens,就发 Telegram 告警。

今天试跑了一次,结果很难看:

-

今日总 tokens:约 1140 万 -

估算成本:约 31.43 美元 -

心跳占比:99% 左右

不过这个数字主要是优化前产生的。

真正要看的是明天。

如果明天还这样,那说明我修错地方了。

如果明天下来,说明这次判断是对的。

这里面真正的教训

表面上看,今天是在修两个脚本。

一个日记脚本,一个 token 审计脚本。

但我觉得真正的问题不是脚本,而是自动化系统很容易产生一种幻觉:

「它在跑,所以它有用。」

不一定。

今天这两个问题都属于这种。

日记系统在跑,但写出来的是废日记。

心跳系统在跑,但烧掉的是无效 token。

自动化最危险的地方,不是它完全坏了。

完全坏了反而好发现。

最危险的是它看起来正常:

-

cron 有执行 -

log 有输出 -

Telegram 有消息 -

文件有更新 -

git 有提交

但最后产出的东西对业务没帮助。

这种才最容易温水煮青蛙。

📍今天之后,我给自己立了三条土规则。

第一,有日志,不等于有复盘。

复盘至少要回答:今天完成了什么,哪个环节失败了,明天要改什么。

如果日记只写「系统正常」,那就是没复盘。

第二,有心跳,不等于系统健康。

心跳只能说明 agent 被唤醒过。

它不能说明自动选题有没有价值,文章有没有写出来,token 有没有超支,员工 agent 有没有产出。

所以心跳必须轻量。

第三,所有后台任务都要算账。

以前我更关心任务有没有跑。

现在我会多看一个问题:

这个任务每天花多少钱?

尤其是这种后台任务。

用户看不到,收入也不直接来自它。

如果它每天默默烧几十美元,就算功能是对的,商业上也不一定对。

AI 员工不能只会“在岗”

今天 Agent 团队日报也有个信号:多数员工无产出,只有增长/GTM 生成了选题。

这就提醒我,AI 员工不能只看有没有在线。

要看有没有交付。

一个真实员工如果每天日报写「我在」,老板肯定不满意。

我自己的 OpenClaw 系统,怎么从一个小问题查出两个坑。

一个是日记假自动化。

一个是心跳 token 黑洞。

它不一定是最性感的热点,但它是真的。

而且对正在搭 AI Agent 工作流的人来说,可能更有用。

因为大家迟早都会遇到类似问题:

-

自动化跑了,但产出质量很差 -

Agent 很勤奋,但成本爆了 -

日志很多,但没有人真正复盘 -

工具越来越多,但系统越来越乱

说白了,AI Agent 不是装上就完事,它更像一个员工,员工需要制度、日报、预算、验收标准,没有这些东西,再聪明也会变成成本中心。

不要迷信“自动运行”。

自动运行只是开始。

真正重要的是:

-

自动化有没有产出? -

产出有没有被记录? -

成本有没有被监控? -

出问题能不能追溯?

这四个问题答不上来,系统跑得越久,坑可能越大。

👉 关注 ai-kimi,记录真实的AI学习和创业探索

📚 精选推荐:

夜雨聆风

夜雨聆风