当前位置:

夜雨聆风 > 未分类 > AI编程工具的底裤被扒了,里面全是国产模型

当前时间: 2026-03-23 19:20:37

更新时间: 2026-03-23

分类:未分类

评论(0)

AI编程工具的底裤被扒了,里面全是国产模型

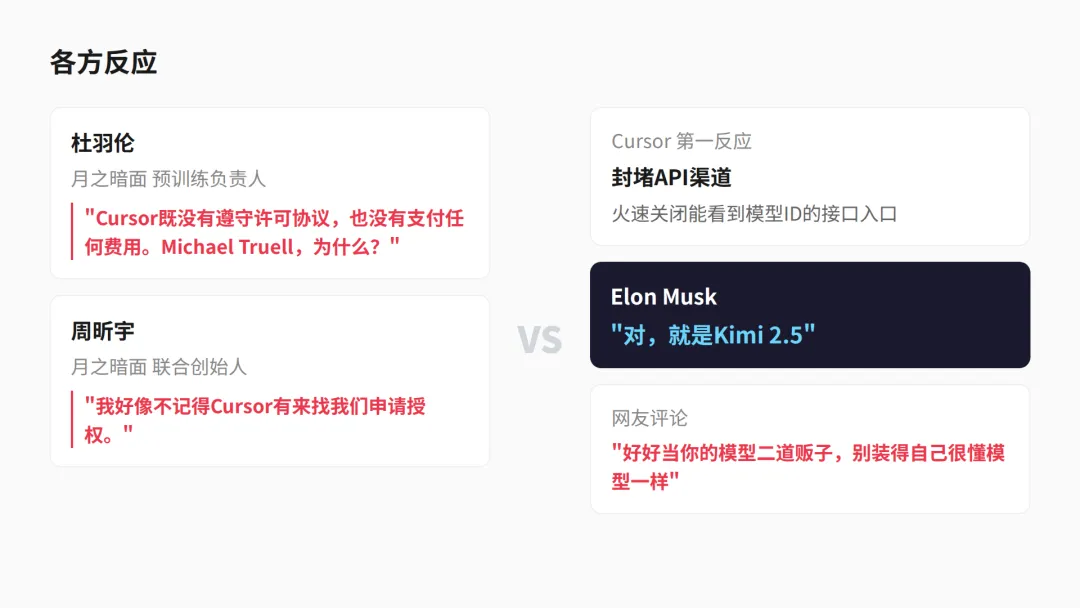

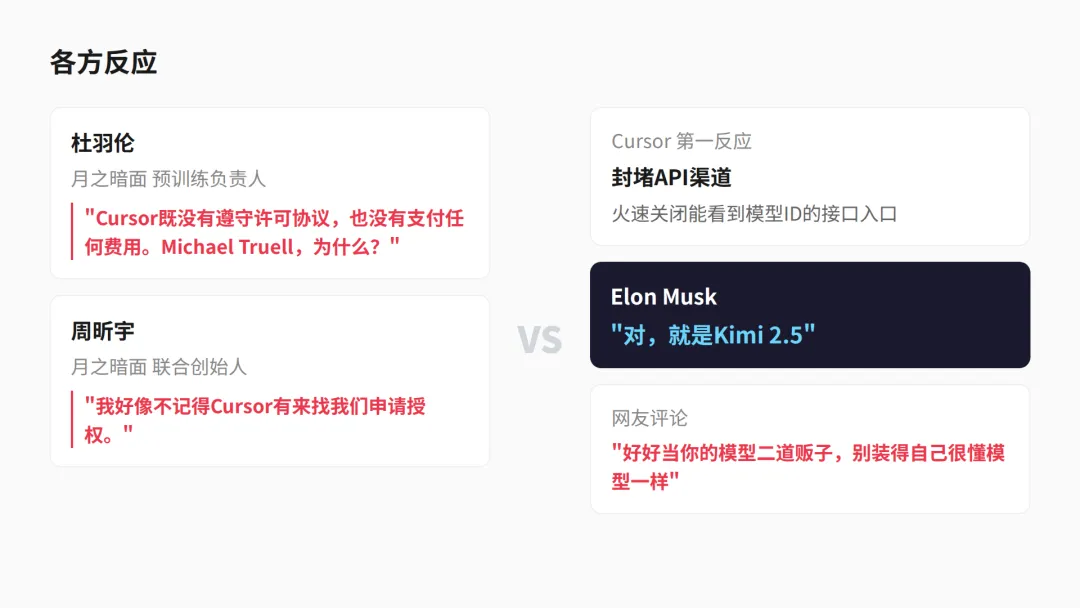

3月19号,Cursor发了个新模型,叫Composer 2。 博客写得挺好看的,什么”首次持续预训练”,什么”大规模强化学习”,配了一堆benchmark图表,结论是:比Claude Opus还强。 然后不到24小时,一个开发者在调API的时候,看到了返回的模型ID。 kimi-k2p5-rl-0317-s515-fast k2p5,Kimi K2.5。rl,强化学习。0317,大概是训练日期。 马斯克都跑来评论了一句:”对,就是Kimi 2.5。” 一个估值500亿美元的AI编程公司,发布”自研”新模型,底下跑的是月之暗面的Kimi。博客里一个字没提。 这事表面上是个套壳翻车,但往下扒一层,瓜比这大得多。 事情的经过,比表面看到的更精彩 消息刚出来的时候,很多人还不太信。Cursor这么大的公司,用了别人的模型怎么也得提前打个招呼吧? 月之暗面的预训练负责人杜羽伦没等太久,自己去跑了一遍测试。结论很硬:Composer 2的tokenizer和Kimi的一模一样。这基本就实锤了,Cursor拿Kimi K2.5做了一道后训练,然后包装成自己的模型发了出去。 杜羽伦直接在X上点名Cursor CEO Michael Truell:”Cursor既没有遵守我们的许可协议,也没有向我们支付任何费用。Michael Truell,为什么?” 月之暗面联创周昕宇也下场了,说得更直白:”我好像不记得Cursor有来找我们申请授权。” Cursor这边发现事情不对,第一反应不是解释,而是火速把那个能看到模型ID的API渠道给封了。 全网最狠的一条评论大概是这个:”如果你是套壳AI应用,就好好当你的模型二道贩子,别装得自己很懂模型一样。” 许可证这笔账,Cursor超了8倍 Kimi K2.5在Hugging Face上用的是修改版MIT许可证。MIT本身很宽松,商用随便,改了也行,但月之暗面加了一条:如果你的产品月活超过1亿,或者月收入超过2000万美元,必须在产品界面上醒目标注”Kimi K2.5″。 Cursor什么情况呢?2026年2月的年化收入已经突破20亿美元。算一下月收入,大概1.67亿,是许可证门槛的8倍多。 但打开Cursor的界面,只有”Composer 2″四个字,Kimi的影子都找不到。 与此同时,Cursor正在跟投资人谈新一轮融资,估值目标500亿美元。去年11月那轮是293亿美元。 也就是说,一个正在冲500亿估值的公司,用了别人的开源模型做底座,在产品里没标注,在博客里没提,然后对外说这是自己”首次持续预训练”的成果。 反转来了,但反转更有意思 3月21号凌晨3点左右,Kimi官方在X上发了条声明。 语气特别优雅:”恭喜Cursor团队发布Composer 2!我们很自豪看到Kimi K2.5为其奠定基础。” 关键信息在最后一句:Cursor是通过Fireworks AI的托管平台,以授权商业合作的方式接入Kimi K2.5的。 翻译一下:Cursor不是偷的,是买的。只不过买了以后没跟大家说。 Cursor这边,开发者体验副总裁Lee Robinson也出来承认:”一开始没在博客中提到Kimi基座,确实是个失误。” 一场看上去要打官司的许可证纠纷,48小时内变成了一次”沟通不当”。 但这个反转本身挺有意思的。月之暗面的人一开始是真不知道Cursor在用他们的模型,还是知道但配合炒了一波?不管哪种,结果对月之暗面都是利好。毕竟,估值500亿的Cursor亲自证明了一件事:Kimi K2.5确实好用。 月之暗面刚好在这个节骨眼上也融了10亿美元,90天内第三轮,估值到了180亿。 这不是第一次了 上一次是Composer 1。那会儿有开发者发现,Composer 1生成的代码里频繁冒出中文注释。写的是英文项目,注释突然来一句中文,怎么看都不对劲。 有投资人直接贴出截图,说这就是Composer 1基于国产开源模型微调的”铁证”。 Cursor的反应是:不回应,不解释,不公开基座模型。后来悄悄出了个Composer 1.5,把事情翻篇了。 现在Composer 2又是同样的操作。用了不说,被扒了才认。 如果说第一次可以算”失误”,第二次就很难不让人觉得这是策略了。在发布公告里大写特写自己做了什么改进,对底下用的是谁家的模型只字不提。这种叙事方式,确实容易让人误以为整个模型都是自研的。 套壳有什么问题吗?其实没有 说到这里,可能很多人默认”套壳”是个贬义词。但仔细想想,套壳这件事本身有什么问题吗? 从零训一个coding模型,成本极高,周期极长,风险极大。对一个做编程工具的公司来说,核心竞争力本来就不在模型层,而在产品体验、工程化和用户生态。 其实整个AI编程工具赛道都在这么干。Claude Code底下跑的是Anthropic的Claude,GitHub Copilot底下是OpenAI的GPT,Windsurf也在调各家模型的API。没有哪个编程工具是从头训自己的大模型的。 这就像手机厂商不会自己炼芯片里的硅一样,分工不同而已。 Cursor选择在Kimi K2.5上面做后训练和强化学习,这个工程决策本身完全合理。问题从来不在”用了”,在”怎么说”。 问题在哪?在”装” Cursor博客的原文是这么写的:”这些性能提升,来自我们首次进行的持续预训练,为后续扩展强化学习提供了坚实基础。” 读完这段话,正常人的理解是什么?Cursor自己训了一个模型。 但实际上呢?底座是Kimi K2.5,Cursor在上面做了后训练和RL。这跟”自己训了一个模型”差别很大。 很多公司在宣传自家AI产品的时候都有这个毛病:强调自己做了什么改进,对底层用的开源模型语焉不详。法律上可能没问题,但在开源社区的价值观里,这是对贡献者的不尊重。 开源生态的运转靠的是一个很简单的默契:我把东西开源给大家用,大家用了说一声。不是为了图名,是因为这个生态要可持续运转下去,信任是基础。 一个年化收入20亿美元的公司,在这件事上省那一句标注,怎么看都不值。 更大的瓜:国产开源模型正在成为底座 跳出Cursor这个事件本身,往更大的图景看,一个有意思的事实正在浮出水面。 硅谷估值最高的AI编程公司,底下跑的是我国的Kimi。 这事放在两三年前,大概没人信。那时候的叙事是国产AI在”追赶”,是大模型能力在”缩小差距”。 月之暗面估值180亿美元,90天融了3轮。Cursor这次事件反而给Kimi做了一波免费背书:一个500亿估值的公司拿它当底座,说明这模型的coding能力确实能打。 而且不只是Kimi。DeepSeek的V3也在被各种地方拿去用。模型层的竞争格局,比大多数人以为的要激烈得多,国产模型的存在感也比大多数人以为的要强得多。 对普通从业者意味什么 第一,不用焦虑”我用的工具底下到底是谁家的模型”。应用层的价值在组装和体验,不在从头造轮子。Cursor就算底座是Kimi,它的产品体验、代码补全的流畅度、Agent模式的工程化做得好,它就值这个价钱。 第二,如果自己在做AI相关的产品或者商业项目,认真看一遍用到的模型的许可证。特别是那些修改版的MIT、修改版的Apache,条款可能比想象中严格。 第三,这个行业的真实运行方式就是分层的。模型层做模型,应用层做应用,中间还有一层Fireworks AI这样的托管推理平台做连接。各赚各的钱,各做各的事。搞清楚自己在哪一层,比什么都重要。 Cursor这个事,表面上是一次套壳翻车,底下是整个AI应用行业的运行逻辑。 用别人的模型不丢人。从iPhone到特斯拉,全球最成功的产品公司都是组装大师。

上一篇速存!长沙四大集团初三联考日历附命题说明