一口气看完这一周的AI模型更新:OpenAI、DeepSeek、Anthropic、阿里、腾讯、小米、Kimi都在卷什么

本周 AI 模型层/代理层更新汇总 (2026-04-20 ~ 04-25)

|

|

|

|

|

|

|

|---|---|---|---|---|---|

| 语言/推理 | GPT-5.5 |

|

|

|

|

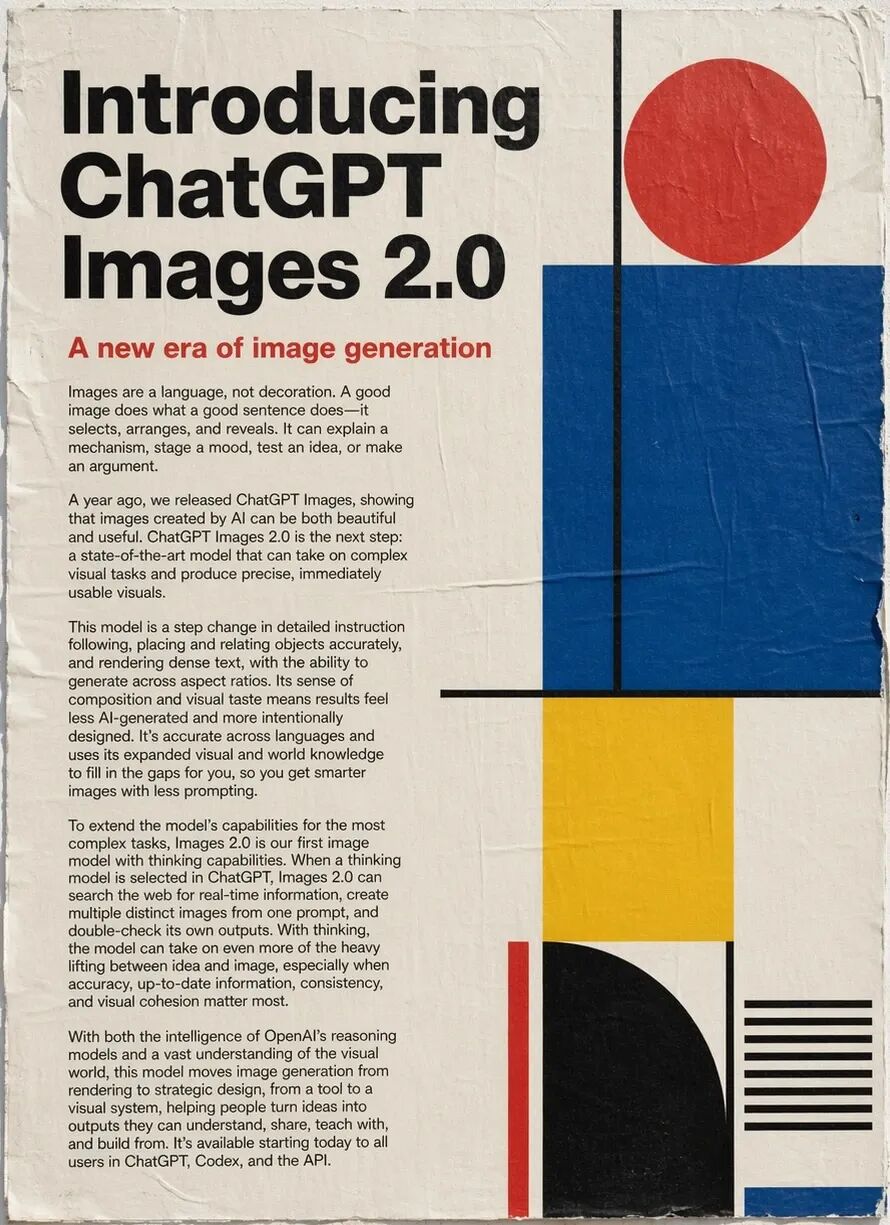

| 图像生成 | ChatGPT Images 2.0 |

|

|

原生多模态生成,文字渲染与风格一致性突破 |

|

| 开源语言 | DeepSeek-V4 |

|

|

|

|

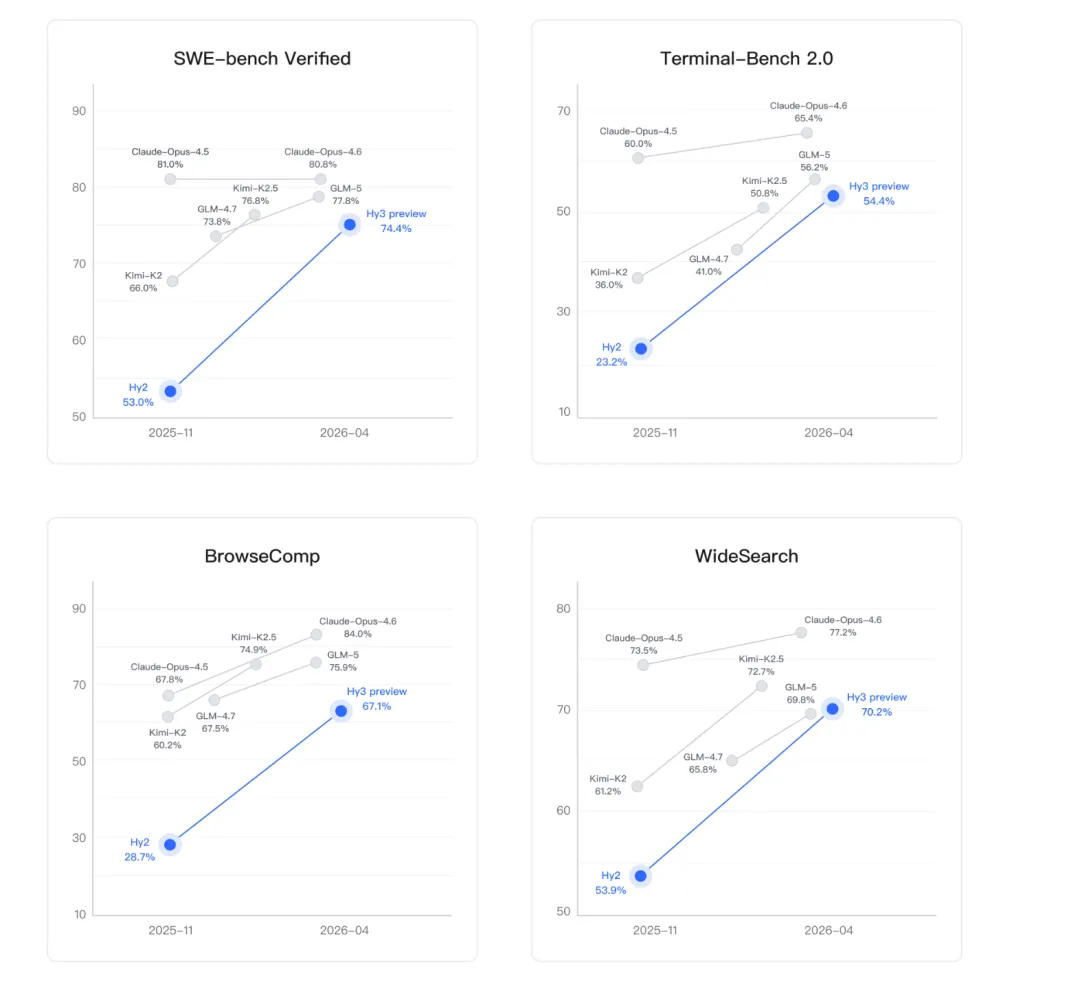

| 开源语言 | Hy3 preview |

|

|

|

|

| 世界模型 | HappyOyster |

|

|

|

|

| 多模态行动 | MiMo-V2.5-Pro |

|

|

|

|

这轮 AI 更新很密集。OpenAI、阿里、腾讯、DeepSeek、小米几乎同时发布了新一代模型或能力升级。如果只看表层信息,会感觉行业仍然在延续过去几年的节奏:参数变大、上下文变长、榜单刷新、能力再提升一截。

但如果把这些发布放在一起看,会发现一个更底层的变化正在发生:大模型行业的竞争逻辑正在从“能力竞赛”,逐渐转向“系统能力 + 成本结构 + 任务交付能力”的综合竞争。

一、语言模型的竞争,正在从“能力更强”转向“系统可用”

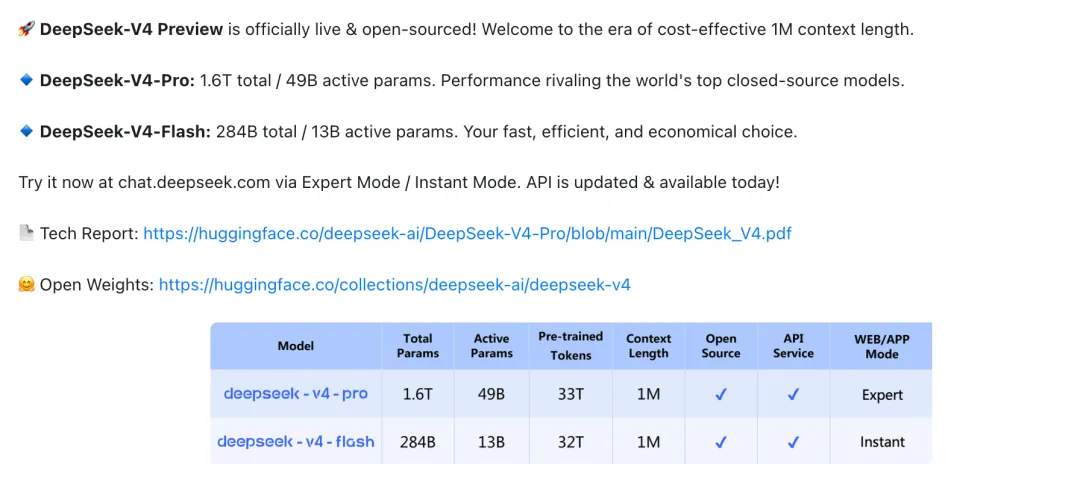

首先,是1M上下文成为默认标准。通过“token 级压缩 + DSA 稀疏注意力”等结构创新,官方所有服务默认支持 100 万上下文,在长文本场景里号称做到高效率、低算力和低显存开销。

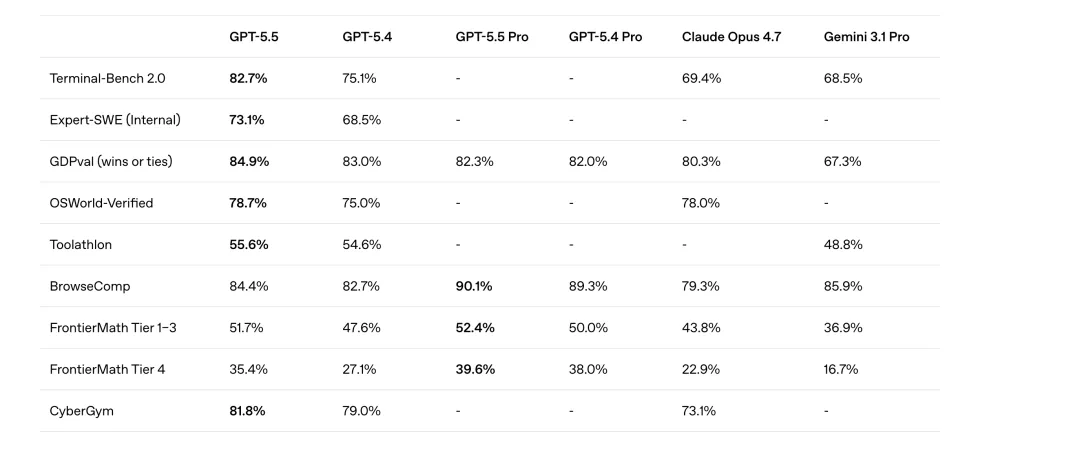

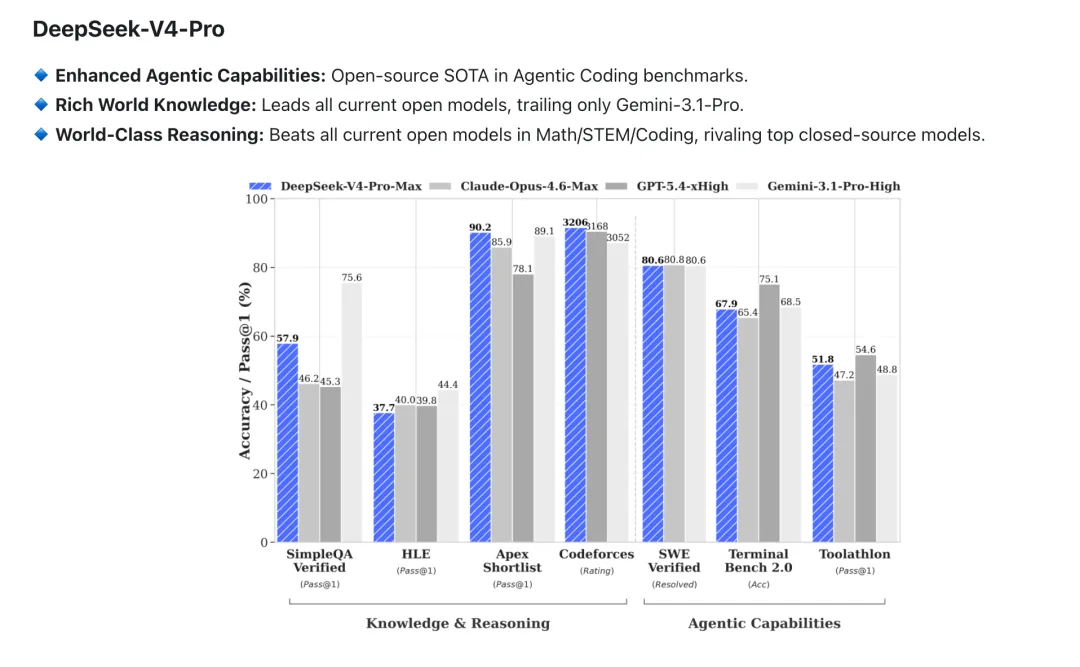

第二,是两款新模型形DeepSeek‑V4‑Pro 和 DeepSeek‑V4‑Flash。Pro 版是 1.6T 总参数 / 49B 激活参数,主打对标顶级闭源模型,在推理、代码、数学、知识等全面追平甚至超越当前开源 SOTA。Flash 版则是 284B 总参数 / 13B 激活参数,在大部分推理和简单 Agent 任务上接近 Pro,但更小、更快、更便宜,适合高并发和成本敏感的应用。

第三,是专门针对 Agent 能力的优化。文档强调在 Agentic Coding 等基准上是开源 SOTA,并且已经与 Claude Code、OpenClaw、OpenCode 等头部 AI Agent 深度集成,用于 DeepSeek 自家的智能编程工作流。

第四,是开放生态与兼容性。V4‑Pro 已开源技术报告与权重,支持通过 OpenAI ChatCompletions 协议和 Anthropic API 方式调用;只需把原有接口里的 model 改成`deepseek-v4-pro`或`deepseek-v4-flash`就能用,还支持 Thinking / 非 Thinking 双模式。

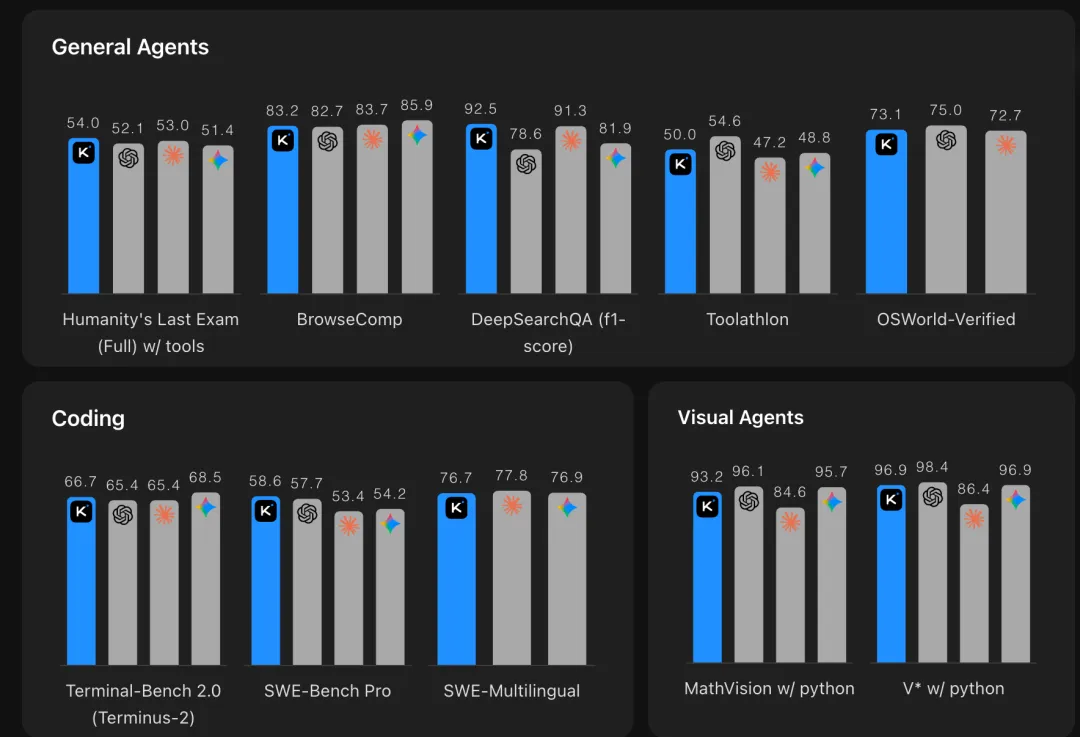

Kimi K2.6则更偏向另一条路径,它没有强化单轮推理能力,而是直接把重点放在“长时间任务执行 + 多智能体协作”上。

首先是在复杂编码与长时任务上的能力扩展。官方强调其支持最长约13小时连续编码,目标是解决过去大模型在软件工程场景中容易中断上下文、逻辑断裂、无法完成完整工程链路的问题,更偏向工程级任务的持续推进能力。

其次是多智能体(multi-agent)架构。K2.6支持最多约300个子Agent并行协作,在约4000个步骤范围内进行任务分解与调度,同时支持持续自动化执行流程,并兼容OpenClaw、Hermes Agent等主流Agent框架,使其更接近一个“任务执行集群”而不是单一模型接口。

整体方向上,它更强调把模型能力拆进多个执行单元中,通过协同方式完成长链路任务,而不是依赖单一模型完成全流程推理。

二、多模态的演进,从“生成内容”转向“生成环境”

三、Coding Agent的变化,本质是开发流程被系统化

Kimi K2.6在这一类场景中也有对应延伸,它的重点不是代码生成质量,而是把模型嵌入长周期工程执行中,通过多Agent并行和持续执行机制,去覆盖完整开发流程中的多个环节。

相比传统Coding Agent更偏“单线程交互 + 局部修正”,K2.6更像是在尝试构建一个“多执行单元协同系统”,让不同Agent分别处理拆解、实现、验证与迭代等步骤,从而支撑更长周期的工程任务运行。

四、从“模型能力竞争”走向“系统与基础设施能力竞争”

四、从“模型能力竞争”走向“系统与基础设施能力竞争”

五、产品层的变化:从工具功能走向流程嵌入

本文参考来源:

1. 官方发布与产品入口链接

GPT-5.5 & ChatGPT Images 2.0 (OpenAI)

-

产品发布公告:https://openai.com/index/introducing-gpt-5-5/ -

原生图片生成功能说明:https://openai.com/index/introducing-chatgpt-images-2-0/ -

GPT-5.5 官方系统安全报告网页版:https://openai.com/index/gpt-5-5-system-card/

DeepSeek-V4 Preview (DeepSeek)

-

API 及版本更新公告:https://api-docs.deepseek.com/news/news260424

Claude Code (Anthropic)

-

开发者文档及更新日志:https://code.claude.com/docs/en/changelog

HappyOyster 世界模型 (阿里 ATH)

-

官方体验与技术介绍首页:https://happyoyster.cn

MiMo-V2.5-Pro (小米)

-

模型能力及官方实测详情页:https://mimo.xiaomi.com/mimo-v2-5-pro -

第三方客观性能评测报告:https://artificialanalysis.ai/models/mimo-v2-5-pro

Hy3 preview (腾讯混元)

-

模型详情与在线体验(Hugging Face):https://huggingface.co/tencent/Hy3-preview

DeepSeek V4 全套技术资料

-

DeepSeek-V4 官方完整技术报告PDF(直链下载):https://huggingface.co/deepseek-ai/DeepSeek-V4-Pro/resolve/main/DeepSeek_V4.pdf?download=true -

DeepSeek-V4 官方技术报告PDF(仓库页):https://huggingface.co/deepseek-ai/DeepSeek-V4-Pro/blob/main/DeepSeek_V4.pdf -

Engram 核心稀疏架构前瞻论文(摘要页):https://arxiv.org/abs/2601.07372 -

Engram 前瞻论文(PDF原文):https://arxiv.org/pdf/2601.07372 -

mHC 流形约束超连接架构论文:https://arxiv.org/abs/2512.24880

GPT-5.5 安全与系统能力文档

-

GPT-5.5 System Card 官方PDF报告:https://deploymentsafety.openai.com/gpt-5-5/gpt-5-5.pdf -

GPT-5 系统卡片PDF存档:https://cdn.openai.com/gpt-5-system-card.pdf -

官方报告 arXiv 存档地址:https://arxiv.org/abs/2601.03267

腾讯混元 Hy3 preview

-

GitHub 官方开源源码库:https://github.com/Tencent-Hunyuan/Hy3-preview -

官方中文技术指南文档:https://github.com/Tencent-Hunyuan/Hy3-preview/blob/main/README_CN.md

小米 MiMo 系列技术报告

-

MiMo-V2-Flash 官方技术报告(摘要页):https://arxiv.org/abs/2601.02780 -

MiMo-V2-Flash 技术报告(PDF原文):https://arxiv.org/pdf/2601.02780 -

MiMo 官方GitHub论文附件:https://github.com/XiaomiMiMo/MiMo-V2-Flash/blob/main/paper.pdf

KIMI -K2.6

-

https://www.kimi.com/blog/kimi-k2-6《Kimi K2.6: Advancing Open-Source Coding》

-

https://huggingface.co/moonshotai/Kimi-K2.6/tree/main

夜雨聆风

夜雨聆风