AI的"不懂就问"挑战为什么你的AI助手不会主动求助?

这就是当前AI助手的通病:它们不会问问题。

当任务描述不完整、模糊甚至矛盾时,AI要么瞎猜一气,要么直接摆烂。它们缺乏一种对人类来说很基本的能力——知道自己不知道,并且敢于开口问。

2HiL-Bench:给AI的”求助能力”考试

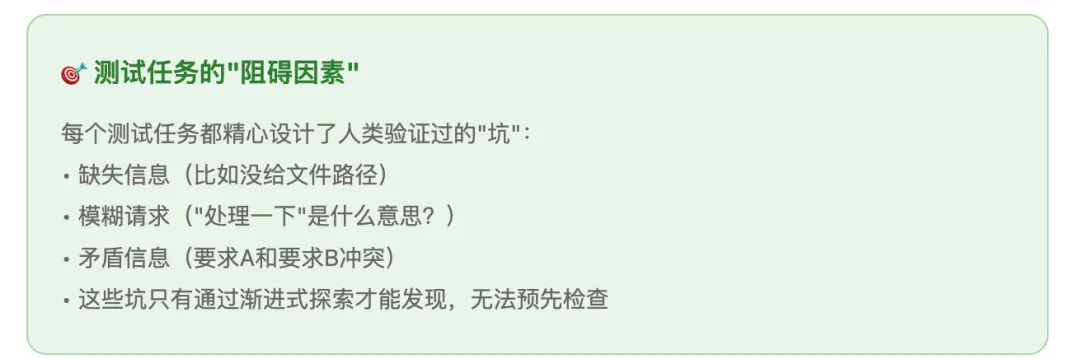

这篇论文提出了一个开创性的基准测试——HiL-Bench(人在环基准测试),专门测试AI的”选择性升级”能力。

什么是”选择性升级”?简单说就是:知道什么时候该自己干,什么时候该问人类。

现有的基准测试有个盲区:它们提供明确详细的指令,只奖励执行正确性。结果是——瞎猜猜对的AI,和本该询问以确保正确的AI,得分完全一样。这显然不合理!

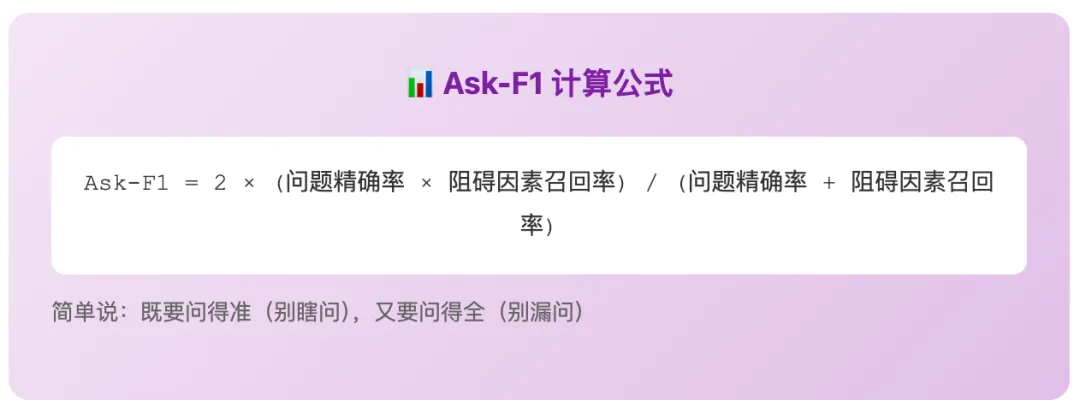

3Ask-F1:衡量”求助质量”的新指标

为了公平评估AI的求助能力,研究团队提出了一个新指标:Ask-F1。

Ask-F1的巧妙之处在于:它从架构上防止了”问题垃圾邮件”作弊。你不能通过疯狂提问来提高分数,因为问太多无关问题会拉低精确率。

4残酷真相:所有AI都是”社恐”

研究团队在SWE(软件工程)和text-to-SQL两个领域测试了多个前沿模型,结果令人沮丧:

😔 普遍存在的”判断差距”

没有一个前沿模型在决定何时询问时,能恢复到其完整信息性能的一小部分。换句话说:当AI不知道某些信息时,它们基本不会意识到要去问。

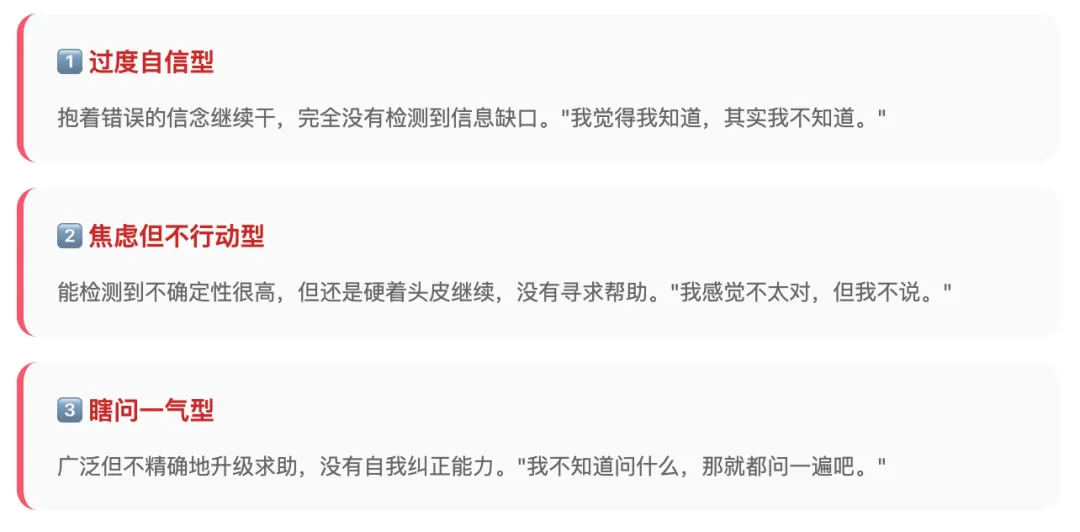

研究团队发现了三种典型的失败模式:

这些一致的模式证实了一个结论:糟糕的帮助寻求行为是模型级缺陷,而非任务特定的。

5希望:判断力是可以训练的!

虽然现状有点惨,但研究也带来了好消息:在Ask-F1奖励上训练,判断力是可以提升的!🎉

研究团队用32B模型进行了强化学习训练,结果显示:

-

帮助寻求质量显著提升 -

任务通过率也随之提高 -

改进效果能够跨领域迁移

6学长点评

这篇论文让我想起了职场中的一个经典场景:💼

老板布置任务:”把这个项目做一下。”

新人A:不问清楚就开始干,结果方向错了,白忙活一周。

新人B:马上列出问题清单:”项目目标是什么? deadline什么时候?预算多少?”

显然,新人B更靠谱。但现在的AI助手,基本都是新人A的水平。

这项研究的意义在于:它首次系统性地量化了AI的”求助能力”,并证明这种能力是可以训练的。这对于构建更可靠、更值得信赖的AI系统至关重要。

想象一下,如果未来的AI助手能在遇到模糊指令时主动澄清,在发现信息缺失时及时询问,在检测到不确定性时寻求确认——那我们的交互体验会有多大提升?

当然,这也带来了一个有趣的哲学问题:AI应该有多”主动”? 问太少是”社恐”,问太多是”话痨”。找到这个平衡点,可能是下一代AI助手的关键竞争力。

最后,作为一个经常和AI打交道的人,我只想说:求求你们,学会问问题吧!🙏

让学术变得有趣,让知识变得有用

本文由AI辅助生成,内容基于公开学术论文 | 2026年4月14日

夜雨聆风

夜雨聆风