当AI撞上玻璃墙:人形机器人如何跨越“世界模型”的物理鸿沟?

Preface序言

在人工智能的时间尺度上,18个月足以跨越一个时代。

当全世界都在为大语言模型的参数狂飙而沸腾时,硅谷的人形机器人赛道,正在发生一场更为硬核、也更少被外界真正理解的底层革命。

近日,一场发生于Figure总部、长达一个半小时的内部深度对谈中,Figure创始人Brett Adcock以前所未有的坦诚,剥开了当前人形机器人行业的华丽外衣。他讲得最透彻的一点,并非“机器人又学会了什么新动作”,而是重新定义了人形机器人的真正分水岭——从来不是杂技般的后空翻表演,而是能否在真实世界中,彻底抛弃传统代码,依靠端到端的神经网络持续、闭环、稳定地完成有用工作。

本文基于该期访谈实录进行提炼,试图还原人形机器人赛道最真实的竞争壁垒,以及我们距离那个“丰裕时代”还有多远。

这不是一家公司的技术迭代,而是整个人工智能产业向“物理世界模型”进军的冲锋号。

原视频来自

Peter H. Diamandis

《The Humanoid Takeover: $50T Market, Figure’s Full Body Autonomy, and Robots in Dorms #229》

告别“死胡同”:全面抛弃传统控制代码,走向全栈神经网络

Peter:距离上次我们在播客里交流大概只有18个月,但按AI的时间尺度看,几乎像过了十年。今天在Figure总部走了一圈,我最大的感受是:你们已经完全不是原来的样子了。

Brett:我们内部也有同样的感觉。18个月前,我们还处于试图弄清楚硬件基础的阶段。而今天,整个业务的底层逻辑已经完全不同。过去这两年,我们越来越确定一件事:人形机器人不能靠手写代码一路走到终局。你可以用C++写出很多控制逻辑,但那条路最终会遇到绝对的边界。

Peter:我还记得你们早期那个很关键的时刻——Figure 1把咖啡胶囊放进了咖啡机。真正重要的地方,似乎不只是它完成了这个动作,而是它证明了双手人形机器人可以用神经网络去完成真实任务?

Brett:对。当时跑在机器人上的是一个双臂神经网络。在此之前,我们写了几十万行的C++代码。你要知道,写一行这样的代码成本可能高达100美元,不仅极其昂贵,而且很难测试、很难保证可靠性,更不可能去建模真人在现实环境中会遇到的所有复杂行为。

那次之后,我们就决定全力押注神经网络。不是局部使用,而是整个系统都往这个方向重构。到今天发布的Helix 2,我们把剩下的10.9万行C++代码也彻底拿掉了。现在,整个身体的动态控制都已经交给了端到端的神经网络。

Peter:所以Helix 2的意义,不只是模型更新,而是机器人第一次真正开始“全身工作”了?

Brett:没错。过去行业比较强的是桌面级操作(抓取、放置)。但让机器人一边移动、一边操作、一边规划、一边纠错,这是完全不同维度的难度。

我们花了很长时间重构架构,目的就是让眼、手、脚、腿、躯干都协同起来。你会看到它在厨房里工作时,甚至会用胯部去关门、用身体姿态去配合动作,这些根本不是工程师事先写死的,而是神经网络自然生成的行为。它开始接近“自己学会怎么做”。

Peter:你们早期和OpenAI深度合作过。现在行业里也有很多人试图直接把大语言模型(LLM)塞进机器人里。既然LLM已经这么强大,它能不能直接作为机器人的大脑?

Brett:LLM当然重要,但它解决的只是问题的一小部分。它擅长的是语义理解和常识,比如它知道“这是一个水瓶,应该从侧面抓取”。

但机器人真正困难的地方,是物理理解。当它伸手去拿水瓶时,肘部怎么摆?骨盆怎么退?手指怎么施力?接触面的物理反馈是怎样的?一个拥有40多个自由度的人形机器人,其状态空间比宇宙中的原子还要多。这些极其复杂的物理规律和动态协调,是纯文本训练的LLM天然不懂的。

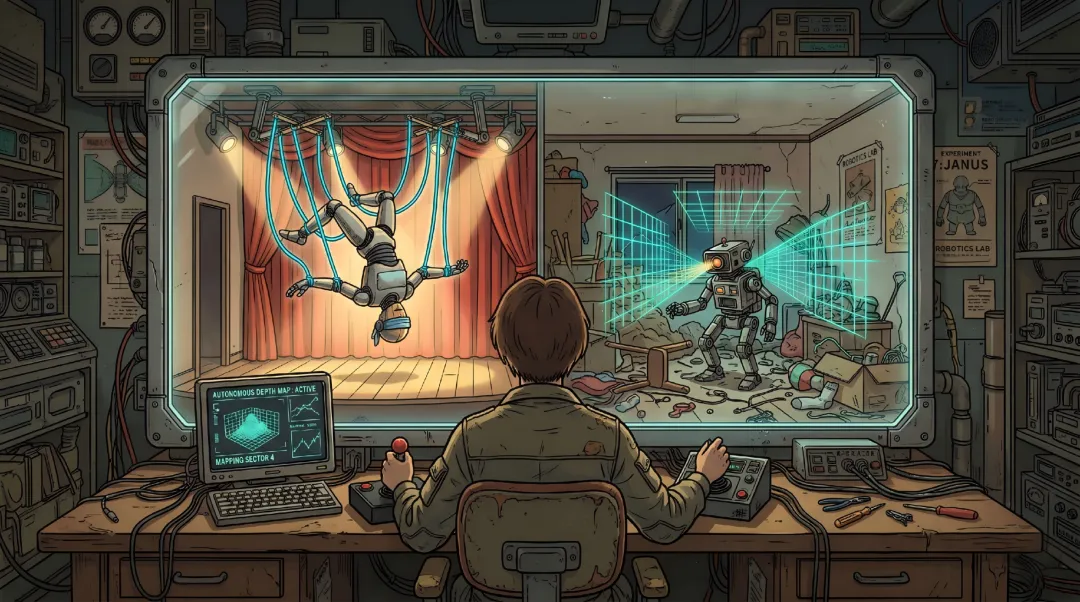

我们曾经做过极限测试,也就是所谓对LLM进行“Zero-shot(零样本)”测试。我们给了一个多模态大模型最基础的X、Y轴导航控制权限,让它寻找出口离开大楼。结果呢?方向是对了,但它直接全速撞上了一堵透明的玻璃墙。

Peter:所以,文本世界里的“知道”,和物理世界里的“会做”,中间还隔着很远。LLM以为自己什么都会,但一进入真实的物理机器,它就原形毕露了。

Brett:完全正确。这也是为什么我们的团队最终决定跑在前面,靠自己的力量去构建底层架构。从观测空间到动作空间的隐性物理映射,必须在物理世界中进行海量的模型训练。我们建立了一套强化学习的“System 0”底层控制器,让机器人真正学会如何在遵守物理定律的前提下控制自己的躯体。世界上以前从没有人能在人形机器人上做到这一点。

Peter:我们目前正处于一个机器人大爆发的时代。现在外界最容易被吸引的,往往是机器人后空翻、跑跳、甚至打功夫这些东西。你如何看待这种竞争格局?最后会像早期的汽车工业一样,从几百家整合到只剩几家巨头吗?

Brett:全球最终只会整合到极少数的几家头部企业。大家普遍大大低估了做通用人形机器人的难度。

很多极其酷炫的演示,本质上是“开环动作回放”,或者干脆是“遥操作(Teleoperation,背后有真人遥控)”。你让一个人通过动捕把动作做出来,再让机器人复现,这绝对不等于机器人真的学会了。

Brett:我在乎的是:你能不能把机器人放进一个没见过的陌生环境(比如一个刚租的Airbnb),让它在那里全自主地连续工作几天。

真正难的,不是做一个漂亮动作,而是“闭环控制”——持续感知、持续推理、持续行动,还能在未知环境里泛化。你当然可以做10万台只能遥操作的机器人,但这毫无意义。现在行业里真正值得看的,不是谁会表演,而是谁能解决“通用机器人”问题。

Peter:也就是说,今天大量看起来很震撼的视频,和真正可部署的机器人之间,其实还隔着一大段距离。

Brett:没错。你当然可以做10万台只能遥操作或只能回放固定动作的机器人,但那并不说明你解决了问题。真正重要的是:哪怕只有10台,它们也能进入陌生场景,完成真实而有价值的工作。

硬件现实:为什么“拼装货架零部件”永远造不出好机器人?

Peter:让我们聊聊硬件。Figure 3的进化令人瞩目。你提到成本降低了90%,重量减轻了约30磅,动作也更加流畅自然。很多创业公司或者其他团队,会选择购买现成的电机、机械手进行组装。你们为什么选择极其耗时的重度垂直整合?

Brett:如果能直接从货架上买到电机和机械手,拧上螺丝就能用,那当然是世界上最美好的事。但现实情况是:这完全行不通。

那些货架上的硬件,其技术成熟度极低,而且根本不是为“跑通神经网络”而设计的。如果你去买一台现成的商用人形机器人,为了让它运行大模型,你不得不在它背后外挂一个巨大的“算力背包”,里面塞满电池、计算板,拖着乱七八糟的线缆,还要自己解决极其棘手的散热问题和底层固件通信。这就好比你在造火箭,结果图省事买了个外包的二级助推器直接拿胶带绑在侧面——在早期实验室里玩玩可以,但如果你想规模化量产,这就等同于自杀。

Peter:所以Figure 3的设计逻辑是彻底反过来的?先有AI,再有硬件?

Brett:完全正确。Figure 3唯一的设计原则就是:如何为Helix神经网络设计一个最完美的物理容器。

我们的手、脚、传感器分布,全都是围绕大模型的数据吞吐需求来定制的。比如,人类在伸手去高处或深处拿东西时其实往往是视线受阻的,为了让AI更好地理解抓取过程,我们在Figure 3的每一个指尖都配备了高分辨率触觉传感器,并在掌心嵌入了摄像头。比如我们在脚部加入了被动柔性脚趾,让机器人在下蹲工作时拥有极佳的运动范围。

我们移除了内部所有杂乱的线缆,让外骨骼直接承担结构载荷。而且,为了保证计算效率且不消耗过度电能,我们的推理计算完全在本地运行,没有依赖H100这种高功耗集群,而是极低延迟的定制边缘算力。充电方面,我们采用脚部无线感应充电,机器人只需要站在薄垫上,无需插拔任何线缆,充电一小时就能高强度工作四五小时。

如果你不能完全掌握硬件底层,当你试图提升3到5倍的运行速度时,你的可靠性系统瞬间就会崩溃,你连错出在哪里都不知道。我们甚至计划在今年夏天前,将几乎所有的供应链完全从外部剥离,实现高度的自主可控。

数据飞轮与路线图:终局不仅是工厂,而是家庭

Peter:你刚才提到一个特别关键的点:在神经网络时代,数据会变成真正的资产。

Brett:这已经是一场纯粹的数据竞赛了。人类的学习是孤立的,但机器人群体的进化是指数级的——一旦某一台机器人学会了某项任务,整个机群理论上瞬间就能共享这项能力。这意味着,谁能更快获取高质量、多样化、持续积累的真实世界数据,谁就建立了最深的护城河。

Peter:如果把视角放到2026年,Figure最关心的三个目标是什么?

Brett:第一,在我们的超级工厂里,让“机器人制造机器人”大规模发生。

第二,大规模部署到工业和商业客户场景中。我们已经有很多客户需求,现在关键是交付和运行。

第三,也是最核心的——继续逼近“通用机器人”。不是一个只能执行固定流程的机器,而是一个你可以对话、可以交代事情、能理解上下文、也能真正去完成任务的系统。

Peter:所以商业场景的意义,不只是订单,而是锤炼系统。

Brett:对。只有进入真实世界,机器人才能真正变成熟。你会在客户现场学到大量关于连续运行、维护、安全、调度、修复的东西。我们真正想做的,不是摆出一个demo,而是把机器人跑起来,而且天天跑。

Peter:但你真正描绘的未来,显然不只是工业应用。

Brett:当然。家庭一定是终局之一。尤其是养老、居家照护、长期陪伴,这些都是真实存在而且会越来越大的需求。

我从小接触养老场景,所以很清楚:很多人真正需要的,不只是一个会干活的工具,而是一个既能帮忙做事、又能理解情境、还能长期陪伴的系统。

Peter:所以你理想中的机器人,不只是执行器,更像一个“在身体里的智能体”。

Brett:是的。它要能对话,能记住你说过的话,能理解你的处境,也能在数字世界和物理世界同时行动。最终它不只是一个机器,而是某种意义上的“合成人类能力体”。

寻找物理世界的大航海图

这场超过万字的深度对话,带来了一种令人窒息的科技压迫感,同时也揭示了当前通用人工智能赛道最隐秘的核心命题。

从十万行C++代码的彻底清退,到整个机器人的神经控制接管;从简单的LLM对话,到必须理解重力、摩擦力、空间几何与材料形变的具身智能。Brett Adcock用最直接的工程现实告诉我们:理解文字的规则,与理解物理法则,是两套截然不同的叙事。

Figure 3惊人的流畅度背后,是其系统正在拼命构建一个能精准映射现实的“物理世界模型(World Models)”。但这同时引出了当前赛道最亟待填补的行业空白,也是下一阶段技术与资本必须锚定的核心战役:下一代空间动态数据获取。

传统的2D互联网视频已经无法喂饱这个庞大的物理怪兽,我们需要更高维的数据,来为机器人标注极其细腻的动作抓取、力矩变化与空间轨迹。

从实验室里的步伐,到工厂流水线上的自我制造,钢铁躯壳的物理进化已经走过了最艰难的从0到1。但在通往那个价值50万亿美元的丰饶经济时代前夜,谁能率先跨越这道“数据获取”的鸿沟,为AI铺设最精准的物理世界大航海图,谁就能在接下来的史诗级具身智能浪潮中,真正扼住产业的咽喉。

我们正站在这个巨变奇点的边缘。而且,它来得比任何人预想的都要快。

周蒙🌙:内容研究整理

周蒙🌙:文字排版

Lanshi Rushi 🦁:选题策划

https://www.youtube.com/watch?v=S_fXhVT67Uw:原文链接

夜雨聆风

夜雨聆风