AI全在涨价限速,我用了三层框架管住token

事情是这样的,我开通了 GitHub Copilot 的 Pro 会员,一直用得好好的。然而某天打开Github Copilot的产品公告——Opus 系列模型从 Pro 套餐里整体移除了,未来也不会有高等级的模型可以使用,他们意思很明确:得加钱!

于是我和广大网友一样开始找替代方案,但调研了一圈,发现的问题远比”换个平替的AI”更大。

- GitHub Copilot

:不仅移除 Opus,还暂停了 Pro/Pro+/学生版新用户注册;内部文件显示 6 月 1 日准备全面切换按 token 计费 - Anthropic

:悄悄把 Claude Code 从 $20/月 Pro 里删掉(后来说是”2% 用户测试”随即撤回),企业版已经改成了按百万 token 实际计费 - 阿里云

:3 月 18 日,四天内连发三条涨价公告,幅度约 34% - 智谱 AI

:2026 年 Q1 把 API 调用价格上调了 83%——调用量不降反升,还增长了 400% - 各类 Coding Plan 常年售罄

:国内外各大模型厂商的 coding plan,如百炼、GLM、方舟等 lite 版本常年处于售罄状态,说明需求远超供应

今年以来,全球 token 消耗量增长了 10 倍,中国日均调用量暴涨了 1000 倍。这个现象的根本原因是:Agent 模式让单次任务的 token 消耗量是聊天机器人模式的 50 到 200 倍。Agent 模式下,模型需要处理更多的上下文、工具调用、子代理交互,导致 token 消耗成倍增加。

GitHub Copilot 内部文件写得直接:今年以来运营成本每周翻倍。Anthropic 增长负责人的原话更坦诚——”使用模式已经变化太多了,现在的套餐根本不是为这种用量设计的。”翻译过来就是:当初定价的时候,没人想到你会这么用。

我本来想找更便宜的 token,但后来我想通了

我原本的出发点和大多数人一样——想找一个更便宜的工具或者订阅方案来代替 Copilot 的 $10/月套餐。但调研到这个程度,我确认了一件事:补贴正在退出,而且不会回头。Token 进入了通货膨胀的时代。 于是我重新思考了一个更重要的问题:Token 管理。

我注意到大多数关于”省 token”的讨论是从账单出发的,但我越用越觉得这个出发点不对。Token 管理的本质不是省钱,是让模型在做事时尽可能少受噪音干扰。

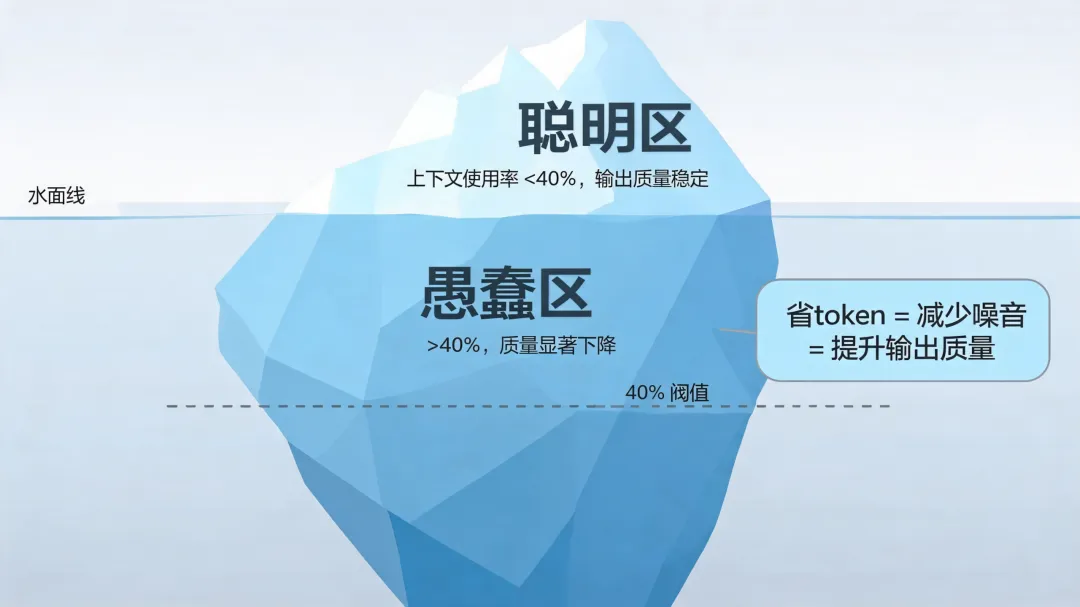

Dex Horthy 在 AI Engineer 大会上提到了一个”愚蠢区”的概念,深得我心:以 Claude Code 约 168K 的上下文窗口为例,当使用率超过 40%,模型的输出质量就开始显著下降。他的解释直击要害——”LLM 是无状态的,每一次工具调用的选择,完全取决于当前上下文窗口中的 token。更好的 token 进,更好的 token 出。”

这个描述重新框定了整件事:省 token = 减少噪音 = 提升输出质量,这三件事是同一件事。我在做实际项目的时候切身感受过这个现象——长时间不清理上下文,模型给出的答案就会开始漂移,它知道的历史信息太多了,反而不知道当前任务的边界在哪里。这不是模型变差了,是噪音把它推进了”愚蠢区”。

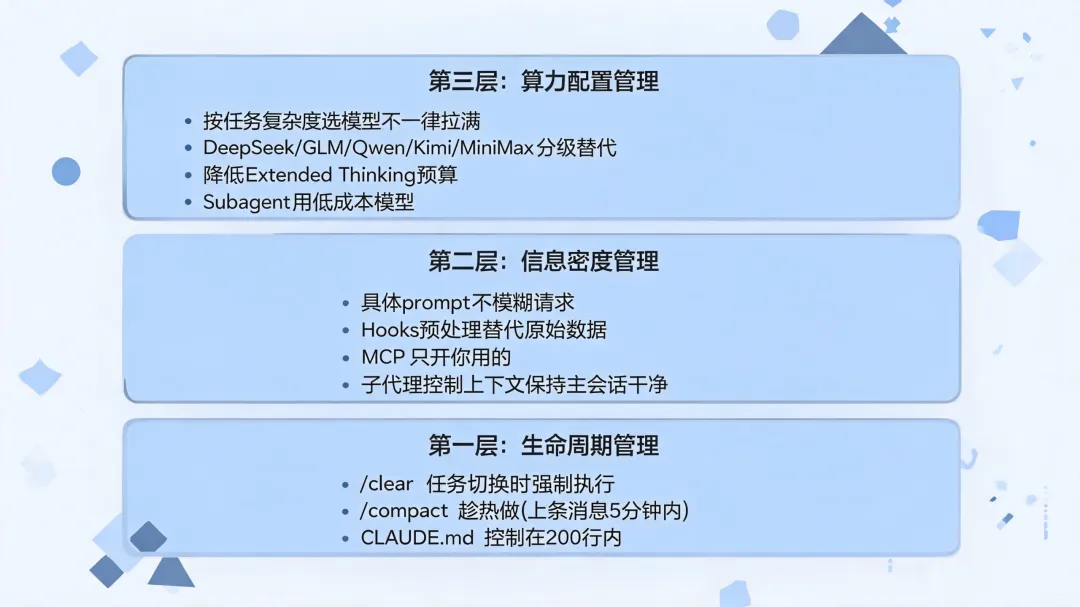

三层框架:系统性地管理上下文

如何高效地管理上下文、节省 token 的使用量,其实 Anthropic 官方文档列了很多具体操作。我去搜集了 A 社的文档,重新在逻辑上整理了一下。按照我的理解从机制出发,token 管理可以分成三层。

第一层:生命周期管理(影响最大,零设置成本)

上下文有生命周期:开始、积累、腐坏。大多数人只关注开始,不关注腐坏。

/clear 在任务切换时强制执行——不清的代价是每条后续消息都要支付之前所有历史 token 的税,换了工作场景却拖着旧上下文,等于把所有旧信息都强加给了模型。/compact 趁热做(上条消息 5 分钟内效果最好),而且可以指定方向:/compact Focus on code changes and test output,告诉模型压缩时保留什么,而不是让它自行判断。

CLAUDE.md 保持精简,复杂指令下沉到 Skill。CLAUDE.md 每次会话都自动加载,里面每一行都是全局税;Skill 是按需加载的,不调用不消耗。官方建议把 CLAUDE.md 控制在 200 行以内。

第二层:信息密度管理(控制进入上下文的信息质量)

上下文里的 token 不是越多越好,是越精准越好。

写具体 prompt,不写模糊请求。直接说”优化下我的代码”会触发大范围全局扫描,但是你说清楚具体的需求,比如”在 auth.ts 文件中为 login 函数添加输入验证”,那么只需要读一个文件,消耗差距可能是十倍。这不只是省钱——具体 prompt 让模型可以直接作业,模糊 prompt 让模型在”猜你在要什么”上消耗算力。

用 Hooks 做预处理,而不是让模型处理原始数据。Claude Code 支持配置 PreToolUse hook:读日志前先 grep ERROR,只把相关行传给模型,而不是把 10000 行原始日志塞进上下文。能用工具做的确定性工作,不要用大模型来做。MCP 工具同理——只开你用的,加载了不用的工具等于把算力预算花在了菜单上,而不是食物上。

Dex Horthy 把这层逻辑总结得更直接:子代理不是用来模拟角色的,是用来控制上下文的。派子代理去读代码、探索仓库、理解流程,然后只把精简结论返回给主会话——主会话始终保持干净,始终在”聪明区”工作。

第三层:算力配置管理(根据任务选择消耗档位)

这一层是在合适的地方花对应的钱,而不是一律最高档。

Anthropic 官方文档里提到 Sonnet、Haiku、Opus 的分级策略——日常任务用 Sonnet、复杂架构上 Opus、简单子任务配 Haiku。这个分级的底层逻辑完全可以迁移到国内模型上:DeepSeek、GLM、Qwen、Kimi、MiniMax 等等,各有各的能力档位和成本曲线。关键是根据任务复杂度选模型,而不是一律拉满。我的亲身经验是:模型档位不是决定输出质量的唯一变量,一个上下文干净的中等模型,产出质量往往比一个上下文混乱的顶配模型更强。

降低 Extended Thinking 预算同样重要。Thinking token 按输出 token 计费,默认预算动辄数万 token 每次,简单任务可以把 MAX_THINKING_TOKENS 设为 8000,或用 /effort 降档——对于确定性强的任务,过度的 thinking 反而是浪费。Subagent 用低成本模型,主会话保留高配模型。多 Agent 场景下,token 消耗与活跃 Agent 数量线性相关,每个 Agent 都有自己的上下文窗口。

三层之后:有件事你不能外包

Dex Horthy 的演讲里有一句话我觉得是整套框架的核心:”AI 不能替代思考,只能放大你已有的思考——或你没做的思考。”

他们用的是 Research → Plan → Implement(RPI)流程:先派子代理做 Research,找到正确的文件和代码位置;产出完整的 Plan,包含文件名、行号、测试策略;再 Implement。但他强调了一件事:Research 和 Plan 这两份文件,你必须亲自读。 你不能把这个判断也外包给 AI。

这和”写具体 prompt”是同一件事的两面:你对任务理解越清楚,给出的指令越精准,模型消耗越少,产出质量越高。我在之前做项目时也有过类似的总结:Token 消耗量是伪生产力指标——大量消耗 token 但产出废代码,不是在用 AI 工作,是在让 AI 在上下文里来回打转。真正有效的 AI 使用是消耗越少,产出越精准。

最后:开源本地部署行不行?

理论上,本地部署开源模型可以绕开 token 通胀——你自己的算力,没有计费压力。这条路真实存在,但门槛限制了它的适用范围:首先你需要一个不错的硬件环境才能跑起来还不错的模型,比如 5090 32GB 显存的显卡或者是 Mac Studio Max/Ultra 大内存版本,其次需要自行部署、维护、调参,不是普通开发者在做正式项目时的主路径。对大多数人来说,更实际的路是:在付费工具里,用更少的 token,做更好的事。

这不是省钱技巧,是认知框架。

参考来源:

GitHub Copilot 官方公告、Where’s Your Ed At 内部文件披露、Anthropic Claude Code 移除事件、Token大跃进、Claude Code 官方成本控制文档、Dex Horthy “No-Vibes-Allowed” 演讲

夜雨聆风

夜雨聆风