AI军事化加速——美国国防部拉7家AI公司入伙,战争形态正在改写

2026年5月1日,美国国防部宣布与7家领先人工智能公司签署协议,将前沿AI技术部署至国防部机密网络,用于”合法的作战行动”。这份名单包括SpaceX、OpenAI、谷歌、英伟达、微软、亚马逊AWS以及初创企业Reflection。

这不是一次普通的商业采购。当全球AI产业还在讨论如何服务消费者和企业用户时,美国五角大楼已经将这些最尖端的大模型接入美军最高密级的作战网络。从这一刻起,AI军事化不再是”未来趋势”,而是”正在进行时”。

一、协议背后:130万人在用,谁进谁出

根据五角大楼官方数据,其GenAI.mil平台已有超过130万国防部人员使用,5个月内产生了数千万次提示输入,部署了数十万个智能代理。 这次与7家公司的签约,是这一进程的质的飞跃——AI能力将直接嵌入机密网络的核心层级(IL6和IL7)。

7家公司的分工呈现明显的分层架构:

- 基础设施层

:亚马逊AWS和微软提供云端算力支撑 - 模型层

:OpenAI、Reflection提供大语言模型能力 - 硬件层

:英伟达提供GPU算力保障 - 应用层

:谷歌横跨模型与基础设施,SpaceX则在通信与航天领域提供独特支撑

值得注意的是,这份名单的”缺席者”比名单本身更值得深思。

Anthropic曾是五角大楼机密网络中唯一可用的大模型提供商,其Claude模型通过了国防安全认证。但今年3月,五角大楼要求”无限制使用”Anthropic的技术——包括允许用于国内大规模监控和全自主武器系统。Anthropic拒绝了这一要求,坚持为其AI设置安全护栏。

结果是:Anthropic被列入”供应链风险”黑名单,这一标签以往仅用于关联外国敌对势力的企业。Anthropic随即起诉特朗普政府,加州一名联邦法官裁定该禁令违宪并暂时叫停,五角大楼已提起上诉。

国防部首席技术官埃米尔·迈克尔的表态意味深长:”只靠单一合作方本身就很不稳妥,发现对方不愿配合后,马上多方筛选敲定了备选方案。”

这番话道出了此次合作的本质:不是在选择”最好的AI”,而是在选择”最听话的AI”。

二、AI军事化现状:从辅助决策到自主作战

当人们还在讨论AI是否会改变战争时,战场已经给出了答案。

当前的AI军事应用,早已超越简单的数据整理层面。美国国防部的”智能体工作流”(Agentic AI Workflows)项目,要求AI系统能够读取机密数据、自主推理并提供决策建议。与传统生成式AI不同,代理式AI不仅可以生成计划,还可以采取行动。

具体应用场景正在全面铺开:

- 情报分析

:谷歌依托云计算优势,开发多源情报分析平台,整合卫星图像与通信数据,生成敌方行动预测模型 - 目标定位

:AI系统被用于协助处理敏感的目标定位信息 - 网络作战

:OpenAI构建主动网络防御体系,xAI通过Groklang语言模型支持网络安全任务 - 后勤自动化

:AI被嵌入军事后勤与供应链管理 - 医疗与行政

:优化军人医疗福利申请、采购数据管理等

美军在2024年10月之前两年内,已签署约6.7亿美元合同,涉及近323家公司的多种AI项目。 2025年7月,美国国防部首席数字与人工智能办公室(CDAO)向OpenAI、Anthropic、谷歌、xAI各授予最高2亿美元的合同,专门开发智能体工作流。

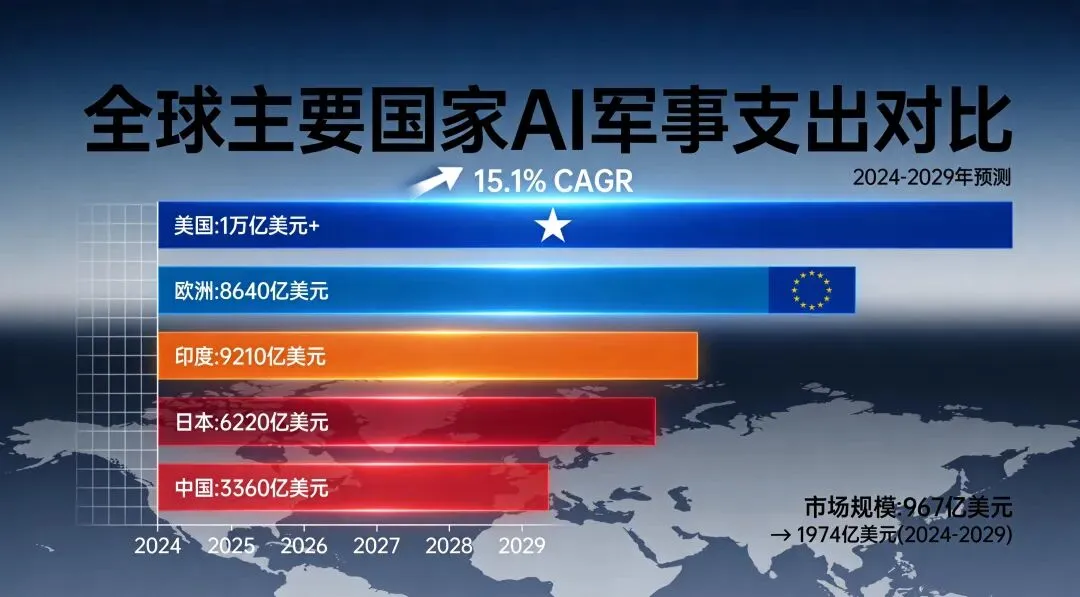

全球AI军事市场正加速扩张:据市场研究机构预测,该市场将从2024年的96.7亿美元增长至2029年的197.4亿美元,复合年增长率达15.1%。

三、全球格局:AI军备竞赛加速,伦理边界模糊

AI军事化的潘多拉魔盒,已经被美国人率先打开。

2025年全球军费开支攀升至2.887万亿美元,创下历史新高,同比增长2.9%。这是SIPRI统计以来连续第11年增长。全球军费占GDP比重升至2.5%,创2009年以来最高值。

这一轮增长背后,是各国对AI军事能力的竞逐:

- 美国

:2026财年军费预算已超1万亿美元,AI专项研发投入达18亿美元,重点布局自主系统与决策支持 - 欧洲

:2025年军费大涨14%至8640亿美元,德国增长24%,西班牙增长50%创1953年以来新高 - 中国

:军费增长7.4%至3360亿美元,实现31年连续增长 - 日本

:防卫费增长9.7%至622亿美元,占GDP 1.4%创1958年以来最高 - 印度

:军费增长8.9%至921亿美元

“算法战”正在成为新的战争形态。

传统战争比拼的是火力、机动力和人数,新一代战争的核心竞争力将是数据、算力和算法。谁能更快地从海量信息中提取情报,谁能更准地预测敌方行动,谁能更迅速地做出决策,谁就将在战场上占据优势。

但AI军事化引发的伦理争议,远比技术进展更为复杂。

乔治敦大学安全与新兴技术中心临时执行主任海伦·托纳警告:AI系统进行信息汇总、监控画面识别、潜在目标识别时,人类该参与多少、风险怎么控制、培训标准是什么,”这些讨论都还在进行中”。

Anthropic的出局恰恰揭示了核心矛盾: 当AI公司试图在”帮助军事”与”防止滥用”之间划定边界时,五角大楼选择了”只选听话的”。这意味着全球AI军事化进程中,伦理约束机制正在让位于战略需求。

四、对中国的启示:自主AI生态的战略意义

美国国防部的这次动作,对中国而言既是挑战,也是警示。

挑战在于: 当全球最顶尖的AI公司集体站队美国军方,AI军事能力的代差可能在未来战场上被进一步放大。美国国防部”增强作战人员在各作战领域保持决策优势”的声明,直白地表明了AI军备竞赛的国家战略意图。

警示在于: AI军事化的底线思维必须加强。

中国需要构建自主可控的AI生态,这已不仅是产业问题,更是国家安全问题。 依赖外部AI技术意味着将战略决策能力的一部分让渡给他人。无论是芯片、模型还是应用层,拥有自主能力才能在关键时刻不受制于人。

在具体路径上,有几个关键方向:

- 算力自主

:突破高端AI芯片瓶颈,确保训练能力不被”卡脖子” - 模型自主

:发展具有国际竞争力的基础大模型,避免对单一技术路线的依赖 - 应用自主

:在军事AI领域建立自己的技术标准和安全框架 - 治理自主

:形成与国情相适应的AI军事伦理规范,而非被动接受他国规则

值得强调的是,AI军事化并非简单的”越快越好”。 Anthropic坚持设置安全护栏的立场,虽然在短期内付出了商业代价,却代表了一种更为审慎的技术伦理。完全放弃约束的AI军事化,可能带来难以预料的风险——包括技术失控、冲突升级和战争门槛降低。

五、潘多拉魔盒已开,我们如何面对

美国国防部与7家AI公司的签约,是AI军事化进程中的一个标志性节点。

它意味着:全球最强大的AI技术能力,正在系统性地向军事领域集中;AI战争从概念讨论进入实际部署阶段;围绕AI军事化的国际规则制定,将成为大国博弈的新焦点。

但我们不必陷入恐慌,也不应盲目跟进。

首先,AI军事化是客观趋势,抗拒不如适应。 试图在军事领域拒绝AI应用,在大国竞争背景下并不现实。问题不在于”要不要用”,而在于”怎么用”。

其次,速度不是唯一的衡量标准。 130万美军人员使用AI平台,产生了数千万次交互——但这些交互的质量、风险和边界在哪里,目前仍缺乏足够透明的信息。快速部署不等于安全部署。

第三,国际合作与规则建设仍是可能且必要的。 AI军事化带来的风险是全球性的。气候变化、网络安全已经证明,在战略性新兴领域,国际规则虽然艰难但并非不可能。

最后,对于每一个关注这一议题的人而言,保持清醒的认知本身就是一种力量。

AI军事化的潘多拉魔盒已经打开。我们能做的,不是幻想将其重新合上,而是确保在这场新的军备竞赛中,不至于因为无知而缺席,因为盲目而失焦,因为恐惧而失语。

战争形态正在被改写。而我们,至少要理解这场变革的逻辑。

📊 数据速览

|

|

|

|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

本文数据来源:新华社、澎湃新闻、SIPRI、The Business Research Company、Defensescoop等

夜雨聆风

夜雨聆风