用 AI 编程工具打造长程任务工作流:不再手动发“继续”

前几轮推进很顺,第十轮开始跑偏; 任务一长,就要反复手动提醒“继续”“按这个流程走”“先别改代码”。

当工具从单会话进化到多会话并发后,新的问题又出现了:

-

你要频繁巡检多个会话状态 -

某些会话会中断或失焦 -

你还得不停补一句“继续”

本质上不是会话数不够,而是闭环能力没有跟上。长程任务真正需要的是清晰分工:

-

人负责目标、约束和关键决策 -

AI 负责研究、执行、重试、记录和阶段闭环

这样并发才会转化为产出,而不是转化为新的管理负担。

本文用一个真实类型场景说明:如何把一次跨仓库功能迁移,做成可稳定推进的长程工作流。

背景:长程能力需要流程化支撑

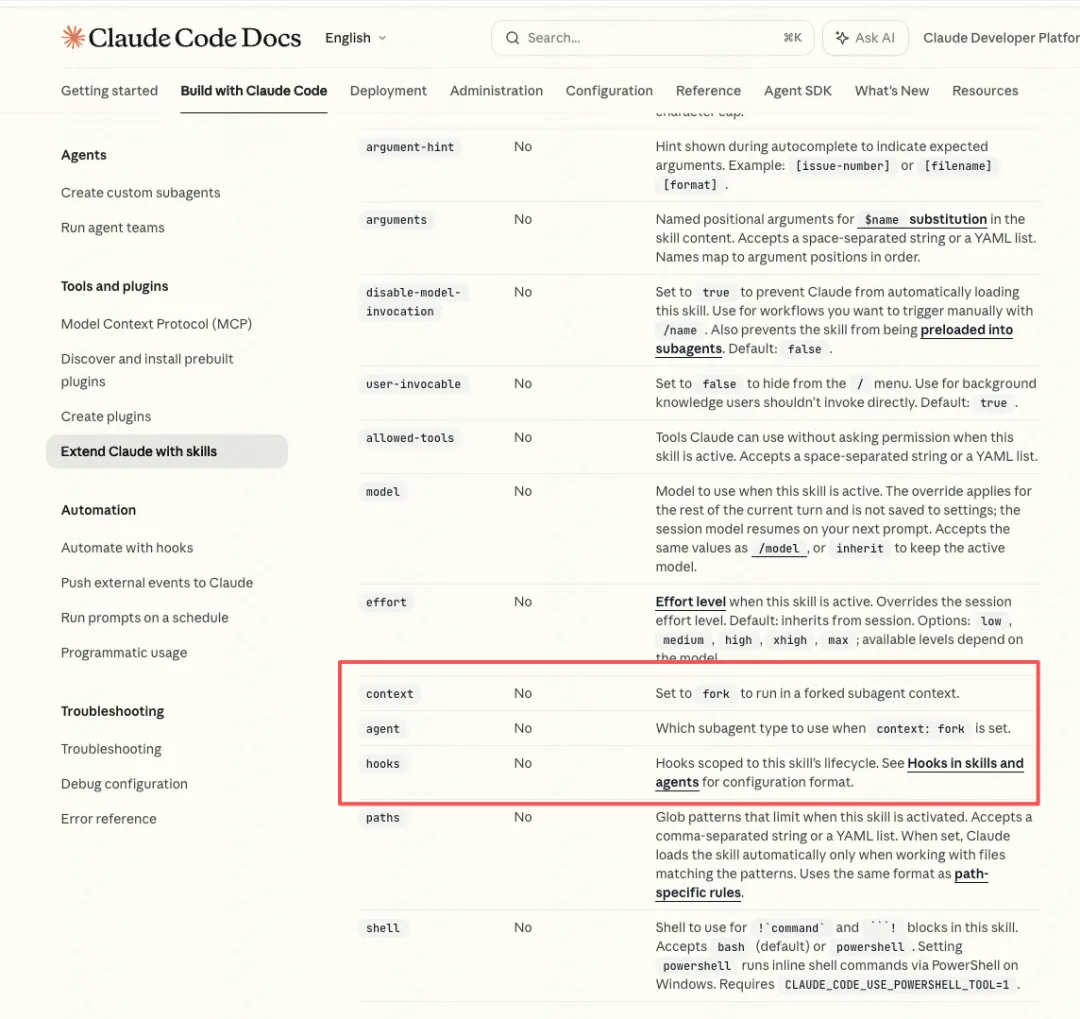

很多 AI 编程工具已经逐步提供更完整的能力模型(如 hooks、agent、context 等)。在实际落地中,可以通过以下组合获得稳定的长程编排能力:

-

在 Skill 中加入会话初始化(session bootstrap) -

在流程里引入 Subagent 协作 -

用 Hook 提示把关键步骤“钉死”

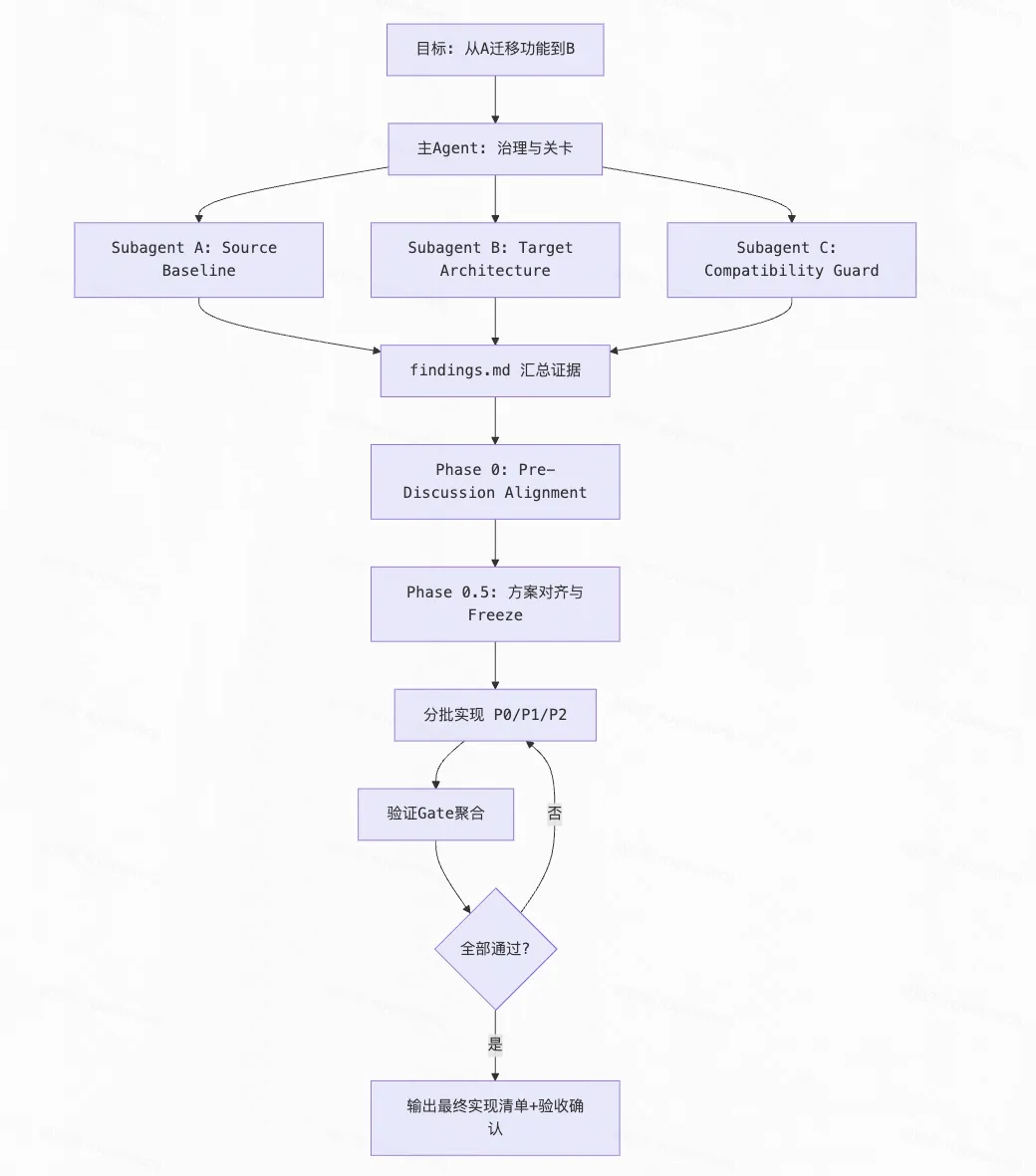

典型难题:把项目 A 的功能迁移到项目 B

这个任务看似简单,实际至少有三条认知链路:

-

看懂 A:原功能实现、边界和隐含约束 -

看懂 B:目标架构接入点、生命周期、协议限制 -

设计 A→B:哪些必须一致、哪些允许适配、风险怎么兜底

如果把这三部分全部塞给主 Agent,上下文会很快被历史调研淹没,实施阶段容易失焦。

更稳的做法是:研究任务分发给 Subagent,治理权留在主 Agent。

返工的根因:对齐不够“硬”

很多流程里,“先对齐再做”只是一句建议。在长程任务里,这几乎一定失效:系统天然会偏向“先产出、后修正”。

有效做法是把对齐做成硬门禁。

Phase 0.5 必须产出的三段文档

-

Cross-Repo Delta Summary

-

Confirmed Parity(必须保持) -

Allowed Adaptation(允许改动) -

Open Questions(阻塞 / 非阻塞) -

User Alignment Confirmation

-

approved / rejected / unresolved -

每条 unresolved 必须带 owner + next action -

Alignment Decision Freeze

并设置硬规则:

-

没有 User Alignment Confirmation → 不允许 Freeze -

没有 Freeze → 不允许进入 Feature Inventory

这一步能显著降低“研究完直接开工”导致的返工概率。

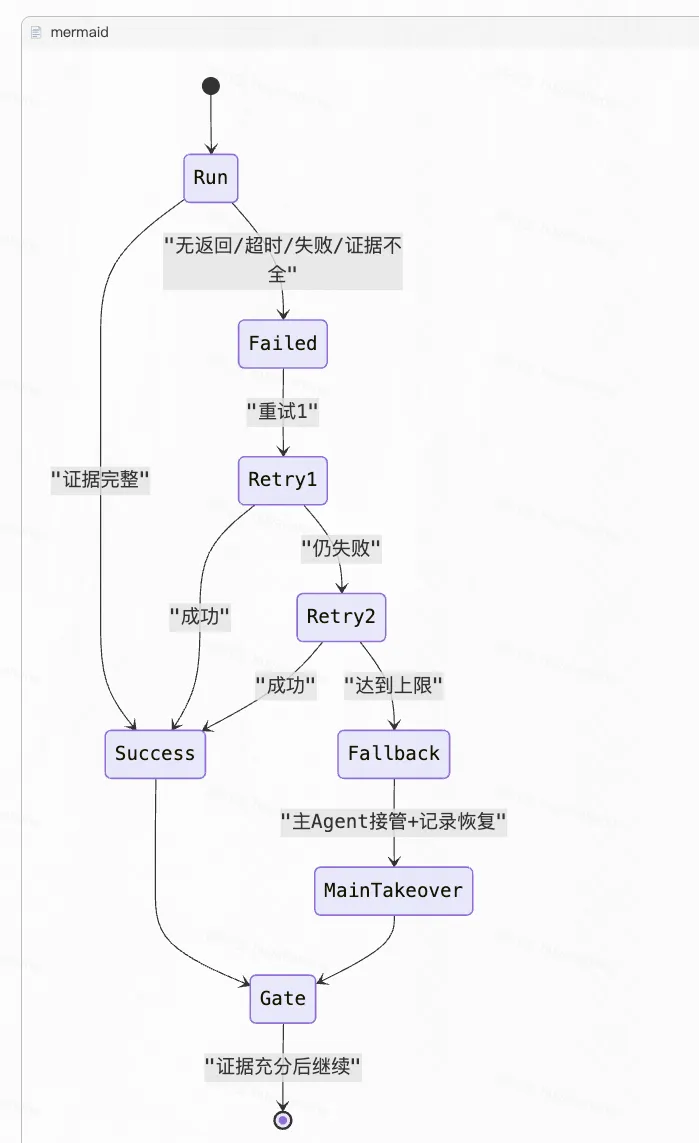

Subagent 会失败,流程必须内建恢复力

真实环境里,Subagent 失败是常态:

-

no response -

timeout -

tool failure -

incomplete evidence

如果把这些当作“偶发异常”,主流程就会卡住。更稳妥的方式是把失败恢复写进标准流程:

-

统一定义上述四类失败 -

每个任务最多重试 2 次(总计 3 次) -

每次重试都缩小任务范围,并强制结构化输出: -

status -

evidence -

blockers -

next_step -

达到上限后由主 Agent 接管并记录 Subagent Failure Recovery -

证据不完整时,Gate 不可通过(只能补证据或标记 blocked)

Hooks 的价值:把经验变成强制提醒

很多团队有经验,但经验常停留在个人脑内,时间一长就丢失。Hooks 的价值是把经验固化成可重复触发的系统提醒:

-

UserPromptSubmit:每轮提示当前计划和最近进展,防止任务断片 -

PreToolUse:操作前检查“是否已完成 Freeze”,防止越级实现 -

PostToolUse:改完即提醒更新进度与 gate 状态,防止漏记 -

Stop:结束前做完整性检查,防止“看起来结束,实际上还有 pending”

Hooks 不是“小技巧”,而是流程纪律的自动执行器。

这套工作流适合哪些任务

如果你有以下任一场景,这套方法可直接复用:

-

跨仓库功能迁移 -

长链路重构或多阶段改造 -

需要“研究 → 方案 → 实施 → 验证”闭环的任务 -

希望减少人工盯流程与重复提醒

一句话总结:把“让 AI 听话”升级为“让流程可验证”。

实践清单(可直接照搬)

-

先拆角色:主 Agent 负责治理,Subagent 负责取证与执行 -

把对齐做成 Gate,不做成建议 -

为每个 Subagent 任务定义失败判定、重试次数、降级接管 -

用 Hooks 固化提醒,减少人为跟踪 -

每阶段写入 findings.md/progress.md,保证可回放、可审计

参考资料

-

Claude Code Skills 文档:https://code.claude.com/docs/en/skills

结语

过去很多团队靠“手动提醒 AI 继续”推进长任务。现在可以反过来:用一套可验证流程,让系统自动提醒自己继续。

这就是长程工作流的核心价值:把注意力从“催进度”释放到“做决策”。

夜雨聆风

夜雨聆风