Openclaw中文版(openclaw-cn)本地部署手把手教程

一、安装环境

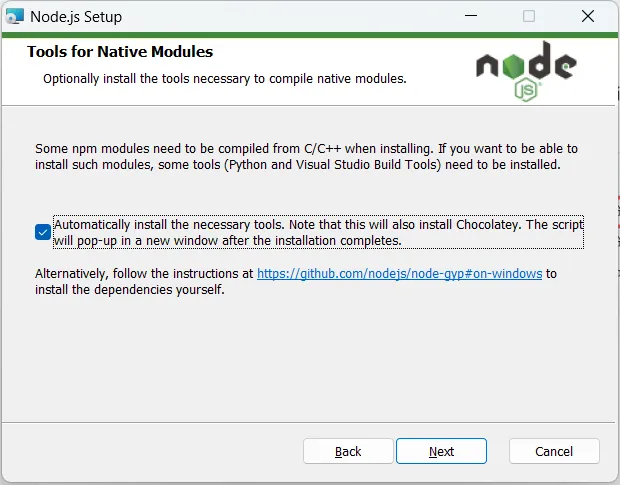

(一)安装Node.js

1、下载Node.js

打开浏览器,访问 Node.js 官方网站:https://nodejs.org/zh-cn

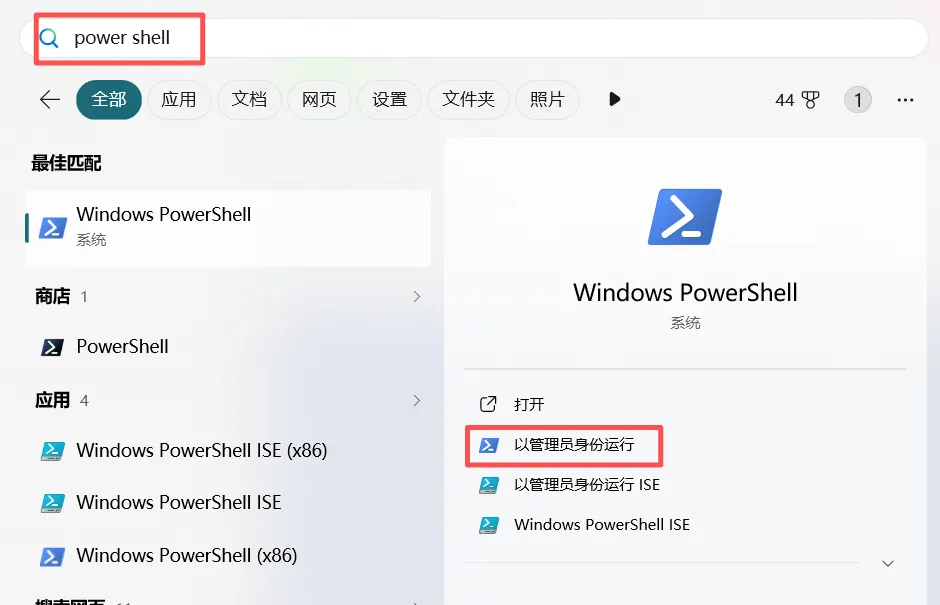

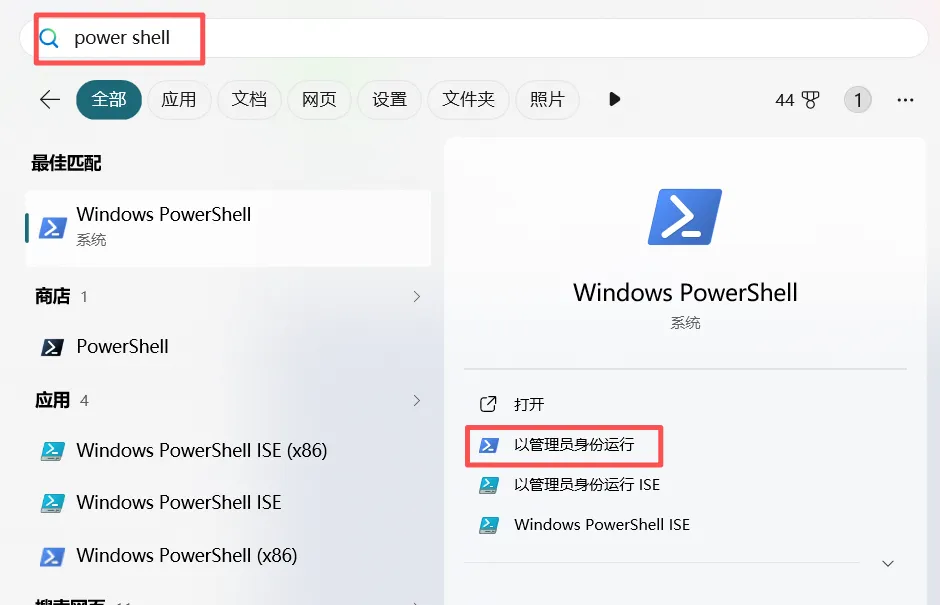

安装完成后,打开开始菜单,如下图用管理员权限打开power shell窗口

输入如下命令:

node -v 回车后会出现node的版本,提示安装成功;

输入:npm -v 加车后会出现npm的版本。

(二)安装Git

1. 下载安装包

访问官方下载页面:https://git-scm.com/download/win

2. 安装步骤

双击下载的 .exe 文件,按向导安装:

|

|

|

|---|---|

|

|

|

|

|

|

|

|

推荐选择”Git from the command line and also from 3rd-party software” |

|

|

|

|

|

推荐选择”Checkout Windows-style, commit Unix-style line endings” |

|

|

|

3. 验证安装

打开新的 CMD 或 PowerShell 窗口:

git --version显示类似 git version 2.43.0.windows.1 即安装成功。

二、安装openclaw

(一)全局安装方法

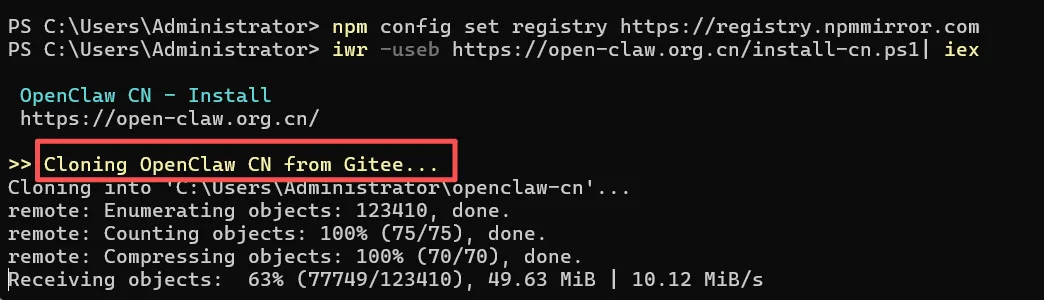

1、修改国内镜像地址

在管理员PowerShell中,输入以下命令:

npm config set registry https://registry.npmmirror.com并回车,将npm包的下载源改为国内镜像,能大大提升安装速度;

2、安装openclaw

然后在同一个窗口中,输入以下命令:

openclaw

npm install -g openclaw@latestopenclaw-cn

npm install -g openclaw-cn@latest并回车,开始全局安装OpenClaw,

然后看到类似于 + openclaw@版本号 的提示即表示安装成功。

1、Windows本地部署

核心方案对比:

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

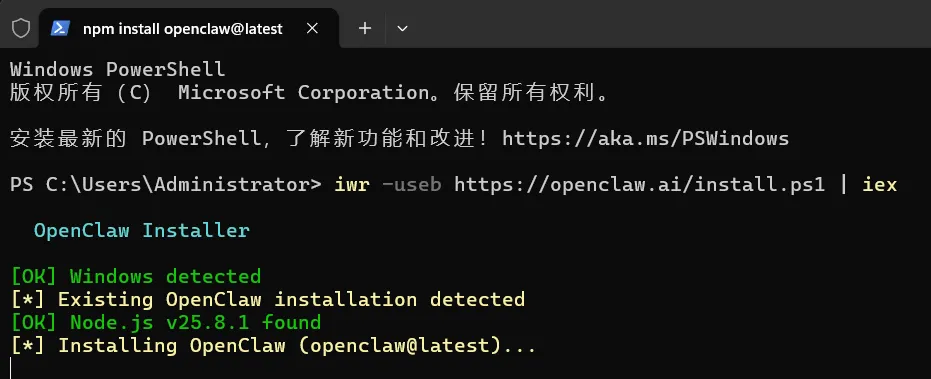

用管理员权限打开power shell窗口

openclaw

iwr -useb https://openclaw.ai/install.ps1 | iex

openclaw-cn

iwr -useb https://open-claw.org.cn/install-cn.ps1| iex

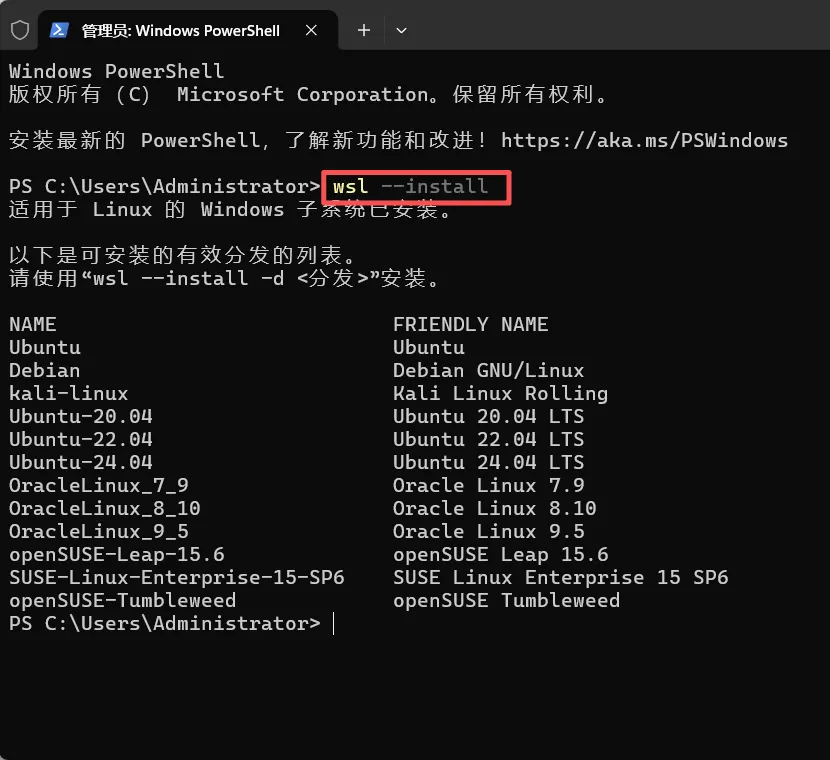

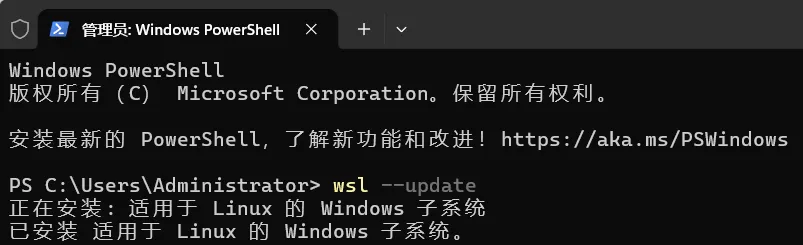

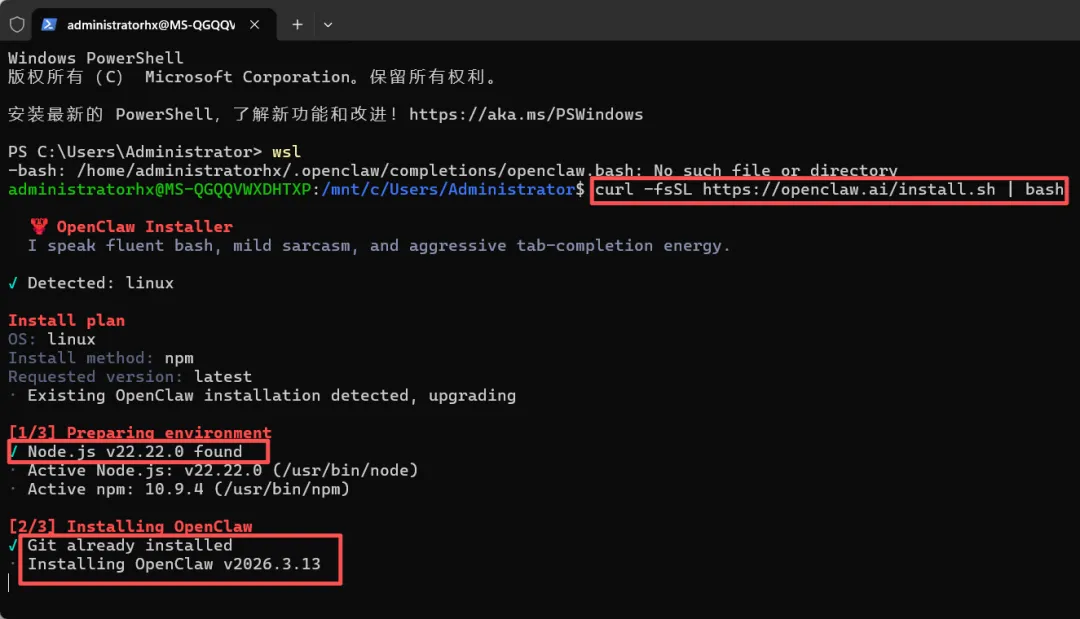

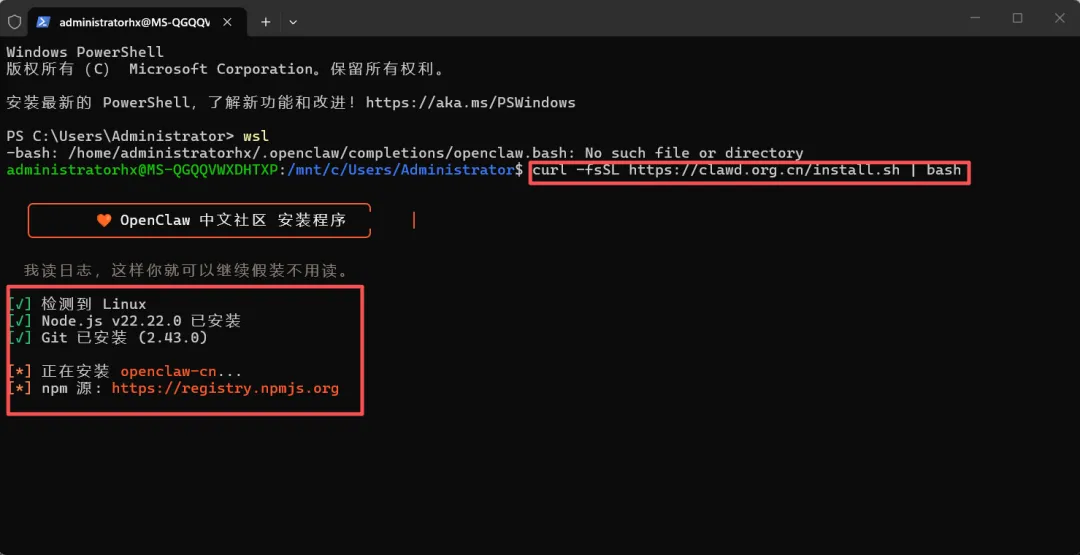

(2)WSL2+Ubuntu环境下安装

wsl --install

wsl --update

openclaw

curl -fsSL https://openclaw.ai/install.sh | bash

openclaw-cn

curl -fsSL https://clawd.org.cn/install.sh | bash

三、配置 OpenClaw 连接本地 Ollama + DeepSeek

(一)Ollama+Deepseek安装

见“DeepSeek本地化部署喂饭级教程”文章

(二)openclaw启动配置向导配置本地模型

openclaw onboard --install-daemon相关配置按提示选择:

|

|

|

|---|---|

|

|

y |

|

|

QuickStart |

|

|

Custom Provider

|

|

|

http://127.0.0.1:11434/v1

|

|

|

ollama-local

|

|

|

OpenAI-compatible |

|

|

deepseek-r1:7b

|

|

|

deepseek-local

|

|

|

N

|

|

|

N |

|

|

Open the Web UI |

完成后,浏览器将自动打开:http://localhost:18789

(三)修改openclaw.json配置

openclaw.json主配置文件位置

Windows路径:

C:\Users\<用户名>\.openclaw\openclaw.json

Linux/macOS路径:

~/.openclaw/openclaw.json

Agent模型配置文件

~/.openclaw/agents/main/agent/models.json

修改配置文件

{"models": {"mode": "merge","providers": {"custom-127-0-0-1-11434": {"baseUrl": "http://127.0.0.1:11434/v1","apiKey": "ollama","api": "openai-completions","injectNumCtxForOpenAICompat": true,"models": [{"id": "qwen2.5:7b-32k","name": "qwen2.5:7b-32k","reasoning": false,"input": ["text"],"cost": {"input": 0,"output": 0,"cacheRead": 0,"cacheWrite": 0},"contextWindow": 32768,"maxTokens": 32768}]}}}}

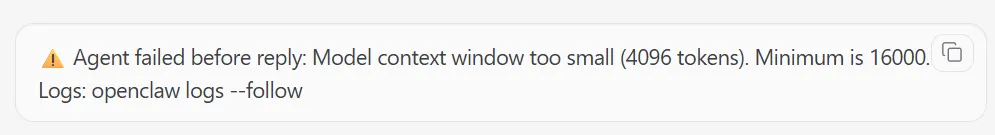

(四)ollama token不足解决方案

按照上述配置ollama本地算力模型,Agent会报错

解决OpenClaw本地部署时”Model context window too small (4096 tokens). Minimum is 16000″错误的完整方案如下:

1、问题原因

OpenClaw 在启动时会读取本地模型(如Ollama或LM Studio)的元数据,但默认情况下对于”不认识”的本地模型会将其上下文窗口限制为4096 tokens。即使您已在Ollama中设置了更大的上下文窗口(如32768),OpenClaw仍会缓存并使用4096这个默认值。

2、解决方案

方法一:使用命令行快速配置

如果您使用的是OpenClaw 2026.3.x版本,可以直接使用命令行设置:

# 设置默认上下文窗口

openclaw config set models.default.contextWindow 16000# 设置最大tokens

openclaw config set models.default.maxTokens 16000# 重启网关生效

openclaw gateway restart注意:根据您的模型实际能力,建议设置为 32768 或更高(如128000),而不是刚好16000。

方法二:手动修改配置文件(更灵活)

(1)修改openclaw.json配置文件

找到 models.providers 下您的本地模型配置(如 custom-127-0-0-1-11434 或 ollama),将 contextWindow 和 maxTokens 从 4096 改为 32768 或更高:

{"models": {"mode": "merge","providers": {"custom-127-0-0-1-11434": {"baseUrl": "http://127.0.0.1:11434/v1","apiKey": "ollama","api": "openai-completions","injectNumCtxForOpenAICompat": true,"models": [{"id": "qwen2.5:7b-32k","name": "qwen2.5:7b-32k","reasoning": false,"input": ["text"],"cost": {"input": 0,"output": 0,"cacheRead": 0,"cacheWrite": 0},"contextWindow": 32768,"maxTokens": 32768}]}}}}

关键参数说明:

-

contextWindow: 32768(或根据模型实际能力设置,如128000) -

maxTokens: 32768(模型一次生成的最大token数) -

injectNumCtxForOpenAICompat: true(重要:确保Ollama使用正确的上下文窗口而非默认4096)

(2)针对Ollama的特殊配置

如果您使用Ollama作为后端,还需要确保Ollama本身配置了正确的上下文窗口:

1)创建自定义Modelfile

# 进入您的工作目录cd C:\Users\Administrator# 创建 Modelfile(注意:指令必须小写)@"from qwen2.5:7bparameter num_ctx 32768parameter temperature 0.7"@ | Out-File -FilePath "Modelfile" -Encoding utf8

这是将 PowerShell 的 Here-String 语法,我不会用,所以改为使用 echo 命令逐行创建文件的方式。

2)CMD 逐行命令(Windows)

echo from qwen2.5:7b > Modelfileecho. >> Modelfileecho parameter num_ctx 32768 >> Modelfileecho parameter temperature 0.7 >> Modelfile

生成新模型

ollama create qwen2.5:7b-32k -f Modelfile验证 ollama list

然后在OpenClaw配置中使用 qwen2.5:7b-32k 作为模型ID 。

修改后重启

必须完全退出OpenClaw后重新启动:

停止当前运行的OpenClaw(Ctrl+C终止终端进程)

(3)重新对接Ollama(关键配置)

初始化时按提示选择:

1. Model provider:选 Custom Provider(列表最后)

2. API Base URL: http://127.0.0.1:11434/v1

3. API Key:填任意字符串(如 ollama ,Ollama无需真实Key)

4. Model name: qwen2.5:7b-32k (你定制的模型名)

5. 完成后重启OpenClaw(必做)

重启后,建议输入 /status 查看当前上下文限制是否已更新 。

验证是否解决

-

启动OpenClaw TUI:

openclaw tui -

输入

/status查看上下文窗口大小 -

尝试进行对话,确认不再出现”Model context window too small”错误

如果仍然报错,请检查:

-

两个配置文件是否都已修改并保存

-

模型ID是否与Ollama中运行的模型完全一致

-

injectNumCtxForOpenAICompat是否设置为true(Ollama必需)

夜雨聆风

夜雨聆风