AI说错话,凭什么叫「幻觉」?一场正在改写行业话语权的命名之战

Groq创始人Jonathan Ross一条推文炸了:「两年后,严肃的人都不会再把AI的错误叫’幻觉’了。」这不是在抠字眼——叫「幻觉」还是叫「错误」,决定了AI公司能不能继续把产品bug包装成神秘现象,也决定了谁来为这些错误负责。一场关于AI解释权的战争,已经悄悄打响。

一个词,藏着一场骗局

先说一个真实案例。

2023年,美国一名律师用ChatGPT准备法庭材料,AI信心满满地引用了六个判例。律师照单全收,提交法院。结果法官一查:六个案例,全部不存在。

律师被罚款,颜面尽失。

AI公司怎么解释?「这是幻觉(hallucination)。」

这个词用得太妙了。幻觉——像梦境,像艺术,像某种神秘的感知偏差。听起来,AI只是偶尔「看见了不存在的东西」,带点科幻味,带点无奈,却不带任何责任。

但现在,有人要把这块遮羞布扯掉了。

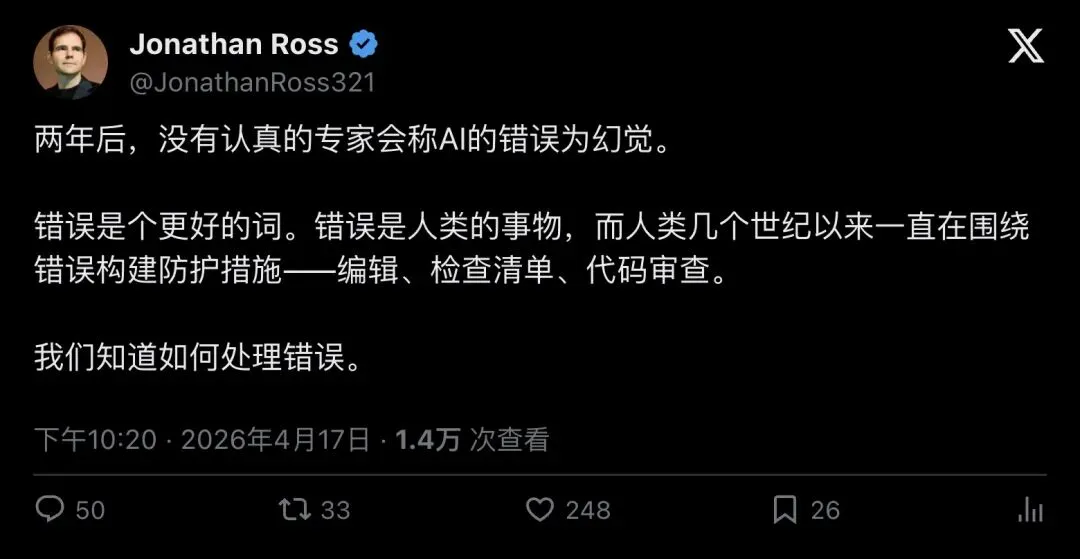

▲ Groq创始人Jonathan Ross,2026年4月17日,1.4万人围观

Ross的炸弹:「两年后没人再说幻觉」

Jonathan Ross不是普通人。他是Google TPU的创造者,Nvidia首席软件架构师,Groq创始人——AI硬件圈里真正懂底层的人。

4月17日,他发了这条推文:

“In two years, nobody serious will call AI errors hallucinations. Error is the better word. An error is a human thing, and humans have been building guardrails around errors for centuries – editors, checklists, code reviews.

Errors we know how to handle.”

「两年后,严肃的人都不会再把AI的错误叫幻觉。错误才是更好的词。错误是人类的东西,人类几百年来一直在为错误建立护栏——编辑、清单、代码审查。错误,我们知道怎么处理。」

14112人看到了这条推文,248人点赞,50条回复。

但真正值得抓的,不是「两年后」这个预测,而是后两句话。

Ross在做一个工程类比:人类社会已经为「错误」发展出一整套防护机制。AI也应该被放进这个治理框架里。

叫「幻觉」,就是在说:这东西神秘,难免,你只能接受。

叫「错误」,就是在问:错误率是多少?在哪个环节产生?怎么加校验?谁来负责?

一字之差,天壤之别。

不只是Ross一个人在说

这场讨论,早就在多个方向同时发酵。

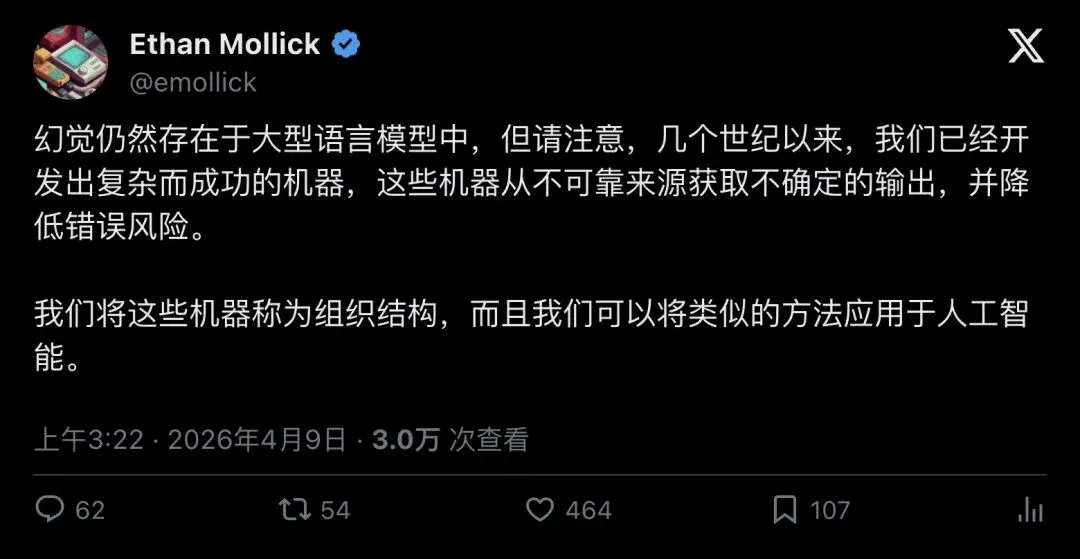

Wharton商学院教授Ethan Mollick,在Ross发推前几天,发了一条被近3万人看到的推文:

“Hallucinations remain in LLMs, but note that over centuries we have developed complicated, successful machines that take uncertain output from unreliable sources & reduce the risk of errors. We call those machines organizational structures & we can apply similar approaches to AI.”

「幻觉在大模型里依然存在,但几百年来,人类已经发展出复杂而成功的机器,用来把不可靠来源的不确定输出降风险。那种机器,就叫组织结构。同样的方法,可以用在AI上。」

▲ Wharton教授Mollick:464赞,3万人围观

Mollick没有否认幻觉还在,但他把重点放到了组织、流程、校验、分工上。和Ross的「编辑、清单、code review」,是同一路数。

更早的声音来自学术界。东北大学AI研究院的Usama Fayyad,早在2023年就说得更直接:

“Generally speaking, we don’t like the term because these models make errors — and we can explain why they make errors.” “When you say hallucinations, you’re attributing too much to the model… intent; consciousness; understanding.”

「我们不喜欢这个词,因为这些模型是在犯错——而且我们可以解释它们为什么犯错。说’幻觉’,是在给模型赋予太多东西:意图、意识、理解力。」

联合国大学(UNU)也发文批评:

“To build and integrate artificial intelligence into our society responsibly, we must speak about it with precision.”

「要负责任地把AI融入社会,我们必须精确地谈论它。」

就连Google Cloud,在自己的官方解释页面上,也已经把AI hallucinations定义为「incorrect or misleading results that AI models generate」——不正确或误导性的结果。

哪怕平台没有弃用这个词,落地定义里,它已经被「错误化」了。

反对者说:不是一回事

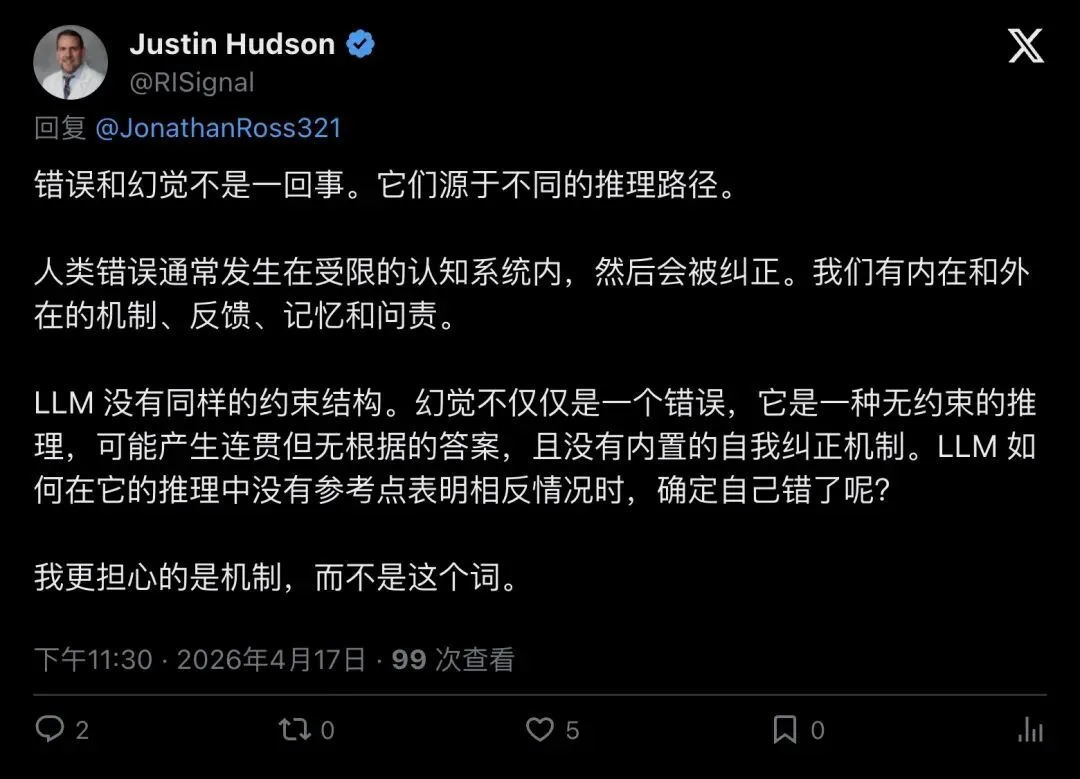

当然,Ross的回复区里也有人不买账。

Justin Hudson(@RISignal)的反驳逻辑清晰:

“An error and a hallucination are not the same thing. They come from different reasoning paths… A hallucination is not just a mistake, it is unconstrained inference that can produce a coherent but unfounded answer with no built in self correction.”

「错误和幻觉不是一回事,它们来自不同的推理路径……幻觉不只是一个失误,它是无约束的推断,能产出连贯但毫无根据的答案,而且没有内置的自我纠错机制。」

▲ Justin Hudson:我更关心的是机制,不是词

另一位用户grant说得更简洁:

“yeah but hallucinations are a specific kind of error… grabbing the wrong information is an error, making something up entirely is a hallucination. the distinction is valuable.”

「幻觉是一种特定类型的错误……抓错信息是error,完全凭空编造是hallucination。这个区分是有价值的。」

这两条反驳,代表了「机制保留派」的核心立场:他们不反对把AI输出当工程问题治理,但反对把所有错误压扁成同一种error——因为LLM的错误往往是流畅、完整、强自信、却没有事实锚点的那种。

这是很强的论点。

真正的分歧:治理语言 vs 机制语言

把这场争论拆开来看,其实双方说的不是同一件事。

Ross派强调的是治理可落地:

-

叫error,就能问错误率 -

叫error,就能建评估集 -

叫error,就能加护栏、做人工复核、追责任边界

Hudson/grant这派强调的是机制不要被抹平:

-

LLM的错不是普通软件报错 -

它是「高流畅度、高置信度、低事实锚定」的特殊失败模式 -

这个特征值得保留一个专属标签

两边都有道理。但有一个数据,让这场争论的天平开始倾斜。

2026年初,OpenAI自己的研究论文,从数学上证明了:对于自回归语言模型,幻觉/错误是不可消除的固有属性。o1的错误率16%,o3是33%,o4-mini高达48%。

这不是偶发的神秘现象。这是可度量的系统性错误。

这个词,帮了谁的忙

现在可以说一件更不舒服的事了。

「幻觉」这个词,客观上对AI公司非常有利。

它把产品缺陷包装成了一种带点诗意的特质。它让用户觉得「AI就是会偶尔抽风,这很正常」。它让监管者很难追问:你的错误率是多少?你的护栏在哪里?你的责任边界在哪里?

一旦改叫「错误」,游戏规则就变了。

教育、医疗、金融、法律——这些场景对「错误」语言极度敏感。一旦承认这是error,就意味着要有error budget、review流程、责任边界和补救机制。

这正是Ross们想要的。也正是某些人不想要的。

结语:词语是战场

语言不是中立的。

「幻觉」让AI显得神秘而难以驯服。「错误」让AI变成一个需要被治理的工程系统。

这场命名之争的本质,是AI行业从「新奇玩具」进入「生产工具」阶段的必然阵痛。越进入真实业务,越不接受神秘说法,越要追责和控风险。

Ross说,两年后严肃的人都不会再说「幻觉」了。

也许不需要两年。

当一个词开始帮人逃避责任,它的寿命,就已经进入倒计时了。

— END —

夜雨聆风

夜雨聆风