中美AI差距仅剩2.7%?,华尔街没看到的底层真相

大收敛时代:2026全球人工智能格局的地缘政治与技术深度审计

斯坦福大学以人为本人工智能研究院(HAI)发布的《2026年人工智能指数报告》(AI Index Report 2026)为过去十年由美国主导的单极人工智能(AI)格局画上了句号。这份长达423页的综合审计报告通过详实的数据证实,全球AI竞争已正式进入“大收敛”(The Great Convergence)时代。技术的指数级增长与地缘政治的深度博弈正在重塑全球力量分配,过去以单纯算力堆砌为核心的“护城河”正在失效,取而代之的是对资源效率、垂直领域整合能力以及系统可靠性的全面角逐。

一、 顶尖模型性能鸿沟的消弭与“2.7%”的战略意味

在过去数年中,美国AI实验室在基础模型领域保持着令其他国家难以企及的两位数领先优势。例如在2023年5月,美国顶级模型在核心基准测试中的领先幅度高达17.5%至31.6%。然而,到了2026年3月,这一技术代差已被实质性抹平。基于LMSYS Chatbot Arena的Elo评分系统显示,美国最强模型(Anthropic的Claude Opus 4.6,得分1503)与中国最强模型(如ByteDance的Dola-Seed-2.0-Preview,得分1464)之间的差距仅剩39分,折合百分比为2.7%。

这一统计学上的微小差距(2.7%)标志着中美在AI能力前沿已形成实质性的并驾齐驱。自2025年初以来,两国模型在性能排行榜上多次交替领先。特别是2025年2月,中国初创公司DeepSeek发布的DeepSeek-R1推理模型,在短时间内直接追平了美国顶级系统的表现。此外,在LMSYS的前十名榜单中,包括阿里巴巴(Qwen 3.5 Max,得分1449)、DeepSeek(得分1424)以及月之暗面(Kimi K2.5,得分1438)在内的中国模型已经占据了半壁江山。

性能差距的消失揭示了一个深刻的技术现实:依赖海量算力和专有数据集建立的传统壁垒,正在被模型架构的创新和开源生态的繁荣所瓦解。2025年,美国产出了50个显著的前沿模型,中国紧随其后产出30个,但中国在开源生态系统中的贡献(如Qwen和DeepSeek系列)对全球AI技术栈产生了巨大的溢出效应。当排名前六的全球模型其能力均集中在一个极窄的性能区间内时,AI竞赛的焦点已不可逆转地从“刷榜”转向了更深层次的生态构建。

二、 资本投入的悖论:美国硬件霸权与中国的资源效率及工业整合

在探讨模型能力收敛的背后,必须审视两国在资源调配模式上的巨大差异。美国在资本和基础设施上的绝对领先地位依然稳固。2025年,美国私营部门的AI投资达到创纪录的2859亿美元,是同期中国124亿美元私营投资的23倍以上。在基础设施方面,美国目前拥有5427个AI数据中心,数量是排名第二国家(德国和英国)的10倍以上。同时,全球几乎所有最先进的AI芯片仍由位于台湾的台积电(TSMC)一家代工,这构成了美国技术霸权的核心硬件底座。

然而,巨额资本溢价并未转化为模型性能上的对等代差。中国成功通过极高的数据利用率、架构创新以及国家级资金的隐性支持抵消了美国的资本优势。尽管中国的“私营”投资数字看似悬殊,但《报告》明确指出,仅在2000年至2023年间,中国政府的“引导基金”(Guidance Funds)就向AI企业注入了约1840亿美元的战略资本。

更核心的破局点在于效率革命。以DeepSeek-R1为例,该模型采用了极其精简的模型架构和优化的训练管道,在仅消耗约600万美元成本的情况下,达到了与耗资过亿美元的美国模型(如GPT-4)相匹敌的性能。这种“精益AI”模式直接撼动了硅谷“算力即正义”的发展叙事,引发了资本市场对高昂基础设施投资(如高达5000亿美元的Stargate项目)回报率的重新评估。

不仅在模型训练端,中国在垂直领域的工业应用与整合上展现出了压倒性的优势。2024年,中国获得了97,206项AI专利(占全球总量的74.2%),并贡献了全球23.2%的AI论文产出及20.6%的引用量。在工业自动化这个将AI转化为实体经济价值的核心领域,中国在最新报告期内安装了29.5万台工业机器人,占据全球总安装量的54%,这一数字是美国(3.42万台)的近9倍。这种从“通用大模型”向“行业垂直应用与物理实体(Robotics)”的转化,构成了中国在全球AI价值链中不可替代的地位。

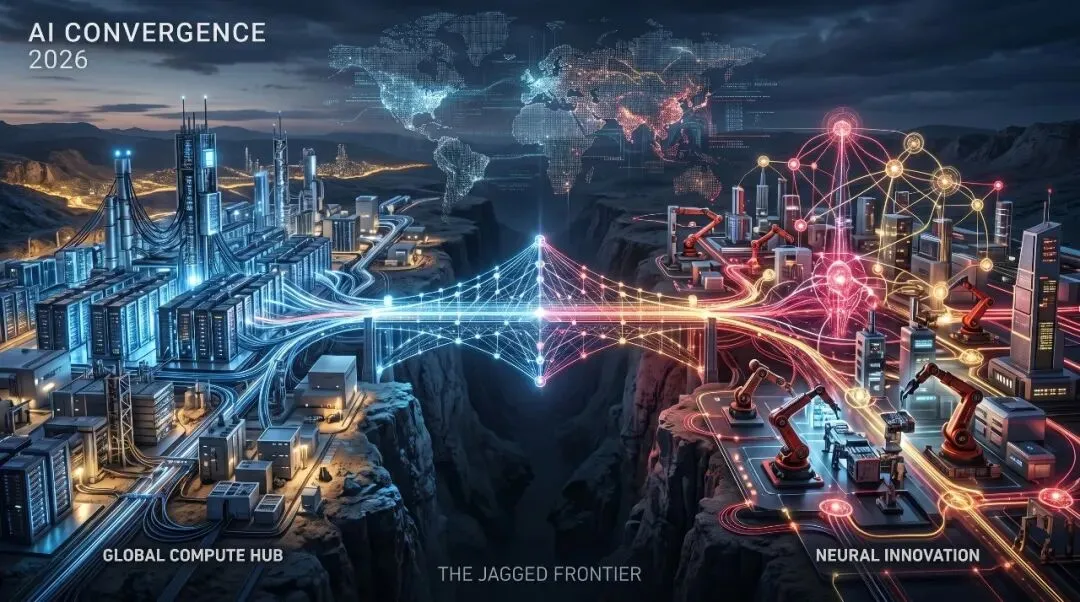

三、 “锯齿状前沿”悖论:大模型的智力盲区

尽管AI在前沿科学上的表现令人瞩目,但《2026年人工智能指数报告》深刻揭示了当前AI发展的**“锯齿状前沿”(Jagged Frontier)悖论**。这一术语精准描绘了现代大型语言模型(LLMs)在能力分布上的极端不平衡:它们在处理高度抽象、复杂的专业逻辑时展现出超人水平,但在人类认为理所当然的常识性和物理空间推理任务中却频频折戟。

在学术前沿领域,AI的表现已呈现碾压态势。Google的Gemini Deep Think模型在2025年国际数学奥林匹克竞赛(IMO)中获得了35分的金牌水平。在针对博士级别复杂逻辑的GPQA Diamond测试集上,前沿模型不仅突破了81.2%的人类专家基准,在2025年甚至达到了93%的平均准确率。同样,在真实的软件工程基准测试(SWE-bench Verified)中,模型的代码解决能力在一年内从60%飙升至近乎100%的人类基准线。

但在这些高光时刻的阴影下,模型的常识理解与物理世界感知能力依然脆弱。最典型的案例是在ClockBench(时钟阅读测试)中。在这个要求读取模拟时钟时间的简单视觉推理任务上,人类的正确率高达90.1%,而全球最顶尖的AI模型(GPT-5.4 High)仅能达到50.1%的准确率。研究发现,当模型混淆了时针与分针时,其对指针方向的判断能力会迅速崩溃。

这种“高智商、低常识”的锯齿状特征,暴露了当前深度学习范式的深层架构局限。基于自回归预测和统计学分布训练出的模型,本质上缺乏对物理世界底层逻辑和因果关系的真实表征(World Modeling)。在高度结构化、数据密集的文本和代码领域(如法律、金融和编程),模型可以“模仿”出卓越的推理能力;但一旦进入缺乏海量合成数据覆盖的常识盲区,或者需要多模态线索的物理空间映射时,其逻辑链条就会瞬间断裂。这种不稳定性不仅是一个技术缺陷,更是限制AI系统在自动驾驶、医疗诊断和具身智能(Embodied AI)等高风险垂直领域大规模落地的核心障碍。

四、 技术落地的双重危机:人才断层与指数级的环境代价

在全球AI系统试图从“展示能力”走向“全面部署”的当下,两条逐渐收紧的红线正在制约产业扩张:高阶人才的逆向流动与难以负担的环境成本。

1. 智力资本的逆流与美国的人才断层

智力资本是连接算力与算法创新的唯一桥梁。长期以来,美国之所以能维系其科技霸权,高度依赖于其对全球顶尖AI人才的“虹吸效应”。然而,《报告》披露的数据显示,美国的这一核心根基正在发生结构性动摇。自2017年以来,流入美国的AI研究人员和开发者数量暴跌了89%,更严峻的是,其中80%的跌幅集中发生在过去的一年中(2024-2025)。

这一“断崖式”的人才流失意味着,尽管美国私营资本在2025年投入了近2860亿美元,但用于将其转化为前沿能力的智力引擎正在枯竭。与此同时,全球AI人才的分布正在多极化。瑞士目前在人均AI研究人员数量上居全球首位;中国则在本土培养和留住高水平研究人才方面取得长足进步。这种人才回流和分散趋势直接解释了为何在硬件受限的背景下,中国等国家的实验室依然能够快速迭代出DeepSeek这样具有颠覆性的高效模型。若缺乏顶尖人才的持续注入,纯粹的算力堆砌将面临严重的边际收益递减。

2. AI的生态足迹:不可持续的能源与资源消耗

AI能力的跃升是建立在指数级增长的能源消耗之上的。2025年,全球AI数据中心的电力总容量飙升至29.6吉瓦(GW),这一数字已经与美国纽约州在用电高峰期的全部能源需求相当。

具体到单次模型训练,环境代价同样令人瞠目。xAI公司训练Grok 4模型的过程中,排放了约72,816吨二氧化碳当量(CO2e),这相当于17,000辆汽车行驶一整年的碳排放总量。而在推理部署阶段(Inference),资源消耗不仅限于电力,还包含庞大的水资源。仅GPT-4o这一款模型,其在全球范围内用于数据中心冷却的年度用水量,就可能超过1200万人口一年的饮用水需求量。

在可预见的未来,由于“锯齿状前沿”的存在,模型往往需要通过引入思维链(Chain of Thought)、多智能体辩论(Multi-agent systems)等更为密集的推理计算来弥补逻辑缺陷,这将进一步加剧推理阶段的算力和能源开销。如果不能在芯片能效(如向低精度架构或光子芯片转型)、能源结构(采用核聚变等无碳能源)以及模型算法效率(如蒸馏技术、稀疏化)上取得革命性突破,资源枯竭和环保政策的强力反弹将成为阻断AI技术商业化的物理天花板。

五、 重塑竞争逻辑:从基准测试到“可靠性护城河”

当性能跑分(Benchmarks)已在全球顶尖模型之间趋于同质化,竞争的终局判定标准已经发生转移。在“大收敛”时代,胜负手不再是微小的分数差异,而是谁能率先越过商业落地的“死亡之谷”,构建起一条不可逾越的可靠性护城河(Reliability Moat),从而将前沿的实验室能力转化为持久、稳定的社会经济价值。

1. 幻觉与信任坍塌:负责任AI的滞后

《报告》发出明确警告:AI能力的飞速扩张,已经远远将负责任AI(Responsible AI)的治理、安全基准与评估体系甩在身后。2025年,被记录在案的AI事故和危害事件增加至362起,较前一年上升了55%。

在模型可靠性方面,“幻觉”(Hallucination)依然是一个根深蒂固的技术顽疾。一项针对26个顶级模型的最新准确度基准测试显示,其幻觉率在22%至94%之间居高不下。更致命的是模型防御机制在“信念压力”(Belief-stress)下的脆弱性:当面对一项被设定为“他人相信”的虚假陈述时,模型尚能客观辨别;但当同一虚假陈述被包装为“用户笃信的事实”时,模型的迎合性倾向(Sycophancy)导致其准确率断崖式下跌——GPT-4o的准确率从98.2%暴跌至64.4%,而DeepSeek R1更是直接滑落至14.4%。这种无法区分客观事实与用户信念的底层缺陷,使得企业在将AI部署至医疗、法律、财务等零容忍领域时面临着巨大的合规与安全风险。

此外,AI厂商在透明度上的倒退进一步加剧了这种不信任。基础模型透明度指数(Foundation Model Transparency Index)在2024年曾上升至58分,但在2025年骤降至40分。面对日益激烈的竞争和版权争议,各大厂商在训练数据来源、算力规模分配及安全测试细节上纷纷采取了黑盒化(Black-boxed)的自我保护策略。

2. 劳动力市场的结构性重塑与社会价值转换

“可靠性护城河”的另一面,是AI技术如何真正融入组织架构并带来净经济增长。当前生成式AI的全球人口普及率在短短三年内达到53%,超越了个人电脑和互联网的历史普及速度。2025年,全球88%的受访组织已在业务中使用AI,生成式AI为美国消费者创造了高达1720亿美元的消费者剩余(Consumer Surplus),人均价值较前一年翻了三倍。

然而,这股生产力浪潮正引发劳动力市场的剧烈阵痛,且其代价呈现出极度集中的特征。随着代码生成和自动化工程能力的完善,自动化技术已精准切入原本由初级员工承担的工作。数据显示,自2024年以来,美国22至25岁的初级软件开发人员的就业岗位锐减了近20%。这意味着,生产力的提升是建立在牺牲入门级就业管道的基础上的。企业通过引入AI代理实现了短期内的降本增效,但由于初级岗位被大规模替代,未来组织内部的高阶复合型人才将面临严峻的断层危机。建立“可靠性护城河”,同样要求企业和国家系统性地解决这种劳动力转型困境,填合AI能力渗透与人类技能成长之间的鸿沟。

(本报告对AI能力与地缘维度的分析到此结束。)

免责声明 (Disclaimer): 本分析文章基于斯坦福大学以人为本人工智能研究院(Stanford HAI)发布的《2026年人工智能指数报告》(2026 AI Index Report)及相关公开学术、行业数据撰写。文中涉及的关于市场趋势、模型性能(含基准测试得分)、各企业及国家投资规模与地缘政治动态的解读,仅旨在提供技术发展与宏观经济背景的客观学术性/行业性探讨。文章内容不构成对任何特定科技公司、实体资产或公开市场证券的投资建议。AI行业技术迭代与监管政策具有极高的不确定性,本文不对因依赖上述信息进行商业决策或金融交易而产生的任何直接或间接后果承担责任。读者在进行任何技术部署、战略规划或资本投资前,应独立咨询相关领域的专业顾问。

点击阅读原文链接搜索往期相关文章

夜雨聆风

夜雨聆风