深度拆解:支撑所有AI工具的底层技术栈,从算力到应用的全链路硬核解析

引语:当你轻触屏幕发出指令,AI便在毫秒间给出回应。这份流畅体验的背后,是一套精密如钟表的技术架构在协同运转。从冰冷的芯片到灵动的交互,每一层都暗藏着智能诞生的密码。

🏗️ 基础设施层:AI的算力基石

核心:GPU/NPU/ASIC芯片、高速存储、液冷数据中心

这是AI的物理根基,千亿参数模型的训练与推理全赖于此。主流AI集群以万卡级GPU为核心,搭配HBM高带宽内存与InfiniBand高速网络,单集群算力可达百亿亿次/秒。据中国信通院2026年数据,全球AI算力缺口仍超40%,国产昇腾910C芯片性能已达国际旗舰的80%,正加速填补供给空白。

📊 数据资源层:AI的智能燃料

核心:多模态语料、合规清洗、隐私计算、高质量标注

数据是模型的“食粮”,优质数据直接决定AI上限。训练千亿参数模型需万亿级Token的文本、图像、音视频数据。受《生成式AI服务管理暂行办法》约束,合规数据获取成本上涨40%,隐私计算、联邦学习成为数据安全流通的关键技术。

🧠 模型框架层:AI的核心引擎

核心:Transformer架构、MoE稀疏激活、预训练/微调范式

Transformer是现代大模型的统一底座,2017年由Google提出,以自注意力机制实现并行计算与长文本理解。当前主流模型(GPT、文心一言、通义千问)均基于此构建。参数突破万亿后,MoE混合专家架构通过“稀疏激活”降低**60%**推理成本,成为规模化标配。

🛠️ 开发工具层:AI的工程化中台

核心:RAG检索增强、提示工程、模型压缩、分布式训练

此层将基础模型转化为可用工具。RAG技术让模型实时调用外部知识库,解决“幻觉”与知识滞后问题;模型量化、蒸馏技术把千亿参数压缩至可在手机端运行,边缘AI加速普及。

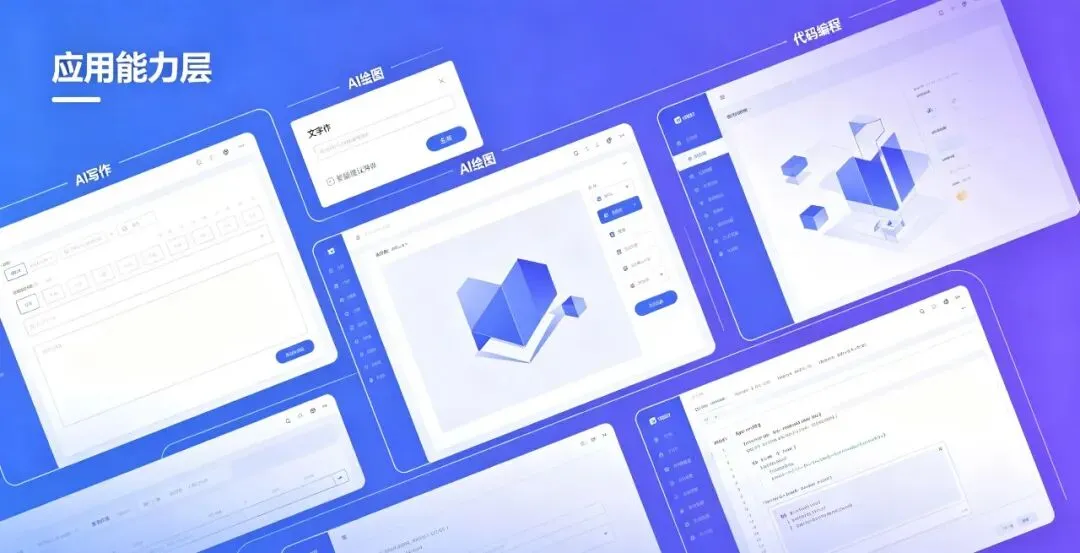

💡 应用能力层:AI的价值外化

核心:NLP、多模态生成、代码理解、智能体决策

技术栈在此转化为用户可见能力:文本创作、图像生成、语音对话、逻辑推理。2026年艾媒咨询数据显示,中国AI大模型市场规模达738.57亿元,6年增长45.5倍。企业服务、制造、医疗等领域AI渗透率超50%,核心环节效率提升30%-80%。

🌐 终端交互层:AI的用户入口

核心:智能助手、ChatBot、API服务、行业SaaS、AI终端

这是技术的最终呈现:Copilot、文心一言、AI客服等。2026年,AI正从聊天工具转向垂直生产力工具,“按结果付费”成为主流商业模式 。AI手机、AI PC渗透率快速提升,智能交互无处不在 。

⚖️ 行业现状:繁荣与瓶颈并存

– 优势:技术成熟、场景落地加速、国产算力与模型快速追赶

– 瓶颈:高端芯片供应受限、高质量数据稀缺、训练成本高昂(单次千亿模型训练超2000万美元)、深度伪造检测准确率仅75%、88%企业应用AI但仅**6%**获高回报

🔮 未来趋势:迈向智能生态

1. 技术融合:多模态统一、具身智能(AI+机器人)爆发,2028年市场规模破万亿

2. 架构进化:通用底座+垂直模型闭环,轻量化、低能耗成为方向

3. 生态成熟:国产软硬件协同完善,算力自给率提升;监管与伦理体系健全

4. 商业变革:中小企业AI渗透率破60%,AI成为数字基础设施

结语:AI技术栈是层层递进的精密体系,从算力、数据到模型、应用,缺一不可。当前行业正从技术竞赛转向价值落地,突破瓶颈、深耕场景,才能让AI真正赋能千行百业。智能时代的蓝图,正由这套底层架构一笔笔勾勒。

💬 文末互动:你日常最常用哪款AI工具?你认为AI技术栈下一个突破点会是算力、模型还是应用场景?评论区聊聊你的看法~

夜雨聆风

夜雨聆风