人工智能(AI)正在重塑一切,但它的风险你真的了解吗?

-

预计在未来四年内,全球约40%的岗位将受到AI影响

-

AI深度参与社会运行,其影响将是系统性的,而不是局部的

-

“变革性”的人工智能,可能带来一系列跨领域的风险

近两年以来,从ChatGPT写报告,到用人工智能(AI)自动生成代码、分析数据、甚至参与企业的商业决策,越来越多的工作,正在被AI“重塑”。

这种变化,感觉上并不是渐进式的,而更像是“突然发生”的。

很多人开始主动学习如何用AI提升效率:写邮件更快了、做分析更轻松了、编程序更容易了,甚至连复杂的研发报告也可以在AI的协助下一键生成。但与此同时,也有越来越多人开始隐隐不安:自己的工作,会不会在不知不觉中被替代?

很多人甚至是在“还没准备好”的情况下,被卷入其中。而这种焦虑,并非空穴来风。

在近期的世界经济论坛上,国际货币基金组织(IMF)总裁Kristalina Georgieva,用了一个非常强烈的词来形容AI对劳动力市场的冲击:“海啸(Tsunami)”。这个比喻背后的含义很清晰:不是局部影响,而是系统性重塑。

根据IMF的研究,随着AI技术的快速普及,全球劳动力市场正在经历一轮深刻的结构性变化。预计在未来四年内,全球约40%的岗位将受到AI影响,而发达经济体中约有60%的工作岗位将受到人工智能的影响。

但更值得注意的是,这种变化并不只是“岗位数量”的变化,而是对“能力结构”的重塑:企业不再只需要“会做事的人”,而是更需要“能与AI协作、并理解其影响的人”。

但在这场被称为“海啸”的变革中,企业在思考如何用AI降本增效,个人在焦虑如何不被替代。几乎所有注意力,都集中在“效率” 和 “替代” 上。但一个更关键、也更容易被忽视的问题是:当AI越来越多地参与个人和企业的决策时,我们是否真的理解它的 “风险”?

理解人工智能风险的核心

人工智能风险的核心,其实在于一种“新的不确定性”。

早在2017年的“有益人工智能”会议上,全球众多AI领域的研究者共同提出了著名的“阿西罗马人工智能原则”。其中一个重要共识是:不应对未来人工智能的能力上限,做出过于乐观或过于悲观的假设。这背后的核心其实很简单:AI的发展,本身就充满不确定性。我们既无法完全预测它会强大到什么程度,也无法完全预判它会在哪些环节出现问题。但可以确定的是:一旦AI深度参与社会运行,其影响将是系统性的,而不是局部的。

研究人员也因此指出,具有“变革性”的人工智能,可能带来一系列跨领域的风险,例如:对劳动力市场的冲击,技术被滥用,虚假信息的大规模传播,数据与行为的广泛监控,以及技术能力向少数机构集中。

与此同时,AI技术的发展速度,正在超过很多既有监管和治理框架的演进速度。这意味着,在一些关键领域:技术已经可以应用,但相应的规则、边界和约束还没有完全建立。

个人、组织和社会面临的风险

进一步看,随着人工智能的发展与应用,个人、组织以及整个社会面临广泛的风险。

1. 个人层面:判断与自主性的风险

对个人来说,AI的影响往往最直接。

当越来越多决策依赖算法时,如果模型存在偏差或数据不当,可能导致不公平甚至错误的结果,影响个人层面有关贷款、医疗、应聘等关键决策。

与此同时,人们在与AI互动过程中,也容易产生“自动化依赖”,逐渐降低警惕性与独立判断能力。此外,基于个人数据的算法还可能被用于精准影响甚至操控个体决策,对隐私与自主性带来挑战。

个人层面上,真正的风险不只是被AI影响,更是逐渐“习惯依赖AI”。

2. 组织层面:决策与治理的风险

在企业中,AI正在成为决策的重要组成部分。

但过度依赖AI,可能带来“虚假信心”,比如:看似科学的数据支持,背后却隐藏偏差与缺陷。一旦决策失误,可能直接导致业务损失、客户不满,甚至引发声誉与法律风险。

同时,随着监管不断加强,AI的使用也必须符合隐私保护、模型治理等要求。

因此,当AI参与决策,企业不仅要“用好模型”,更要“管好模型”。

3.社会层面:结构性与系统性风险

与以往的工业与技术 “革命”类似,AI的发展也可能在社会层面带来风险。这些风险包括:在AI应用取代人类劳动的领域出现就业减少;掌握AI相关技能的人与未掌握者之间的财富差距扩大;以及在能够充分利用AI的国家(通常是更富裕、工业化程度更高的国家)与其他国家之间加剧全球不平等。

此外,AI也可能被不法分子利用,例如通过生成式AI制造和传播虚假信息(如深度伪造),以误导公众或操控舆论。

当“真假难辨”成为常态,风险就不再是个体问题,而是系统性问题。

如何评估“人工智能风险”的新技能,正在变得重要

越来越多机构开始意识到:AI带来的挑战,并不只是“用不用”,而是“如何用、如何管、如何负责”。在传统框架下,风险管理主要围绕市场风险、信用风险和操作风险等展开;但在AI时代,一个新的问题正在出现:当企业决策越来越依赖人工智能模型,谁来评估其本身的风险?

这不仅是技术问题,更是治理问题。企业需要的不再只是数据科学家去“构建模型” ,还需要一类新的能力去回答:模型是否可靠?决策是否公平?风险是否被充分识别?是否符合监管和伦理要求?AI时代,正在催生一种新的专业能力:AI风险管理。

人工智能与风险证书:应对AI风险的系统化学习路径

也正是在这样的背景下,全球风险管理专业人士协会(GARP)推出了风险与人工智能(RAI™)证书,试图系统性地回答一个问题:如何在充分利用AI的同时,有效识别、理解并管理其带来的风险?本项目的推出可以为风险管理专业人士提供一个系统化框架,帮助其理解AI、驾驭风险,并推动负责任的人工智能应用落地。

当AI成为基础能力,真正拉开差距的,不再是“谁会用AI”,而是谁能够理解并管理它带来的风险。

GARP推出的风险与人工智能(RAI)证书,由全球顶尖的人工智能专家与资深风险管理从业者共同开发。它并不是一门单纯讲“技术” 的课程,而是围绕一个核心问题展开:在AI时代,如何理解并管理风险?

通过RAI,学员将系统性地掌握:

- 人工智能与机器学习的发展脉络

- AI在商业决策中的实际应用工具与方法

- AI应用过程中潜在的各类风险

- 以及如何建立负责任的AI治理与风险管理框架

此外,项目还结合了多项独家案例研究,帮助学员从真实业务场景出发,理解企业如何在实际中部署AI、识别问题并应对风险。不仅“知道AI是什么”,更重要的是“知道如何安全地使用AI”。

下一期关于风险与人工智能的系列文章,我们将探讨:随着AI在金融业务中的深入应用,可能带来哪些新的金融风险?谁又应该开始关注并学习AI风险管理?

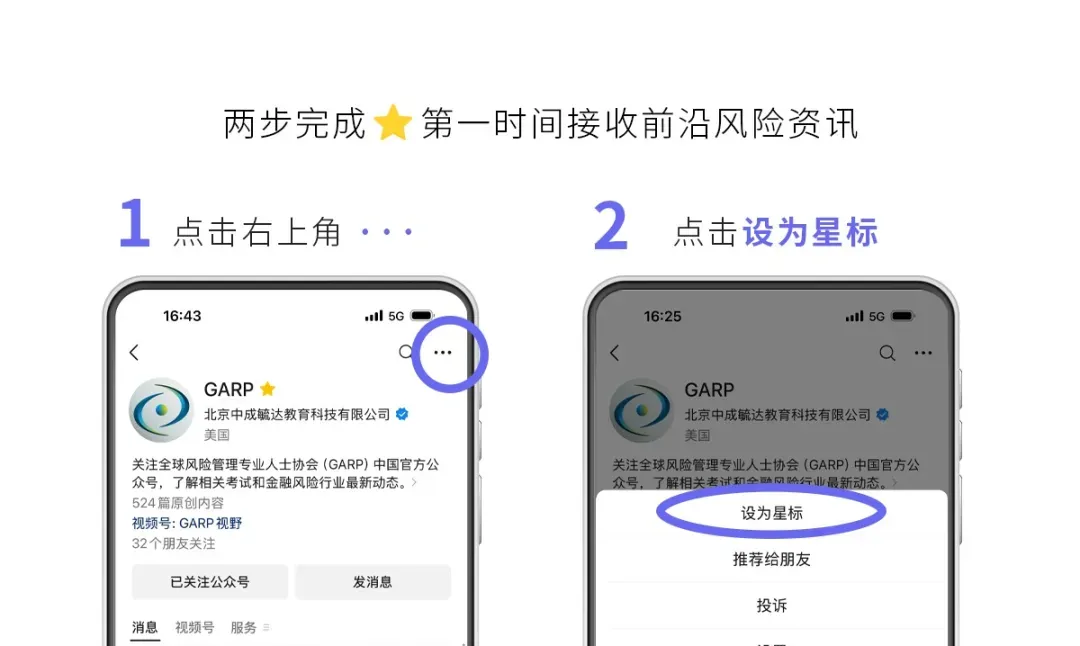

欢迎关注GARP公众号,期待你的点赞和分享。

点击阅读原文登录GARP官网,即可了解风险与人工智能(RAI)证书详情。

夜雨聆风

夜雨聆风